继斩获NeurIPS、ICCV、AAAI、ACMMM四大顶会认可后,后摩智能再传捷报——4篇论文成功入选国际顶级人工智能会议ICLR 2026(International Conference on Learning Representations),聚焦大模型低秩压缩、非线性算子高效近似、矢量量化以及MOE专项量化等端侧部署关键技术,提出多项创新性解决方案,进一步夯实后摩智能在端侧AI芯片与算法融合领域的技术壁垒,助力大模型在资源受限设备上实现高精度、高效率落地。

01【ICLR-2026】NLI:非均匀线性插值LUT

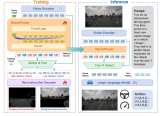

后摩智能芯片算法团队和东南大学联合提出非均匀线性插值方法NLI(Non-Uniform Interpolation LUT),并设计配套的NLI Engine硬件模块,攻克了大语言模型中非线性算子(如EXP、Rsqrt)在端侧部署时“精度与效率不可兼得”的难题,通过动态规划优化插值节点布局,实现非线性函数的高效近似,大幅降低硬件资源开销,适配各类端侧NPU平台。相关研究成果已应用于后摩智能端侧AI芯片的非线性计算单元设计。

非线性算子是LLMs推理过程中的核心组件,直接影响模型精度,但这类算子计算复杂,在端侧资源受限设备上难以高效部署。现有解决方案主要分为两类:一是基于神经网络的LUT拟合(如NN-LUT),但泛化能力差,易出现精度骤降;二是均匀插值LUT方法,无法适配非线性函数的曲率差异,高曲率区域误差过大,且硬件实现需大量比较器,资源开销高。这些问题严重制约了LLMs在端侧的实时推理性能。

NLI以“数据无关、全局最优、硬件友好”为核心目标,通过两大核心创新实现突破,同时配套硬件模块优化,形成“算法-硬件”协同解决方案:

核心创新一:动态规划非均匀节点布局(DP-based Non-Uniform Cutpoint Placement)。将插值节点(cutpoints)选择问题转化为动态规划问题,在固定节点预算下,基于FP16数值范围的曲率特征,全局优化节点分布,在高曲率区域密集布局节点,低曲率区域精简节点,既保证近似精度,又减少节点数量,避免资源浪费;同时无需数据校准,适配各类非线性算子,泛化能力极强。

核心创新二:两级地址翻译计算策略(Two-Level Address Translation)。设计“宏区间-微区间”两级布局,将全局节点划分为10个宏区间,中间8个宏区间再细分为32个微区间,仅需10个比较器即可完成地址定位,相比传统均匀插值方法(需259个比较器),大幅降低硬件开销;同时预计算插值系数,通过简单乘加运算完成线性插值,兼顾效率与精度。

核心创新三:NLI Engine硬件模块。NLI Engine采用四级流水线设计,适配1GHz时钟频率,集成LUT存储、两级地址翻译、线性插值计算等功能,可直接作为 plug-and-play 模块集成到端侧NPU中。实验表明,NLI在各项指标上全面超越现有SOTA方法:

软件层面:在LLaMA3、Qwen2.5等系列大模型上,替换非线性算子后,零样本精度、困惑度(PPL)与FP32浮点模型基本一致,最坏-case误差低于1.2×10⁻³,超越NN-LUT等方法;硬件层面:NLI Engine相比NN-LUT、RI-LUT硬件模块,面积分别节省68%、69%,功耗降低26%、29%,效率提升4.02×、4.29×,且吞吐量保持1GHz,完美适配端侧资源受限场景,为LLMs端侧实时推理提供核心计算支撑。

文章链接:https://arxiv.org/abs/2602.02988

02【ICLR-2026】SAES-SVD:自适应误差抑制SVD

后摩智能芯片算法团队提出自适应误差抑制低秩压缩框架SAES-SVD(Self-Adaptive Suppression of Accumulated and Local Errors for SVD-based LLM Compression),创新性地将累积误差补偿与自适应权重优化融入SVD低秩分解,攻克了传统低秩压缩方法中“层间误差累积、精度持续下降”的核心痛点,无需微调或混合秩策略,即可实现大模型高效压缩与高精度保留,为端侧大模型的参数压缩部署提供全新解决方案。

低秩压缩(基于SVD)是大模型端侧部署的关键技术之一,具有硬件无关、兼容性强的优势,已被广泛应用于LLMs压缩。但现有SVD-based方法(如ASVD、SVD-LLM)均采用“逐层独立优化”策略,仅关注单一层级的重构误差最小化,忽视了压缩误差的层间传播与累积——上游层的微小重构误差,会随着网络深度增加不断放大,导致下游层输入分布偏移,最终使模型输出与浮点基线偏差显著,难以满足端侧部署的精度要求。

SAES-SVD通过两大核心模块协同工作,实现“局部误差抑制+全局误差补偿”,彻底解决误差累积问题:

核心模块一:累积误差感知层压缩(CEALC)。打破逐层独立优化的局限,将压缩目标定义为“局部重构误差+累积误差补偿”的加权组合,不仅最小化当前层的输出重构误差,还通过对齐当前层与浮点模型的输出,补偿上游层传播的累积误差;基于二阶激活统计量(输入协方差、差分协方差)推导闭解,无需存储海量原始激活数据,大幅降低内存开销,同时保证优化效率。

核心模块二:自适应协同误差抑制(ACES)。针对不同层对累积误差的敏感度差异,引入自适应加权系数,通过最大化低秩子空间的能量保留率(RER),动态调整累积误差补偿的强度——对高敏感度层增强补偿,对低敏感度层精简资源,确保在固定秩预算下,保留模型关键信息,提升压缩效率,避免过度补偿导致的资源浪费。

实验表明,SAES-SVD在各类LLMs上表现优异,优势显著:在LLaMA-3-8B模型上,压缩比为0.2时,相比传统SVD-LLM,输出与浮点模型的余弦相似度从0.79提升至0.95以上,有效抑制误差累积;在LLaMA-7B模型上,0.2压缩比下,零样本精度下降仅0.02,远低于现有方法。无需任何微调或混合秩策略,即可实现“高压缩比、高精度、低开销”,为端侧大模型低秩压缩提供全新范式。

文章链接:https://arxiv.org/abs/2602.03051

03【ICLR-2026】KBVQ-MoE:面向MoE大模型的KLT引导SVD与偏置校正矢量量化方法

后摩智能芯片算法团队提出面向混合专家(MoE)大语言模型的矢量量化框架KBVQ-MoE(KLT-guided SVD with Bias-Corrected Vector Quantization for MoE LLMs),创新性地融合KLT变换、SVD低秩分解与偏置校正技术,专门解决MoE架构量化中“专家间冗余浪费码本、量化误差累积导致分布偏移”的核心痛点,实现MoE大模型超低比特量化下的高精度保留与高效部署,填补了现有MoE量化方法缺乏输入驱动协同优化机制的空白,相关成果可直接适配端侧资源受限设备的MoE大模型部署需求。

MoE大模型凭借“专家分工、稀疏激活”的特性,在参数规模与推理效率间实现平衡,成为端侧部署的重要选择,但现有MoE量化方法存在明显局限:多数方法未整合输入激活的统计特征,既无法充分利用专家间共享的输入相关共性模式,也未能针对性校正专家量化误差导致的分布偏移,在高压缩比场景下难以平衡模型精度与部署效率,无法适配端侧设备的存储与计算约束。

KBVQ-MoE以“输入驱动去冗余、偏置校正稳输出”为核心,构建两大关键模块协同工作的完整框架,形成“预处理-量化-后处理”的全流程优化方案,同时兼顾算法创新性与端侧硬件适配性:

核心模块一:输入驱动冗余消除(IDRE)。基于输入激活的统计特征,通过KLT变换构建输入相干空间,将所有专家的权重矩阵投影至该空间,实现权重结构与输入特征的精准对齐;随后通过SVD分解提取专家间的共享主导分量并保留全精度,仅对专家专属的非冗余分量进行量化,大幅降低冗余信息对码本的占用,提升量化效率。该模块通过三步实现冗余消除:一是对输入激活进行KLT分解,构建基于输入能量排序的正交相干基;二是将专家权重投影至该相干空间,建立权重与输入特征的直接关联;三是通过SVD分解分离共享分量与专家专属分量,共享分量全精度保留,专属分量用于后续量化。

核心模块二:偏置校正输出稳定(BCOS)。针对专家专属分量量化后产生的累积偏置,设计通道级仿射补偿机制,通过对齐量化输出与全精度输出的均值和方差,抑制量化误差导致的分布偏移,确保模型输出稳定性。具体而言,先对专家专属分量进行矢量量化,再引入通道级缩放因子与偏置项,基于最小均方误差(MMSE)准则优化参数,仅增加少量额外参数(每一层2倍输出通道数),即可实现低开销的偏置校正,避免误差在专家聚合过程中被放大。

实验表明,KBVQ-MoE在主流MoE大模型上表现远超现有SOTA方法,适配端侧超低比特部署场景:在Qwen3-30B-A3B、Mixtral-8x7B等模型上,2-3bit量化时,零样本平均精度接近FP16全精度,其中Mixtral-8x7B在3bit量化下,WikiText2数据集上的困惑度(PPL)低至4.07,与全精度模型仅相差0.19;相比GPTQ、MoEQuant等现有方法,KBVQ-MoE在2bit量化时,Qwen3-30B-A3B的平均精度提升10个百分点以上,困惑度降低近6个点。同时,该框架可作为通用插件,与现有矢量量化方法(如GPTVQ、VPTQ)集成,进一步提升其性能,在Qwen1.5-MoE-A2.7B模型上,与GPTVQ集成后3bit量化的困惑度提升近30%。

在端侧部署适配性上,KBVQ-MoE无需修改MoE模型的专家结构与路由机制,量化后模型推理速度较全精度模型提升1.5-1.6倍,仅增加可忽略的计算与存储开销,完美适配后摩智能端侧AI芯片架构,可广泛应用于车载、嵌入式、边缘设备等资源受限场景,为MoE大模型的端侧规模化部署提供核心技术支撑。

文章链接:https://github.com/xuzukang/kbvq_moe/blob/main/VQMoe_iclr2026__camera_ready_.pdf

04【ICLR-2026】PCDVQ:基于极性聚类的矢量量化

后摩智能芯片算法团队提出极性聚类矢量量化框架PCDVQ(Polar Clustering Vector Quantization),创新性地将极性聚类与矢量量化深度结合,攻克了大语言模型(LLMs)超低比特量化中码本利用率低、精度损失显著的核心痛点,为LLMs在边缘设备、嵌入式终端的极致压缩部署提供了高效解决方案。

随着LLMs参数规模持续扩大,超低比特(2-bit及以下)量化成为实现端侧部署的关键手段,但传统矢量量化方法存在两大核心瓶颈:一是码本学习过程中易出现“码本崩溃”,部分码本长期闲置,导致量化精度下降;二是忽视权重极性特征,将正负权重混合量化,加剧误差累积,难以在超低比特场景下保留模型性能。现有方法虽尝试通过复杂码本初始化缓解问题,但仍无法兼顾量化效率与精度,难以适配端侧设备的资源约束。

PCDVQ以极性聚类为核心创新点,构建“极性分离-聚类优化-协同量化”的三级框架,通过三大核心设计实现突破:

核心设计一:极性分离编码(Polar Separation Encoding)。首次将权重矢量按极性划分为正、负两个独立子集,分别进行量化处理,避免正负权重混合量化带来的误差干扰,同时保留权重的极性特征,减少对模型损失函数的影响,为高精度量化奠定基础。

核心设计二:动态极性聚类(Dynamic Polar Clustering)。基于K-means聚类算法优化码本生成,针对正负权重子集分别学习专属码本,通过动态调整聚类中心,提升码本利用率,缓解“码本崩溃”问题;同时结合率失真理论,在有限比特预算下实现量化误差最小化。

核心设计三:跨极性协同优化(Cross-Polar Cooperative Optimization)。引入协同正则化项,联合优化正负权重的量化参数,确保量化后模型的权重分布与浮点模型保持一致,减少极性分离带来的性能波动,进一步提升量化精度。

实验表明,PCDVQ在主流LLMs上表现卓越,全面超越当前SOTA方法:在LLaMA-3-70B模型上,2.25-bit量化时,零样本平均精度达71.98%,接近FP16浮点精度;在LLaMA-3-8B模型上,2.25-bit量化的零样本平均精度较VPTQ提升1.23%;在Mistral-7B模型上,2-bit量化时的QA平均精度达64.33%,显著优于GPTQ、AQLM等现有方法,真正实现“超低比特、高精度、高效率”的量化目标,为端侧大模型部署提供核心技术支撑。

文章链接:https://arxiv.org/abs/2506.05432

-

人工智能

+关注

关注

1820文章

50314浏览量

266868 -

后摩智能

+关注

关注

0文章

56浏览量

1751 -

大模型

+关注

关注

2文章

3765浏览量

5269

原文标题:后摩前沿丨后摩智能4篇论文入选人工智能顶会ICLR 2026,持续突破大模型端侧部署核心技术瓶颈

文章出处:【微信号:后摩智能,微信公众号:后摩智能】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

华工科技子公司入选2026年湖北省人工智能典型应用场景

烽火通信AI大模型项目入选2026年湖北省人工智能典型应用场景

奕行智能论文入选国际计算机体系结构顶级会议 ISCA 2026

西井科技携手同济大学 三篇AI研究成果入选顶会ICLR 2026

后摩智能斩获多项人工智能行业大奖

维智科技入选2025中国科创好公司人工智能榜单

MediaTek多篇论文入选全球前沿国际学术会议

理想汽车12篇论文入选全球五大AI顶会

后摩智能4篇论文入选人工智能顶会ICLR 2026

后摩智能4篇论文入选人工智能顶会ICLR 2026

评论