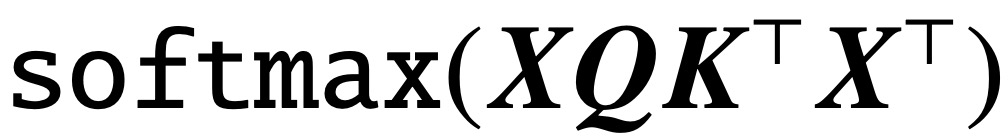

为什么 transformer 性能这么好?它给众多大语言模型带来的上下文学习 (In-Context Learning) 能力是从何而来?在人工智能领域里,transformer 已成为深度学习

2023-09-25 12:05:37 736

736

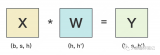

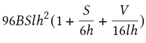

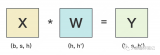

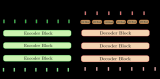

在之前的内容中,我们已经介绍过流水线并行、数据并行(DP,DDP和ZeRO)。 今天我们将要介绍最重要,也是目前基于Transformer做大模型预训练最基本的并行范式:来自NVIDIA的张量模型

2023-05-31 14:38:23 1605

1605

基于transformer模型的,模型结构主要有两大类:encoder-decoder(代表模型是T5)和decoder-only,具体的,decoder-only结

2023-07-10 09:13:57 5737

5737

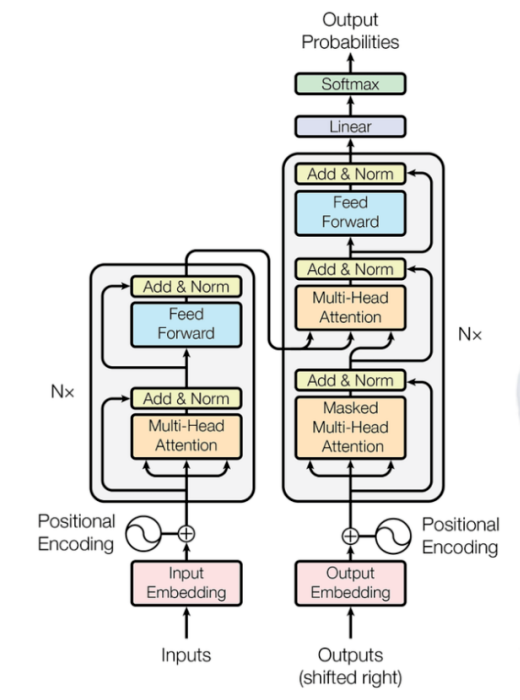

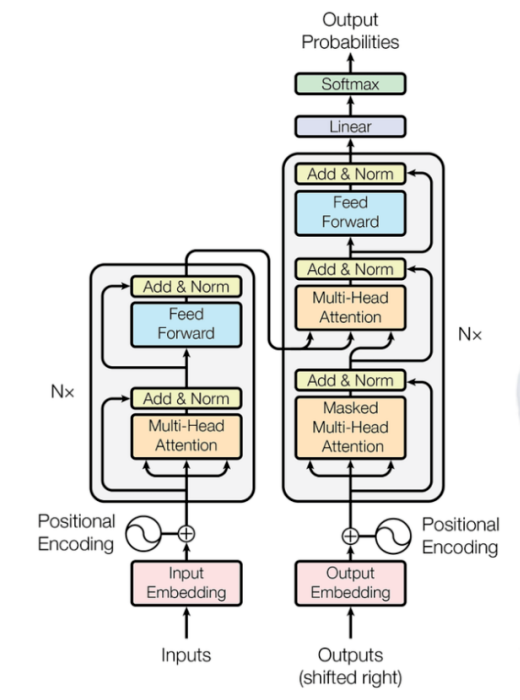

Transformer 本质上是一个 Encoder-Decoder 架构。因此中间部分的 Transformer 可以分为两个部分:编码组件和解码组件。

2023-11-17 10:34:52 216

216

Transformer模型在强化学习领域的应用主要是应用于策略学习和值函数近似。强化学习是指让机器在与环境互动的过程中,通过试错来学习最优的行为策略。

2024-02-20 09:55:35 352

352

for Language Understanding》,BERT模型横空出世,并横扫NLP领域11项任务的最佳成绩。而在BERT中发挥重要作用的结构就是Transformer,之后又相继出现XLNET、roBERT等模型击

2023-12-25 08:36:00 1282

1282

从电源、单片机、晶体管、驱动电路、显示电路、有线通讯、无线通信、传感器、原理图设计、PCB设计、软件设计、上位机等,给新手综合学习的平台,给老司机交流的平台。所有文章来源于项目实战,属于原创。一、拓扑结构1、降压拓扑如上图,要想掌握降压电路,必须深刻理解拓扑结构,几乎所有降压...

2021-11-17 06:32:03

ABBYY PDF Transformer+有三种不同类型的 PDF 文档。仅包含页面图像的文档不可搜索,其包含的文本也不可编辑。包含文本层的文档可以搜索,包含在这些文档中的文本也可进行复制。本文

2017-11-13 18:11:34

。HarmonyOS源码文件之多,想要短时间内研读完成是比较困难的。对于我们刚刚学习此操作系统的开发来说,如果一个个目录去研读代码,需要花费大量的时间。本文从框架上简单解析HarmonyOS的目录结构

2021-02-03 14:59:27

我们刚刚学习此操作系统的开发来说,如果一个个目录去研读代码,需要花费大量的时间。本文从框架上简单解析HarmonyOS的目录结构,让开发者有针对性的研究它。 下图将HarmonyOS源码的一级目录通过软件层

2021-03-12 10:18:36

类似于C语言中的结构体,结构体中又包含数组,如何快速解析出来呢

2013-09-11 15:15:38

体系结构标准定义了网络互联的七层框架(物理层、数据链路层、网络层、传输层、会话层、表示层和应用层),即OSI开放系统互连参考模型。这里根据笔者的理解以及相关资料的查询,觉得这个OSI通信与笔者...

2021-07-30 06:08:26

PROFIBUS协议模型与ISO/OSI协议模型的关系 PROFIBUS协议结构

2009-11-17 10:33:24

深入探讨关于RF放大器模型结构,看完秒懂!

2021-02-22 06:14:52

模型(逐字节),我也得到了信息传递字符串。这意味着我可以总是使用模型(逐字节)代替文件I/O类型的读/写传输模型?或者最后一个模型比字节模型有更多的应用程序?此外,缓冲队列传输模型是最复杂的理解模型。有人能帮助我理解这个模型的实际应用吗?非常感谢你。

2020-04-23 13:56:48

1、YOLOv5 网络结构解析 YOLOv5针对不同大小(n, s, m, l, x)的网络整体架构都是一样的,只不过会在每个子模块中采用不同的深度和宽度, 分别应对yaml文件中

2022-10-31 16:30:17

一、Yarn基本结构Hadoop三大核心组件:分布式文件系统HDFS、分布式计算框架MapReduce,分布式集群资源调度框架Yarn。Yarn并不是在Hadoop初期就有的,是在Hadoop升级

2021-01-05 16:58:44

在画路时,需要用到电流互感器,需要选择哪个模型呢?一下这些transformer 分别是什么意思?那些在我们设计电路时候比较常用?一些变压器的表述中“Transformer (Coupled Inductor Model)”的耦合电感模型是什么意思?

2014-12-01 16:32:10

通过超越语言应用(如音乐、语音、图像和视频生成)对该领域产生重大影响。在这篇文章中,我们将努力深入Reformer模型并试着去理解一些可视化方面的指南。准备好了吗?为什么是Transformer?在

2022-11-02 15:19:41

AR模型原理

2019-02-13 07:05:37

树模型的一些理解

2020-05-22 09:40:45

在模型预测控制中,把状态空间模型转换成MPC状态空间模型,结果得到一个矩阵,如何去理解这个矩阵代表的意义?

2019-03-20 16:09:03

何为变量?变量一般可以细分为如下图:本节重点为了让大家理解内存模型的“栈”,暂时不考虑“静态变量” 的情况,并约定如下:“全局变量”仅仅默认为“普通全局变量”;“局部变量”仅仅默认为“普...

2021-12-22 07:30:05

怎样去搭建一种电力电子仿真模型?如何对双母线结构模型进行仿真?

2021-09-24 10:28:46

为了实现最佳识别效果,页面应有标准方向,即,水平线条和字母应向上。所以有时不得不对文档页面进行旋转,以优化ABBYY PDF Transformer+转换结果。下面小编给大家讲讲如何更改ABBYY

2017-10-16 10:19:26

在安装ABBYY PDF Transformer+时会让您选择界面语言。此语言将用于所有消息、对话框、按钮和菜单项。在特殊情况下,您可能需要在安装完成后更改界面语言以适应需求,方法其实很简单,本文

2017-10-11 16:13:38

【追踪嫌犯的利器】定位技术原理解析(4)

2020-05-04 12:20:20

`手机通信原理解析:第 1 章 无线通信原理第2 章 移动通信系统第3 章 移动通信系统的多址接入技术第4 章 移动通信系统的语音编码第5 章 GSM移动通信系统的数字

2011-12-14 14:31:20

做题之前要先理解一下按键的内部结构。矩阵键盘中有两个I/O端口,一个作为输入,一个作为输出。当按键按下时,两个端口相连导通(我是这样认为的),当作为输入的I/O端口输入高电平时,输出就是高电平,反之就是低电平。矩阵键盘扫描原理...

2022-01-12 06:25:28

,稍有不同就无法复现论文的结果。而网络结构作为一种特殊的超参数,在深度学习整个环节中扮演着举足轻重的角色。在图像分类任务上大放异彩的ResNet、在机器翻译任务上称霸的Transformer等网络结构

2019-09-11 11:52:14

【理解】线结构光成像模型

2020-06-09 16:48:46

可使用ABBYY PDF Transformer+从Microsoft Word、Microsoft Excel、Microsoft PowerPoint、HTML、RTF、Microsoft

2017-10-17 14:13:42

很多人喜欢在书本文章关键位置加上自己的想法、理解等文字注释,普通的PDF软件不能满足你这样的要求,而ABBYY PDF Transformer+可让您在PDF页面的任何地方添加注释,使之更有

2017-09-22 16:42:48

【锂知道】锂电池基本原理解析:充电及放电机制电池充电最重要的就是这三步:第一步:判断电压

2021-09-15 06:47:08

单片机的结构原理解析

一、单片机的外部结构拿到一块芯片,想要使用它,首先必须要知道怎样连线,我们用的一块称之为 89C51 的芯片,下面我们就看一

2010-04-09 14:53:11 41

41 LCD结构解析大纲•TFTLCD原理与结构篇–动作原理–实体解剖•TFT&CF功能与制程篇–ThinFilmTransistor–ColorFilter•LCD背光模块篇–结构–技术R

2010-06-01 09:12:23 119

119 三极管开关电路工作原理解析

图一所示是NPN三极管的 共射极电路,图二所示是它的特性

2009-11-24 10:50:36 270157

270157 MPOA的模型结构,MPOA的模型结构是什么?

(1)基本组成

MPOA采用了LANE、NHRP、交换路由器(Switched Router)三种互补的

2010-04-07 13:27:02 476

476 高速缓冲存储器部件结构及原理解析

高速缓存 CACHE用途 设置在 CPU 和 主存储器之间,完成高速与 CPU交换信息,尽量避免 CPU不必要地多次直

2010-04-15 11:18:50 4410

4410 组合逻辑控制器组成结构及工作原理解析

按照控制信号产生的方式不同,控制器分为微程序控制器和组合逻辑控制器两类

微程序控制器是

2010-04-15 11:20:51 12372

12372 虚拟存储器部件原理解析

2010-04-15 14:25:20 2909

2909 CPU内核结构解析 CPU内核主要分为两部分:运算器和控制器。

(一) 运算器

1、 算

2010-04-15 16:13:27 1495

1495 触摸屏的应用与工作原理解析

2017-02-08 02:13:17 38

38 Android系统文件夹结构解析

2017-03-19 11:23:20 0

0 爪极发电机因其特殊的转子结构导致磁场空间分布复杂,通常需要建立三维有限元模型对其进行计算分析。而三维有限元方法计算费时,且不便于分析发电机结构及电磁参数对磁场和电磁力的影响,因此提出一种气隙磁场

2018-02-10 10:02:16 2

2 我们已经了解了模型的主要部分,接下来我们看一下各种向量或张量(译注:张量概念是矢量概念的推广,可以简单理解矢量是一阶张量、矩阵是二阶张量。)是怎样在模型的不同部分中,将输入转化为输出的。

2019-01-10 15:15:10 5775

5775

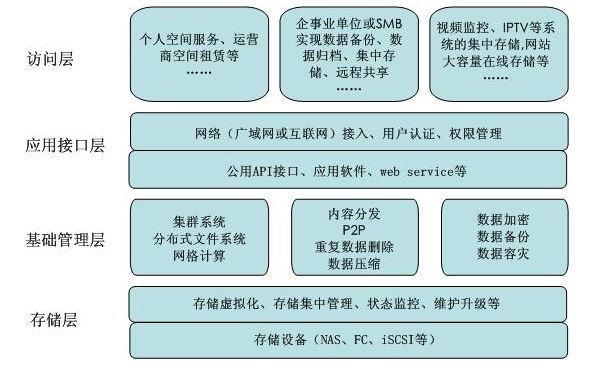

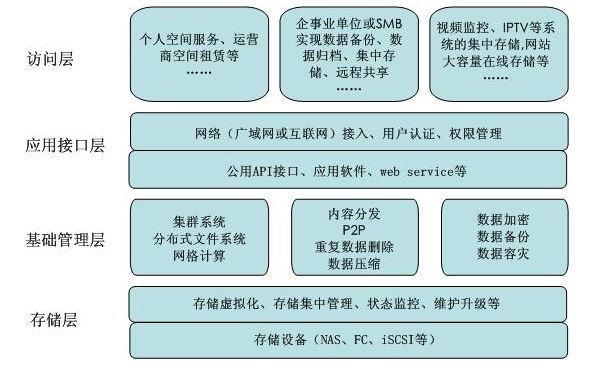

在存储的快速发展过程中,不同的厂商对云存储提供了不同的结构模型,在这里,我们介绍一个比较有代表性的云存储结构模型。

2020-12-25 11:23:26 3540

3540

刚刚,Google Brain 高级研究科学家 Barret Zoph 发帖表示,他们设计了一个名叫「Switch Transformer」的简化稀疏架构,可以将语言模型的参数量扩展至 1.6 万亿

2021-01-13 16:50:49 2638

2638 基于Transformer结构的各类语言模型(Bert基于其encoder,Gpt-2基于其decoder)早已经在各类NLP任务上大放异彩,面对让人眼花缭乱的transformer堆叠方式,你是否

2021-03-08 10:27:06 3036

3036

现有时序异常检测方法存在计算效率低和可解释性差的问题。考虑到 Transformer模型在自然语言处理任务中表现岀并行效率髙且能够跨距离提取关系的优势,提岀基于 Transformer的掩膜时序

2021-03-10 16:08:38 1

1 问句理解是模型将自然语言冋句转换成SαL的重要基础。目前多数利用深度学习的模型仅是通过数据库结构,未结合数据库内容充分理解问句生成SQL查询。在 SQLOVA模型的基础上,提出一种基于表结构和内容

2021-03-22 11:09:29 14

14 随着Transformer在视觉中的崛起,Transformer在多模态中应用也是合情合理的事情,甚至以后可能会有更多的类似的paper。

2021-03-25 09:29:59 9836

9836

全面。解析操作系统的概念、结构和机制。

2021-03-26 14:19:44 8

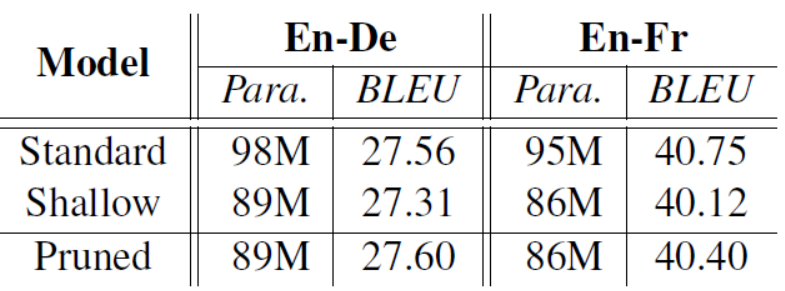

8 引言 Transformer是近年来非常流行的处理序列到序列问题的架构,其self-attention机制允许了长距离的词直接联系,可以使模型更容易学习序列的长距离依赖。由于其优良的可并行性以及可观

2021-04-01 16:07:28 11918

11918

近些年,Transformer[1]逐渐成为了自然语言处理中的主流结构。为了进一步提升Transformer的性能,一些工作通过引入额外的结构或知识来提升Transformer在特定任务上的表现。

2021-04-09 09:50:57 5973

5973

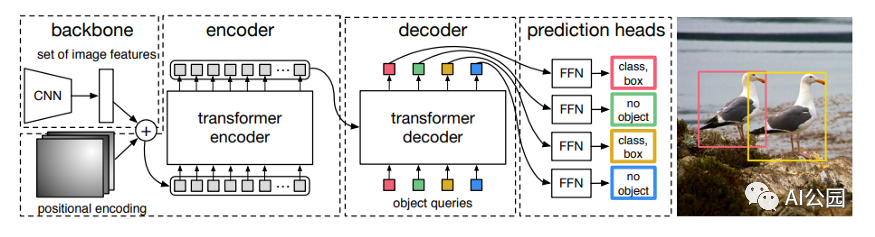

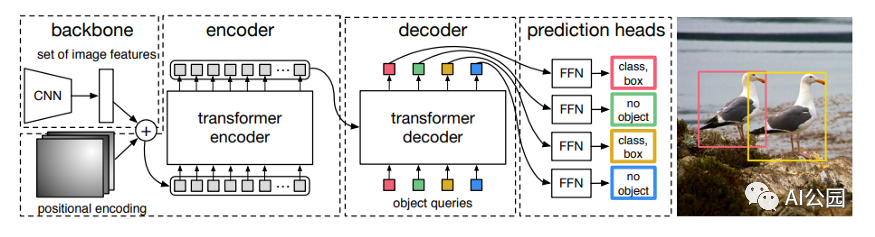

)是Facebook研究团队巧妙地利用了Transformer 架构开发的一个目标检测模型。在这篇文章中,我将通过分析DETR架构的内部工作方式来帮助提供一些关于它的含义。下面,我将解释一些结构,但是

2021-04-25 10:45:49 2296

2296

用了Transformer 架构开发的一个目标检测模型。在这篇文章中,我将通过分析DETR架构的内部工作方式来帮助提供一些关于它的直觉。 下面,我将解释一些结构,但是如果你只是想了解如何使用模型,可以直接跳到代码部分

2021-06-10 16:04:39 1913

1913

【导读】GMP 模型是让 go 语言轻量快速高效的重要调度模型,本文从 GMP 源码出发直观地解析了这一模型。 这篇文章就来看看 golang 的调度模型-GPM 模型的源码结构。 Go 版本

2021-07-06 11:55:04 1876

1876 Inductor and Flyback Transformer Design .pdf(继电保护必须加电源开关吗)-Inductor and Flyback Transformer Design .pdf

2021-07-26 14:50:20 12

12 中的25个Transformers模型 总结 ACL 2021中的25个Transformers模型 NLP中的层次结构Hi-Transformer: Hierarchical Interactive Transformer for Efficient and Effective Long Docume

2021-09-01 09:27:43 5635

5635

NVIDIA Megatron 是一个基于 PyTorch 的框架,用于训练基于 Transformer 架构的巨型语言模型。本系列文章将详细介绍Megatron的设计和实践,探索这一框架如何助力

2021-10-11 16:46:05 2226

2226

NVIDIA Megatron 是一个基于 PyTorch 的框架,用于训练基于 Transformer 架构的巨型语言模型。本系列文章将详细介绍Megatron的设计和实践,探索这一框架如何助力

2021-10-20 09:25:43 2078

2078 Microsoft 的目标是,通过结合使用 Azure 与 NVIDIA GPU 和 Triton 推理软件,率先将一系列强大的 AI Transformer 模型投入生产用途。

2022-03-28 09:43:38 1029

1029 Microsoft 的目标是,通过结合使用 Azure 与 NVIDIA GPU 和 Triton 推理软件,率先将一系列强大的 AI Transformer 模型投入生产用途。

2022-04-02 13:04:21 1456

1456 所以我们为此文章写了篇注解文档,并给出了一行行实现的Transformer的代码。本文档删除了原文的一些章节并进行了重新排序,并在整个文章中加入了相应的注解。此外,本文档以Jupyter

2022-06-20 14:26:50 3155

3155 Compensation Designer 2P2Z控制器S域模型理解

2022-10-28 12:00:24 7

7 史密斯圆图和阻抗匹配原理解析

2022-11-02 20:16:23 1626

1626 什么是晶振 晶振工作原理解析

2022-12-30 17:13:57 3727

3727

Transformer 作为特征抽取器,基于语言模型进行训练的预训练语言模型。所以,理解GPT主要熟悉两个方面即可,即 语言模型 和其由 Transformer 组成的结构。将无监督学习有监督模型的预训练目标

2023-02-14 09:33:23 2

2 Transformer的主要优点是它可以并行地处理输入序列中的所有位置,因此在训练和推理时都有着很好的效率。此外,Transformer没有使用循环结构,因此它不会受长序列的影响,并且在处理长序列时不会出现梯度消失或爆炸的问题。

2023-03-08 15:36:00 494

494 Thinking Like Transformers 这篇论文中提出了 transformer 类的计算框架,这个框架直接计算和模仿 Transformer 计算。使用 RASP 编程语言,使每个程序编译成一个特殊的 Transformer。

2023-03-08 09:39:00 488

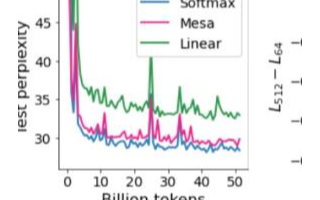

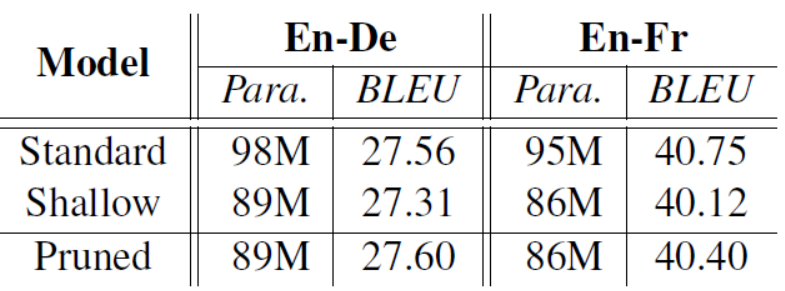

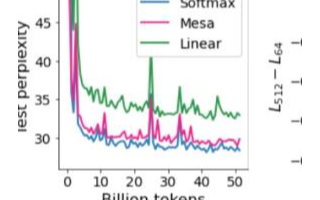

488 结构化剪枝是一种重要的模型压缩算法,它通过移除神经网络中冗余的结构来减少参数量,从而降低模型推理的时间、空间代价。在过去几年中,结构化剪枝技术已经被广泛应用于各种神经网络的加速,覆盖了ResNet、VGG、Transformer等流行架构。

2023-03-29 11:23:52 2933

2933 。 2)Transformer模型没有使用传统的CNN和RNN结构,其完全是由Attention机制组成,其中Self-Attention(自注意力)是Transformer的核心。 3)OpenAI的GPT模型和Google的BERT模型虽然都是基于Transformer所构建,但GPT模型仅使用了解

2023-03-29 16:57:06 1

1 无论是 “一触即通” 还是 “一通百通”,都意味着视觉模型已经 “理解” 了图像结构。SAM 精细标注能力与 SegGPT 的通用分割标注能力相结合,能把任意图像从像素阵列解析为视觉结构单元,像生物视觉那样理解任意场景,通用视觉 GPT 曙光乍现。

2023-04-09 09:40:52 1162

1162 Transformer是当前各种大模型所采用的主要结构,而ChatGPT的火爆让人们逐渐意识到人工智能有着更高的上限,并可以在计算机视觉领域发挥出巨大潜能。相比于在云端用GPU部署Transformer大模型,在边缘侧、端侧部署Transformer最大的挑战则来自功耗

2023-05-30 11:04:02 615

615

本文首先详细介绍Transformer的基本结构,然后再通过GPT、BERT、MT-DNN以及GPT-2等基于Transformer的知名应用工作的介绍并附上GitHub链接,看看Transformer是如何在各个著名的模型中大显神威的。

2023-06-08 09:56:22 1352

1352

与基于 RNN 的编码器-解码器模型类似,基于 transformer 的编码器-解码器模型由一个编码器和一个解码器组成,且其编码器和解码器均由 残差注意力模块 (residual attention blocks) 堆叠而成。

2023-06-11 14:17:34 1145

1145

本文旨在更好地理解基于 Transformer 的大型语言模型(LLM)的内部机制,以提高它们的可靠性和可解释性。 随着大型语言模型(LLM)在使用和部署方面的不断增加,打开黑箱并了解它们的内部

2023-06-25 15:08:49 991

991

预训练的2D图像或语言Transformer:作为基础Transformer模型,具有丰富的特征表示能力。作者选择了先进的2D Transformer模型作为基础模型,例如Vision Transformers (ViTs) 或者语言模型(如BERT)。

2023-07-03 10:59:43 387

387

,并能做出属于自己的 SAM 模型,那么接下这篇 Transformer-Based 的 Segmentation Survey 是不容错过!近期,南洋理工大学和上海人工智能实验室几位研究人员写了

2023-07-05 10:18:39 463

463

搭档完成复杂任务 预测台风路径降低灾害损失 帮助缩短药物研发周期 …… 此次发布有诸多新升级 更为客户提供了“开箱即用”的模型服务 简直就是一个AI大礼包! 一支视频为你深度解析盘古大模型硬实力! 你想了解的都在这儿 原文标题:最强科普!深度解析华为云盘古

2023-07-14 15:20:03 1334

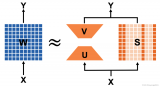

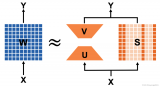

1334 动机&背景 Transformer 模型在各种自然语言任务中取得了显著的成果,但内存和计算资源的瓶颈阻碍了其实用化部署。低秩近似和结构化剪枝是缓解这一瓶颈的主流方法。然而,作者通过分析发现,结构

2023-07-17 10:50:43 1172

1172

理解Transformer背后的理论基础,比如自注意力机制(self-attention), 位置编码(positional embedding),目标查询(object query)等等,网上的资料比较杂乱,不够系统,难以通过自学做到深入理解并融会贯通。

2023-07-18 12:54:13 383

383

接着 大模型部署框架 FastLLM 简要解析 这篇文章首先梳理了一下FastLLM的调用链和关键的数据结构,然后解析了 FastLLM 的一些实现细节和CPU/GPU后端实现采用的优化技巧。

2023-07-27 10:48:27 734

734

掌握基于Transformer的目标检测算法的思路和创新点,一些Transformer论文涉及的新概念比较多,话术没有那么通俗易懂,读完论文仍然不理解算法的细节部分。

2023-08-16 10:51:26 363

363

Transformer在汽车领域应用自然是针对视觉的,ChatGPT3这种至少需要八张英伟达A100显卡的大模型是绝对无法出现在汽车上的。

2023-08-17 14:57:01 512

512

BEV人工智能transformer 人工智能Transformer技术是一种自然语言处理领域的重要技术,广泛应用于自然语言理解、机器翻译、文本分类等任务中。它通过深度学习算法从大规模语料库中自动

2023-08-22 15:59:28 549

549 理解Transformer背后的理论基础,比如自注意力机制(self-attention), 位置编码(positional embedding),目标查询(object query)等等,网上的资料比较杂乱,不够系统,难以通过自学做到深入理解并融会贯通。

2023-08-24 11:19:41 132

132

华为盘古大模型以Transformer模型架构为基础,利用深层学习技术进行训练。模型的每个数量达到2.6亿个,是目前世界上最大的汉语预备训练模型之一。这些模型包含许多小模型,其中最大的模型包含1亿4千万个参数。

2023-09-05 09:55:56 1229

1229 这些embedding可以使用谷歌Word2vec (单词的矢量表示) 找到。在我们的数值示例中,我们将假设每个单词的embedding向量填充有 (0和1) 之间的随机值。

2023-09-06 14:44:17 656

656

集成电路(IC),一种将数以千计的晶体管、电阻和电容等微小元件,集成在一小块半导体材料(通常是硅)上的微型结构,它的出现彻底改变了电子行业的发展。为了更深入理解集成电路,让我们从它的基本结构与分类入手进行解析。

2023-09-27 09:11:09 1568

1568

最后是在ADE20K val上的LeaderBoard,通过榜单也可以看出,在榜单的前几名中,Transformer结构依旧占据是当前的主力军。

2023-12-07 09:39:15 357

357

作为通用序列模型的骨干,Mamba 在语言、音频和基因组学等多种模态中都达到了 SOTA 性能。在语言建模方面,无论是预训练还是下游评估,他们的 Mamba-3B 模型都优于同等规模的 Transformer 模型,并能与两倍于其规模的 Transformer 模型相媲美。

2023-12-07 14:14:27 282

282

是其核心之一。最近爱芯元智带来的两款IPC SoC新品在黑光全彩处理、适配Transformer大模型等方面表现十分亮眼,爱芯元智副总裁史欣也向媒体分享了公司对IPC SoC高清化、智能化发展的洞察。 两款IPC SoC:AX630C和AX620Q 爱芯元智带来的两款新产品AX

2023-12-08 13:50:39 424

424

基于Transformer架构的大型模型在人工智能领域中发挥着日益重要的作用,特别是在自然语言处理(NLP)和计算机视觉(CV)领域。

2024-02-22 16:27:19 211

211

电子发烧友App

电子发烧友App

评论