电子发烧友网报道(文/李弯弯)显存,是显卡上用于存储图像数据、纹理、帧缓冲区等的内存。它的大小直接决定了显卡能够同时处理的数据量。

在AI计算中,显存的大小对处理大规模数据集、深度学习模型的训练和推理过程至关重要。足够的显存容量能够确保显卡在执行AI任务时能够同时存储和操作所需的数据,避免因为显存不足而导致的性能瓶颈。

在AI计算中如何选择合适的显存

显存对AI计算有影响,首先是它可以支持大规模模型,深度学习模型,尤其是那些涉及到大量参数和复杂计算的模型,需要较大的显存来存储模型参数、中间结果和计算图等。足够的显存能够支持更大规模的模型,从而提高模型的复杂度和性能。

其次,它可以加速计算过程,显存的高速访问能力能够显著加速数据的读写速度,从而提高计算效率。在AI计算中,大量数据的频繁读写是不可避免的,因此显存的速度对整体性能有着重要影响。

第三,如果显存容量不足,显卡可能无法同时存储整个模型或处理的数据集,导致需要频繁地在显存和主存之间进行数据交换。这种数据交换过程会显著降低任务的执行效率,并增加系统的功耗和延迟。

因此,在显存的选择上也需要注意。比如,在选择显卡时,需要根据实际AI计算任务的需求来选择合适的显存大小。对于需要处理大规模数据集或复杂深度学习模型的任务,应选择具有较大显存容量的显卡。

在AI计算过程中,可以通过优化算法、调整模型参数、减少不必要的数据存储等方式来优化显存的使用。这有助于在有限的显存资源下实现更高的计算效率和性能。

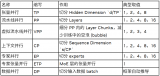

当然,一些先进的显卡技术,如NVIDIA的Tensor Core和AMD的Infinity Fabric等,能够提供更高的显存带宽和更低的延迟,从而进一步提高AI计算的性能。

AI推动显存技术不断升级

在AI加速卡中,显存是不可或缺的一部分。AI加速卡通过集成高性能的显存和计算单元,实现对AI计算任务的高效处理。显存作为数据存储和访问的桥梁,与计算单元紧密配合,共同提升AI应用的性能和效率。

随着AI技术的不断发展,对显存性能的要求在不断提高。这推动了显存技术的不断革新和升级,如GDDR6、HBM等新型显存技术的出现。这些新技术提供了更高的带宽、更大的容量和更低的功耗,为AI应用提供了更强大的支持。

同时,显存技术的提升也促进了AI应用的拓展和普及。例如,在医疗影像分析、自动驾驶、智能制造等领域,AI技术结合高性能的显存设备可以实现更精准、更高效的解决方案。

在显存技术的早期,SDRAM是主要的显存类型。它具有与CPU时钟同步的特性,能够提供比传统DRAM更高的数据传输速率。

随着技术的发展,DDR系列显存逐渐取代了SDRAM。DDR显存在每个时钟周期内能够传输两次数据,从而实现了数据传输速率的翻倍。DDR系列经历了从DDR、DDR2到DDR3的演进,每一代都在前一代的基础上提高了性能和效率。

接着,为了满足GPU对高带宽和高性能的需求,GDDR系列显存应运而生。GDDR系列专注于为图形处理提供更高的带宽和更低的延迟。作为最早的GDDR显存,它专为图形处理而设计,提供了比DDR更高的带宽。随着技术的发展,GDDR2和GDDR3相继推出,每一代都在前一代的基础上提高了性能和效率。

GDDR5是显存技术发展历程中的一个重要里程碑。它采用了更高的频率、更大的带宽和更低的功耗设计,极大地提升了GPU的性能。GDDR5在2012年左右成为主流显卡的标配显存。

近阶段,作为GDDR5的改进版,GDDR5X在保持与GDDR5兼容的同时,进一步提高了频率和带宽。它主要用于高端显卡和计算设备中。

2018年GDDR6出现,并首次用于NVIDIA RTX 20系列和AMD RX 5000系列显卡。GDDR6采用了更高的预取值(16bit)、更低的运行电压(1.35V)和更高效的封装模式(180-ball BGA),从而实现了更高的带宽和更低的功耗。GDDR6的起始速度为14 GT/s,远高于GDDR5和GDDR5X。

GDDR6X是GDDR6的进阶版本,由NVIDIA用于其更高端的RTX 30和40系列GPU。GDDR6X的起始速度高达19 GT/s,比GDDR6更快,为高端显卡提供了更高的带宽和性能。

写在最后

可以看到,显存与AI之间存在着相互促进的关系。显存的性能直接影响到AI算法的执行效率和模型的准确性,而AI技术的发展也推动了显存技术的不断革新和升级。未来,随着AI技术的不断发展,对显存的需求将会持续增加,同时也将推动显存技术的进一步发展。

-

AI

+关注

关注

91文章

41138浏览量

302608 -

显存

+关注

关注

0文章

112浏览量

14116

发布评论请先 登录

HBM迎头赶上!国产AI芯片飞跃

AWQ/GPTQ量化模型加载与显存优化实战

大模型服务为什么总是爆显存

显存读写冲突造成花屏解决方案

大显存突破!解锁120B MoE大模型,英特尔酷睿Ultra 285H拓展AI新应用

借助NVIDIA Megatron-Core大模型训练框架提高显存使用效率

如何看懂GPU架构?一分钟带你了解GPU参数指标

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI的未来:提升算力还是智力

【「AI芯片:科技探索与AGI愿景」阅读体验】+可期之变:从AI硬件到AI湿件

英特尔可变显存技术让32GB内存笔记本流畅运行Qwen 30B大模型

睿海光电800G光模块助力全球AI基建升级

AI 边缘计算网关:开启智能新时代的钥匙—龙兴物联

大模型推理显存和计算量估计方法研究

算力时代,你的GPU选对了吗?三张表看清专业卡与消费卡的本质差异

显存技术不断升级,AI计算中如何选择合适的显存

显存技术不断升级,AI计算中如何选择合适的显存

评论