电子发烧友网报道(文/黄晶晶)近日,阿里平头哥AI算力卡PPU在央视新闻被曝光,在“国产卡与NV卡重要参数对比”表格中显示,其PPU在显存、片间带宽等多项硬件参数均超越英伟达A800,介于英伟达A800和H20之间。

根据报道,平头哥PPU采用HBM2e显存,单卡显存容量96GB,片间带宽为700GB/s,采用PCIe5.0×16通道接口,单卡功耗为400W。英伟达A800显存同样采用HBM2e,单卡显存80GB,片间带宽400GB/s,接口规格是PCIe4.0×16,功耗400W;而H20的显存和片间带宽更强,单卡96GB HBM3显存,片间带宽为900GB/s,采用PCIe5.0×16接口,但功耗较高为550W。

另外还有,华为昇腾910B单卡采用64GB HBM2显存,片间带宽392GB/s,接口为PCIe4.0×16,功耗350W;壁仞104P单卡搭载32GB HBM2e显存,片间带宽256GB/s,采用PCIe5.0×16接口,功耗为300W。

我们可以看到,相当水平的AI算力卡,它们的存储规格基本在HBM2/2e、HBM3这一阶段。

根据报道,平头哥PPU采用HBM2e显存,单卡显存容量96GB,片间带宽为700GB/s,采用PCIe5.0×16通道接口,单卡功耗为400W。英伟达A800显存同样采用HBM2e,单卡显存80GB,片间带宽400GB/s,接口规格是PCIe4.0×16,功耗400W;而H20的显存和片间带宽更强,单卡96GB HBM3显存,片间带宽为900GB/s,采用PCIe5.0×16接口,但功耗较高为550W。

另外还有,华为昇腾910B单卡采用64GB HBM2显存,片间带宽392GB/s,接口为PCIe4.0×16,功耗350W;壁仞104P单卡搭载32GB HBM2e显存,片间带宽256GB/s,采用PCIe5.0×16接口,功耗为300W。

我们可以看到,相当水平的AI算力卡,它们的存储规格基本在HBM2/2e、HBM3这一阶段。

HBM对于AI芯片的重要性

高带宽内存HBM是一种基于3D堆栈技术的DRAM,通过TSV(硅通孔)和芯片堆叠架构实现高速数据传输与低能耗特性。该技术由三星、AMD和SK海力士共同提出,2013年SK海力士首次量产HBM芯片,2015年首次应用于AMD Fiji GPU。

随着 AI大模型向千亿、万亿级等大参数、以及FP8/FP4 高精度低比特计算方向演进,传统内存方案已无法满足数据传输效率需求。AI 计算需反复调用海量参数,如 GPT-3的1750亿参数需占用数百GB内存,且计算单元呈大规模并行架构,每秒需从内存读取/写入TB级数据。若数据供给不及时,会造成芯片实际性能大幅低于理论峰值。

HBM在AI服务器GPU中成为主流解决方案,是当前AI算力芯片突破性能瓶颈的核心关键技术,其3D堆叠技术有效提升内存带宽并减少延迟。

HBM六代产品演进

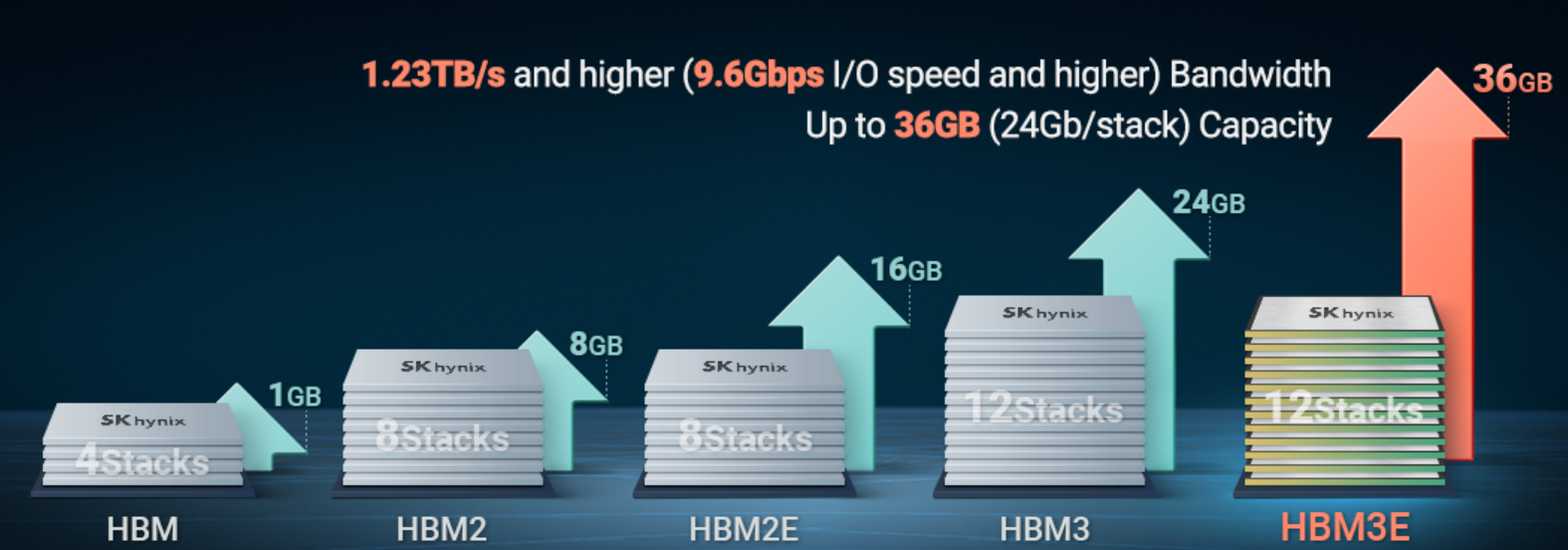

目前HBM总共有六代产品,分别为HBM1、HBM2、HBM2E、HBM3、HBM3E、HBM4。SK海力士于2013年首次开发HBM DRAM(第一代)产品,随后以HBM2(第二代)、HBM2E(第三代)、HBM3(第四代)的顺序开发。

2018年SK海力士发布第二代HBM产品HBM2,2020年发布第三代产品HBM2E是HBM2的扩展版本,HBM2E速度更快、容量更大、散热性能更高。

SK海力士于2021年10月推出全球首款HBM3,并在2022年6月实现量产。该款HBM3每个引脚传输速率达6.4Gbps,1024位宽接口,最高带宽可达819GB/s,较HBM2E(460GB/s)高约78%。16Gb内核密度、尖端的TSV垂直堆叠技术,满足了系统对更高密度的要求,该技术可实现12层堆叠内存立方体,从而实现最大24GB封装密度。

2024年,SK海力士全球率先开始量产 8/12层HBM3E,实现了现有HBM产品中最大的36GB容量。11月4日,海力士正式宣布开发全球最大容量16层堆叠HBM3E。

图源:SK海力士

SK海力士2025年9月宣布,已成功完成面向AI的超高性能存储器新产品HBM4的开发,并在全球首次构建了量产体系。这次全新构建量产体系的HBM4采用了较前一代产品翻倍的2048条数据传输通道(I/O),将带宽扩大一倍,同时能效也提升40%以上。凭借这一突破,该产品实现了全球最高水平的数据处理速度和能效。公司预测,将该产品引入客户系统后,AI服务性能最高可提升69%,这一创新不仅能从根本上解决数据瓶颈问题,还可显著降低数据中心电力成本。

与此同时,此次HBM4实现高达10Gbps(每秒10千兆比特)以上的运行速度,这大幅超越JEDEC标准规定的8Gbps(每秒8千兆比特)。公司在HBM4的开发过程中采用了产品稳定性方面获得市场认可的自主先进MR-MUF技术和第五代10纳米级(1b)DRAM工艺,最大程度地降低其量产过程中的风险。

华为自研HBM

根据华为近日在全联接大会2025上公布的信息,昇腾950PR芯片架构新增支持低精度数据格式,其中FP8/MXFP8/HIF8: 1 PFLOPS,MXFP4: 2 PFLOPS,重点提升向量算力,提升互联宽带2.5倍,支持华为自研HBM高带宽内存,分为HiBL 1.0和HiZQ 2.0两个版本。HiBL 1.0容量128GB,带宽1.6TB/s。HiZQ 2.0容量144GB,带宽4TB/s。

昇腾950PR芯片采用950核心+HiBL 1.0内存,可提升推理Prefill(预填充)性能,提升推荐业务性能。昇腾950DT采用HiZQ 2.0内存,可提升推理Decode(解码)性能,提升训练性能,提升内存容量和带宽。

根据规划,2026年第一季度将推出昇腾950PR,2026年第四季度计划推出昇腾950DT。2027年第四季度将推出昇腾960芯片,预计在各项规格上相比前代产品将有大幅提升。2028年第四季度规划推出昇腾970芯片,这将是该系列中的高端产品,预计在算力和互联带宽等方面实现全面升级。

远见智存HBM2/2e已完成终试

此前有报道,深圳远见智存成功实现HBM2e芯片量产,并计划于2025年春节前后初步完成下一代HBM3/HBM3e前端设计。

远见智存成立于2023年,拥有一支由行业精英组成的团队,团队成员在HBM技术方面具有深厚的积淀和丰富的经验。据介绍,通过技术创新,公司成功绕开TSV(Through-Silicon Via)及CoWoS(Chip-on-Wafer-on-Substrate)等关键技术瓶颈,使得HBM2e的国产化得以顺利实现。

同时,远见智存依规提供符合高堆叠JEDEC标准的HBM产品,并整合国内高端封装资源,推出自主可控的HBM3/3e产品,为AI训练芯片产业注入动力。

针对远见智存的HBM存储芯片的研发进度,目前公开信息显示,中天精装间接持有深圳远见智存股权,穿透计算的持股比例为6.71%。中天精装表示,公司参股企业深圳远见智存科技聚焦高带宽存储芯片(HBM)领域,目前HBM2/2e产品已完成终试,正在推动量产和升级;HBM3/3e处于研发阶段,已完成前期预研和部分设计工作。

另外,今年7月,赛博格机器人与芯玑半导体和量子芯云联合推出内置DNPU和LPDDR5的存算一体化芯片和全球首颗移动HBM。

随着AI大模型向更大参数、更多模态演进,HBM与AI 芯片将深度绑定,HBM的技术迭代将为AI算力推波助澜。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

HBM

+关注

关注

2文章

426浏览量

15697 -

AI芯片

+关注

关注

17文章

2062浏览量

36558

发布评论请先 登录

相关推荐

热点推荐

GPU猛兽袭来!HBM4、AI服务器彻底引爆!

电子发烧友网报道(文/黄晶晶)日前,多家服务器厂商表示因AI服务器需求高涨拉高业绩增长。随着AI服务器需求旺盛,以及英伟达GPU的更新换代,势必带动HBM供应商的积极产品推进。三星方面HBM

国产TDDI芯片:藏在屏幕背后的"隐形冠军",谁能笑到最后?

市场被海外巨头垄断,如今国产玩家正迎头赶上。这场"屏幕背后的战争",到底谁更有机会胜出? TDDI芯片:为什么手机厂商都爱它? 传统方案中,触控和显示需要两颗独立芯片,就像两个人各管一

国产AI芯片真能扛住“算力内卷”?海思昇腾的这波操作藏了多少细节?

最近行业都在说“算力是AI的命门”,但国产芯片真的能接住这波需求吗?

前阵子接触到海思昇腾910B,实测下来有点超出预期——7nm工艺下算力直接拉到256 TFLOPS,比上一代提升了40%,但功耗

发表于 10-27 13:12

紫光国芯存储芯片国产替代方案:打破DDR5/HBM芯片供应链瓶颈

贞光科技作为紫光国芯核心代理商,主推其DDR5/HBM国产替代方案。紫光国芯的高性能存储产品已广泛应用于信创及数据中心,贞光科技提供全线产品供应与技术服务,助力打破供应链垄断,保障关键基础设施的自主

SK海力士宣布量产HBM4芯片,引领AI存储新变革

在人工智能(AI)技术迅猛发展的当下,数据处理与存储能力成为制约其进一步飞跃的关键因素。2025 年 9 月 12 日,韩国半导体巨头 SK 海力士宣布,已成功完成面向 AI 的超高性能存储器新产品

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI芯片的需求和挑战

②Transformer引擎③NVLink Switch系统④机密计算⑤HBM

FPGA:

架构的主要特点:可重构逻辑和路由,可以快速实现各种不同形式的神经网络加速。

ASIC:

介绍了几种ASIC AI芯片

发表于 09-12 16:07

性能优于HBM,超高带宽内存 (X-HBM) 架构来了!

电子发烧友网综合报道,NEO Semiconductor宣布推出全球首款用于AI芯片的超高带宽内存 (X-HBM) 架构。该架构旨在满足生成式AI和高性能计算日益增长的需求,其32Kb

【书籍评测活动NO.64】AI芯片,从过去走向未来:《AI芯片:科技探索与AGI愿景》

名单公布

@LiuDW、@jinglixixi、@bruceleesohu

请于9月3日前,前往【书籍评测活动NO.64】《AI芯片:科技探索与AGI愿景》完成书籍兑换。

如有疑问请 添加小助手微信

发表于 07-28 13:54

HBM应用在手机上,可行吗?

电子发烧友网报道(文/梁浩斌)最近有不少关于HBM技术被应用到手机的消息,此前有消息称苹果会在20周年iPhone,也就是2027年推出使用HBM DRAM的iPhone手机,提高端侧AI能力

国产 vs 进口贴片固态电容:技术差距缩小,本土化替代加速

差异、市场表现及未来趋势,探讨国产替代的机遇与挑战。 1.性能对比:国产技术迎头赶上 (1)关键参数差距缩小 - ESR(等效串联电阻):早期国产固态电容的ESR较高,影响

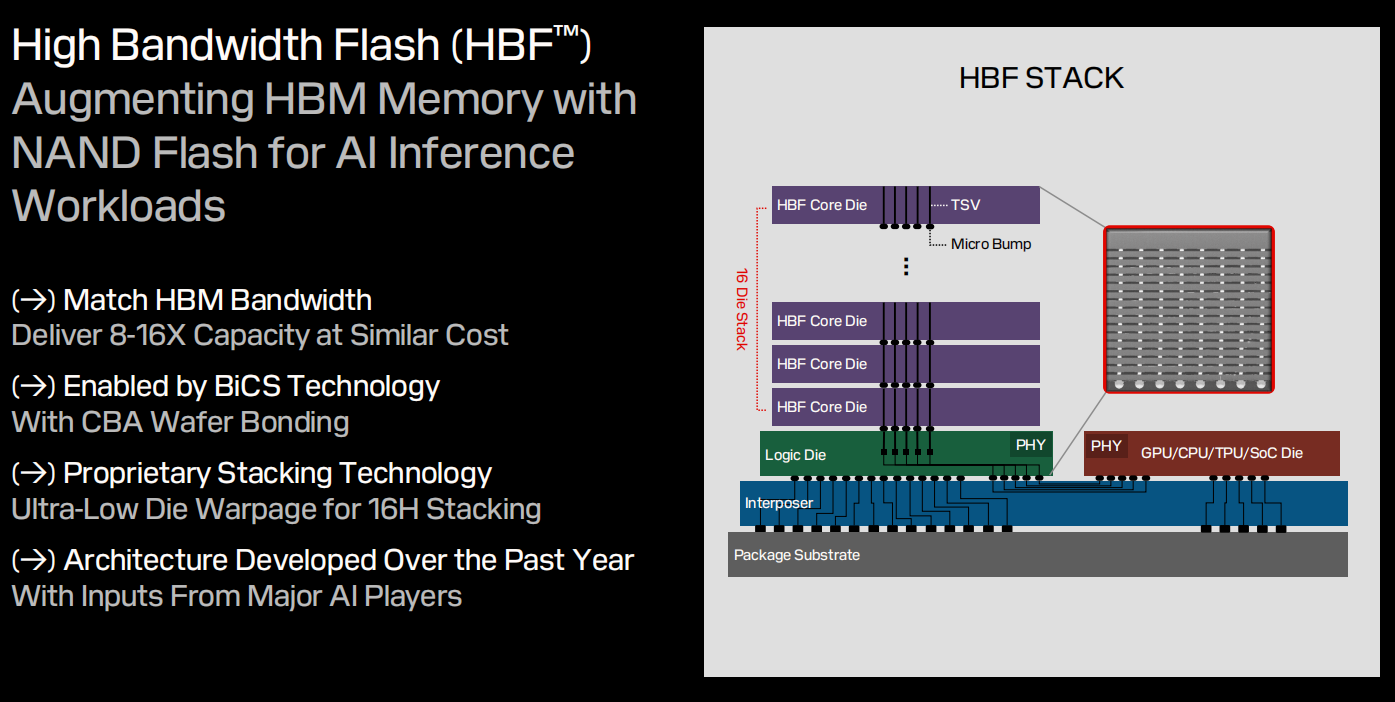

不再是HBM,AI推理流行,HBF存储的机会来了?

NAND闪存和高带宽存储器(HBM)的特性,能更好地满足AI推理的需求。 HBF的堆叠设计类似于HBM,通过硅通孔(TSVs)将多个高性能闪存核心芯片堆叠,连接到可并行访问闪存子

deepseek国产芯片加速 DeepSeek的国产AI芯片天团

,从而纷纷继续“卷”起来,效仿DeepSeek的“开源”模式。 对于DeepSeek本身,人们关注其如何在有限算力实现强大性能,更关注其在重重条令围城之下的未来之路。而在最近,全世界的芯片厂商集体出动,纷纷宣布支持DeepSeek。尤其是众多国产

SK海力士增产HBM DRAM,应对AI芯片市场旺盛需求

SK海力士今年计划大幅提升其高带宽内存(HBM)的DRAM产能,目标是将每月产能从去年的10万片增加至17万片,这一增幅达到了70%。此举被视为该公司对除最大客户英伟达外,其他领先人工智能(AI)芯片公司需求激增的积极回应。

AI兴起推动HBM需求激增,DRAM市场面临重塑

TechInsights的最新报告揭示了AI兴起对高带宽内存(HBM)需求的巨大影响。特别是在机器学习和深度学习等数据密集型应用中,HBM的需求呈现出前所未有的高涨态势。 报告预测,到2025年

HBM迎头赶上!国产AI芯片飞跃

HBM迎头赶上!国产AI芯片飞跃

评论