最近几个月,随着ChatGPT的现象级表现,大模型如雨后春笋般涌现。而模型推理是抽象的算法模型触达具体的实际业务的最后一公里。 但是在这个环节中,仍然还有很多已经是大家共识的痛点和诉求,比如: 任何

2023-05-18 14:35:17 2000

2000

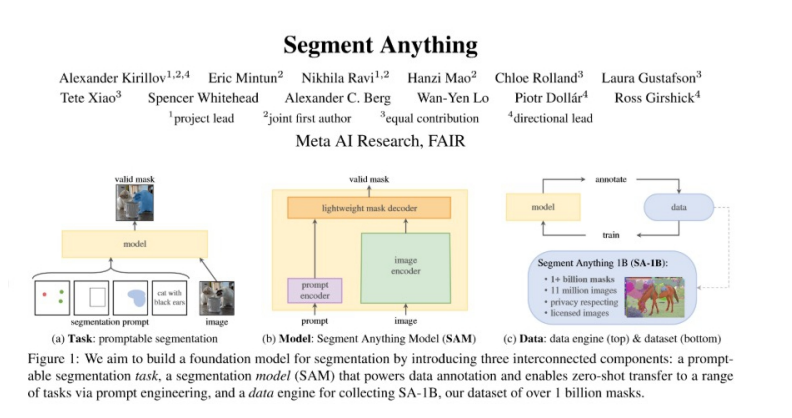

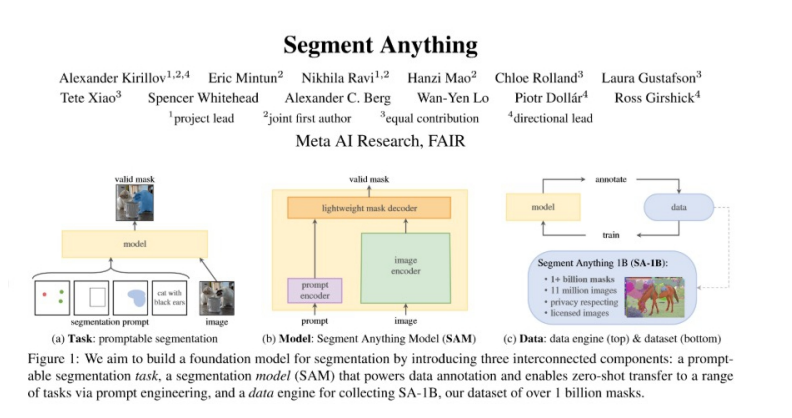

在一起,从而显著提升模型的泛化能力。SAM 的设计初衷是简化图像分割的过程,减少对专业建模知识的依赖,并降低大规模训练所需的计算资源。

2023-08-21 04:02:50 1293

1293

一、概述本文介绍了AscendCL模型推理相关知识,介绍了AscendCL接口加载离线模型,为离线模型准备数据结构以及调用离线模型进行推理的过程。简单来说,曻腾的AscendCL的推理工程可以问为

2023-08-24 11:04:14

DLLite-Micro 是一个轻量级的 AI 推理框架,可以为 OpenHarmony OS 的轻量设备和小型设备提供深度模型的推理能力DLLite-Micro 向开发者提供清晰、易上手的北向接口

2021-08-05 11:40:11

道。 本次实验快速圆满完成,得益于NetBox操作简单、无需编译的特性,能实现快速上手且精准验证的体验,助力科研高效发展。 NetBox 是一款基于FPGA的电力电子实时仿真产品。FPGA无需编译,直接

2022-12-14 10:24:50

场景介绍

MindSpore Lite 是一款 AI 引擎,它提供了面向不同硬件设备 AI 模型推理的功能,目前已经在图像分类、目标识别、人脸识别、文字识别等应用中广泛使用。

本文介绍

2023-12-14 11:41:13

首个独立AI推理基准测试 ——MLPerf Inference 0.5中取得第一名。由于推理一直是AI市场中最大、同时也是最具竞争力的领域,业内此前一直希望能够有一套客观的推理性能测试指标。在参与

2019-11-08 19:44:51

k210可以采集传感器的数据进行模型的推理吗?

2023-09-14 08:52:56

使用rknn的api读取我的模型,进行转换api可以成功转换出rknn模型,但遇到的问题是:我使用测试数据调用rknn.inference进行推理,每一次的输出结果都为[array([nan, nan

2023-01-11 18:45:48

为开发者提供一个简单且高效的开发平台。虽然LuckFox Pico作为入门级开发板只有几十块钱,但是它具有人工智能协处理器NPU,也可以实现人工智能的推理工作。瑞芯微 RV1103芯片采用了和RK3568

2023-11-11 16:51:53

设备的资源限制。此外,TinyML还依赖于优化的推理引擎和针对嵌入式设备的硬件加速器,以实现高效的模型推理。

TinyML的应用领域非常广泛,包括智能传感器、健康监测、物联网、智能音频处理、自动驾驶

2023-12-22 10:12:25

SAM3U处理器的内部结构 1.3.3 SAM3U系列MCU的优点 1.3.4 SAM3 MCU的开发工具第2章 CortexM3 处理器编程模型 2.1 寄存器组 2.1.1 通用寄存器

2014-03-13 11:00:26

/main/detail。ChatGLM3 的推理框架是基于最新的高效动态推理和显存优化技术构建的,在相同硬件、模型条件下,相较于目前最佳的开源实现,对比伯克利大学推出的 vLLM 以及 Hugging

2023-12-17 22:54:49

研的人工智能协处理器NPU,并且提供了RKNN-Toolkit。今天就介绍一下如何使用RKNN模型进行推理应用程序开发。一、推理应用程序的基本流程RKNN 是 瑞芯微(Rockchip) NPU平台

2022-12-08 19:06:16

主要内容本文提出了一种不依赖于棋盘格等辅助标定物体,实现像素级相机和激光雷达自动标定的方法。方法直接从点云中提取3D边特征,一避免遮挡问题,并且使用了精确度更高的深度连续边。文中首先指出:以下四种

2021-09-01 07:42:19

使用rk3588多npu推理模型,模型总推理时间还增加了,这怎么解释

2023-11-05 18:22:42

关于 TinyMaixTinyMaix是面向单片机的超轻量级的神经网络推理库,即TinyML推理库,可以让你在任意单片机上运行轻量级深度学习模型~设计原则:易用性 > 移植性 &

2022-09-21 09:56:29

你好我使用 STM32CUBE-AI v5.1.2 ApplicationTemplate 将简单的 CNN 导入到 STM32L462RCT我发现压缩模型对推理时间没有影响。aiRun 程序在 8

2023-01-29 06:24:08

出色的 ML 推理性能。例如,其能够以良好的功率表现执行 MobileNet v2 等最先进的移动视觉模型,且 fps 可达 100 以上。这意味着你将能够在符合节能与隐私保护要求的前提下,将快速 ML

2019-03-05 21:20:23

当我为 TFLite 模型运行基准测试时,有一个选项 --nnapi=true我如何知道 GPU 和 NPU 何时进行推理?谢谢

2023-03-20 06:10:30

使用 PyTorch 对具有非方形图像的 YOLOv4 模型进行了训练。

将 权重转换为 ONNX 文件,然后转换为中间表示 (IR)。

无法确定如何获得更好的推理性能。

2023-08-15 06:58:00

如何实现具有RTD级精度且无需校准快速温度传感器设计

2021-01-07 06:27:14

EPP技术和CPLD技术介绍应用CPLD及EPP技术对CCD信号像素级的高速采集

2021-04-08 06:11:10

PyTorch Hub 加载预训练的 YOLOv5s 模型,model并传递图像进行推理。'yolov5s'是最轻最快的 YOLOv5 型号。有关所有可用模型的详细信息,请参阅自述文件。详细示例此示例

2022-07-22 16:02:42

rk1808 相同模型速度变慢: rknn_server 0.9.4 (2078225 build: 2019-03-07 20:07:28) librknn_runtime version

2022-04-21 11:36:29

生成两个 IR文件(相同的 .xml 文件,但不同的 .bin 文件)

具有不同重量的类似模型,以不同的 fps (27fps 和 6fps) 运行

更多样化的权重是否会影响 Myriad X 上的推理性能?

2023-08-15 07:00:25

:管理资源引擎的相关内容。Engine:推理引擎,推理的主要功能都由它管理。PluginManager:管理框架调度器的配置与工具。插件:管理框架与推理模型的加载、卸载。AIInterpreter:手机

2022-03-25 11:15:36

摘要本文为系列博客tensorflow模型部署系列的一部分,用于实现通用模型的部署。本文主要实现用tflite接口调用tensorflow模型进行推理。相关源码见链接引言本文为系列博客

2021-12-22 06:51:18

研华公司近期新推出了一款经济高效的入门级系统平台。研华ARK-1310拥有紧凑型、无风扇的铝制机箱外壳,可安装在任何大型系统中,也可作为独立平台单独应用。ARK-1310小巧紧凑、坚固耐用,因此非常适合各种恶劣环境应用和自动化控制应用。

2019-07-23 06:21:45

请问模型推理只用到了kpu吗?可以cpu,kpu,fft异构计算吗?

2023-09-14 08:13:24

与采用旧 CPU 的推理相比,在新 CPU 上推断的 INT8 模型的推理速度更快。

2023-08-15 08:28:42

鉴于模型推理的入侵检测方法,需要在庞大的审计记录空间中搜索巨量的攻击脚本子集中的最优值,对于这一NP类完全问题,提出了应用模拟退火算法。并建立了攻击检测的优化问

2008-11-18 00:18:36 6

6 数据库推理问题是数据库安全研究的重要分支方向,推理通道的分析是解决推理问题的基础。传统推理规则无法处理不完全符合函数依赖的数据关系,针对这一问题,本文提出了弱

2009-12-25 14:58:04 16

16 首个32 GB microSDHC存储卡问世

SanDisk(闪迪)宣布,闪迪专为手机打造的的大容量、移动式存储卡 ——32 gigabyte (GB)1 闪迪 microSDHC存储卡——现已上市。全新

2010-03-25 17:20:33 1027

1027 我国自主研发的高效彩色太阳能电池在长问世

记者今日从市科技局获悉,继湖南制造的高效彩色双玻太阳能电池组件亮相上海世博会

2010-04-12 08:34:06 432

432 超像素词包模型与SVM分类的图像标注_於敏

2017-03-19 19:03:46 1

1 针对CLINK算法在路由改变时拥塞链路推理性能下降的问题,建立一种变结构离散动态贝叶斯网模型,通过引入马尔可夫性及时齐性假设简化该模型,并基于简化模型提出一种IP网络拥塞链路推理算法(VSDDB

2018-01-16 18:46:26 0

0 SAM Boot Assistant(SAM-BA)允许使用USB或UART主机进行在系统编程(ISP),而无需任何外部编程接口。

2018-07-20 10:48:11 5195

5195 日前,欧司朗光电半导体和Joyson Safety Systems 公司为新款凯迪拉克CT6配备了一款创新的半自动驾驶系统。这款系统名为“超级巡航”(Super Cruise),是业内首个真正的在高速上实现“无需双手”的驾驶技术。

2018-09-13 15:10:47 2811

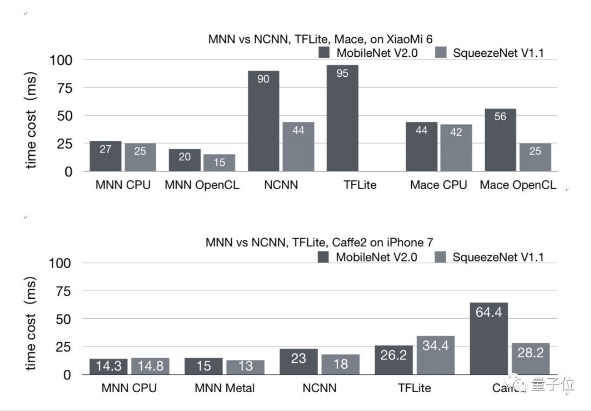

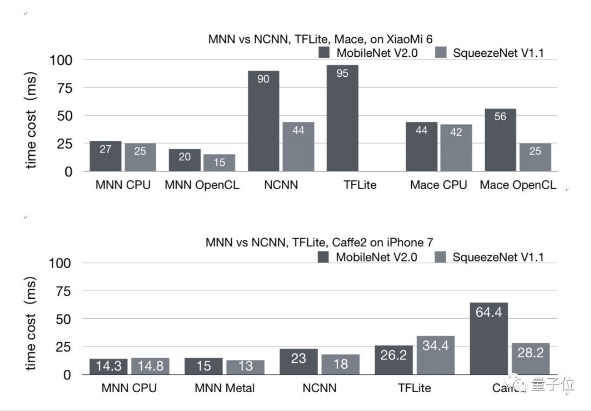

2811 阿里开源首个移动AI项目,淘宝同款推理引擎,这是阿里开源的首个移动AI项目,已经用于阿里手机淘宝、手机天猫、优酷等20多个应用之中。覆盖直播、短视频、搜索推荐、商品图像搜索、互动营销、权益发放、安全风控等场景。在IoT等移动设备场景下,也有若干应用。

2019-07-03 09:53:29 284

284

浪潮宣布开源发布基于FPGA的高效AI计算框架TF2,这一框架的推理引擎采用全球首创的DNN移位计算技术,结合多项最新优化技术,可实现通用深度学习模型基于FPGA芯片的高性能低延迟部署。

2019-09-09 14:17:53 932

932 浪潮宣布开源发布基于FPGA的高效AI计算框架TF2,这一框架的推理引擎采用全球首创的DNN移位计算技术,结合多项最新优化技术,可实现通用深度学习模型基于FPGA芯片的高性能低延迟部署,这也是全球首个包含从模型裁剪、压缩、量化到通用模型实现等优化算法的完整方案的FPGA上AI开源框架。

2019-09-23 15:04:56 1799

1799 Adlik是LF AI中首个聚焦深度学习模型推理阶段的项目,其宗旨是使深度学习模型能够高效地运行在多种部署环境下。

2019-10-11 09:15:53 1420

1420 来自中国航天科技集团有限公司八院消息,近日,中国首个3.35米直径火箭长筒段贮箱在八院800所问世。后续,该技术将应用于新一代运载火箭中。

2021-02-27 09:38:08 1546

1546 分类问题是数据挖掘和机器学习领域硏究的重点问题,贝叶斯网络模型因其简单髙效的特点而广泛应用于分类问题。一依赖估测器(ODE)模型作为半监督学习贝叶斯网络模型中的经典模型,受到研究人员的广泛关注。现有

2021-03-17 15:05:10 12

12 本应用笔记介绍将基于 SAM9x5 的设计移植到 SAM9X60 器件需进行的硬件和软件更改。SAM9X60 器件的性能优于SAM9x5。

2021-03-30 16:26:31 2

2 数据中心网络需要更加高效的推理模型提升流簇大小判断的准确性和敏感性。提岀了一种基于机器学习的流簇大小推理模型( Mlcoflow),利用极限学习杋(ELM)以最小训练误差为求解目标建立推理模型,并且使用不完全信息建模以提升敏感度。实验证

2021-04-02 11:38:16 34

34 基于像素级生成对抗网络的图像彩色化模型

2021-06-27 11:02:01 4

4 基于变量依赖关系模型的变量重要性度量综述

2021-07-02 14:44:08 0

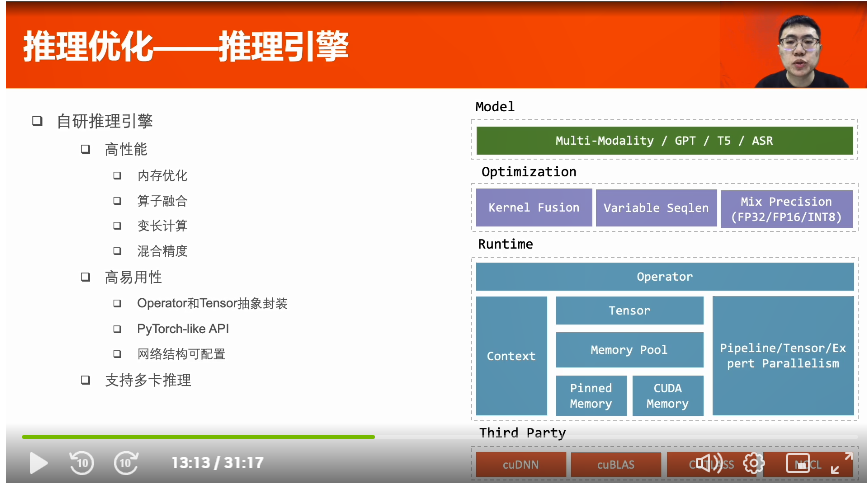

0 自然语言理解、匹配排序等等,这些模型的训练和推理都大量依赖于NVIDIA GPU,尤其在推理方面,NVIDIA GPU及相应的解决方案都满足了业务所需的延迟和吞吐要求。 微信搜索业务需要更高效平台 微信搜索业务由多个子模块构成,包括查

2021-10-28 15:28:12 1551

1551 MegEngine「训练推理一体化」的独特范式,通过静态图优化保证模型精度与训练时一致,无缝导入推理侧,再借助工业验证的高效卷积优化技术...

2022-02-07 10:59:49 0

0 的时延变长,GPU 使用效率不高。医疗影像推理的另一个需要考虑的问题是如何实现高效的部署。我们往往需要部署多个医疗影像 AI 应用,那么如何去调度多个模型,如何并发处理多个请求,并充分利用 GPU 资源成为挑战。

2022-04-09 08:18:22 1042

1042 一个完整的医疗影像推理流程一般包含数据的前处理、AI 推理以及数据后处理这几部分。

2022-04-10 15:06:09 2396

2396 “强悍的织女模型在京东探索研究院建设的全国首个基于 DGX SuperPOD 架构的超大规模计算集群 “天琴α” 上完成训练,该集群具有全球领先的大规模分布式并行训练技术,其近似线性加速比的数据、模型、流水线并行技术持续助力织女模型的高效训练。”

2022-04-13 15:13:11 783

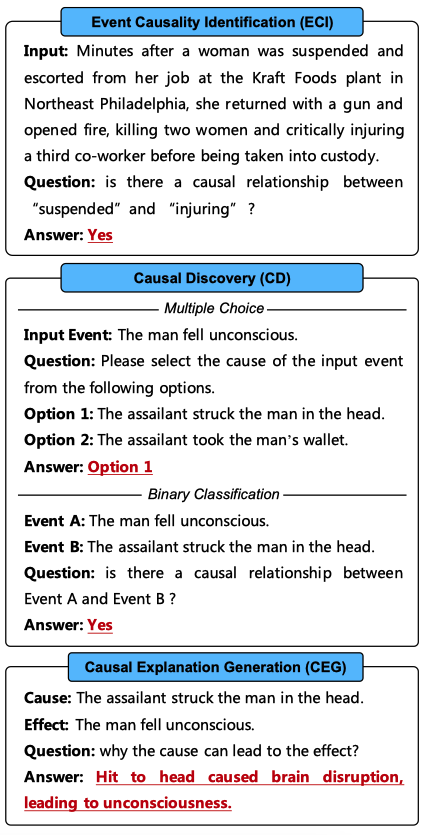

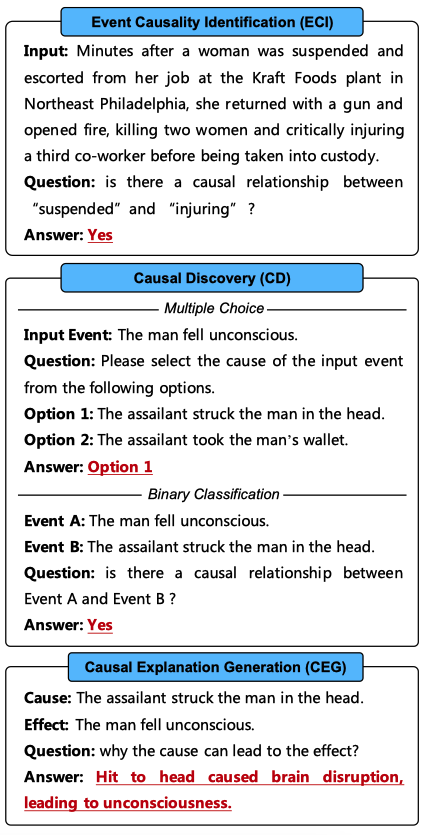

783 因果推理是人类的一项核心认知能力。借助因果推理能力,人类得以理解已观测到的各种现象,并预测将来可能发生的事件。然而,尽管当下的各类因果推理模型已经在现有的因果推理数据集上取得了令人印象深刻的性能,然而,这些模型与人类的因果推理能力相比仍存在显著差距。

2022-05-16 16:21:26 1081

1081 NVIDIA Triton 推理服务器(以前称为 TensorRT 推理服务器)是一款开源软件,可简化深度学习模型在生产环境中的部署。借助 Triton 推理服务器,Devops 和 MLops

2022-06-28 15:49:47 1293

1293 2022年7月25日,由科大讯飞承建的我国首个认知智能全国重点实验室荣登科学常识推理挑战赛OpenBookQA榜首,创新性提出X-Reasoner模型,以准确率94.2%的绝对优势夺冠,常识推理

2022-07-25 23:00:28 488

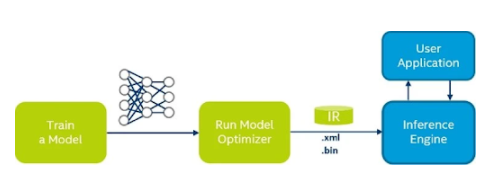

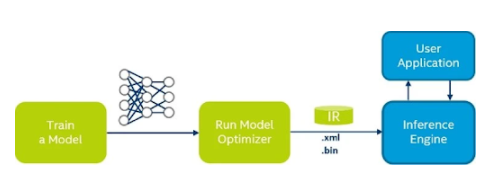

488 推理引擎用于部署应用程序。使用部署管理器,您可以通过将模型、IR 文件、应用程序和相关依赖项组装到目标设备的运行时包中来创建开发包。

2022-08-16 11:27:29 439

439

蚂蚁链 AIoT 团队与 NVIDIA 合作,将量化感知训练(QAT)技术应用于深度学习模型性能优化中,并通过 NVIDIA TensorRT 高性能推理 SDK 进行高效率部署, 通过 INT8 推理, 吞吐量提升了 3 倍, 助力蚂蚁链版权 AI 平台中的模型推理服务大幅降本增效。

2022-09-09 09:53:52 872

872 加速AI推理模型已成为一项基本任务,因为我们正朝着创建更复杂,更高效的AI应用程序迈进。灵活和完整的AI辅助是在快速增长的AI领域取得成功的关键组成部分。

2022-10-19 09:08:50 423

423 对您的 LED 进行高效调光,无需检测电阻器

2022-11-07 08:07:28 0

0 如果给语言模型生成一些 prompting,它还向人们展示了其解决复杂任务的能力。标准 prompting 方法,即为使用少样本的问答对或零样本的指令的一系列方法,已经被证明不足以解决需要多个推理步骤的下游任务(Chowdhery 等,2022)。

2023-02-02 16:15:26 772

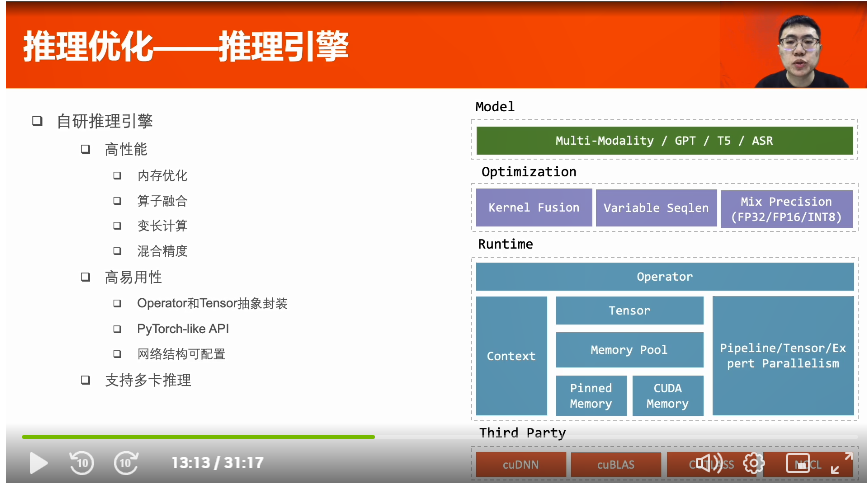

772 多卡推理--流水线并行:将模型和数据切分,以流水线形式计算,提高GPU利用率。模型切分策略:依照各部分的计算时间和参数量设计。

2023-03-23 18:17:33 1921

1921

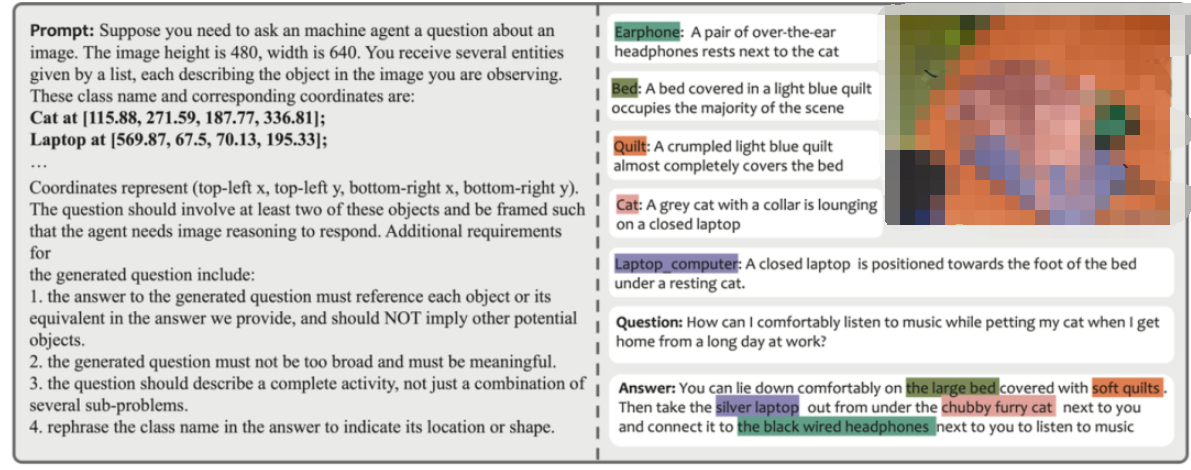

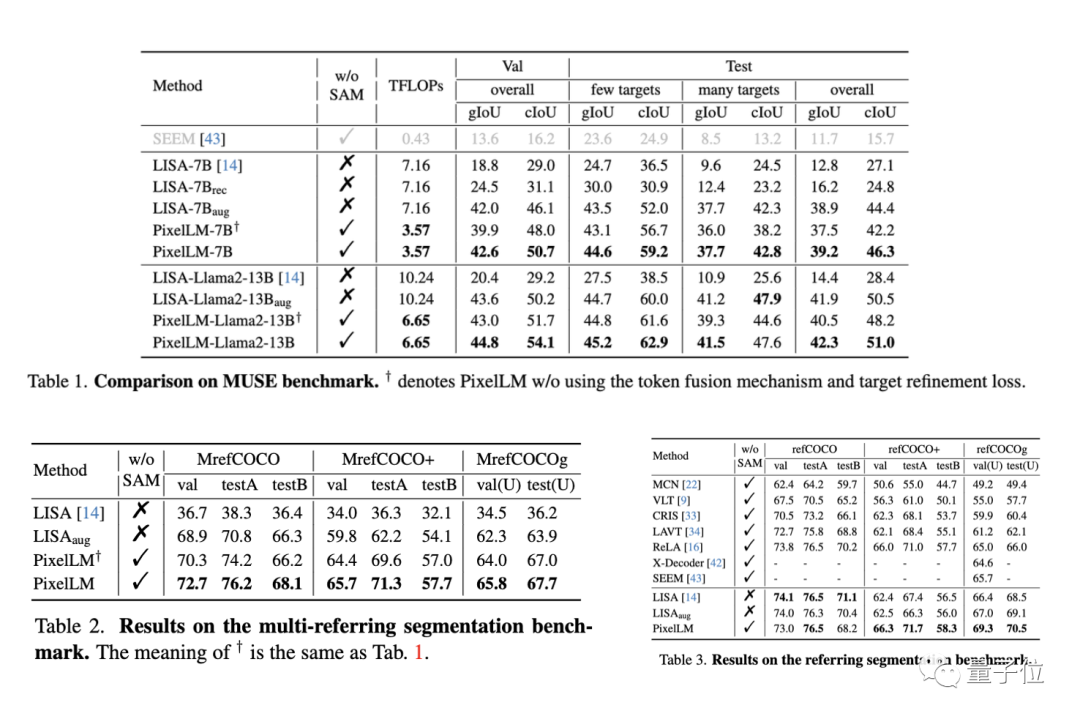

在这些基础模型中,Segment Anything Model(SAM)作为一个在大型视觉语料库上训练的通用图像分割模型取得了显著的突破。事实证明,SAM在不同的场景下具有成功的分割能力,这使得它在图像分割和计算机视觉的相关领域迈出了突破性的一步。

2023-04-20 10:13:37 1061

1061 SAM是一类处理图像分割任务的通用模型。与以往只能处理某种特定类型图片的图像分割模型不同,SAM可以处理所有类型的图像。

2023-05-20 09:30:45 1380

1380 SAM 是一个提示型模型,其在 1100 万张图像上训练了超过 10 亿个掩码,实现了强大的零样本泛化。许多研究人员认为「这是 CV 的 GPT-3 时刻,因为 SAM 已经学会了物体是什么的一般

2023-05-24 14:36:10 596

596

所以,这篇arXiv的论文提出了一个简单而有效的基于SAM大模型的视听定位和分割框架,即AV-SAM,它可以生成与音频相对应的发声对象掩码。具体而言,利用SAM中预先训练的图像编码器的视觉特征,把它和音频特征逐像素视听融合来聚合跨模态表示

2023-05-24 16:00:02 500

500

的有这么强大吗?让我们一起通过本文了解详情! SAM 是一个由 Meta AI 实验室推出的强大人工智能图像分割应用,可以自动识别哪些图像像素属于一个对象,并且对图像中各个对象进行自动风格处理,可广泛用于分析科学图像、编辑照片等。 SAM 的完整应用由一个图片编码器模型(encoder)

2023-06-12 10:46:56 2622

2622

今日,Meta 推出了首个基于 LeCun 世界模型概念的 AI 模型。该模型名为图像联合嵌入预测架构(Image Joint Embedding Predictive Architecture, I-JEPA),它通过创建外部世界的内部模型来学习, 比较图像的抽象表示(而不是比较像素本身)。

2023-06-15 15:47:34 201

201

分割任何模型 (Segment Anything Model - SAM) 是一种突破性的图像分割模型,可实现具有实时性能的快速分割。

2023-06-18 11:42:53 1027

1027

大家好,YOLOv8 框架本身提供的API函数是可以两行代码实现 YOLOv8 模型推理,这次我把这段代码封装成了一个类,只有40行代码左右,可以同时支持YOLOv8对象检测、实例分割、姿态评估模型的GPU与CPU上推理演示。

2023-06-18 11:50:44 1891

1891

因果推理是人类智力的标志之一。因果关系NLP领域近年来引起了人们的极大兴趣,但其主要依赖于从常识知识中发现因果关系。本研究提出了一个基准数据集(CORR2CAUSE)来测试大语言模型(LLM

2023-06-20 15:39:05 1223

1223

导读 本文提出一种"解耦蒸馏"方案对SAM的ViT-H解码器进行蒸馏,同时所得轻量级编码器可与SAM的解码器"无缝兼容" 。在推理速度方面,MobileSAM处理一张图像仅需10ms

2023-06-30 10:59:08 673

673

比Meta的「分割一切模型」(SAM)更快的图像分割工具,来了! 最近中科院团队开源了FastSAM模型,能以 50倍的速度 达到与原始SAM相近的效果,并实现25FPS的实时推理。 该成果

2023-07-03 17:06:08 630

630

使用集成模型在 NVIDIA Triton 推理服务器上为 ML 模型管道提供服务

2023-07-05 16:30:34 1082

1082

深度学习模型部署有OpenVINO、ONNXRUNTIME、TensorRT三个主流框架,均支持Python与C++的SDK使用。对YOLOv5~YOLOv8的系列模型,均可以通过C++推理实现模型

2023-08-06 11:39:17 1677

1677 IEEE高级会员、天津理工大学教授、AR/VR技术专家罗训对记者表示,SAM是视觉领域的通用大模型,很多报道中把它比喻成视觉领域的ChatG-PT,SAM和ChatGPT的支撑技术和应用场景都是不同的,但是在通用性这一点上,它们都是当前技术发展趋势的代表者。

2023-08-23 16:32:19 529

529 在 MLC-LLM 部署RWKV World系列模型实战(3B模型Mac M2解码可达26tokens/s) 中提到要使用mlc-llm部署模型首先需要一个编译过程,将原始的基于Realx搭建的模型

2023-09-26 12:25:55 383

383

vLLM是一个开源的大模型推理加速框架,通过PagedAttention高效地管理attention中缓存的张量,实现了比HuggingFace Transformers高14-24倍的吞吐量。

2023-10-10 15:09:58 1556

1556

背景介绍TPU-MLIR编译器可以将机器学习模型转换成算能芯片上运行的bmodel模型。由于浮点数的计算需要消耗更多的计算资源和存储空间,实际应用中往往采用量化后的模型(也称定点模型)进行推理。相比

2023-10-10 10:17:42 484

484

昆仑芯科技公众号全新栏目“用芯指南”重磅推出!面向AI行业技术从业者,系列好文将提供手把手的昆仑芯产品使用指南。第一期围绕昆仑芯自研效能工具——昆仑芯Anyinfer展开,这是一款基于昆仑芯AI加速卡的高效模型推理部署框架。种种行业痛点,昆仑芯Anyinfer轻松搞定。

2023-10-17 11:16:43 799

799

近日,位于江宁高新区的江苏运动健康研究院传来好消息,在东南大学生物科学与医学工程学院院长、江苏运动健康研究院院长顾忠泽教授团队与华为公司的强强联合下,全球首个人体器官芯片医药大模型近日在江宁问世

2023-10-20 08:43:41 261

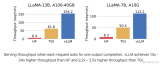

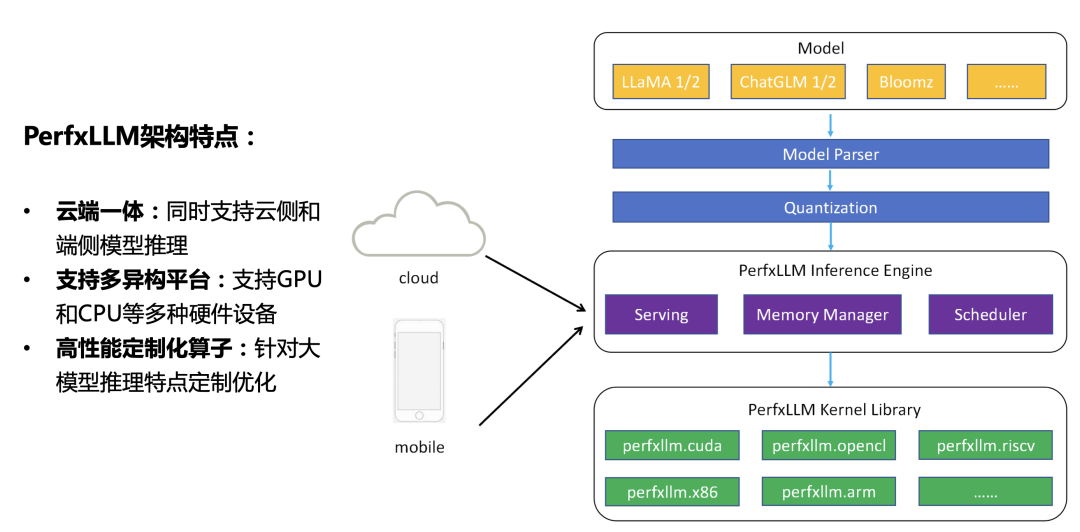

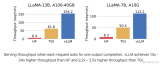

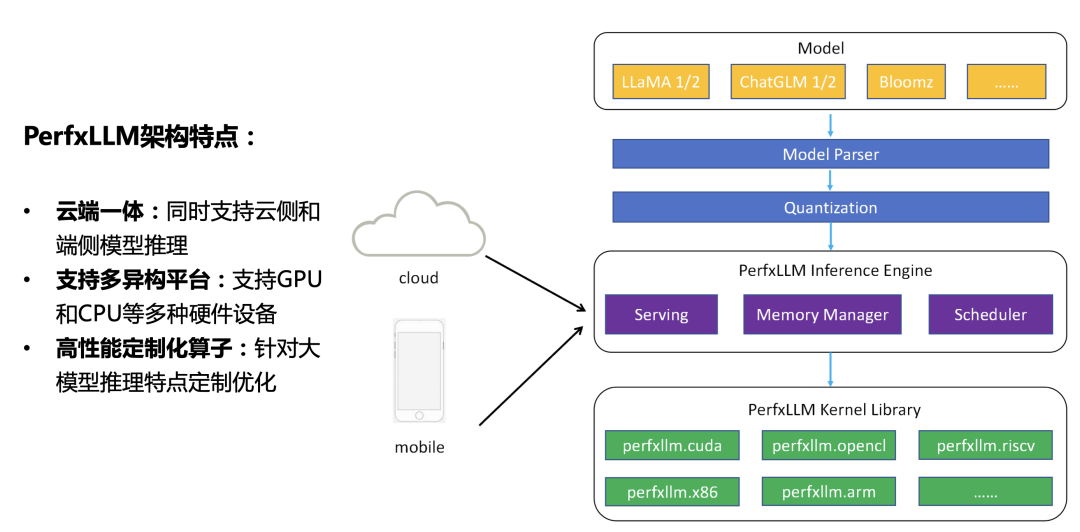

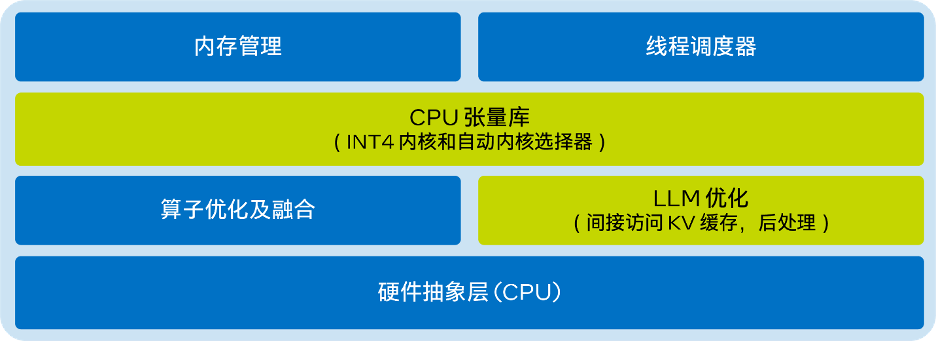

261 要的巨额开销也引发了相关研究者的关注。如何高效地进行推理,并尽可能地减少成本,从而促进大模型应用的落地成为了目前的关键问题。 于是,澎峰科技研发了一款 大模型推理引擎—PerfXLLM ,并且已经在 高通的 骁龙8Gen2 平台实现了应用 。接下来将分为四个部分进行介绍,第一部分将介

2023-11-25 15:35:01 383

383

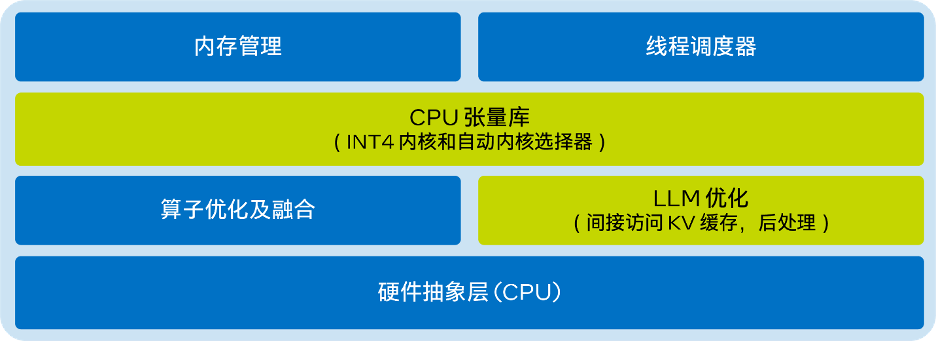

工具包中的LLM Runtime为诸多模型显著降低时延,且首个token和下一个token的推理速度分别提升多达40倍和2.68倍,还能满足更多场景应用需求。 英特尔 Extension

2023-12-01 20:40:03 552

552

SAM、HQ-SAM、Stable-SAM在提供次优提示时的性能比较,Stable-SAM明显优于其他算法。这里也推荐工坊推出的新课程《如何将深度学习模型部署到实际工程中?

2023-12-29 14:35:14 252

252

因果推理能力对于许多自然语言处理(NLP)应用至关重要。最近的因果推理系统主要基于经过微调的预训练语言模型(PLMs),如BERT [1] 和RoBERTa [2]。

2024-01-03 09:55:37 420

420

万兴科技近日正式发布了国内首个音视频多媒体大模型——万兴“天幕”,并宣布大模型研发中心将正式落户马栏山。

2024-02-04 11:42:03 785

785 Groq推出了大模型推理芯片,以每秒500tokens的速度引起轰动,超越了传统GPU和谷歌TPU。

2024-02-26 10:24:46 289

289

人工智能推理的重要性日益凸显,高效运行端侧大模型及AI软件背后的核心技术正是推理。不久的未来,全球芯片制造商的主要市场将全面转向人工智能推理领域。

2024-02-29 16:46:08 557

557

电子发烧友App

电子发烧友App

评论