[首发于智驾最前沿微信公众号]在自动驾驶中,激光雷达(LiDAR)一直被视为车辆的眼睛。随着技术竞争的加剧,很多技术方案装配激光雷达的数量从一颗增加到了三颗甚至四颗。这种硬件上的堆料虽然提升了感知的覆盖范围,但也带来了一个问题,那就是传感器多了,数据处理起来会打架吗?系统会不会因为信息量太大而产生严重的延迟?

为什么自动驾驶需要多个激光雷达?

很多智驾车辆上,都会在车顶安装单颗激光雷达,虽然探测距离远,但它的视场角是有限的,无法兼顾车身四周的近距离盲区。

为了实现全方位的感知,尤其是应对复杂的城市路口转弯、近距离加塞等场景,有些技术方案中会在车头两侧或翼子板位置增加补盲激光雷达。这种布置方式确保了车辆能够拥有三百六十度的环视能力,不给障碍物留下藏身之地。

图片源自:网络

除了扩大视野,多雷达布局还提供了一种冗余保障。在高速行驶的过程中,如果单一传感器受到强光干扰或者物理遮挡导致失效,其他位置的雷达可以迅速接管感知任务,确保系统不会瞬间变成瞎子。

硬件上的相互补位,是提升自动驾驶安全性的重要手段。然而,这种物理上的并存只是第一步,真正的挑战在于如何让这些来自不同位置、不同角度的数据在数字世界里完美地合为一体。

多传感器融合的难点究竟在哪?

激光雷达越多,带来最直接的问题就是空间上的对齐。每一颗雷达都有自己的坐标系,这就好比好几个人从不同的窗口观察同一个房间,他们看到的物体位置和角度都不一样。

要把这些碎片化的点云信息拼成一张完整的地图,就需要极其精确的标定。如果标定出现哪怕几厘米的偏差,系统在识别物体时就会出现重影,明明只有一辆车,算法却可能认为前方有两个重叠的目标,这会直接干扰后续的路径规划。

图片源自:网络

除了空间对齐,时间上的同步同样关键。车辆在行驶过程中,周围的环境是实时变化的。如果左侧雷达采集数据的时间比右侧雷达晚了几十毫秒,那么当系统尝试将这两份数据融合时,探测到的物体已经发生了位移。

为了解决这个问题,就需要使用专门的时间同步协议,确保所有雷达都在同一时刻按下快门。这种毫秒级的同步对硬件时钟和通信协议的要求极高,也是衡量自动驾驶系统成熟度的重要指标之一。

传感器多了真的会造成系统延迟吗?

对于传感器加多产生的延迟问题,本质上是计算资源的博弈。激光雷达每秒钟会产生数以百万计的点云数据,每一颗新增的雷达都在成倍地增加数据吞吐量。这些原始数据需要通过车载以太网传输到计算平台,进行去噪、特征提取和目标识别。

如果计算平台的处理速度跟不上数据流入的速度,确实会导致系统响应变慢。在自动驾驶中,几十毫秒的延迟在高速场景下可能就意味着数米的感知滞后,这显然是不可接受的。

图片源自:网络

为了应对这种计算压力,现在的主流方案并不是简单地堆砌处理器,而是从算法层面进行优化。

比如,系统不再对所有雷达的原始数据进行全量处理,而是采用更有针对性的特征级融合。算法会先在每一颗雷达的局部端完成基础的过滤和预处理,只将有用的特征信息汇总到中央大脑。

此外,随着神经网络架构的演进,很多算法已经能够并行处理多个传感器的输入,大大缓解了串行处理带来的时间损耗,将整体延迟控制在安全范围之内。

如何在性能与效率之间寻找平衡?

解决融合困难和延迟问题的核心,在于算法的架构设计。早期的方案是把激光雷达、摄像头和毫米波雷达的数据分开处理,最后再把结果凑在一起,这被称为后融合。

这种方式虽然简单,但容易丢失关键信息。现在的趋势是前融合或者基于统一空间坐标系的感知,系统将多颗雷达的点云在底层就进行深度集成。这种做法虽然对计算能力要求更高,但能让系统更早、更准地理解环境,减少了后期纠错带来的计算浪费。

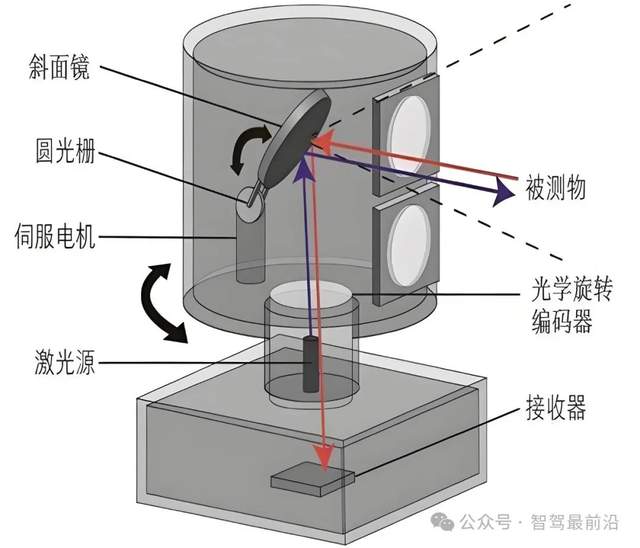

图片源自:网络

随着技术的迭代,激光雷达的性能也在进化。现在的固态激光雷达和高分辨率扫描技术,能够以更高效的数据格式输出信息,减少了冗余的噪声。同时,车载芯片的专用算力也在快速提升,专门针对点云处理设计的硬件加速器让多雷达融合变得不再像以前那样吃力。

虽然增加激光雷达确实带来了融合上的复杂性和潜在的延迟压力,但通过合理的传感器配置、高精度的时空同步以及不断进化的算法架构,这些挑战正在被逐一攻克。对于自动驾驶系统而言,这种硬件上的增加并不是单纯的累赘,而是通往更高级别智能化的必要路径。

审核编辑 黄宇

-

激光雷达

+关注

关注

982文章

4533浏览量

197055 -

自动驾驶

+关注

关注

794文章

14979浏览量

181375

发布评论请先 登录

自动驾驶激光雷达无法识别反光背心吗?

4D点云加持,FMCW激光雷达助力自动驾驶更安全可靠

FMCW和ToF激光雷达,哪种更适合自动驾驶?

自动驾驶里的激光雷达有何作用?

自动驾驶激光雷达可以安装在哪些位置?

决定自动驾驶激光雷达感知质量的因素有哪些?

自动驾驶加激光雷达究竟是增加了成本,还是降低了算力?

自动驾驶中激光雷达搭载越多融合越困难吗?

自动驾驶中激光雷达搭载越多融合越困难吗?

评论