电子发烧友网报道(文/莫婷婷)过去十年,人工智能的爆发式增长与GPU需求紧密相连。凭借其卓越的并行计算能力,GPU成为AI算力的绝对代名词。

然而,英伟达给出颠覆性的新解。在最新的GTC大会上,英伟达CEO黄仁勋正式发布了Vera Rubin AI超级计算机平台。这一平台的问世,不仅标志着英伟达战略从单一的GPU主导转向涵盖CPU、GPU与LPU等技术的全栈“AI工厂”方案商转变,也意味着:未来的AI算力版图,不再由GPU“独舞”。

全栈进化:英伟达从“芯片商”变身“AI工厂”

据多家权威市场研究机构报告,全球AI芯片市场规模正以惊人的复合年增长率扩张,根据市场研究机构Statista的数据,2023年全球GPU市场规模仅为436亿美元,但随着大模型参数量的指数级跃升,数据中心对高性能GPU的需求呈井喷之势,预计2024-2029年复合增速达33.2%,到2029年将达到2742亿美元。

英国皇家工程院院士郭毅可曾在2025世界人工智能大会上指出,全球AI算力需求正以“每两年激增750倍”的惊人速率狂飙。在此浪潮下,中国云端AI芯片市场预计将于2027年冲破480亿美元大关,而国产GPU占据超过八成的市场份额。

面对AI产业对GPU这种对单一架构的过度依赖,不少业内人士也产生担忧,面对日益增长的能效瓶颈、内存墙限制以及多样化的应用场景,除了GPU,我们是否还有更优的解法?

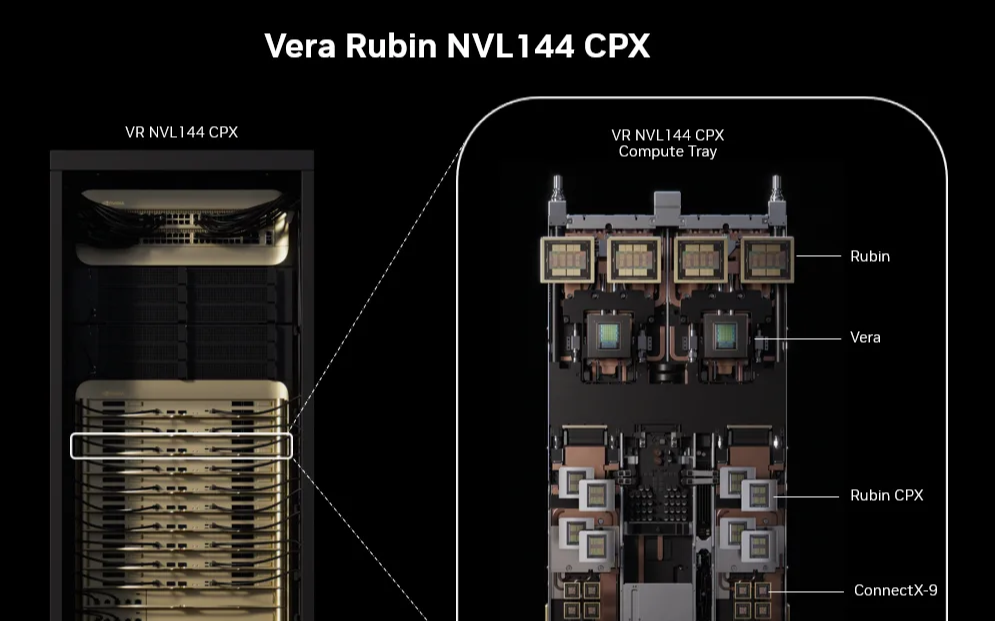

GTC 2026上,英伟达发布了Vera Rubin AI超级计算机平台,包括7款芯片、5种机架级计算机、1台AI超算等在内。

黄仁勋在发布会后的采访中多次强调:“英伟达已经不再是一家传统的芯片公司,而是一家全栈公司。”他指出:“大家以为英伟达只是一家芯片厂商,却忽视了我们业务版图的多元深度,我们是全栈公司,能够帮助全球任何地方的客户构建AI工厂。除非你能交付完整的AI工厂,否则这些客户不会购买芯片,在客户缺乏软件能力的情况下,你必须是一家全栈公司才能服务客户。”

正是基于这种“全栈”思维,英伟达推出了令业内人士期待已久的非GPU重磅产品——推理加速机架“英伟达Groq 3 LPX”。

这款机架配备了256个Groq 3 LPU芯片,拥有高达128GB的片上SRAM、315PFLOPS算力,以及640TB/s扩展带宽,并且可扩展至超过1000张LPU,致力于解决大语言模型推理中的延迟痛点。

作为对比, 黄仁勋拿出Rubin GPU和Groq 3 LPU现场比较关键参数,Rubin GPU被称为“巨量存储与吞吐”的化身,拥有3360亿颗晶体管、288GB HBM4显存及22TB/s带宽,在NVFP4精度下能达到50 PFLOPs的算力;Groq 3 LPU则走“极致片上速度”的极简路线,仅配备980亿颗晶体管与500MB SRAM(容量仅为Rubin的1/500),算力为1.2 PFLOPS,却凭借高达150TB/s的SRAM带宽实现了逆袭——其数据传输速度竟是Rubin的7倍之多。

黄仁勋对这一新平台寄予厚望,他乐观地预判:“我的判断是:我们正处于英伟达推理拐点的第一年,这是十年来推理领域真正意义上的第一个拐点年。而Vera Rubin是拐点的第二年,新增需求的比例同样会达到99%。这正如当年的iPhone 3,其销量的99.9%皆源于前所未有的增量市场。”

在他看来,新的Vera Rubin平台在仅10年内将计算能力提高4000万倍,从而加速让英伟达成为全球最大的“AI工厂”。

Groq补齐推理最后一块拼图

引入Groq技术并非为了取代GPU,而是为了完成最后一块拼图。黄仁勋清晰地阐述了其中的战略意图:“洞察到一个新兴细分市场的崛起,该市场对模型提出了极为严苛三个条件:一是模型体量大,二是支持超长上下文,三是保持极低的推理延迟。Groq,仅能兑现其中一项承诺,无法三者兼得。只有将Vera Rubin与Groq深度融合,才能同时实现这三项承诺。”这也是英伟达收购Groq的初衷之一。

新的Vera Rubin平台通过CPU+GPU+LPU的深度协同,实现了算力的质的飞跃。这一架构不仅为长期由GPU“垄断”的复杂计算难题提供了替代方案,更凭借强大的推理调度能力,重构了算力分工边界——促使CPU与GPU各司其职,实现基于负载特性的精准协同与效能最大化。

LPU的运作方式不同于GPU不同,GPU使用的是SIMD,LPU使用的是序指令集计算机架构,消除了对 HBM 高频重载的依赖,不仅有效规避了 HBM 供应链瓶颈带来的成本溢价,更大幅降低了内存墙限制。

在能效方面,LPU 通过减少多线程管理的开销和避免核心资源的未充分利用,实现了极致的每瓦特算力密度,特别是在推理负载下。公开资料显示,在Llama 2-70B推理任务中,LPU系统实现每秒近300 token的吞吐量,相较英伟达H100实现10倍性能提升,单位推理成本降低达80%。

图源:Groq官网

融入英伟达的Vera Rubin平台后,使得该解决方案更适用于电力稀缺的兆瓦级工厂。Vera Rubin中的GPU负责处理高并发的复杂矩阵运算,而Groq 3 LPU则以其独特的确定性低延迟架构,专注于高速的Token生成,特别是在长上下文场景中表现卓越。黄仁勋再次强调:我们构建的不是一块GPU,而是一座AI工厂。

黄仁勋形象地举例:过去十年,超大规模数据中心受“按核计费”的云计算模式驱动,CPU设计追求核心数量最大化;然而,AI时代的逻辑已发生变化:核心指标从“资源存量”转向了“任务吞吐量”。

“面对价值500亿美元的GPU集群,你绝不允许它们因10亿美元的CPU处理瓶颈而闲置;此时的核心诉求,是迫使CPU以极致速度完成调度,确保GPU集群持续运转”,他指出。

小结:

可以期待的是,未来AI算力部署将迎来根本性变革,GPU不再是唯一的解决方案。黄仁勋描绘出他心中的“算力工厂”蓝图:在一座算力工厂的配置中,75%仍将是纯Vera Rubin部署;其余25%则采用“Vera-Rubin + Groq”的混合模式。他反复强调,Vera-Rubin 将是无可撼动的核心基石,其性能之强悍甚至让英伟达自身都难以构想超越之道。

“我们自己都不知道如何超越Vera Rubin,否则我们早就设计出超越它的产品了。”他认为:虽然当前的推理王座由 Grace Blackwell 占据,但在不久的将来,Grace Blackwell 将功成身退,而 Vera Rubin 及其迭代版本将加冕为新的“推理算力之王”,登顶性能巅峰。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

AI

+关注

关注

91文章

40941浏览量

302517 -

英伟达

+关注

关注

23文章

4112浏览量

99597 -

Groq

+关注

关注

0文章

10浏览量

218

发布评论请先 登录

相关推荐

热点推荐

Vera rubin平台即将交付,英伟达800VDC电源方案进展如何?

、BlueField-4 DPU、Spectrum-6 Ethernet Switch,以及集成Groq 3 LPU)进行整合,形成一个拥有40个机架结构、1200万亿个晶体管、接近20000个

豪言自家芯片比英伟达GPU强10倍,这家AI公司再获融资

电子发烧友网报道(文 / 吴子鹏)在 AI 算力需求呈指数级增长的今天,英伟达凭借其 GPU 和 CUDA 生态构筑的 “护城河” 似乎坚不可摧。然而,

高通挑战英伟达,发布768GB内存AI推理芯片,“出征”AI数据中心

亿美元的数据中心市场中抢占一席之地。 就在10月28日,高通面向数据中心连发两款AI芯片,AI200 和 AI250 芯片,打造下一代

高通挑战英伟达!发布768GB内存AI推理芯片,“出征”AI数据中心

亿美元的数据中心市场中抢占一席之地。 就在10月28日,高通面向数据中心连发两款AI芯片,AI200 和 AI250 芯片,打造下一代

英伟达失守中国区!推理需求爆发,国产GPU抢滩上市

亿元。而在此前,另一家国产GPU公司摩尔线程已于9月26日率先过会。这两大GPU企业接连冲刺IPO,背后是中国AI算力需求爆发式增长与全球供应链格局重塑的多重驱动。

堪称史上最强推理芯片!英伟达发布 Rubin CPX,实现50倍ROI

电子发烧友网报道(文/梁浩斌)近日,英伟达在AI infra峰会上发布了专为大规模上下文推理设计的全新GPU系列Rubin CPX,性能堪称

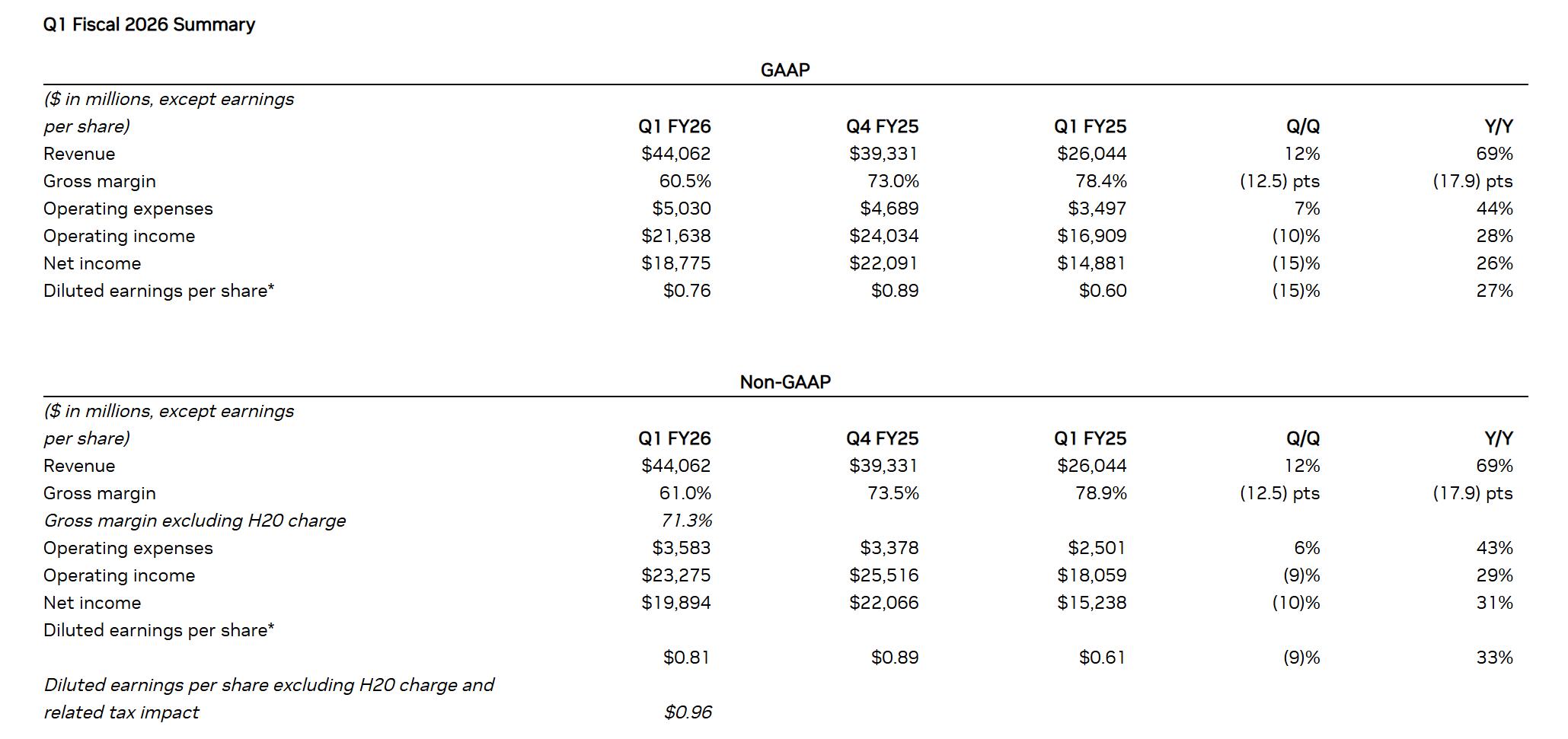

AI推理需求井喷!英伟达Q1营收大涨,H20禁售难挡增长步伐

电子发烧友原创 章鹰 在中美科技企业争夺人工智能高地的竞争中,处于第一方阵的美国AI芯片公司英伟达公司最新交出了让市场满意的答卷。 5月28日,英伟

从英伟达电话会看Agentic AI推理与FPGA价值

2026年2月,英伟达发布2026财年Q4财报:营收681亿美元,同比增长73%,数据中心业务增长75%——预期中的超预期。更值得关注的,是电话会中反复出现的几个关键词:Agentic AI、

AI推理芯片需求爆发,OpenAI欲寻求新合作伙伴

电子发烧友网综合报道,在人工智能迅猛发展的当下,AI推理芯片需求正呈爆发式增长。 AI推理,即支撑如ChatGPT这类AI模型响应用户问

第四次工业革命AI将实现十亿倍增长 | 中国AI芯片与英伟达的角色

内容提要:黄仁勋BG2专访:英伟达、OpenAI、算力未来与美国梦AI规模定律与推理的革命:在传统的AI规模定律(预训练、后训练)之上,引入

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI芯片的需求和挑战

的我我们讲解了这几种芯片的应用场景,设计流程、结构等。

CPU:

还为我们讲解了一种算法:哈希表算法

GPU:

介绍了英伟达H100GP

发表于 09-12 16:07

Groq LPU 如何让万亿参数模型「飞」起来?揭秘 Kimi K2 40 倍提速背后的黑科技

开放预览,引发了开发者社区的疯狂讨论——为什么 Groq 能跑得这么快? 传统 AI 推理硬件(如 GPU)往往面临一个两难选择: ✅

GPU不是AI的唯一解:英伟达用Groq LPU证明,推理赛道需要“另一条腿”

GPU不是AI的唯一解:英伟达用Groq LPU证明,推理赛道需要“另一条腿”

评论