1. 人体关键点识别简介

人体关键点识别是一种基于深度学习的对人进行检测定位与姿势估计的模型,广泛应用于体育分析、动物行为监测和机器人等领域,帮助机器实时解读物理动作。本算法具有运行效率高、实时性强的特点。

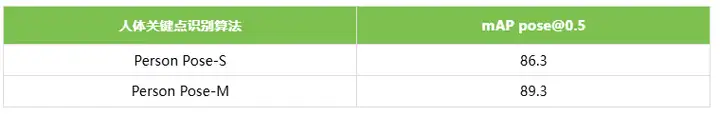

本人员检测算法在数据集表现如下所示:

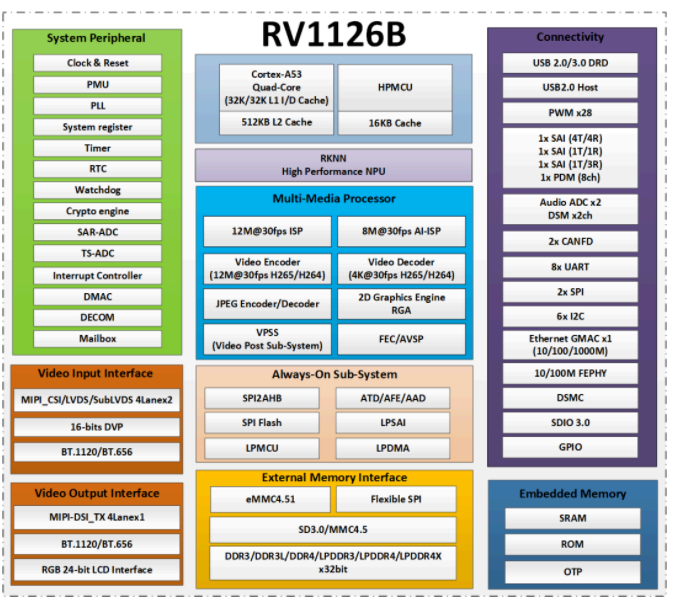

基于EASY-EAI-Nano-TB(RV1126B)硬件主板的运行效率:

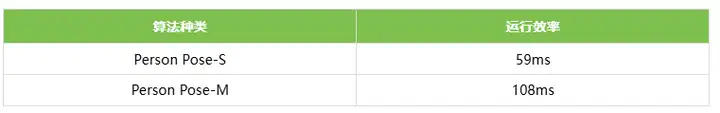

17个人体关键点索引定义:

2. 快速上手

2.1 开发环境准备

如果您初次阅读此文档,请阅读《入门指南/开发环境准备/Easy-Eai编译环境准备与更新》,并按照其相关的操作,进行编译环境的部署。

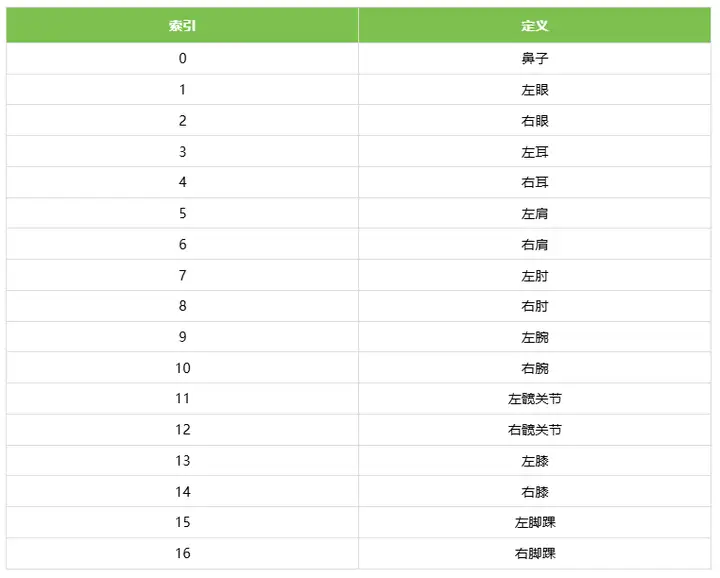

在PC端Ubuntu系统中执行run脚本,进入EASY-EAI编译环境,具体如下所示。

cd ~/develop_environment ./run.sh 2204

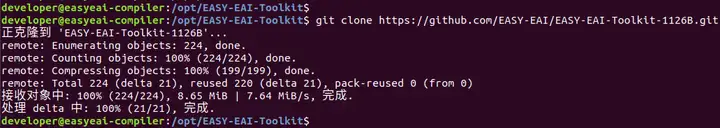

2.2 源码下载

在EASY-EAI编译环境下创建存放源码仓库的管理目录:

cd /opt mkdir EASY-EAI-Toolkit cd EASY-EAI-Toolkit

通过git工具,在管理目录内克隆远程仓库

git clone https://github.com/EASY-EAI/EASY-EAI-Toolkit-1126B.git

注:

* 此处可能会因网络原因造成卡顿,请耐心等待。

* 如果实在要在gitHub网页上下载,也要把整个仓库下载下来,不能单独下载本实例对应的目录。

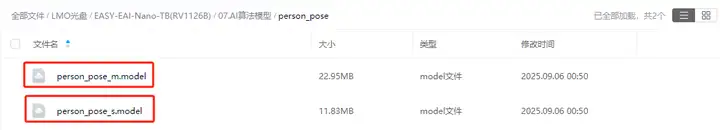

2.3 模型部署

要完成算法Demo的执行,需要先下载人体关键点检测算法模型。

百度网盘链接为:https://pan.baidu.com/s/13BsL5MZ4NQ8jDDe-5WLXDw?pwd=1234(提取码:1234 )。

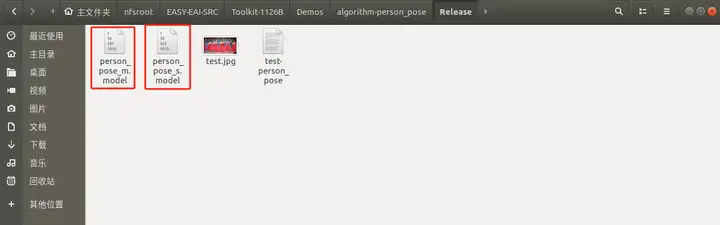

同时需要把下载的人体关键点检测算法模型复制粘贴到Release/目录:

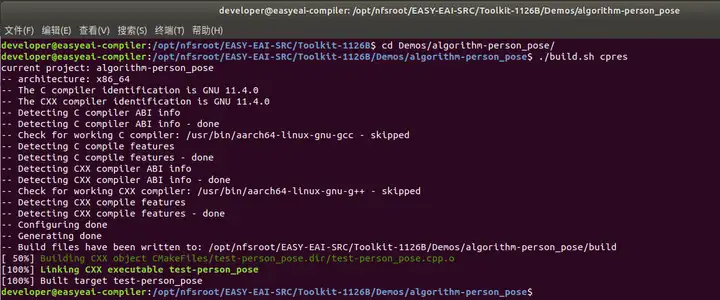

2.4 例程编译

进入到对应的例程目录执行编译操作,具体命令如下所示:

cd EASY-EAI-Toolkit-1126B/Demos/algorithm-person_pose/ ./build.sh cpres

注:

* 由于依赖库部署在板卡上,因此交叉编译过程中必须保持/mnt挂载。

* 若build.sh脚本带有cpres参数,则会把Release/目录下的所有资源都拷贝到开发板上。

2.5 例程运行及效果

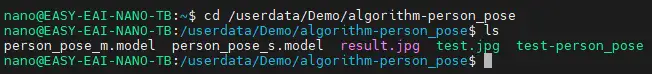

通过串口调试或ssh调试,进入板卡后台,定位到例程部署的位置,如下所示:

cd /userdata/Demo/algorithm-person_pose/

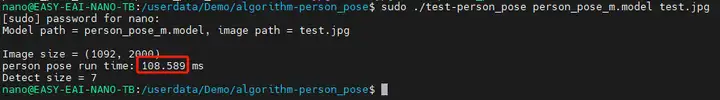

运行例程命令如下所示:

sudo ./test-person_pose person_pose_m.model test.jpg

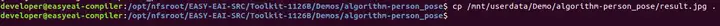

在EASY-EAI编译环境可以取回测试图片:

cp /mnt/userdata/Demo/algorithm-person_pose/result.jpg .

结果图片如下所示:

API的详细说明,以及API的调用(本例程源码),详细信息见下方说明。

3. 人体关键点检测API说明

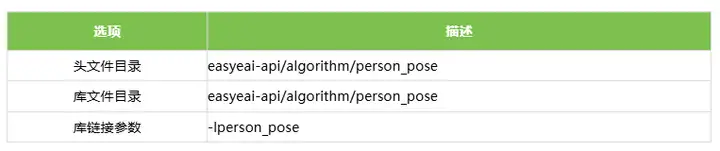

3.1 引用方式

为方便客户在本地工程中直接调用我们的EASY EAI api库,此处列出工程中需要链接的库以及头文件等,方便用户直接添加。

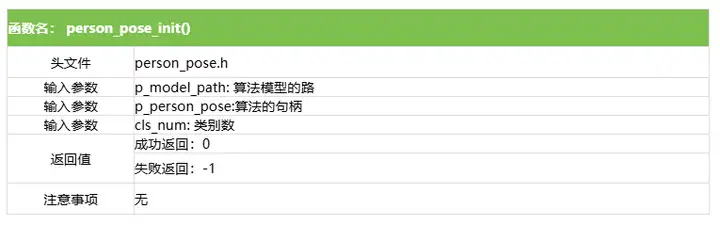

3.2 人体关键点识别初始化函数

人体关键点识别初始化函数原型如下所示。

int person_pose_init(const char *c, person_pose_context_t *p_person_pose, int cls_num)

具体介绍如下所示。

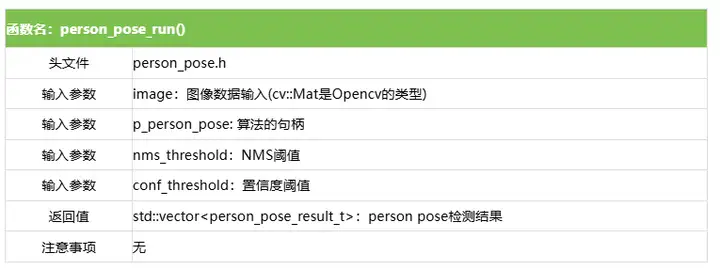

3.3 人体关键点识别运行函数

人体关键点识别运行函数person_pose_run原型如下所示。

std::vector person_pose_run(cv::Mat image, person_pose_context_t *p_person_pose, float nms_threshold, float conf_threshold);

具体介绍如下所示。

3.4 人体关键点识别释放函数

人体关键点识别释放函数原型如下所示。

int person_pose_release(person_pose_context_t* p_person_pose)

具体介绍如下所示。

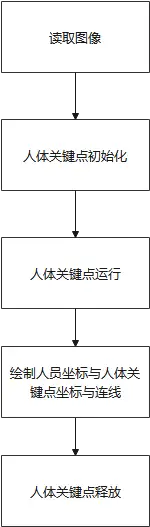

4. 人体关键识别算法例程

例程目录为Demos/algorithm-person_pose/test-person_pose.cpp,操作流程如下。

参考例程如下所示。

#include #include #include #include #include "person_pose.h" #include // 画线 cv::Mat draw_line(cv::Mat image, float *key1, float *key2, cv::Scalar color) { if (key1[2] > 0.1 && key2[2] > 0.1) { cv::Point pt1(key1[0], key1[1]); cv::Point pt2(key2[0], key2[1]); cv::circle(image, pt1, 2, color, 2); cv::circle(image, pt2, 2, color, 2); cv::line(image, pt1, pt2, color, 2); } return image; } // 绘制结果: // 0鼻子, 1左眼, 2右眼,3左耳,4右耳,5左肩,6右肩,7左肘,8右肘,9左腕,10右腕,11左髋关节,12右髋关节,13左膝,14右膝,15左脚踝,16右脚踝 cv::Mat draw_image(cv::Mat image, std::vector results) { long unsigned int i =0; for (i = 0; i < results.size(); i++) { // 绘制脸部 image = draw_line(image, results[i].keypoints[0], results[i].keypoints[1], CV_RGB(0, 255, 0)); image = draw_line(image, results[i].keypoints[0], results[i].keypoints[2], CV_RGB(0, 255, 0)); image = draw_line(image, results[i].keypoints[1], results[i].keypoints[3], CV_RGB(0, 255, 0)); image = draw_line(image, results[i].keypoints[2], results[i].keypoints[4], CV_RGB(0, 255, 0)); image = draw_line(image, results[i].keypoints[3], results[i].keypoints[5], CV_RGB(0, 255, 0)); image = draw_line(image, results[i].keypoints[4], results[i].keypoints[6], CV_RGB(0, 255, 0)); // 绘制上半身 image = draw_line(image, results[i].keypoints[5], results[i].keypoints[6], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[5], results[i].keypoints[7], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[7], results[i].keypoints[9], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[6], results[i].keypoints[8], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[8], results[i].keypoints[10], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[5], results[i].keypoints[11], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[6], results[i].keypoints[12], CV_RGB(0, 0, 255)); image = draw_line(image, results[i].keypoints[11], results[i].keypoints[12], CV_RGB(0, 0, 255)); // 绘制下半身 image = draw_line(image, results[i].keypoints[11], results[i].keypoints[13], CV_RGB(255, 255, 0)); image = draw_line(image, results[i].keypoints[13], results[i].keypoints[15], CV_RGB(255, 255, 0)); image = draw_line(image, results[i].keypoints[12], results[i].keypoints[14], CV_RGB(255, 255, 0)); image = draw_line(image, results[i].keypoints[14], results[i].keypoints[16], CV_RGB(255, 255, 0)); cv::Rect rect(results[i].left, results[i].top, (results[i].right - results[i].left), (results[i].bottom - results[i].top)); cv::rectangle(image, rect, CV_RGB(255, 0, 0), 2); } return image; } /// 主函数 int main(int argc, char **argv) { if (argc != 3) { printf("%s \n", argv[0]); return -1; } const char *p_model_path = argv[1]; const char *p_img_path = argv[2]; printf("Model path = %s, image path = %s\n\n", p_model_path, p_img_path); cv::Mat image = cv::imread(p_img_path); printf("Image size = (%d, %d)\n", image.rows, image.cols); int ret; person_pose_context_t yolo11_pose; memset(&yolo11_pose, 0, sizeof(yolo11_pose)); person_pose_init(p_model_path, &yolo11_pose, 1); double start_time = static_cast(cv::getTickCount()); std::vector results = person_pose_run(image, &yolo11_pose, 0.35, 0.35); double end_time = static_cast(cv::getTickCount()); double time_elapsed = (end_time - start_time) / cv::getTickFrequency() * 1000; std::cout << "person pose run time: " << time_elapsed << " ms" << std::endl; // 绘制结果 image = draw_image(image, results); cv::imwrite("result.jpg", image); printf("Detect size = %ld\n", results.size()); ret = person_pose_release(&yolo11_pose); return ret; }

-

Linux

+关注

关注

88文章

11817浏览量

219555 -

瑞芯微

+关注

关注

27文章

854浏览量

54667 -

EASY-EAI灵眸科技

+关注

关注

4文章

103浏览量

3727 -

RV1126B

+关注

关注

0文章

92浏览量

245

发布评论请先 登录

瑞芯微(EASY EAI)RV1126B 音频输入

瑞芯微(EASY EAI)RV1126B PWM使用

瑞芯微(EASY EAI)RV1126B 音频输出

【EASY EAI Nano-TB(RV1126B)开发板试用】+初识篇

【EASY EAI Nano-TB(RV1126B)开发板试用】命令行功能测试-shell脚本进行IO控制-灯闪

【EASY EAI Nano-TB(RV1126B)开发板试用】命令行功能测试-shell脚本进行IO控制-红绿灯项目

【EASY EAI Nano-TB(RV1126B)开发板试用】命令行功能测试-shell脚本进行IO控制-红绿灯按钮项目

【EASY EAI Nano-TB(RV1126B)开发板试用】+1、开箱上电

【EASY EAI Nano-TB(RV1126B)开发板试用】介绍、系统安装

RV1126系列选型指南:从RV1126到RV1126B,一文看懂升级差异

【免费试用】EASY EAI Nano-TB(RV1126B)开发套件评测

替代升级实锤!实测RV1126B,CPU性能吊打RV1126

瑞芯微(EASY EAI)RV1126B rknn-toolkit-lite2使用方法

瑞芯微(EASY EAI)RV1126B 人体关键点识别

瑞芯微(EASY EAI)RV1126B 人体关键点识别

评论