[首发于智驾最前沿微信公众号]当前自动驾驶行业,各车企的技术路径普遍选择了单车智能方向。而在实际落地过程中,不同企业选择了差异化的技术实现方式,部分车企侧重于视觉—语言—动作模型(Vision Language Action,VLA),另一些则致力于构建并应用世界模型(World Model)。这两种路径有什么不同?

什么是VLA,什么是世界模型

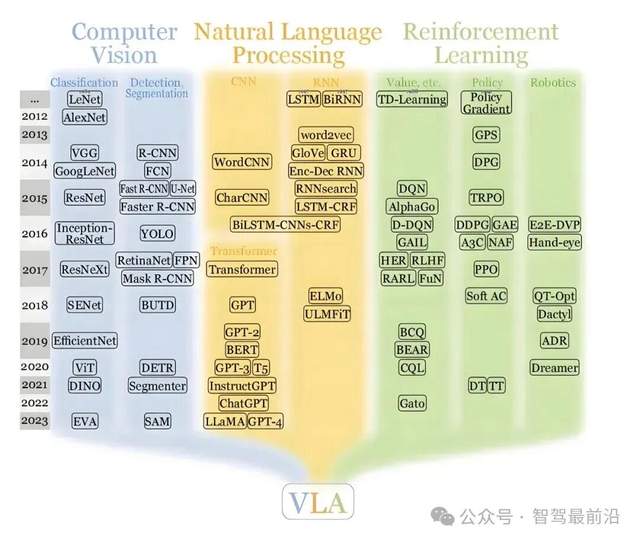

先说说VLA。VLA是英文Vision-Language-Action的缩写,即视觉—语言—动作。也就是说,这种模型把视觉感知、语言/语义理解/推理和动作/控制输出这三步融合到一个端到端(end-to-end)的体系里。

图片源自:网络

VLA先通过摄像头(或其他传感器)获取环境信息,再用视觉编码器把它转成特征向量,然后把这些视觉特征“翻译”到类似语言模型(LLM,large language model)可以理解的语义空间里,通过语言模型进行高层推理、判断(如识别车道线、行人、交通标志,甚至判断行人的意图、交通规则优先级、当前场景该采取什么策略等等),语言模型的“结论”将会被送到动作生成模块,直接输出控制指令(例如转向、加减速、轨迹规划)。

VLA的主要作用就是让自动驾驶汽车具备“看、想、做”的能力,从视觉信息到动作输出,中间有进行了思考、推理、语义理解的环节,而不是简单的感知→规划→控制那种模块化规则的方式。

再说世界模型。世界模型的核心,是在模型大脑中里构建一个对外部世界的虚拟、内部模型。也就是说,它不只是看到当前路况,而是尝试理解世界的物理规律、交通规则、各种动态变化,然后在这个内部模型里模拟、推演、预测未来可能的场景。如可以预测前方那辆车会不会突然转向、行人是否会冲出、天气或光线变化会有怎样影响等,通过对交通环境的预测,可以辅助决策、规划、甚至策略验证。

世界模型常被用来做仿真、模拟,通过大规模模拟极端、稀有场景、长尾场景,为自动驾驶系统训练、验证、生成数据。也能让系统在内部预演并判断风险,而不仅仅依赖当前看到的画面。

简而言之:

VLA=视觉+语言(语义)+动作,通过一个端到端体系,把“看、理解、做”连起来。

世界模型=在“脑子里”建立对世界的模型、仿真,让系统可以想象未来、做预测/推理,从而判断风险。

为什么车企会选择这两个方向?

现阶段众多车企在这两个方向并行投入,都期望这两项技术能给自动驾驶的落地带来更多可能。之所以会这样,是因为自动驾驶对复杂性、不确定性、安全性、长尾场景的高要求,传统的模块化+规则/规划+静态预测模式在真实交通场景中无法完全应对。

传统的自动驾驶系统,主流架构普遍采用“感知→规划→控制”的模块化设计。其通过摄像头、毫米波雷达、激光雷达等传感器采集环境数据,交由感知模块进行目标检测、分类与跟踪,识别如行人、车辆、车道线等关键信息;规划模块再依据感知结果,结合预设规则与预测模型,生成轨迹、速度及加减速等决策;控制模块将根据决策执行具体的转向、油门及制动指令。

图片源自:网络

但随着自动驾驶车辆在道路上应用越来越多,复杂的路况、场景的动态多变以及边缘案例的持续涌现,让基于固定规则与静态预测的串联式架构局限凸显,难以覆盖所有潜在场景,尤其在长尾与极端情况下,系统的适应能力与鲁棒性面临显著挑战。

于是,人们希望自动驾驶系统能像老司机一样,不只是看见世界,还能“理解”、能“推理”、能“预测未来”、能“灵活应对变化”。VLA和世界模型正是基于此出现的。

各自优势与局限

1)VLA的优势

语义理解+可解释性

因为VLA将视觉信息“翻译”成语义(类似语言描述),所以它更贴近人类理解世界的方式。对于如行人、骑车人、交通标志、交互意图等复杂交通场景,VLA的语言推理能力就表现出其优势性。

端到端+整体优化

端到端模型中,从感知到动作的流程都被统一在一个模型里,中间没有太多手工设定的规则和模块边界,使得它理论上可以通过大数据训练、学习,从经验里学会开车该怎样反应,从而体现出较强的泛化能力。

适合复杂语义场景+人机交互

自动驾驶系统需要实现与人类的高效协同,如准确理解请在前方便利店临时停车等自然语言指令,或在必要时向用户解释因左侧行人突然靠近而制动等决策原因。VLA技术所具备的多模态语义对齐与自然语言处理能力显现出其独特价值。其架构天然支持复杂语义的解析、推理与生成,能够为人机交互提供直观、可解释的沟通界面,从而增强系统的可理解性与用户体验。

2)VLA的局限

对环境物理动态+长尾、稀有场景的预测能力弱

VLA本质是“看到+推理+输出”,如果只是基于当前画面做判断,没有对未来可能变化(比如前方车辆突然紧急刹车、行人冲出、雨雪、光照变化等)做足够仿真及预测,就可能反应不够及时或不够安全。

监督信号稀疏/学习不充分

一些最新研究指出,仅靠动作输出(方向盘转角/加速/制动)作为监督,对于一个容量很大的VLA模型来说可能远远不够,有可能让模型的大部分潜能无法利用。近期就有研究提出把世界建模(预测未来画面)加到VLA的训练中,以获得更丰富、更密集的监督信号。

实时性、计算资源消耗

端到端大模型整合了多模态感知与直接动作生成,若进一步要求其具备长短时预测与复杂场景推理能力,将面临算力需求、实时延迟及能效挑战。这在车载嵌入式平台上尤为突出,这样成为其实际落地应用中必须攻克的难题。

3)世界模型的优势

对未来、动态、复杂场景的“预测+仿真+规划”能力强

通过在内部建立对世界的模型,系统可以不仅看到当下,还可以推演未来,从而实现如模拟前车可能刹车、行人可能穿过、光照/天气可能变、车辆可能并线等等预测,然后提前规划最安全/稳妥的动作。这对于自动驾驶尤其重要,因为真实道路环境充满变化、不确定和突发性。

适合大规模训练/长尾/极端场景生成

在真实交通环境中,某些危险或极端情况很难大量收集(比如夜间雨雪、大雾、极端行人行为、突发障碍物等),但用世界模型可以“仿真”这些情况,用来训练、验证、测试自动驾驶系统,增强其鲁棒性和安全性。

提供冗余、安全校验机制

即使主系统(决策/动作模块)出现问题,世界模型也能作为“虚拟大脑”进行冗余判断、风险分析、仿真校验。某些设计还会把轻量世界模型放到车端,用作校验及安全网。

4)世界模型的局限

构建和训练复杂

要让世界模型准确反映真实的交通环境,必须对车辆动力学、交通规则、不确定性因素及行人行为等多维要素进行高保真度建模。这种对物理、社会及动态规则的高精度模拟,对数据质量、计算规模与系统设计均提出了极高要求。正因如此,早期世界模型在实现实时推理与高效部署时存在诸多问题,尤其在GPU算力加速与车规级延迟约束下,其工程化应用受到较大限制。

与语义理解/规则/常识融合较弱

纯世界模型偏重物理+动态+预测/仿真/规划,但对复杂语义、交通规则、行人意图、社会交互规则这些语义+常识+规则+语言的范畴不一定做得很好。对于某些需要语义理解、规则判断、解释及交互的场景,表现将不够灵活。

可解释性/透明性可能较差

世界模型的核心机制在于对物理规律与动态场景进行内部仿真与数值化概率推演,其决策过程依赖于高维隐式状态空间的建模与计算。但这种基于数值模拟的推理方式,在对外输出时难以转化为人类可直观理解的语义解释。在自动驾驶的安全验证、法规合规、责任界定与系统可审计性等实际落地要求中,这种“黑箱”特性成为了不得不去面对的问题。

最后的话

VLA和世界模型,看起来像是自动驾驶领域里两种不同的“脑子设计方式”,VLA让车具备“看到+理解+判断+动作”的能力;世界模型则给车提供了一个“内部虚拟世界+预测/仿真/推演未来”的能力。但在方向选择上,智驾最前沿以为,如果能把两条路结合起来、互补使用,或许可以让自动驾驶真正安全、智能、稳定地落地。

审核编辑 黄宇

-

Vla

+关注

关注

0文章

25浏览量

5921

发布评论请先 登录

小米正式发布并全面开源自动驾驶模型Xiaomi OneVL

蚂蚁灵波开源LingBot-VLA真机后训练代码

小米开源VLA大模型后训练全流程:亚毫米级操作突破引领机器人产业革命

小鹏发布 X-World 世界模型:已全面应用第二代VLA

如何构建适合自动驾驶的世界模型?

VLA模型是基于预置规则来指导行动吗?

全球首车搭载元戎启行VLA模型,魏牌蓝山智能进阶版重磅上市

世界模型是让自动驾驶汽车理解世界还是预测未来?

VLA能解决自动驾驶中的哪些问题?

VLA和世界模型,谁才是自动驾驶的最优解?

自动驾驶上常提的VLA与世界模型有什么区别?

基于大规模人类操作数据预训练的VLA模型H-RDT

VLA,是完全自动驾驶的必经之路?

元戎启行周光:VLA模型将于2025年第三季度量产

VLA与世界模型有什么不同?

VLA与世界模型有什么不同?

评论