[首发于智驾最前沿微信公众号]最近在和一位小伙伴交流时,他提出了一个非常有趣的问题:VLA模型是否更适合纯视觉系统?它能帮助纯视觉系统算法走向成熟吗?这个问题非常有意思,对于这个问题,先讲结论,VLA(Vision-Language-Action,视觉—语言—动作)不是纯视觉系统的“一键升级包”,但它能为纯视觉方案注入非常有价值的能力和训练范式,推动算法走向更成熟的方向。换句话说,VLA模型给自动驾驶带来的不是简单的替代,而是新的工具箱和新的训练思路,把它用在合适的位置、以合适的方法去融合和验证,能让纯视觉系统变得更鲁棒、更有语义理解力,但它也带来新的复杂性、数据需求与工程风险,需要谨慎对待。

什么是VLA?

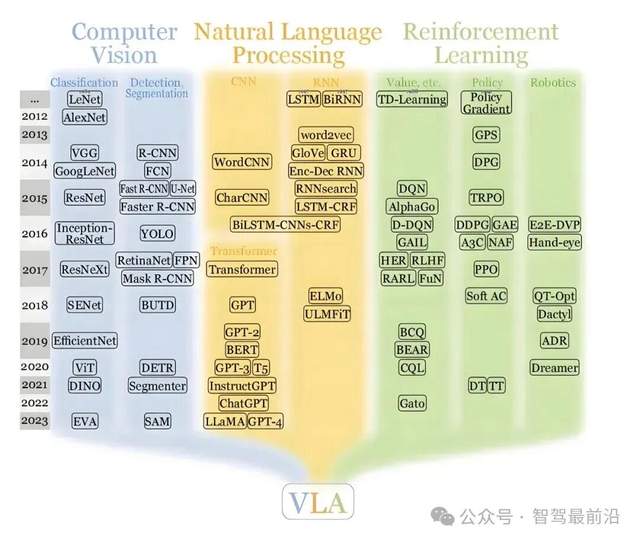

在详细聊今天的话题前,要先弄清“VLA是什么”。VLA一词近两年开始在学术界与产业圈流行起来,其核心思想是把视觉(camera图像)、语言(自然语言或符号描述)和动作(机器人或车辆的控制指令、轨迹)放在同一个大模型里进行联合建模和端到端训练。典型的做法是先用大规模的视觉-语言模型(VLM)作为感知与推理的骨干,再在其上接一个动作解码器,把视觉与语言得到的语义表示直接映射为连续或离散的动作输出。VLM起初被用于机器人操控(例如RT-2的工作方向),随后出现了开源的OpenVLA和一些面向通用具身控制的大模型(如近期行业报道中的Helix、NVIDIA等方案),这些都把“看得懂(vision)+听得懂(language)”和“能做事(action)”连成了一条链。

那在谈及VLA模型时,为什么会将其与“纯视觉”放在同一个话题里比较?其实过去几年里,视觉-语言大模型(VLM)展现了很强的泛化与推理能力,从图像里抽取细粒度语义信息、结合世界知识做推断、把场景转换成可读的自然语言描述,这些都是VLM的强项。而把这些能力和控制策略(动作)连接起来的想法,是为了做到“感知+推理+控制”的更紧耦合。对于自动驾驶汽车来说,若模型不仅可以告诉你前方有辆自行车,还可以根据目标和约束直接输出可执行的动作轨迹或转向/速度指令,这样有效提升自动驾驶的能力。大模型之所以被广泛应用于自动驾驶,主要原因有两点,一是“少模块化,多端到端”的趋势可以简化工程链路、把隐含知识留在模型里;二是大模型的预训练带来了跨场景迁移能力,有机会减少为每个场景单独标注的大量工时。这也解释了为什么会把VLA用到自动驾驶——尤其是一些希望主要依靠摄像头(纯视觉)实现大部分感知与决策功能的团队。

VLA真的更适合纯视觉吗?

VLA是否更适合纯视觉系统?这个问题其实要分两层来讲,一是概念层面,二是工程/安全层面。从概念上讨论,VLA天生是多模态的,它把语言作为中间的抽象层,使模型能用更高层次的语义去理解场景,这对于只靠像素信息的纯视觉系统是个强补充。语言可以作为监督信号、作为任务指令的载体,也可以提供对复杂交通场景的高阶描述(比如“前方有人追球横穿,注意减速让行”),从而把视觉感知的“像素到语义”的映射变得更明确、更可解释。换句话说,VLA为纯视觉系统提供了一个更强的语义通道和训练范式,这对提升视觉模型在长尾场景下的理解能力是有帮助的。

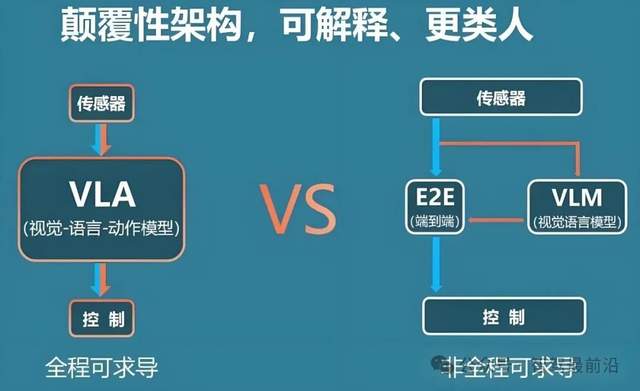

但工程与安全层面又把问题拉回现实。自动驾驶不是只看懂场景就够了,它还要求确定性、实时性、可验证性以及在各种传感器失效条件下的冗余能力。当前行业内将自动驾驶系统拆成感知-定位-规划-控制几个模块,这并非纯粹为了便于功能区分,而是为了各层次的可控与可验证。当把这些都塞进一个端到端的VLA模型里,将会面临多个问题,其中包括动作输出的精确度与时延能否满足实时闭环控制需求?模型在极端少见场景下的失败模式是否可被解释并安全地退回?模型输出是否能满足法规/认证所需的确定性证明?这些问题在机器人领域被部分接受(因为机器人在某些实验条件下能用高频闭环控制、并有直接动作标签做监督),但在车规级自动驾驶上,特别是高速公路与复杂城市环境,风险容忍度低,监管要求高,单纯把控制交给一个大模型目前仍然困难重重。

VLA如何推动纯视觉成熟?

那么VLA能如何“帮助”纯视觉算法成熟?这里可以把它视为若干可借鉴、可组合的能力与工具。VLA的大规模多模态预训练能给视觉模型带来更强的语义表示,用语言监督或对齐,视觉特征更容易学到“概念级”的判别力,进而提升小样本场景下的鲁棒性与可解释性。对纯视觉团队来说,这等于把一批“世界知识”和“语义理解”注入到视觉特征上,而这些正是纯像素监督常常缺乏的。OpenVLA等开源工作已经展示了把大量示教数据与语言描述结合后,模型在跨任务泛化上的提升。

此外,VLA提供了新的监督信号和训练范式。传统视觉感知的训练主要是像素级或框级标签(例如检测框、语义分割标签),这些标注既昂贵又难覆盖长尾。VLA能把自然语言描述、指令序列或轨迹数据当作监督,支持行为克隆、序列预测与从语言到动作的映射学习。这意味着在一些可控场景里,纯视觉系统可以借助VLA-style的蒸馏或联合训练,学习到行为倾向(behavioralpriors)和策略级别的特征,从而在决策层面拥有更一致的语义基础。行业里用VLM预训练然后微调到动作任务,已经证明了这种思路的潜力。

VLA还可以作为“模拟到现实”桥梁与数据合成利器。纯视觉系统在长尾极端场景上的缺样本问题尤其明显,而VLA的多模态预训练和生成能力可以在模拟环境中生成带有语言注释的复杂交互样本,或者把真实场景的视觉内容转成结构化的语言描述用于扩充训练集。这种利用语义级别增强的数据合成,比单纯的像素增强更能补齐模型在理解复杂交通参与者行为上的短板,从而帮助纯视觉感知模块在语义判断上更成熟。

以上都是“助力”的方面,再说说现实的限制与需要警惕的点。第一是动作监督数据短缺且昂贵。要让模型学会把视觉表示转成安全可靠的控制命令,需要大量高质量的轨迹/控制数据(带时间戳的闭环示教、各种速度/转向控制序列等),这些数据比标注图片要难得多。虽然在机器人社区出现了一些百万级示教数据集(OpenX-Embodiment类),但车规级的多场景、长时间序列数据仍然稀缺,系统因此对示教数据的依赖会成为瓶颈。

第二是闭环控制频率与延迟问题。车辆控制要求毫秒级别甚至更高的响应与稳定性,而大型VLM/VLA的推理延迟和算力成本可能无法直接满足这一点。行业里常见的做法是把VLA用作“慢思考”(高层决策、意图预测、策略选择)而不直接负责高频控制环,这样既能利用VLA的推理能力,又保留传统控制环的实时性与确定性。如把VLA输出的高层指令(减速、超车、让行)交给传统的规划与控制模块去执行,这是一种折衷的工程路径。

第三是安全可验证与退避策略。纯视觉系统本身就有传感器盲区与误识别问题,把更多“决策责任”压到端到端模型上,增加了不可预见的失败模式。智驾最前沿以为,从合规与工程管理角度,实际可行的路线更倾向于混合架构,即用VLA提供丰富语义和策略建议,同时维持一个独立的规则化安全栈(基于径向冗余传感器、规则判断和基线控制器)来执行最后的安全约束。换句话说,用VLA加强“智能”和“理解”,但不把生命线交出去。

VLA应如何应用于纯视觉?

那VLA可以如何应用于纯视觉自动驾驶?其实我们可以把VLA看作“语义增强器”和“策略导师”,优先用来提升感知的语义层面与策略级别的学习,而不是直接替代低层控制。可以采用的做法包括用VLM/VLA预训练得到的视觉特征去初始化纯视觉感知网络;用语言对齐的信号去做多任务监督(把检测/分割/行为预测与描述性语言一起学);以及用VLA在模拟环境中合成带文本标注的复杂交互场景来增强稀有长尾样本。这样可以把VLA的长处最大化,同时把风险降到可控范围。

此外,数据治理要做好分级和校验。把动作学习当作主训练目标时,需要对示教数据做严格的质量控制和异常剔除,并配套构建能做因果归因和反事实测试的离线评价体系。车辆的动作输出不能只看在训练集上的平均误差,还必须评估极端情景、边缘案例与连锁反应的安全性。这就要求研发团队在引入VLA时,投入等量甚至更多资源用于构建严密的仿真验证、场景回放和闭环安全测试。

软硬件协同设计更是不可或缺。VLA的计算量与推理特性决定了它的部署方式,是完全云端的辅助推理、边缘加速的半实时部署,还是仅用于离线训练与线上稀疏调用,每种选择对应不同的延迟与安全权衡。对于以摄像头为主的车辆,可以把VLA的推理任务划分成“长期/慢速决策”和“短期/快速策略提示”两类,把高频控制留给车端的专用控制器,同时把VLA的高阶输出作为约束或建议融入规划器。这样既能利用VLA的通用性,也能满足车规级的可靠性需求。

总结

未来VLA会如何应用于自动驾驶?短期内,VLA在自动驾驶领域最现实的作用是成为“认知与策略的增强模块”,它能把语义理解、长尾场景归纳和跨场景迁移做得更好,帮助纯视觉系统在语义判断和策略生成层面成熟。中期看,随着数据量的积累、模型推理效率的提升以及可解释性技术(如可控性约束、可证明安全退避)的进步,VLA有希望承担更多高层决策任务,成为自动驾驶堆栈中不可或缺的一环。长期则是对“具身智能”的更宏大愿景,把车辆看成具备长期记忆、世界模型和自然语言交互能力的智能体,VLA这样的范式会是基础设施之一,开源项目(如OpenVLA)和商业尝试(RT-2、Helix、NVIDIA与车企的研究)都在证明这一点。

总结一下,VLA并不是单纯替代纯视觉系统的“捷径”,而是一套强有力的工具和训练范式。它能把语言作为桥梁,把视觉表示提升到语义级别,能带来更好的跨场景泛化和更强的策略学习能力,这对纯视觉算法的成熟有明确的正向作用。对行业来说,当前值得投入的方向包括如何高效利用VLM预训练特征、如何用语言信号做强化/模仿学习的桥接、如何在仿真与现实之间缩小差距、以及如何设计可验证的退避与冗余机制。只要把这些问题弄扎实,VLA对纯视觉系统的成熟将是真正有价值的推动力。

审核编辑 黄宇

-

Vla

+关注

关注

0文章

22浏览量

5915 -

自动驾驶

+关注

关注

794文章

14985浏览量

181464

发布评论请先 登录

为啥有人认为自动驾驶纯视觉方案比激光雷达方案好?

为什么光照对纯视觉自动驾驶影响较大?

已有VLM,自动驾驶为什么还要探索VLA?

VLA与世界模型有什么不同?

纯视觉自动驾驶会像人眼一样“近视”吗?

没有地图,纯视觉自动驾驶就只能摸瞎吗?

VLA能解决自动驾驶中的哪些问题?

VLA和世界模型,谁才是自动驾驶的最优解?

VLA模型能帮助纯视觉自动驾驶走向成熟吗?

VLA模型能帮助纯视觉自动驾驶走向成熟吗?

评论