●●●

PART. 01

产品简介

Module LLM Kit 是一款专注于离线 AI 推理与数据通信接口应用的智能模块套件,整合了 Module LLM 与 Module13.2 LLM Mate 模块,满足多场景下的离线 AI 推理与数据交互需求。Module LLM 是一款集成化的离线大语言模型 (LLM) 推理模块,专为需要高效、智能交互的终端设备设计。Module13.2 LLM Mate 模块通过 M5BUS 接口与 Module LLM 实现堆叠供电,并提供Type-C,RJ45,FPC-8P 等多种接口功能,便于系统集成和扩展。

PART. 02

产品特性

◎ 高算力,低能耗

Module LLM Kit 采用 爱芯AX630C SoC 先进处理器,内置 3.2 TOPs 高能效 NPU,支持 Transformer 模型推理,轻松应对复杂 AI 任务。模块搭载 4GB LPDDR4 内存(其中 1GB 供用户使用,3GB 专用于硬件加速)及 32GB eMMC 存储,支持多模型并行加载与串联推理,满足多任务处理需求。模块运行功耗仅 1.5W,远低于同类产品,节能高效,适合长期稳定运行。

◎便捷语音与数据交互

集成麦克风、扬声器、TF 存储卡、USB OTG 及 RGB 状态灯,满足多样化应用需求,轻松实现语音交互与数据传输。

◎ 灵活拓展

板载 SD 卡槽支持固件冷/热升级,UART 通信接口简化连接与调试,确保模块功能持续优化与扩展。USB 口支持主从自动切换,既可以做调试口,也可以外接更多 USB 设备如摄像头。

◎多模型兼容

出厂预装 Qwen2.5-0.5B 大语言模型,内置 KWS(唤醒词)、ASR(语音识别)、LLM(大语言模型)及 TTS(文本生成语音)功能,且支持 apt 快速更新软件和模型包。安装 openai-api 插件后,即可兼容 OpenAI 标准 API,支持聊天、对话补全、语音转文字和文字转语音等多种应用模式。官方 apt 仓库提供丰富的大模型资源,包括 deepseek-r1-distill-qwen-1.5b、InternVL2_5-1B-MPO、Llama-3.2-1B、Qwen2.5-0.5B 以及 Qwen2.5-1.5B,同时还涵盖文本转语音模型(whisper-tiny、whisper-base、melotts)和视觉模型(如 yolo11 等 SOTA 模型)。仓库将持续更新,以支持最前沿的模型应用,满足各种复杂 AI 任务。

◎ 即插即用,快速集成

搭配 M5 主机,无需繁琐设置,即可将其集成到现有智能设备中,快速实现 AI 交互体验。

PART. 03

应用场景

◎ 离线语音助手

◎ 文本语音转换

◎ 智能家居控制

◎ 互动机器人

-

Module

+关注

关注

0文章

76浏览量

13581 -

语言模型

+关注

关注

0文章

573浏览量

11341 -

LLM

+关注

关注

1文章

350浏览量

1394

发布评论请先 登录

新品 | LLM-8850 Kit,高性能AI加速卡套件 DinMeter v1.1,1/32DIN标准嵌入式开发板

LLM推理模型是如何推理的?

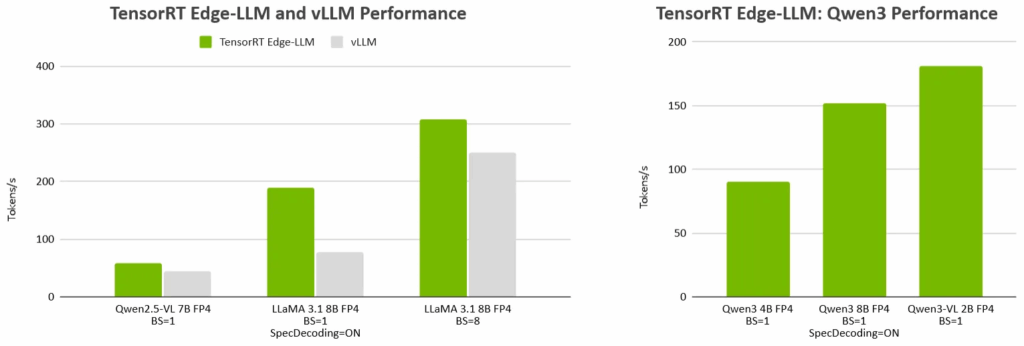

NVIDIA TensorRT Edge-LLM在汽车与机器人行业的落地应用

新品 | Module ASR,AI智能离线语音模块

NVIDIA TensorRT LLM 1.0推理框架正式上线

广和通发布端侧情感对话大模型FiboEmo-LLM

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

3万字长文!深度解析大语言模型LLM原理

基于米尔瑞芯微RK3576开发板的Qwen2-VL-3B模型NPU多模态部署评测

如何在魔搭社区使用TensorRT-LLM加速优化Qwen3系列模型推理部署

大模型推理显存和计算量估计方法研究

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

新品 | Module LLM Kit,离线大语言模型推理模块套装

新品 | Module LLM Kit,离线大语言模型推理模块套装

评论