DeepSeek开源模型的热度席卷全球,其高效性和易用性正在成为推动AI技术普惠化的重要力量。后摩智能作为国产存算一体AI芯片的领军企业,自研的后摩漫界M30芯片成功适配DeepSeek-R1-Distill-Qwen系列模型,包括1.5B、7B、14B等。这一成果不仅证明了存算一体芯片架构在大模型高效部署中的显著优势,也为端边大模型的广泛应用提供了强大的技术支撑。

DeepSeek-R1-Distill-Qwen-7B模型在M30上运行

性能数据:

· 上下文长度:8K

· 首字速度:<1s

· Decode速度:17 tokens/s

后摩智能的M30芯片专为端边部署大模型而设计,其低功耗的核心优势使其在端边应用场景中表现出色,M30芯片具备强大的物理算力,达到100~256 TOPS@INT8,同时典型功耗仅为12~35W,能够在保持高性能的同时显著降低能耗。此次适配DeepSeek-R1-Distill-Qwen系列模型的成功,进一步验证了M30芯片在处理复杂AI任务时的高效性和稳定性。随着AI技术向端侧和边缘侧的快速转移,后摩智能的存算一体技术的突破为国产AI芯片在端边大模型领域的应用树立了新的标杆,也为未来更多创新应用的落地奠定了坚实基础。

为了更好地推动端边大模型的广泛应用,后摩智能推出了基于M30芯片打造的系列产品——力谋SM30计算模组、力谋LM30智能加速卡、力谋BX30 计算盒子,以满足不同场景下的多样化需求。

力谋SM30计算模组

以力谋SM30计算模组为例,这是一款是基于M30芯片打造的智算模组(SoM),支持PCIe EP模式。该模组以其小巧的体积、强劲的性能和极低的功耗,成为小型化设备和功耗敏感嵌入式场景的理想选择。力谋SM30计算模组的物理算力为50/100 TOPS@INT8,典型功耗低于23W,支持8路FHD的编解码,并兼容PCIe 4.0接口。其低功耗和高性能的特点使其能够在资源受限的环境中高效运行,为边缘计算和端侧设备提供了强大的算力支持。

DeepSeek开源模型以其高效的推理能力和较低的部署成本,正在推动AI技术的普惠化。后摩智能自研的存算一体架构,突破了传统冯·诺依曼架构的瓶颈,将存储与计算紧密结合,大幅减少了数据传输延迟,呈现出大算力、低功耗的独特优势,显著提升了模型运行效率。通过后摩智能存算一体芯片与DeepSeek模型的架构级协同,不仅验证了国产技术栈的完整竞争力,更创造了AI普惠化的中国范式——让每瓦特算力都能承载最前沿的智能。

全球AI大模型赛道进入战略窗口期,DeepSeek通过模型创新构建轻量化智能基座,后摩智能的存算一体芯片则以物理级能效突破重构计算边界。这种从底层芯片到顶层模型的颠覆式创新,必将催生大模型落地新定律,期待国产技术组合能够“改写天命”,开辟出超越摩尔定律的进化路径。

-

AI

+关注

关注

91文章

42206浏览量

303202 -

后摩智能

+关注

关注

0文章

63浏览量

1792 -

DeepSeek

+关注

关注

2文章

862浏览量

3491

原文标题:开源破局 x 低功耗守护 : Deepseek与存算一体如何演绎AI界的"哪吒闹海"?

文章出处:【微信号:后摩智能,微信公众号:后摩智能】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

百度腾讯抢滩布局!DeepSeek-R1升级和开源背后,国产AI的逆袭之路

开放原子AtomGit平台首发适配DeepSeek-V4系列模型

后摩智能M50芯片成功部署OpenClaw

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

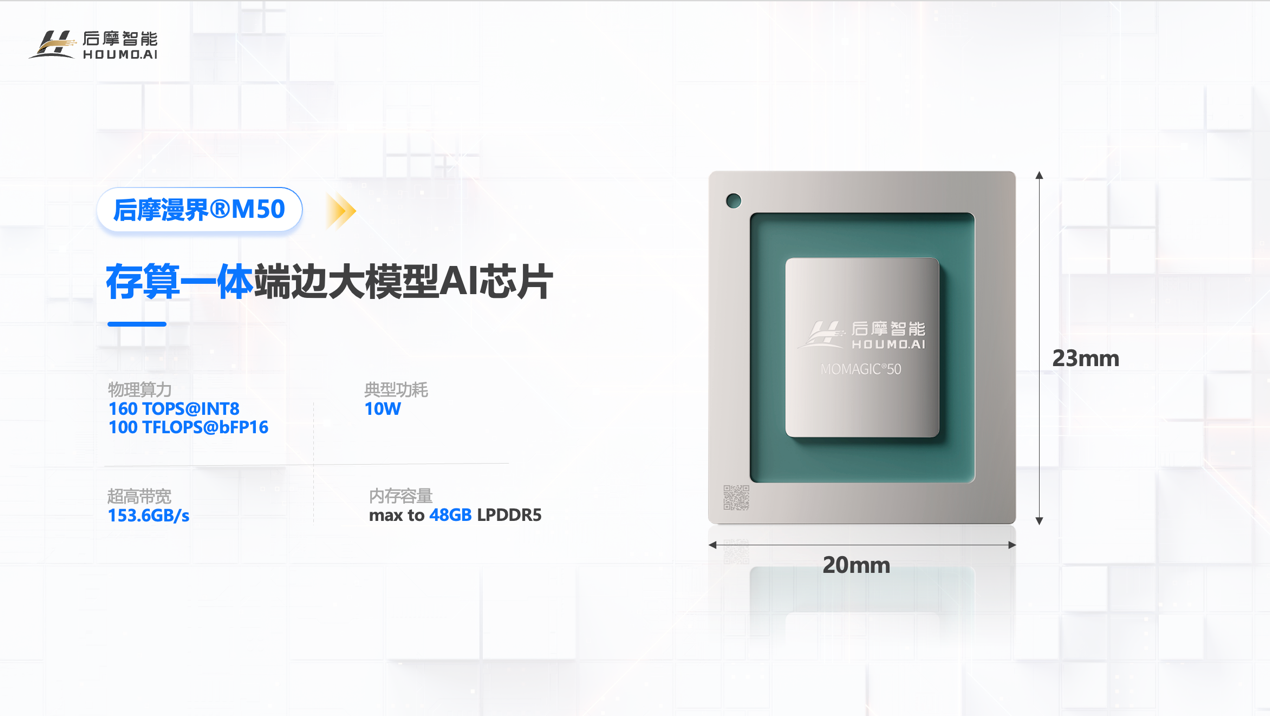

存算一体技术加持!后摩智能 160TOPS 端边大模型AI芯片正式发布

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】--全书概览

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

NVIDIA Blackwell GPU优化DeepSeek-R1性能 打破DeepSeek-R1在最小延迟场景中的性能纪录

后摩漫界M30芯片成功适配DeepSeek-R1系列模型

后摩漫界M30芯片成功适配DeepSeek-R1系列模型

评论