据了解,小米此前并未“官宣”直接加入AI大模型赛道中,但是目前小米的AI大模型 MiLM-6B已经悄然现身C-Eval、CMMLU 大模型评测榜单。并且小米大模型在 C-Eval总榜单排名第 10,同参数量级排名第1。

而从GitHub 项目给出的信息得知,MiLM-6B是由小米公司开发的一个大规模预训练语言模型,参数规模达64 亿。

MiLM-6B模型在具体各科目成绩上,在STEM(科学、技术、工程和数学教育)全部20个科目中,计量师、物理、化学、生物等多个项目获得了较高的准确率。

MiLM-6B 模型目前已经在大多数文科科目中表现出了相对良好的准确度,不过在“法学、数学、编程、概率论、离散数学”等涉及“抽象思维”的科目中,还有一定进步空间wprbsubsqkd。

并且在10个“社会科学”测试科目中,除“教育学和地理”外,该模型在其他8个科目中都获得了较为理想的准确率。

不仅如此,该模型在人文科学的11个科目中的“历史与法律”基础上有着不错的准确率表现。

以上源自互联网,版权归原作所有

审核编辑 黄宇

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

AI

+关注

关注

91文章

41141浏览量

302608 -

小米

+关注

关注

70文章

14547浏览量

152601 -

大模型

+关注

关注

2文章

3772浏览量

5273

发布评论请先 登录

相关推荐

热点推荐

壁仞科技光速支持阿里Qwen3.6-35B-A3B大模型

4月16日晚,阿里巴巴通义实验室正式宣布全量开源Qwen3.6-35B-A3B大模型。该模型为混合专家(MoE)模型,总参数量为350

【瑞萨AI挑战赛】手写数字识别模型在RA8P1 Titan Board上的部署

手写数字识别模型在RA8P1 Titan Board上的部署

手写数字识别是计算机视觉领域的经典入门任务,而瑞萨RA8P1 Titan Board开发板凭借其搭载的双内核架构与专用NP

发表于 03-15 20:42

如何在NVIDIA Jetson AGX Thor上部署1200亿参数大模型

我们将尝试能否在 Jetson AGX Thor 上部署并成功运行高达 1,200 亿参数量的 gpt-oss-120b 大

轻量级参数的管理框架(C语言)

64bit的参数类型

COT_PARAM_NAME_MAX_LENGTH参数名字最大定义长度,小于或等于1则禁用参数名功能

COT_PARA

发表于 12-16 06:24

浅谈SPICE模型参数自动化提取

在过去的几十年里,半导体器件紧凑型模型已经从 BJT Gummel-Poon 模型中的几个参数发展到 MOSFET BSIM 模型中的数百个参数

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

(LLM Core)

模型选择:搭载 qwen2.5-vl-3b-w4a16_level1_rk3576.rkllm 模型,采用 W4A16 量化方案(本文)。

模型规模:

发表于 09-05 17:25

华为宣布开源盘古7B稠密和72B混合专家模型

电子发烧友网综合报道 2025年6月30日,华为正式宣布开源盘古70亿参数的稠密模型、盘古Pro MoE 720亿

大模型推理显存和计算量估计方法研究

、显存估计方法

基于模型结构的显存估计

根据深度学习模型的层次结构和参数数量,可以估算模型在推理过程中所需的显存大小。具体方法如下:

(

发表于 07-03 19:43

华为正式开源盘古7B稠密和72B混合专家模型

[中国,深圳,2025年6月30日] 今日,华为正式宣布开源盘古70亿参数的稠密模型、盘古Pro MoE 720亿

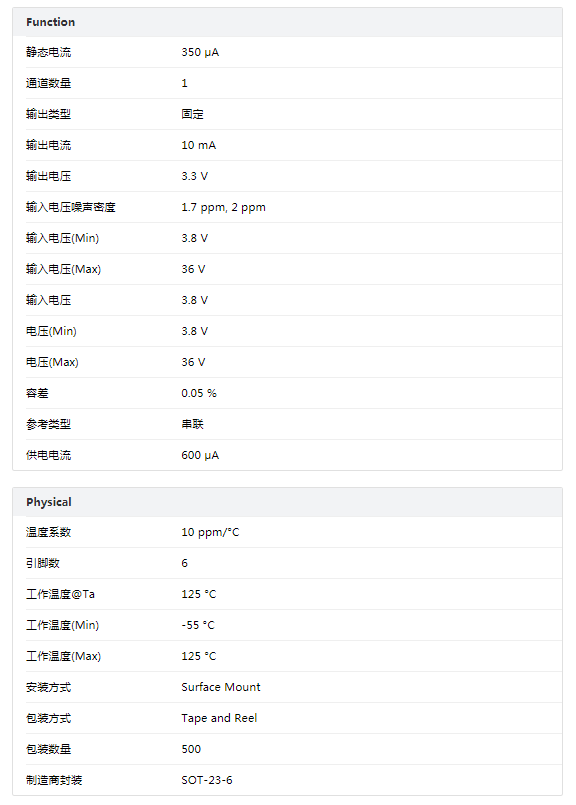

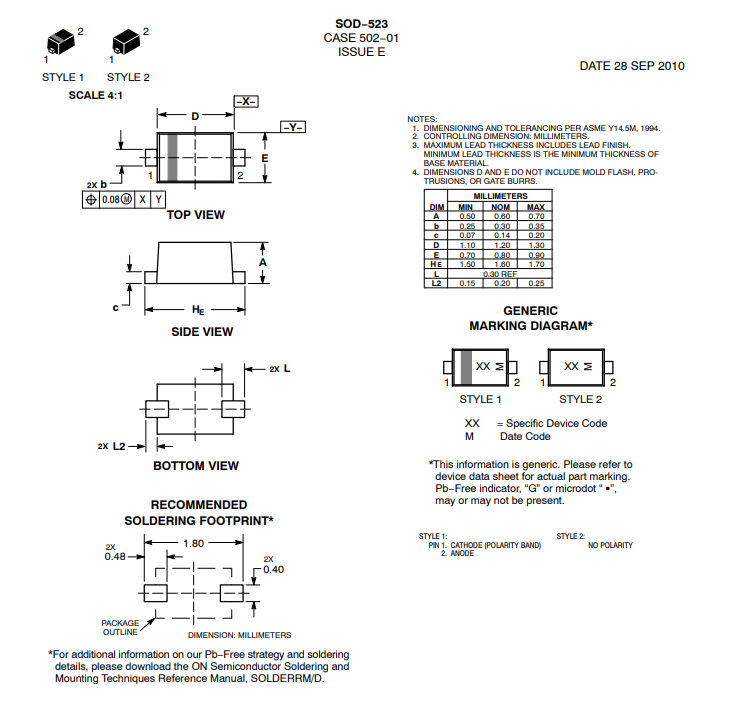

Analog Devices LT6654 AMPS6-3.3器件参数特性解读 EDA模型 数据手册免费下载

Analog Devices LT6654AMPS6-3.3器件参数特性解读 EDA模型 数据手册免费下载

NVIDIA使用Qwen3系列模型的最佳实践

阿里巴巴近期发布了其开源的混合推理大语言模型 (LLM) 通义千问 Qwen3,此次 Qwen3 开源模型系列包含两款混合专家模型 (MoE),235B-A22B(总

小米大模型MiLM-6B具有64亿参数,在同参数量级排名第1

小米大模型MiLM-6B具有64亿参数,在同参数量级排名第1

评论