0. 简介

视觉里程计最近几年越来越受到学术界以及工业界的认可,以ORB和VINS为代表的视觉SLAM已经可以满足绝大多数场景,而OV2SLAM在其他VSLAM中脱颖而出,其实时性以及具体的回环性能在测试中都得到了认可。

1.OV2SLAM与ORB-SLAM2的对比

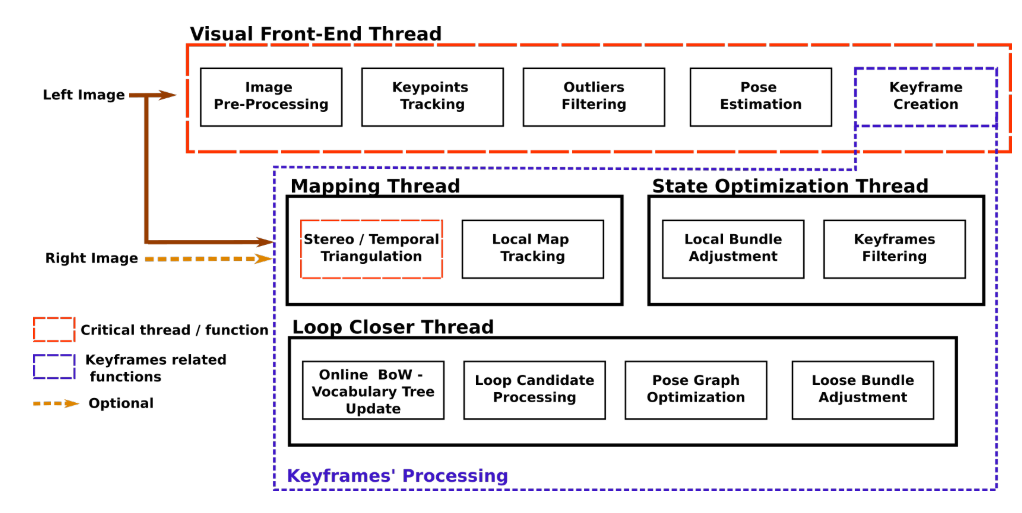

下图为OV2SLAM的示意图

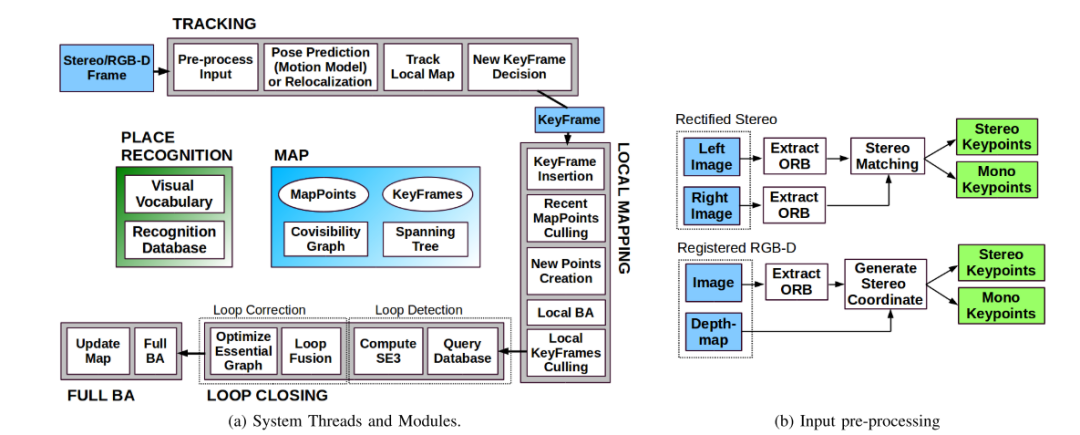

下图为ORB-SLAM2示意图

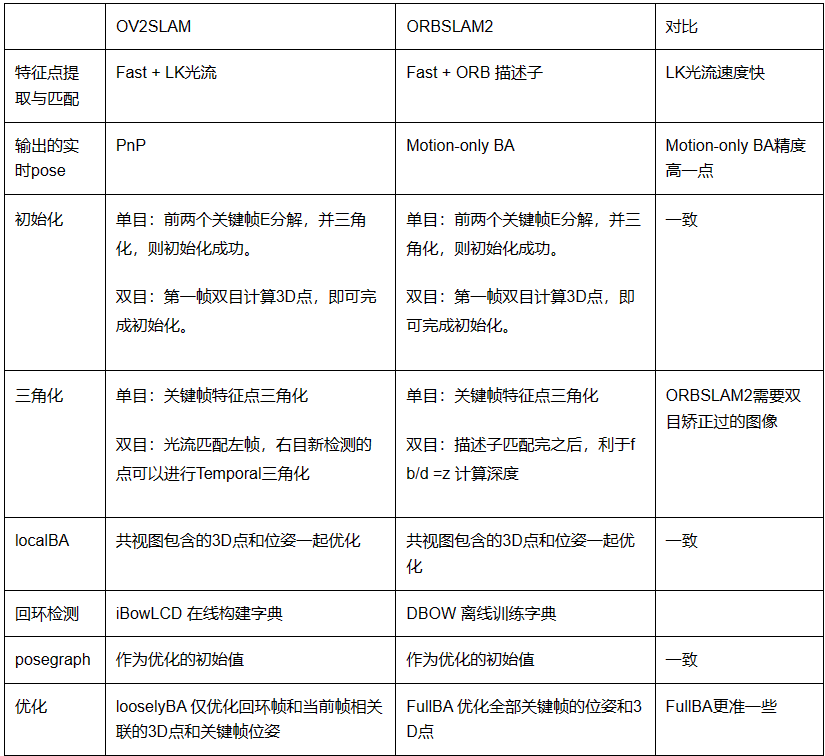

下面是两个算法的对比

我们从上表中可以看到相比于ORB-SLAM2而言,OV2SLAM有以下四个主要的区别点

1.放弃了ORB算子,采用了LK光流来代替。这样可以大大的节省前端特征点提取的时间

2.在输出实时pose的时候,ORBSLAM2精度比OV2SLAM高,相比于ORBSLAM2使用TrackLocalMap来进行motion-only的BA而言,OV2SLAM输出的实时pose是通过PnP计算出来的。虽然OV2SLAM也有TrackLocalMap,但是他这一步仅进行特征点的re-track, 没有进行位姿计算。

3.在回环检测部分ORBSLAM2使用的是DBOW 离线训练字典,而OV2SLAM使用的是iBowLCD 在线构建字典,这就导致OV2SLAM可以适应更多的场景

4.最后也是最关键的就是全局位姿输出,ORBSLAM2使用的是FullBA 优化来优化全部关键帧的位姿和3D点,而OV2SLAM使用的是looselyBA,这个优化方式仅优化当前帧和回环帧关联的信息。所以使用FullBA 可以影响到包括losselyBA以及其余关键帧的pose和3D点。

2 视觉前端

这部分内容其实都大同小异,值得一提的是:

图像预处理(image pre-processing )关键点追踪(keypoint tracking)离群值滤波(outlier filtering)位姿估计(pose estimation)触发条件,创建关键帧(keyframe creation triggering)

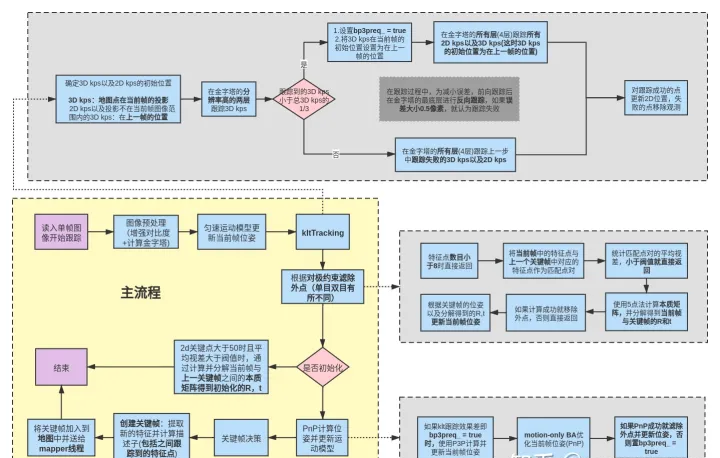

下面我们来简述一下具体流程:

1.图像预处理:通过CLAHE进行对比度增强,这既增加了动态范围,又限制了曝光适应引起的强度变化。

2.关键点追踪:关键点跟踪是通过引导的从粗到精的光流法来执行的。使用具有9×9像素窗口和金字塔比例因子为2的反向组合Lucas-Kanade(LK)算法[12]的金字塔实现来单独跟踪关键点。

这里提到2D点和3D点这两种,对于3D关键点(即已经三角化的3D关键点),会先使用匀速运动模型估计当前帧的初始位姿,然后将3D keyoints对应的3D点投影到当前帧,作为该3D keypoints在当前帧的初始位置。

对于2D关键点-即那些没有关于其真实3D位置的先验信息的关键点,会将其在当前帧的初始位置设置为在上一帧中的位置

3.离群值滤波:采用基于核线约束的RANSAC滤波,使用3D关键点估计基础矩阵(Essential Matrix)然后用它来过滤不一致的2D关键点。

4.位姿估计:使用稳健的Huber成本函数最小化3D关键点重投影误差来执行姿态估计,也就是我们上文提到的PnP计算位姿并更新运动模型

5.创建关键帧:跟踪的3D关键点的数量w.r.t.。最后一个关键帧低于阈值(跟踪的关键点少于85%),或者如果检测到明显的视差(平均15个像素的未旋转关键点运动),则会创建新的关键帧。

值得一提的是OV2SLAM将每张图像分为nbwcells*nbhcells个网格,是基于网格的特征提取。每一帧的更新也是只保留了一个指向当前帧的指针pcurframe,用于实时记录当前帧跟踪到的2D、3D特征点以及位姿信息。

接受到新图像时只更新时间戳和帧号,在光流跟踪以及计算位姿后分别更新当前帧的特征点、位姿信息并更新运动模型。

3. 建图线程

主要处理两个任务,负责三角化以及局部地图的跟踪,在双目的配置情况下会增加立体匹配的功能。

3.1 三角化

mapping中的三角化是整个系统中唯一生成3D点的地方,包括初始化成功后的生成初始地图。三角化的主要功能是在当前关键帧与共视关键帧之间产生新的地图点,使得跟踪更稳。

具体过程为:对于当前关键帧中的每一个2D特征点,将当前2D点与第一次观测到该2D点的关键帧中的对应2D点进行三角化。相比ORB-SLAM中将当前关键帧与其共视程度最高的20帧至少有15个共视点的相邻关键帧通过词袋进行特征匹配,再将成功匹配的点对进行三角化的策略,二者的效果有待进一步实验对比。

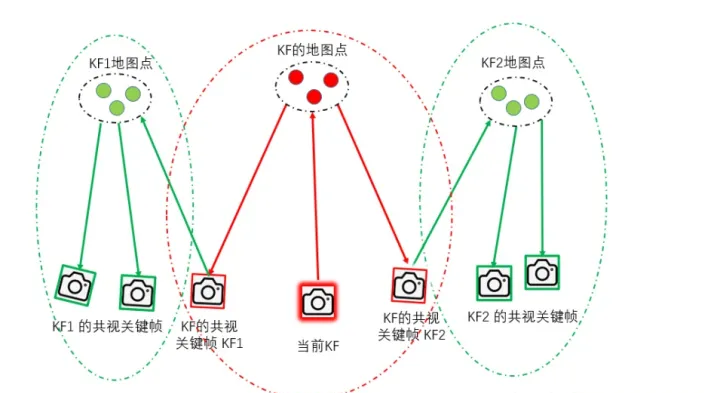

下图为ORB-SLAM的LocalMapping中的三角化搜索范围。这个操作和ORB-SLAM2类似

3.2 暂时三角化

通常用于单目初始化3D地图,本文发现在双目情况下可以用于在当前关键帧之前,已经正确追踪到,但找不到双目匹配的关键点。这时所有成功三角化的地图点立刻应用于前端进行定位,然后这些3D位置通过BA进行重新优化。

3.3 局部地图追踪

类似于ORB-SLAM2局部地图,局部地图包括当前关键帧或共视图关键帧观察到的3D地图点。

局部地图追踪的目标是找出属于局部地图的3D地图点是否可以与当前帧的关键点相匹配。这种重追踪的操作可以看做是基本的回环检测。

任意这样的3D地图点,在当前关键帧的投影与一个关键点的距离少于两个像素点时被定义为候选匹配。计算3D地图点和其他几个候选点的距离,接受最近距离的候选。

4. 状态估计线程

使用局部BA来精炼已选择的关键帧位姿和3D地图点位置,此外过滤冗余的关键帧来限制外来局部BA的运行时间。

4.1 局部地图的优化

这里的优化与ORB-SLAM相近,优化当前关键帧和与其至少有25个共视点的相邻关键帧的位姿以及这些关键帧对应的地图点的3D坐标,对于那些不在这些关键帧范围内,但是可以观测到这些地图点的关键帧,也将观测添加到BA中但是不对这些关键帧的位姿进行优化。

4.2 关键帧过滤

删去关键帧的标准为:该关键帧观测到的95%3D点已经被至少其他4个关键帧观测到

5. 在线词袋回环检测器

回环检测主要负责检测回环和重定位,即校正当前姿势估计和当前帧与已检测到LC的已传递关键帧之间的估计轨迹。这是一个重要的创新点。主要流程主要分为关键帧预处理、使用iBoW-LCD算法检测候选关键帧、验证候选关键帧、位姿图优化以及looseBA。

5.1 关键帧预处理以及选取候选关键帧

作者在论文中提到,出于定位的考虑,OV2SLAM并不会跟踪太多的特征点(大概只有200多)。在这里为了更新词袋树,对每幅图像额外提取300个FAST特征并计算其描述子,然后将此关键帧传给iBoW-LCD用于更新词袋树,当关键帧数量大于100帧时,在词袋树中查找当前关键帧的闭环候选关键帧。

5.2 验证候选关键帧

发现一个好的LC候选,首先确定不是一个假阳性。对当前关键帧Ki和候选关键帧Klc,首先应用一个k最近邻暴力匹配算法在这两个关键帧的描述子中。

而不明确的匹配首先由经典的ratio test进行过滤。然后使用RANSAC方法进行计算基础矩阵Essential Matrix 以便只保持满足极线几何(对极几何)的匹配。

使用这种内在维持方法,我们使用P3P-RANSAC方法用回环候选关键帧Klc观测到的剩余3D地图点对当前关键帧Ki进行一个假设位姿计算。

若计算出一个可靠位姿,由大量内参器(inliers)确定,我们得到候选关键帧Klc的局部地图,然后搜索在当前关键帧Ki的额外的匹配,将3D地图点的投影使用P3P的方法计算位姿。

然后,使用等式(1)基于到目前为止发现的所有匹配来精炼假设位姿,并且基于由Huber鲁棒成本函数检测到的离群值来执行最后的过滤步骤。

5.3 位姿图优化

最终如果保留30个内点,我们验证回环检测,并执行位姿图优化(PGO)来矫正完整轨迹。

目的是将误差均摊到检测到的关键帧与当前关键帧之间的所有关键帧之间。

5.4 looseBA

与ORB-SLAM中的fullBA相比,OV2SLAM只对受闭环检测影响的关键帧以及地图点进行优化,这样减轻了BA的负担,但是仍然要花费数秒的时间

6. OV2SLAM总结

OV2SLAM整体精度比ORBSLAM2略微下降,但是速度明显提升。通过PnP、looselyBA 等方法能够快速的构建出我们想要的地图。对于OV2SLAM而言相较于ORBSLAM2增加了异常点剔除、估算位姿准确性等操作。

当然对于ORB-SLAM3来说除了会判断远点和近点,远点只用于优化旋转,尺度信息只能依靠近点以外,还是用了极大后验概率(MAP)估计应用于利用几何BA(光束平差法)最小化特征重投影误差中。并将历史数据一起加入约束中一起计算BA。

除此以外,ORB-SLAM3中还提出新的位置识别算法,现在当前候选关键帧进行几何一致性检测,然后检测候选关键帧与三个共视关键帧的局部一致性,以计算成本为代价换来高召回率。

除此以外相较于这两篇文章,ORB-SLAM3还提出了 ORB-SLAM Atlas,该地图集提供了ORB-SLAM3的多地图SLAM特性,ORB-SLAM地图集中存有一系列非活动的地图,并且这些地图可以进行位置识别、相机重定位、回环检测以及精准的无缝地图拼接。

7. OV2SLAM 安装

安装 OpenGV

git clone https://github.com/laurentkneip/opengv cd opengv mkdir build cd build/ cmake .. sudo make -j4 install

安装OV2SLAM

xxxxxxxxxx cd ~/catkin_ws/src/ git clone https://github.com/ov2slam/ov2slam.git cd ~/catkin_ws/src/ov2slam chmod +x build_thirdparty.sh ./build_thirdparty.sh cd ~/catkin_ws/src catkin_make --pkg ov2slam

运行 OV2SLAM

xxxxxxxxxx rosrun ov2slam ov2slam_node /home/crp/catkin_ws/src/ov2slam/parameters_files/accurate/euroc/euroc_mono.yaml cd ~/catkin_ws/src/ov2slam rviz -d ov2slam_visualization.rviz rosbag play MH_04_difficult.bag

审核编辑:刘清

-

lcd

+关注

关注

36文章

4630浏览量

177937 -

SLAM

+关注

关注

24文章

459浏览量

33414 -

RANSAC

+关注

关注

0文章

10浏览量

8087 -

orb

+关注

关注

0文章

21浏览量

10210

原文标题:经典文献阅读之—OV2SLAM(高速视觉slam)

文章出处:【微信号:3D视觉工坊,微信公众号:3D视觉工坊】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

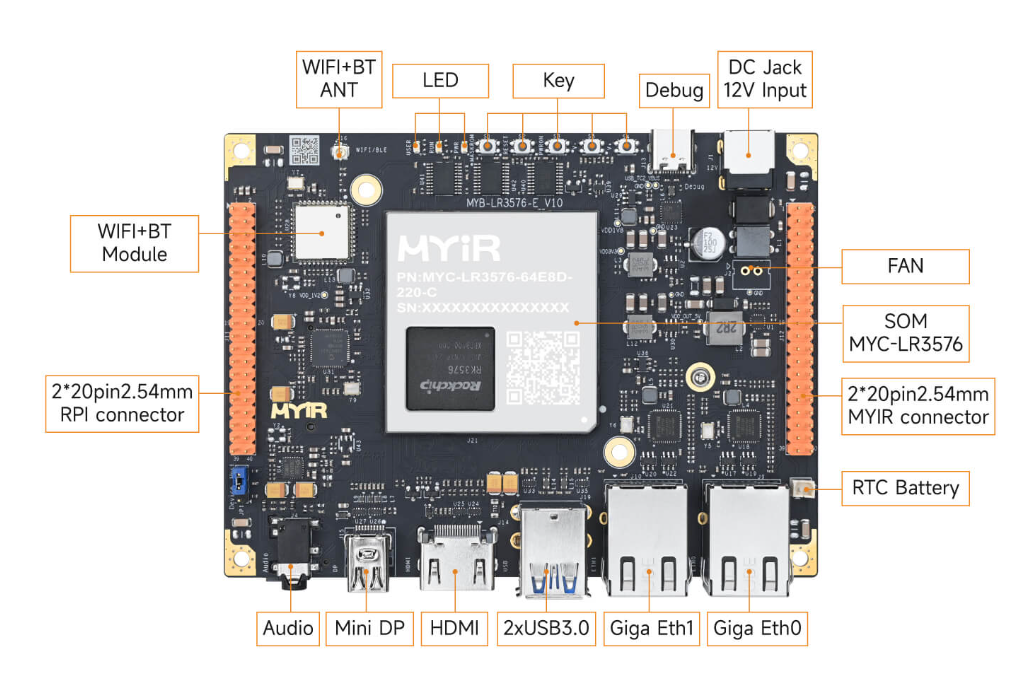

ROS2 SLAM建图与导航实战--基于米尔RK3576开发板

RK3576 + ROS2 SLAM建图与导航实战

SLAM如何为自动驾驶提供空间感知能力?

什么是激光雷达 3D SLAM技术?

FPGA和GPU加速的视觉SLAM系统中特征检测器研究

自动驾驶中如何将稀疏地图与视觉SLAM相结合?

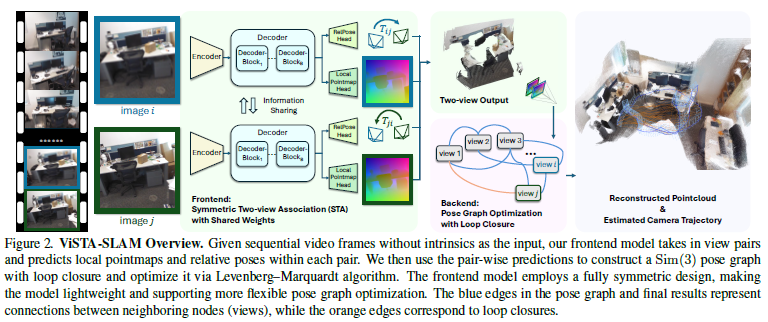

全新轻量级ViSTA-SLAM系统介绍

一种适用于动态环境的自适应先验场景-对象SLAM框架

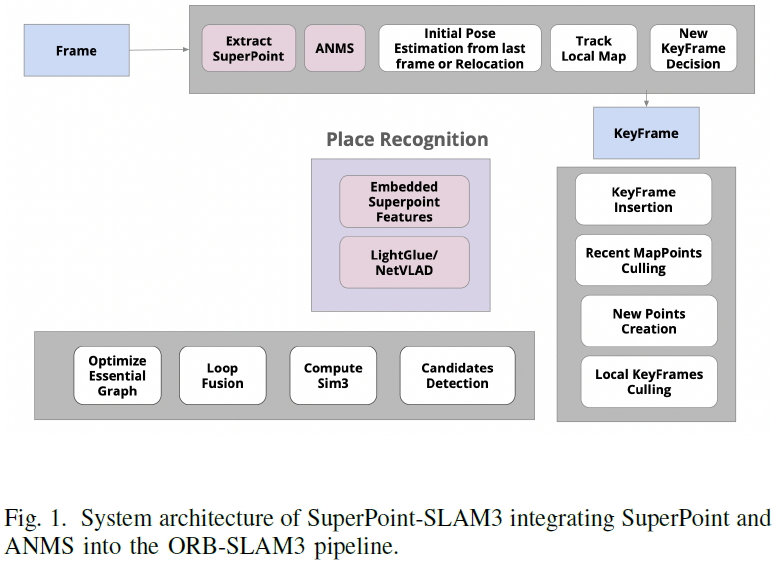

基于深度学习的增强版ORB-SLAM3详解

简析Modbus与MQTT的区别

一种适用于动态环境的实时RGB-D SLAM系统

三维高斯泼溅大规模视觉SLAM系统解析

OV2SLAM(高速视觉slam)简析

OV2SLAM(高速视觉slam)简析

评论