由于模型越来越大,训练过程中硬件的优化变得尤为重要。从2019年下半年开始,各家分别开发出大规模并行训练、模型扩展技术,以期开发出更大的NLP模型。英伟达Megatron-LM、谷歌T5、微软Turing-NLG相继出现。

2020年6月OpenAI在发布了GPT-3,这是当时训练的最大模型,具有1750亿个参数。近段时间,浪潮、英伟达与微软相继发布2500亿参数、5300亿参数的巨量模型,超过GPT-3。

中国工程院院士王恩东认为,人工智能的大模型时代已经到来,利用先进算法,整合大规模数据,汇聚大量算力,训练出巨量人工智能模型是未来的发展方向……

英伟达与微软联合发布了5300亿参数的“威震天-图灵”

上周,英伟达与微软联合发布了5300亿参数的“威震天-图灵”自然语言生成模型(Megatron-TuringNLG)。据介绍,这样的量级不仅让它成为全球规模最大,同时也是性能最强的NLP模型。

训练过程一共使用了4480块英伟达A100 GPU,最终使该模型在一系列自然语言任务中——包括文本预测、阅读理解、常识推理、自然语言推理、词义消歧——都获得了前所未有的准确率。

此模型简称MT-NLG,是微软Turing NLG和英伟达Megatron-LM两者的“继任者”。Turing NLG由微软于2020年2月推出,参数为170亿;Megatron-LM来自英伟达,2019年8月推出,参数83亿。它俩在当时分别是第一、二大规模的Transfomer架构模型。

我们都知道大参数规模的语言模型效果会更好,但训练起来也很有挑战性,比如:即使是最大容量的GPU,也存不下如此规模的参数;如果不特别注意优化算法、软件和硬件堆栈,那么所需的大量计算操作可能会导致训练时间过长。

那这个参数已是GPT-3三倍的MT-NLG又是如何解决的呢?答案就是汲取“两家”所长,融合英伟达最先进的GPU加速训练设备,以及微软最先进的分布式学习系统,来提高训练速度。并用上千亿个token构建语料库,共同开发训练方法来优化效率和稳定性。

具体来说,通过借鉴英伟达Megatron-LM模型的GPU并行处理,以及微软开源的分布式训练框架DeepSpeed,创建3D并行系统。对于本文中这个5300亿个参数的模型,每个模型副本跨越280个NVIDIA A100 GPU,节点内采用Megatron-LM的8路张量切片(tensor-slicing),节点间采用35路管道并行(pipeline parallelism)。

然后再使用DeepSpeed的数据并行性进一步扩展到数千个GPU。最终在基于NVIDIA DGX SuperPOD的Selene超级计算机上完成混合精度训练。(该超级计算机由560个DGX A100服务器提供支持,每个DGX A100有8个 NVIDIA A100 80GB Tensor Core GPU,通过NVLink 和 NVSwitch相互完全连接)。

该模型使用了Transformer解码器的架构,层数、hidden dimension和attention head分别为 105、20480和128。训练所用数据集包括近20万本书的纯文本数据集Books3、问答网站Stack Exchange、维基百科、学术资源网站PubMed Abstracts、ArXiv、维基百科、GitHub等等,这些都是从他们先前搭建的Pile数据集中挑出的质量较高的子集。最终一共提取了2700亿个token。

浪潮发布2500亿参数的中文AI巨量模型“源1.0”

9月28日,浪潮人工智能研究院发布浪潮发布了2500亿参数的中文AI巨量模型“源1.0”。

“源1.0”不仅有高达5TB的全球最大中文高质量数据集,在总计算量和训练效率优化上都是空前的。源1.0几乎把近5年整个中文互联网的浩瀚内容全部读完,在收集并清洗数据后,最终获得5TB高质量数据,成为迄今业界最大的高质量中文数据集。

在语言智能方面,源1.0获得中文语言理解评测基准CLUE榜单零样本学习和小样本学习两类总榜冠军,获得小样本学习的文献分类、商品分类、文献摘要识别、名词代词关系等4项任务冠军。

“在数据量、参数规模与模型精度方面,源1.0均居全球之最。”浪潮人工智能研究院首席研究员吴韶华说。对标OpenAI的GPT-3,源1.0参数规模为2457亿,训练采用的中文数据集达5TB。相比GPT-3模型1750亿参数量和570GB训练数据集,源1.0参数规模领先40%,训练数据集规模领先近10倍。

“得益于我们设计模型时,对精度和计算性能的协同。”吴韶华说,“在算法上,我们解决了巨量模型训练不稳定的业界难题,提出稳定训练巨量模型的算法,打造了巨量模型推理方法创新;在数据方面,我们生成了迄今业界最大的高质量中文数据集;在算力上,我们通过算法与算力协同优化,极大提升了计算效率,在实现业界训练性能第一的同时,还达到了业界领先的精度。”

巨量模型是未来的发展方向

“认知智能是人工智能研究者追求的方向之一。”中国工程院院士王恩东告诉《中国科学报》,“除了加速深度学习技术,开发全新的算法范式研究方向外,大规模数据训练超大参数量的巨量模型也是未来发展方向,即利用先进的算法,整合大规模的数据,汇聚大量算力,训练出巨量人工智能模型。”

2020年6月,OpenAI发布了参数量高达1750亿的大模型GPT-3,该模型一推出就引起人工智能学界和业界的轰动。“语言模型是全球AI界的‘必争之地’。”一位人工智能研究领域的专家说,“参数规模大到远超我们想象的时候,会发生一些难以解释的现象。”

浪潮信息副总裁刘军同样认为,生命从简单进化到复杂,这种智能水平本身就是一种模型。如果把模型比作元宇宙中的生命,大模型的这种综合系统能力,可能会决定未来数字世界和智能世界里的智能水平。“人的神经元突触超过100万亿,而现有大模型的参数量还远远不够,所以我们还有很远路要走”。

伴随着人工智能应用广度与深度的不断提升,众多行业、诸多业务场景的智能化创新需求日益增多。然而当前大多数AI模型只能用于某一特定领域,通用性不强,这对AI技术提出了挑战,也限制了AI的产业化进程。

大模型在今天初露峥嵘绝非偶然。技术、算力、资源、需求等多因素的“风云际会”,让被AI业界视为“核力量”的大模型崭露头角。

电子发烧友综合报道,参考自量子位、浪潮服务器

-

微软

+关注

关注

4文章

6752浏览量

108076 -

浪潮

+关注

关注

1文章

490浏览量

25481 -

英伟达

+关注

关注

23文章

4115浏览量

99605

发布评论请先 登录

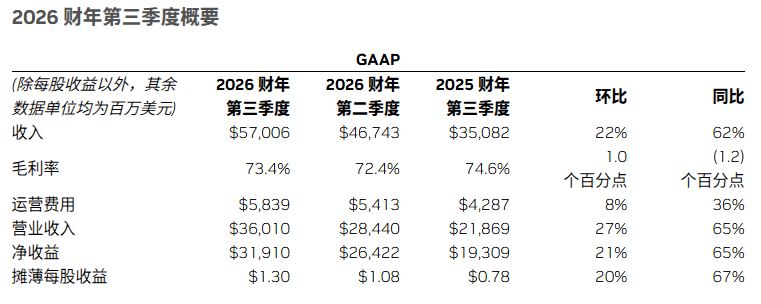

狂揽430亿净利!英伟达Q4炸裂财报:数据中心独吞90%营收

AI不是泡沫,是订单!英伟达Q3业绩超预期,数据中心营收超512亿美元

套现413亿!软银清仓英伟达,AI硬件泡沫破裂?

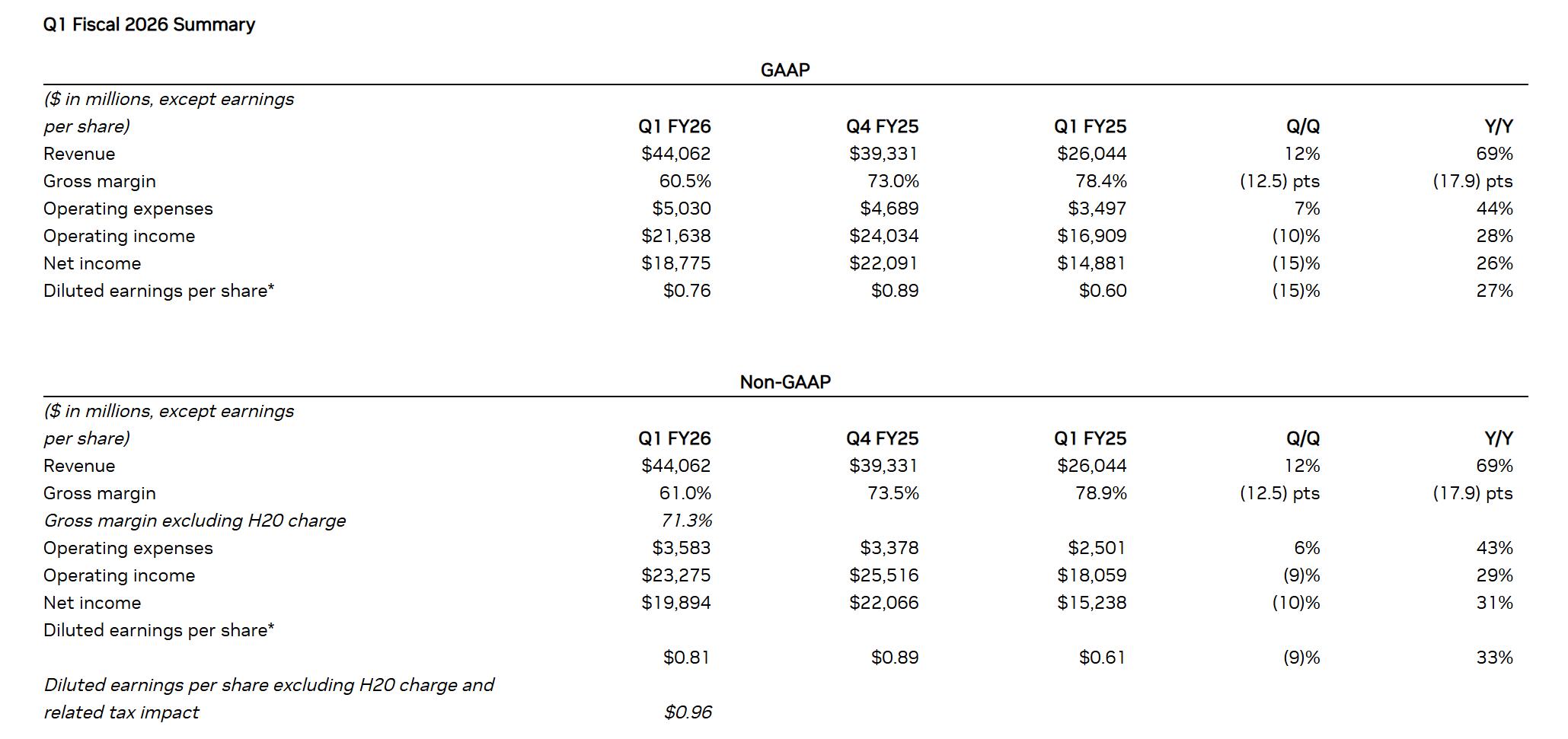

AI推理需求井喷!英伟达Q1营收大涨,H20禁售难挡增长步伐

硅光成AI胜负手?英伟达20亿美元战略投资Marvell

40亿美元!英伟达投资两家光学公司,加码AI算力生态

如何在NVIDIA Jetson AGX Thor上部署1200亿参数大模型

英伟达 Q3 狂揽 308 亿

今日看点:英伟达三季度营收达570亿美元,云 GPU 已售罄;蔚来智驾芯片被曝首次技术外供

NVIDIA新闻:英伟达10亿美元入股诺基亚 英伟达推出全新量子设备

今日看点:苹果认证中国快充品牌遭美调查;英伟达拟向OpenAI投资最高1000亿美元

英伟达斥资50亿美元入股英特尔,芯片巨头携手重塑行业格局

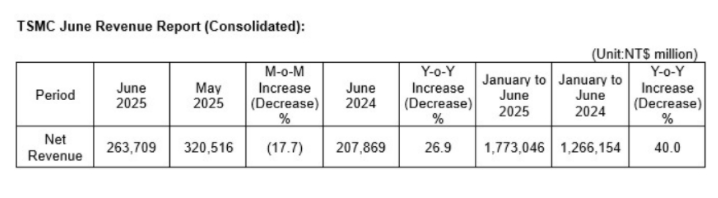

看点:台积电6月销售额2637.1亿元新台币 英伟达市值相当于日本全年GDP 微软大裁员背后:靠AI节省5亿美元

浪潮、英伟达微软相继发布2500亿、5300亿参数的巨量模型,超过GPT-3

浪潮、英伟达微软相继发布2500亿、5300亿参数的巨量模型,超过GPT-3

评论