训练先进的人工智能系统所需的巨大计算资源意味着,经验丰富的科技公司将学术团队置于尘埃中。但是一种新方法可以帮助平衡规模,使科学家可以在一台计算机上解决最先进的AI问题。

OpenAI 2018年的一份报告发现,用于训练最强大的人工智能的处理能力正以惊人的速度增长,每3.4个月翻一番。最需要数据的方法之一是深度强化学习,其中AI通过遍历数百万次仿真来通过反复试验来学习。电子游戏如《星际争霸》和《Dota2》的最新进展都依赖于装有数百个CPU和GPU的服务器。

诸如Cerebras System的Wafer Scale Engine之类的专用硬件有望用完美优化用于训练AI的单个大型芯片来取代这些机架式处理器。但是,由于价格高达数百万美元,对于资金不足的研究人员来说,这并不是什么安慰。

现在,来自南加州大学和英特尔实验室的一个团队已经发明了一种在学术实验室中常用的硬件上训练深度强化学习(reinforcement learning,RL)算法的方法。在近日举行的2020国际机器学习大会(International Conference on Machine Learning,ICML)上发表的一篇论文中,他们描述了如何能够使用一个高端工作站来训练人工智能,在第一人称射击游戏Doom上拥有最先进的表现。他们还使用一小部分正常计算能力来解决DeepMind提出的30种多样化3D挑战套件。

德州大学奥斯汀分校(University of Texas at Austin)专门研究深度RL的教授Peter Stone说:“发明对商品硬件进行深度RL的方法是一个了不起的研究目标。并且,除了将较小的研究小组抛在身后之外,进行此类研究通常所需的计算资源也会产生大量的碳足迹。”

USC研究生的主要作者Aleksei Petrenko说,该项目的灵感来自于必须成为发明之母的经典案例。随着在英特尔的暑期实习期结束,Petrenko失去了进入该公司的超级计算集群的权限,这使尚未完成的深度RL项目陷入危险之中。因此,他和同事决定找到一种方法来继续进行简单系统的工作。

使用一台配备36核CPU和一个GPU的机器,研究人员能够在接受Atari视频游戏和Doom训练时每秒处理大约14万帧图像,或者是次优方法的两倍。

Using a single machine equipped with a 36-core CPU and one GPU, the researchers were able to process roughly 140,000 frames per second while training on Atari videogames and Doom, or double the next best approach.

“根据我的经验,很多研究人员无法接触到尖端的、花哨的硬件,”Petrenko说。“我们意识到,只要重新考虑如何最大限度地提高硬件利用率,实际上就可以接近通常从大型集群中挤出的性能,即使是在单个工作站上。”

深度RL的主要方法是将AI代理置于一个模拟环境中,该环境为实现特定目标提供奖励,agent将此作为反馈来制定最佳策略。这涉及三个主要的计算工作:模拟环境和代理;根据学习到的规则(称为策略)决定下一步要做什么;以及使用这些操作的结果来更新策略。

Petrenko说,培训总是受到最慢流程的限制,但这三个工作通常在标准的深层次RL方法中交织在一起,因此很难单独优化它们。研究人员的新方法被称为“样本工厂(Sample Factory)”,将它们分开,这样就可以投入资源让它们都以峰值速度运行。

Petrenko解释说,进程之间的管道数据是另一个主要瓶颈,因为这些数据通常会分布在多台机器上。他的团队利用在一台机器上工作的优势,只需将所有数据塞进共享内存中,所有进程都可以即时访问这些数据。

与领先的深度RL方法相比,这形成了显著的加速。使用一台配备36核CPU和一个GPU的机器,研究人员能够在接受Atari视频游戏和Doom训练时每秒处理大约14万帧图像,或者是次优方法的两倍。在三维训练环境DeepMind实验室中,他们每秒的帧数为40000帧,比第二名高出15%。

为了检查帧速率是如何转化为训练时间的,研究小组将样本工厂(Sample Factory)与谷歌大脑(Google Brain)在3月份开源的一种算法进行了比较,该算法旨在显著提高深度RL的效率。研究小组还在DeepMind实验室用一台功能更强大的36核4-GPU机器,对30个挑战进行了测试。由此产生的人工智能的性能明显优于DeepMind用来应对挑战的原始人工智能,后者是在大型计算集群上训练的。

虽然论文中使用的计算机仍然是为人工智能研究而设计的高端工作站,但Petrenko说,他和他的合作者也一直在更简单的设备上使用样品工厂。他说,他甚至可以在他的中档游戏笔记本电脑上进行一些高级的深度RL实验。“这是前所未闻的。”

-

计算机

+关注

关注

19文章

7841浏览量

93464 -

AI

+关注

关注

91文章

41141浏览量

302609 -

人工智能系统

+关注

关注

0文章

39浏览量

10876

原文标题:现在可以在一台计算机上训练强大的AI啦

文章出处:【微信号:IEEE_China,微信公众号:IEEE电气电子工程师】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

计算机专业408考研科目

中兴通讯崔丽受邀出席2025腾冲科学家论坛

深圳中国首个光量子计算机制造工厂落成

科学家利用微波激光照射钻石,制造出时间准晶体

国际类脑计算科学家Yulia Sandamirskaya教授加盟时识科技

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI的科学应用

【「AI芯片:科技探索与AGI愿景」阅读体验】+可期之变:从AI硬件到AI湿件

工业计算机与商用计算机的区别有哪些

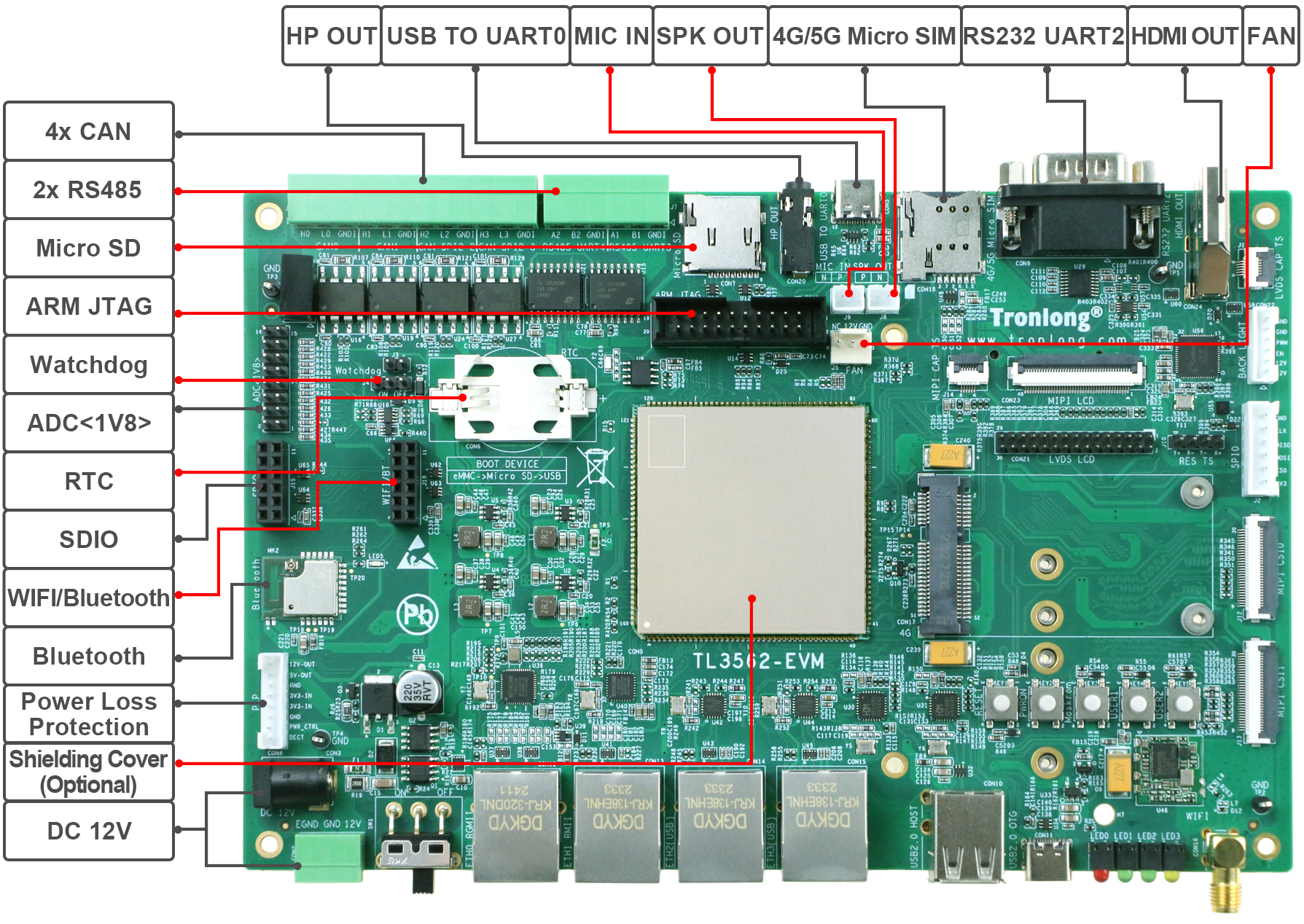

创龙 瑞芯微 RK3562 国产 2GHz 四核A53 工业开发板—Linux开发环境搭建

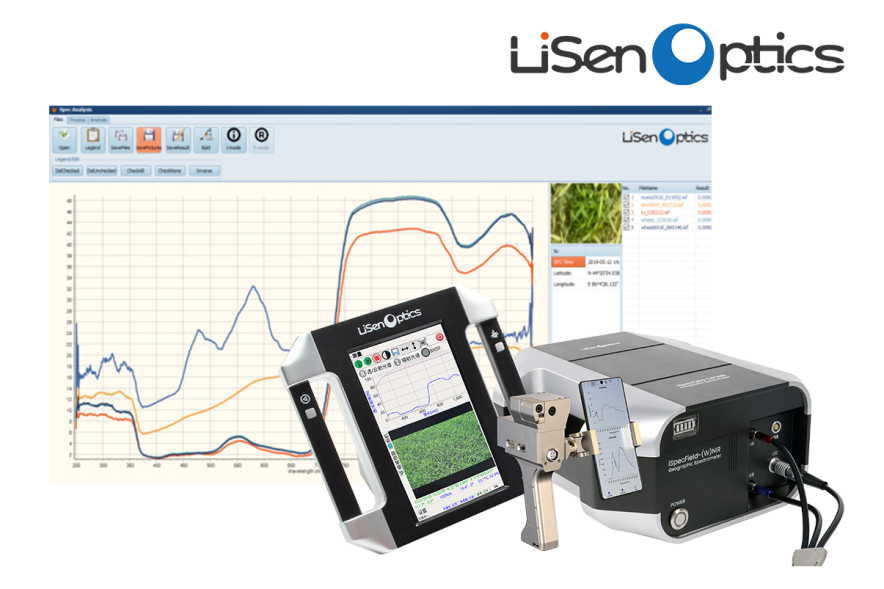

地物光谱仪如何帮助科学家研究植被和土壤?

科学家可以在一台计算机上解决最先进的AI问题

科学家可以在一台计算机上解决最先进的AI问题

评论