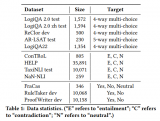

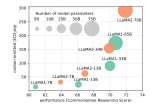

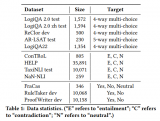

最新研究揭示,尽管大语言模型LLMs在语言理解上表现出色,但在逻辑推理方面仍有待提高。为此,研究者们推出了GLoRE,一个全新的逻辑推理评估基准,包含12个数据集,覆盖三大任务类型。

2023-11-23 15:05:16 476

476

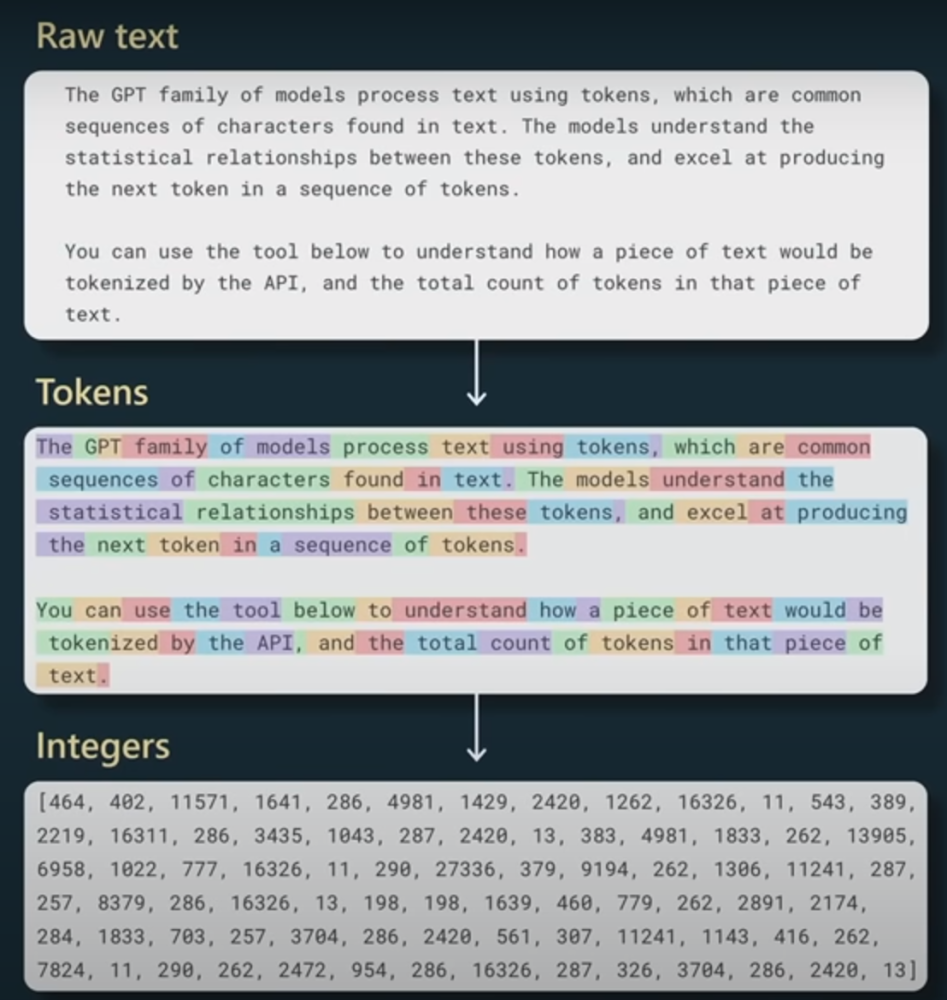

在大型语言模型(LLMs)的应用中,提示工程(Prompt Engineering)是一种关键技术,用于引导模型生成特定输出或执行特定任务。通过精心设计的提示,可以显著提高LLMs的性能和适用性。本文将介绍提示工程的主要方法和技巧,包括少样本提示、提示压缩和提示生成。

2023-12-13 14:21:47 274

274

NVIDIA NeMo Megatron 框架; 可定制的大规模语言模型 Megatron 530B;多GPU、多节点 Triton推理服务器助力基于语言的AI开发和部署,推动行业和科学发展。

2021-11-10 14:22:52 752

752 NVIDIA NeMo 大型语言模型(LLM)服务帮助开发者定制大规模语言模型;NVIDIA BioNeMo 服务帮助研究人员生成和预测分子、蛋白质及 DNA 美国加利福尼亚州圣克拉拉

2022-09-21 15:24:52 434

434

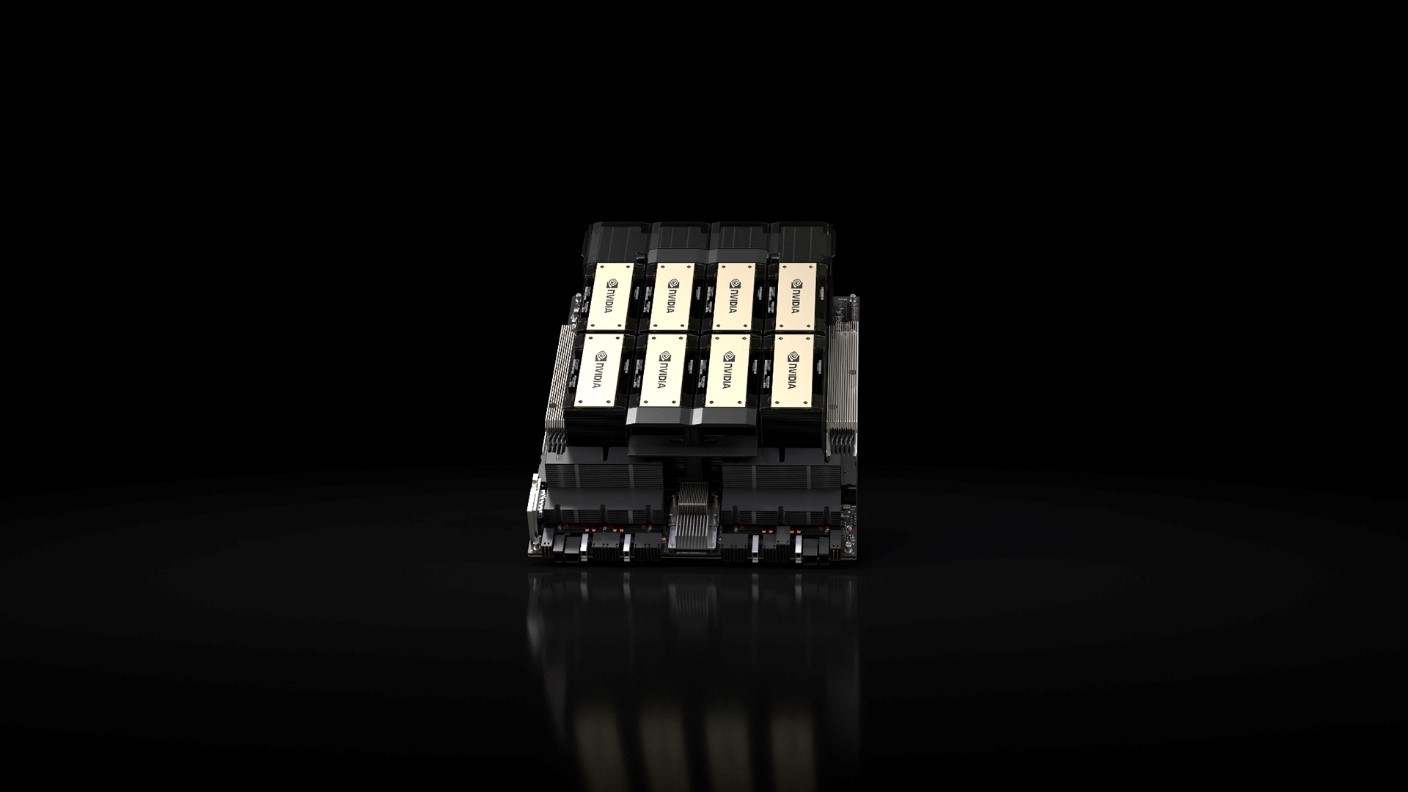

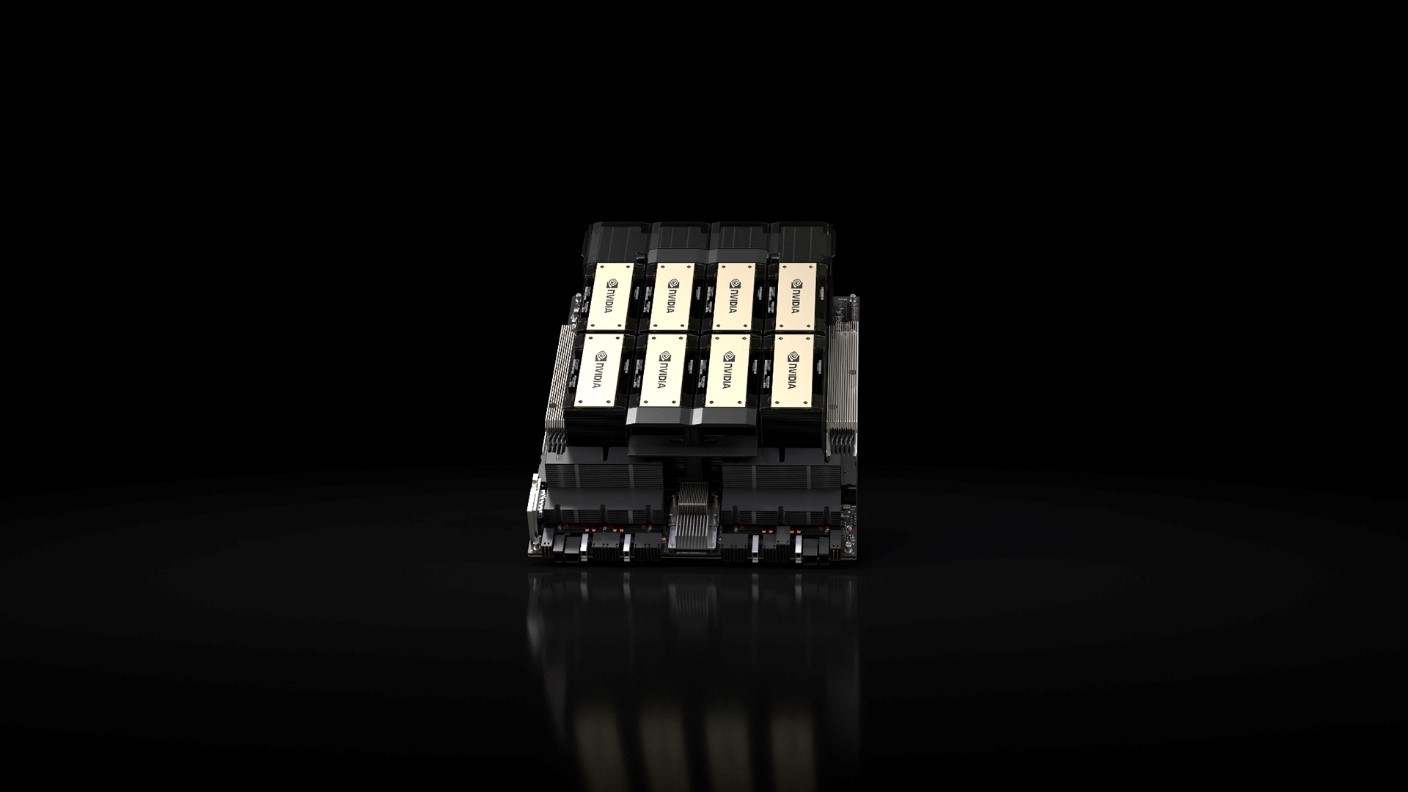

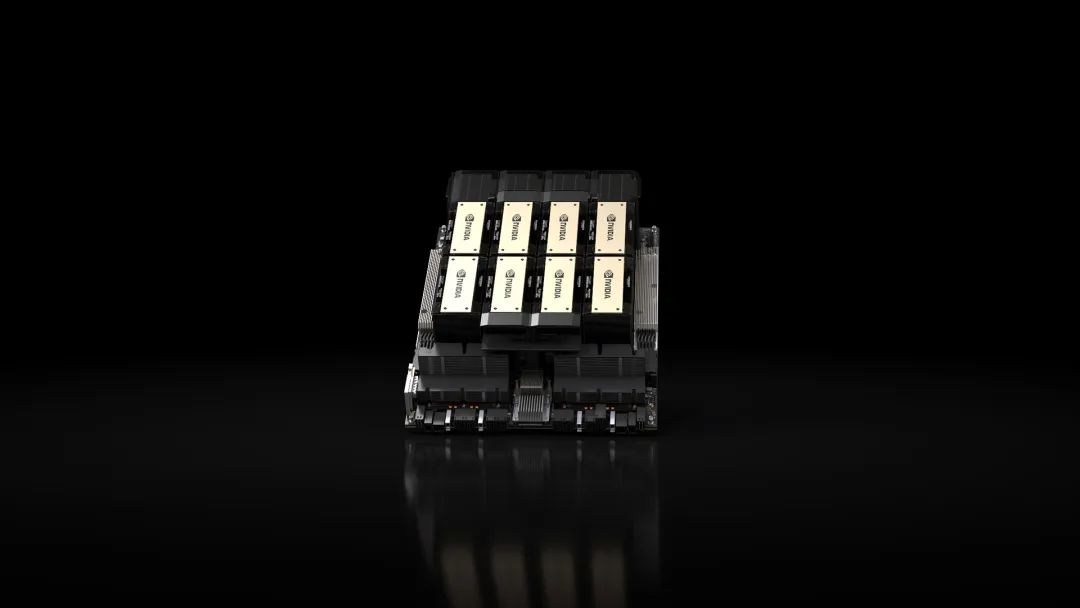

驱动的NVIDIA DGX™超级计算机,旨在助力开发面向生成式AI语言应用、推荐系统和数据分析工作负载的巨型、下一代模型。 NVIDIA DGX GH200的超大共享内存空间通过NVLink互连技术以及NVLink

2023-05-30 14:15:36 422

422

电子发烧友网报道(文/李弯弯)ChatGPT等大型语言模型在语言理解、生成、知识推理等方面正展现出令人惊艳的能力。近段时间,各企业开始探索大模型在不同行业中的应用落地,并针对不同领域推出相对应的行业

2023-07-25 00:12:00 1434

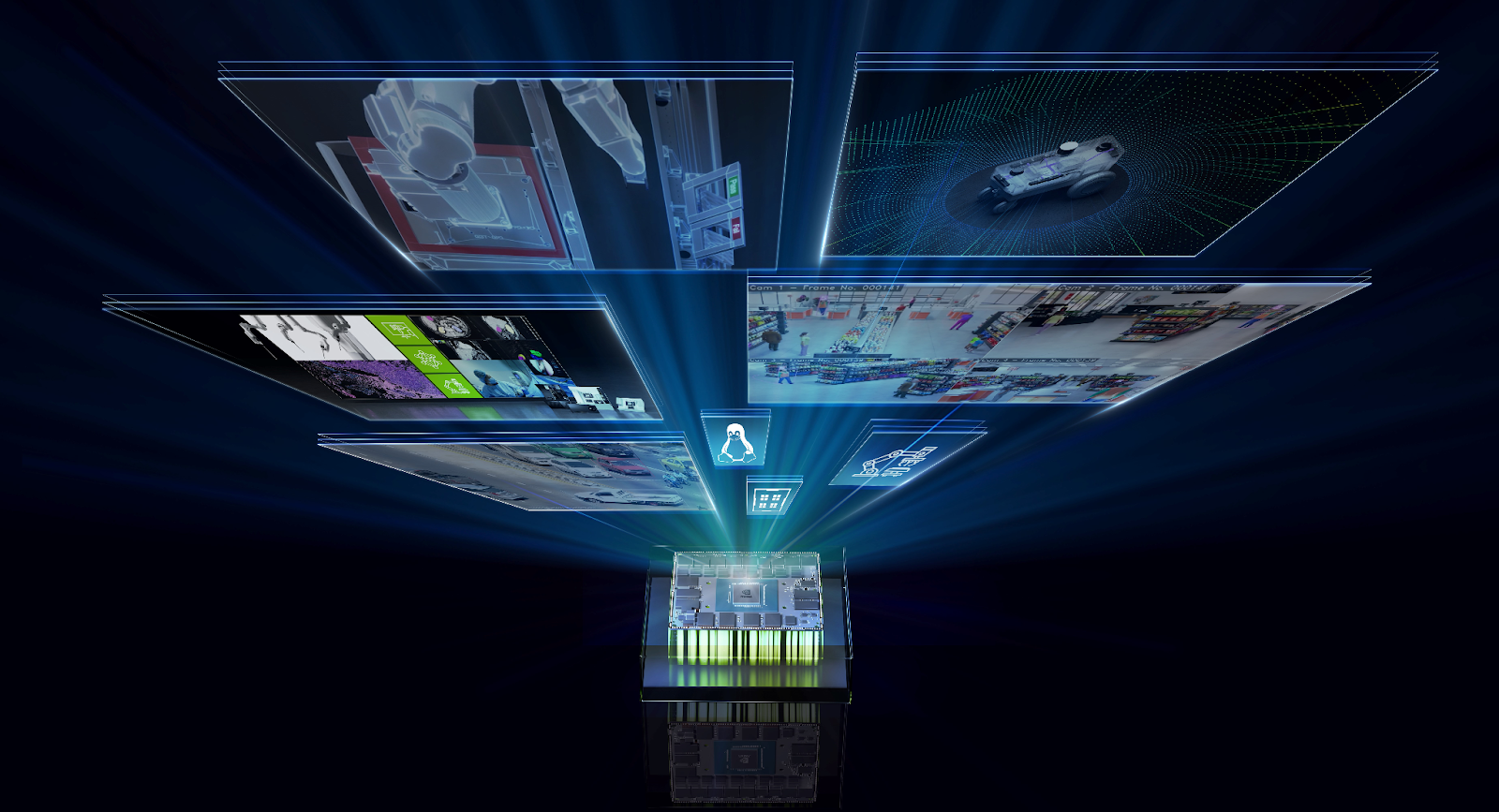

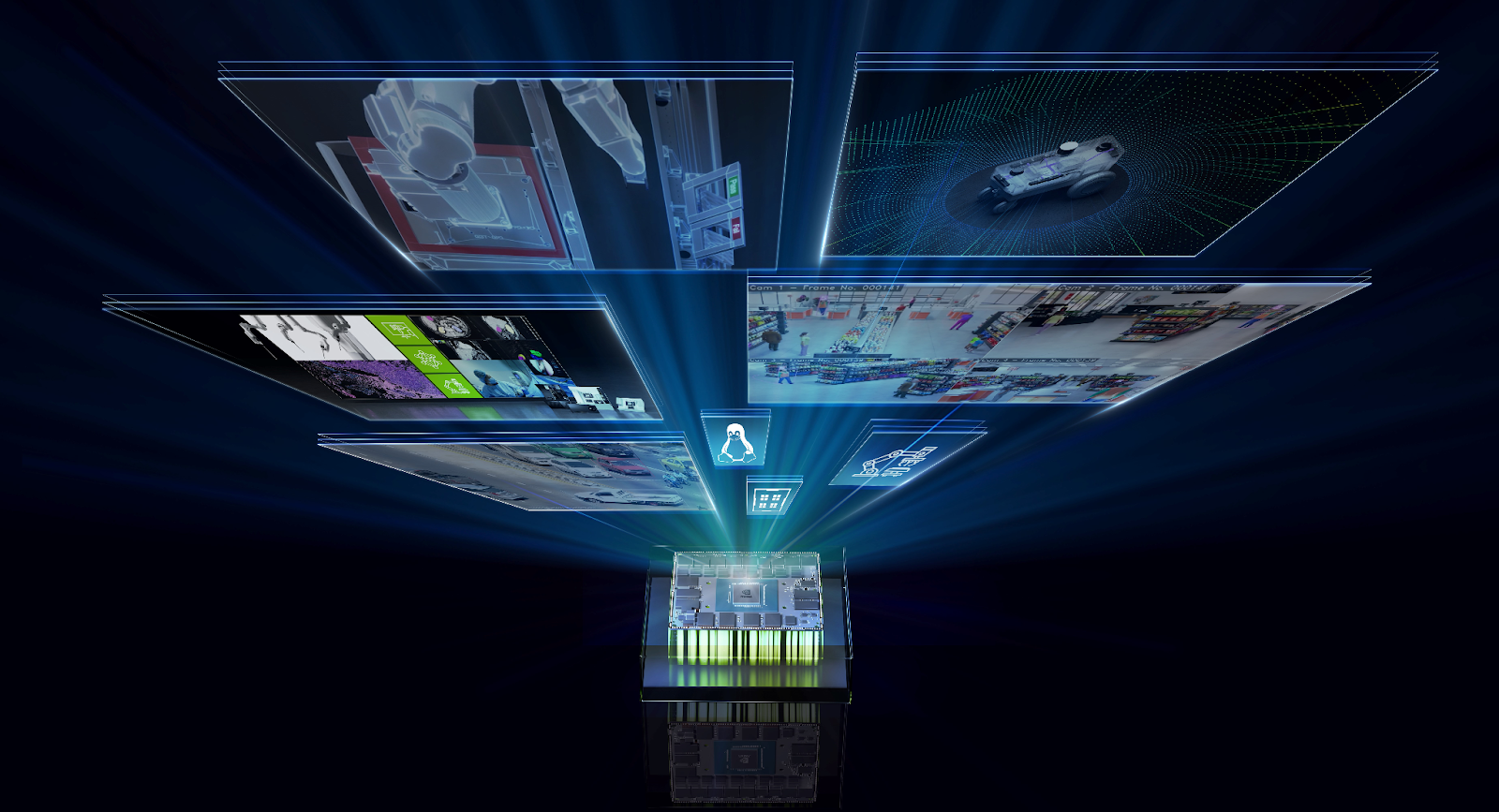

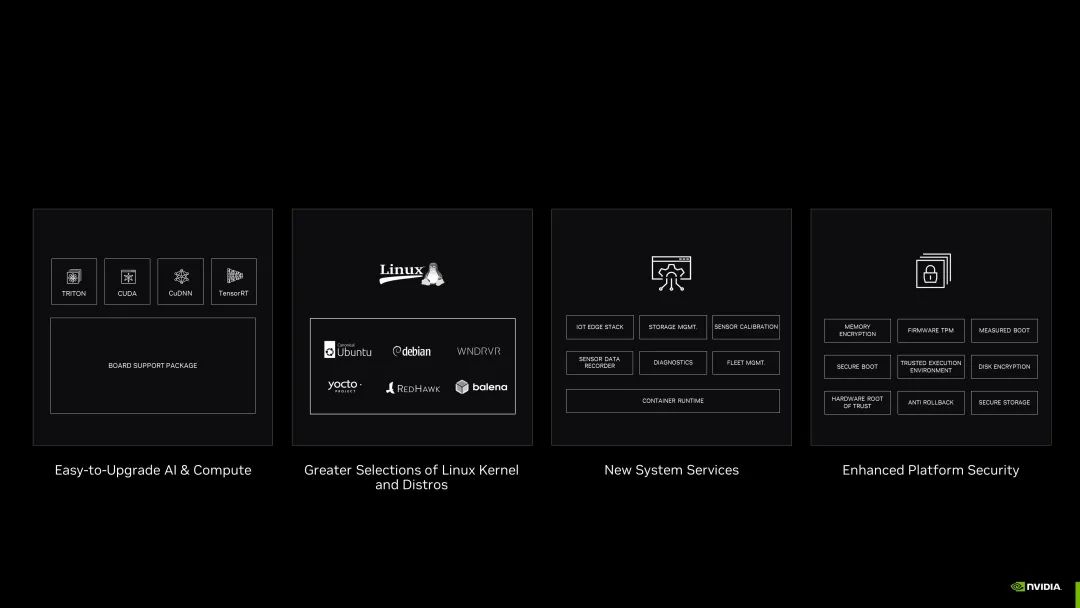

1434 Jetson概述爆炸式增长的AI模型的复杂性专为自主机器开发人员设计的AI计算板加快AI处理的SDK“JetPack”概述NVIDIA Jetson是NVIDIA公司嵌入式单板计算机的一系列

2021-11-09 08:26:45

的BERT、GNMT 和Jasper 等AI模型开源优化帮助开发者实现顶尖推理性能。NVIDIA的客户和合作伙伴中包括有会话式AI领域的一流公司,比如Kensho、微软、Nuance、Optum等。最后要

2019-11-08 19:44:51

腾CANN平台专用的离线模型,既然要调用模型进行推理,首先当然是要把模型加载进来,最简单的场景就是从磁盘加载一个离线模型文件进内存,接口如下:

aclError aclmdlLoadFromFile

2023-08-24 11:04:14

DLLite-Micro 是一个轻量级的 AI 推理框架,可以为 OpenHarmony OS 的轻量设备和小型设备提供深度模型的推理能力DLLite-Micro 向开发者提供清晰、易上手的北向接口

2021-08-05 11:40:11

场景介绍

MindSpore Lite 是一款 AI 引擎,它提供了面向不同硬件设备 AI 模型推理的功能,目前已经在图像分类、目标识别、人脸识别、文字识别等应用中广泛使用。

本文介绍

2023-12-14 11:41:13

你好我使用 STM32CUBE-AI v5.1.2 ApplicationTemplate 将简单的 CNN 导入到 STM32L462RCT我发现压缩模型对推理时间没有影响。aiRun 程序在 8

2023-01-29 06:24:08

你好, 我试图在 X-CUBE-AI.7.1.0 中导入由在线 AI 平台生成的 .h5 模型,收到错误:E010(InvalidModelError): Model saved with Keras 2.7.0 but

2022-12-27 06:10:35

基于SRAM的方法可加速AI推理

2020-12-30 07:28:28

Tengine是什么呢?如何在RK3399这一 Arm64平台上搭建Tengine AI推理框架呢?

2022-03-04 12:31:35

ONNX文件并生成特定平台和运行框架所支持的神经网络模型。ONNX本身不是AI神经网络运行框架,只是AI神经网络模型通用中间描述文件格式GitHub链接https://github.com/onnx/onnx编程语言C++ / Python热度5星Tenso

2021-12-14 06:18:44

如果在没有嵌入式处理器供应商提供的合适工具和软件的支持下,既想设计高能效的边缘人工智能(AI)系统,同时又要加快产品上市时间,这项工作难免会冗长乏味。面临的一系列挑战包括选择恰当的深度学习模型

2022-11-03 06:53:28

管理图 主要流程:任务推理创建流程:首先配置客户端sessionId,端配置clientId,由clientId和clientId组合生成唯一的transactionId,然后根据模型框架类型和推理网络

2022-03-25 11:15:36

,支持广泛的应用程序和动态工作负载。本文将讨论这些行业挑战可以在不同级别的硬件和软件设计采用Xilinx VERSAL AI核心,业界首创自适应计算加速平台超越了CPU/GPU和FPGA的性能。

2020-11-01 09:28:57

对一些非参数化设计师以及3D打印纯小白非常不友好。为此,清锋科技推出了面向增材制造的晶格模型自动生成平台——LuxStudio,不仅可以实现多种结构晶格的自动生成

2022-11-09 10:43:02

亚马逊宣布推出Inferentia,这是由AWS设计的芯片,专门用于部署带有GPU的大型AI模型,该芯片将于明年推出。

2018-12-03 09:46:08 1753

1753 自然语言理解、匹配排序等等,这些模型的训练和推理都大量依赖于NVIDIA GPU,尤其在推理方面,NVIDIA GPU及相应的解决方案都满足了业务所需的延迟和吞吐要求。 微信搜索业务需要更高效平台 微信搜索业务由多个子模块构成,包括查

2021-10-28 15:28:12 1551

1551 NVIDIA NeMo Megatron 框架; 可定制的大规模语言模型Megatron 530B;多GPU、多节点 Triton推理服务器助力基于语言的AI开发和部署,推动行业和科学发展

2021-11-12 14:30:07 1327

1327 软件的新功能,该软件为所有AI模型和框架提供跨平台推理;同时也包含对NVIDIA TensorRT的更新,该软件优化AI模型并为NVIDIA GPU上的高性能推理提供运行时优化。 NVIDIA还推出了NVIDIA A2 Tensor Core GPU,这是一款用于边

2021-11-12 14:42:53 1684

1684 Microsoft Teams借助AI生成的实时字幕和转录功能,帮助全球学生和职场人士顺利进行在线会议。用于训练的NVIDIA AI计算技术和用于推理语音识别模型的NVIDIA Triton推理服务器进一步提升了这两个功能。

2022-01-04 14:20:11 1407

1407 Microsoft Teams借助AI生成的实时字幕和转录功能,帮助全球学生和职场人士顺利进行在线会议。用于训练的NVIDIA AI计算技术和用于推理语音识别模型的NVIDIA Triton推理服务器进一步提升了这两个功能。

2022-01-04 17:45:12 1472

1472 Microsoft 的目标是,通过结合使用 Azure 与 NVIDIA GPU 和 Triton 推理软件,率先将一系列强大的 AI Transformer 模型投入生产用途。

2022-04-02 13:04:21 1456

1456 现在,您和开发人员社区的其他成员都可以使用这些成果,主要是以开源软件的形式。此外, TensorRT 和 Triton 推理服务器可从 NVIDIA NGC 免费获得,以及预训练模型、深度学习框架

2022-04-08 16:31:31 931

931

“在使用 NVIDIA TensorRT和NVIDIA T4 GPU对平台赋能后,“极星”推理平台的算法推理效率得到了进一步的提升,更好地支持速接入各类算法、数据及智能设备,实现AI自闭环能力,并通过应用服务和标准化接口,帮助终端客户低成本实现AI与业务的结合,快速构建智能应用。

2022-04-13 14:49:19 862

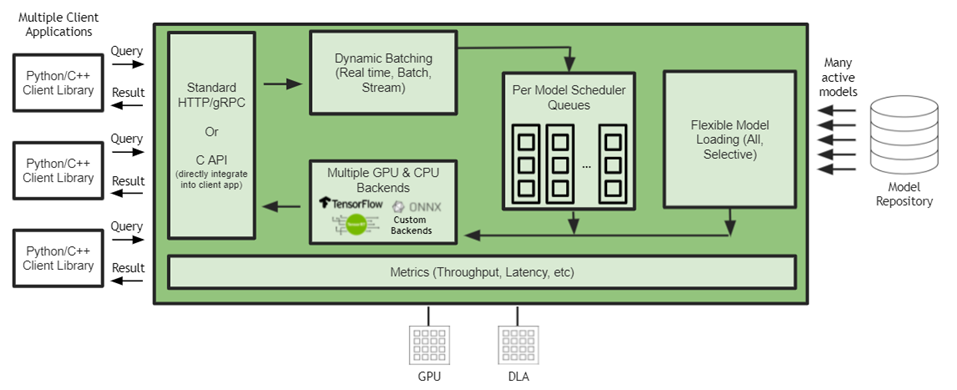

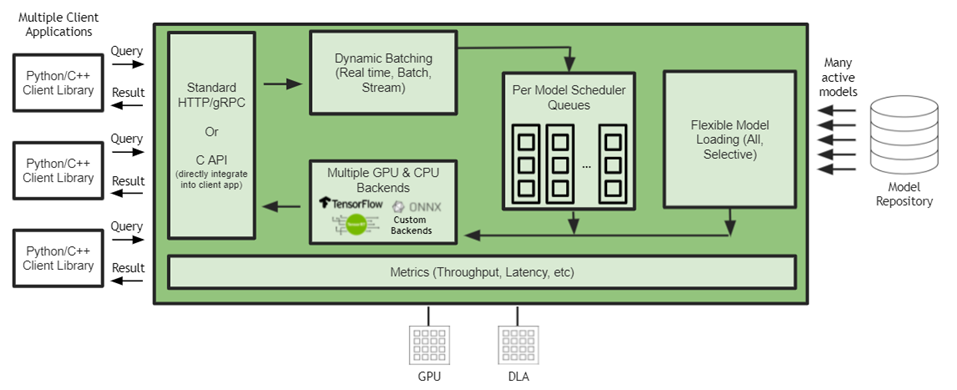

862 NVIDIA Triton 有助于在每个数据中心、云和嵌入式设备中实现标准化的可扩展生产 AI 。它支持多个框架,在 GPU 和 DLA 等多个计算引擎上运行模型,处理不同类型的推理查询。通过与 NVIDIA JetPack 的集成, NVIDIA Triton 可用于嵌入式应用。

2022-04-18 15:40:02 2306

2306

NVIDIA Triton 推理服务器(以前称为 TensorRT 推理服务器)是一款开源软件,可简化深度学习模型在生产环境中的部署。借助 Triton 推理服务器,Devops 和 MLops

2022-06-28 15:49:47 1293

1293 Kit 不仅大大提升了 GPU 集群上多机多卡分布式训练的效率,对于 GPU 上的模型推理也通过集成 NVIDIA TensorRT 带来了显著加速。双方团队就 GPU 推理加速这一话题将进行持续深入的合作,推出定制化的优化方案,为业界客户带来显著的性能收益。

2022-08-31 09:24:07 1235

1235 腾讯云 TI 平台 TI-ONE 利用 NVIDIA Triton 推理服务器构造高性能推理服务部署平台,使用户能够非常便捷地部署包括 TNN 模型在内的多种深度学习框架下获得的 AI 模型,并且显著提升推理服务的吞吐、提升 GPU 利用率。

2022-09-05 15:33:01 1419

1419 蚂蚁链 AIoT 团队与 NVIDIA 合作,将量化感知训练(QAT)技术应用于深度学习模型性能优化中,并通过 NVIDIA TensorRT 高性能推理 SDK 进行高效率部署, 通过 INT8 推理, 吞吐量提升了 3 倍, 助力蚂蚁链版权 AI 平台中的模型推理服务大幅降本增效。

2022-09-09 09:53:52 872

872 NVIDIA NeMo 大型语言模型(LLM)服务帮助开发者定制大规模语言模型;NVIDIA BioNeMo 服务帮助研究人员生成和预测分子、蛋白质及 DNA

2022-09-22 10:42:29 742

742 韩国先进的移动运营商构建包含数百亿个参数的大型语言模型,并使用 NVIDIA DGX SuperPOD 平台和 NeMo Megatron 框架训练该模型。

2022-09-27 09:24:30 915

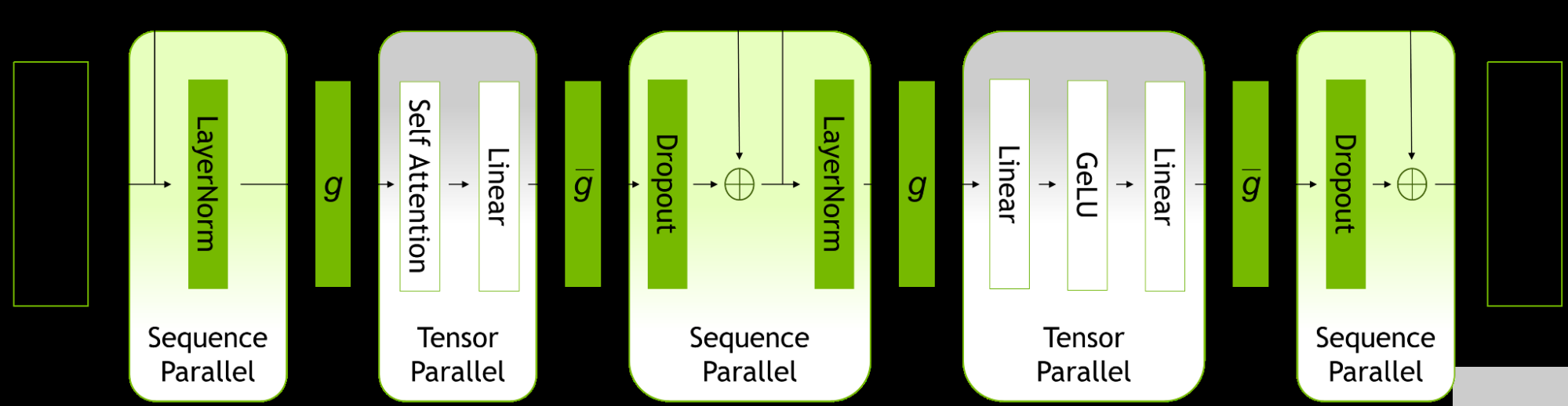

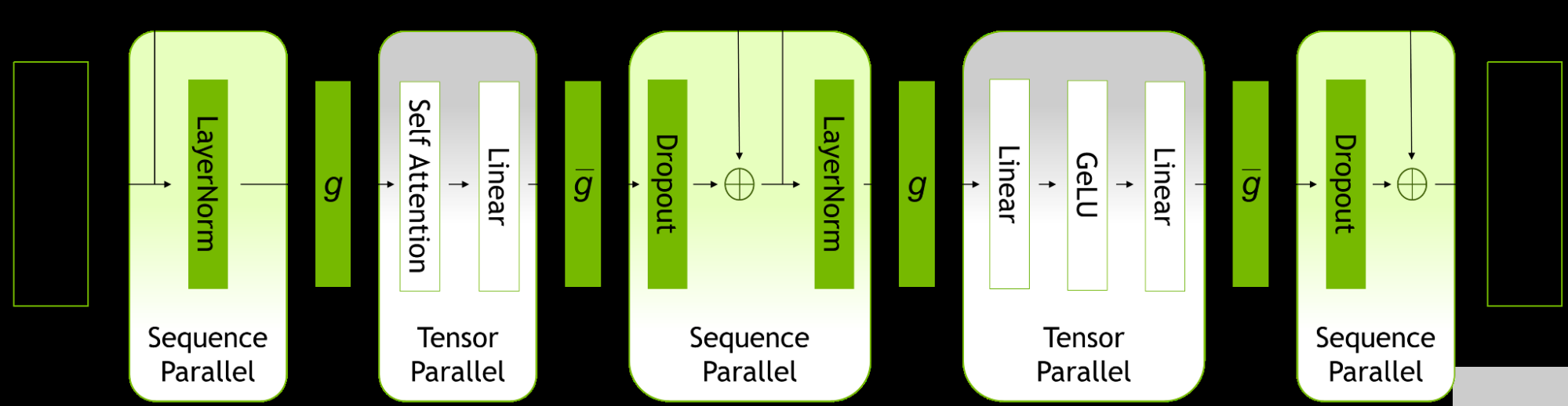

915 随着大型语言模型( LLM )的规模和复杂性不断增长, NVIDIA 今天宣布更新 NeMo Megatron 框架,提供高达 30% 的训练速度。

2022-10-10 15:39:42 644

644

通过 NVIDIA GPU 加速平台,Colossal-AI 实现了通过高效多维并行、异构内存管理、大规模优化库、自适应任务调度等方式,更高效快速部署 AI 大模型训练与推理。

2022-10-19 09:39:39 1149

1149 科学家使用 NVIDIA BioNeMo 创建出能够生成高质量蛋白质的大型语言模型,以此加快药物研发并助力创造更具可持续性的环境。 初创企业 Evozyne 使用 NVIDIA 提供的预训练 AI

2023-01-13 23:15:02 419

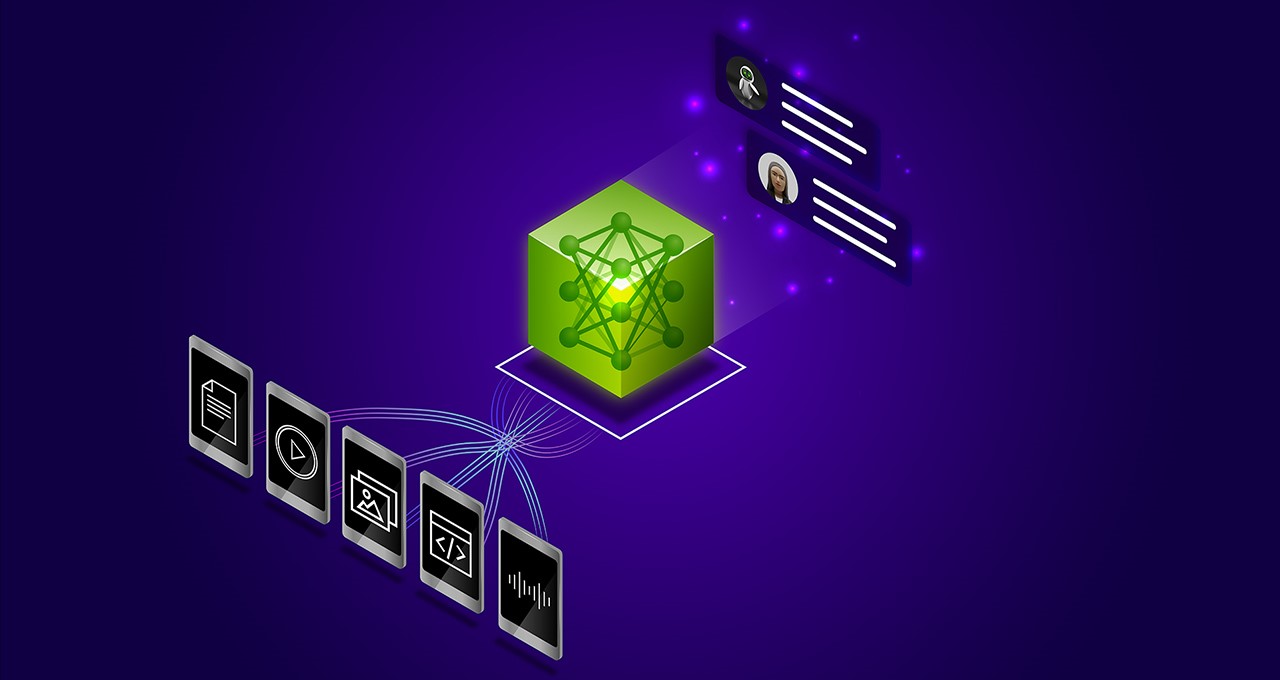

419 大型语言模型能识别、总结、翻译、预测和生成文本及其他内容。 AI 应用在大型语言模型的帮助下,可用于解决总结文章、编写故事和参与长对话等多种繁重工作。 大型语言模型(LLM)是一种深度学习算法,可以

2023-02-23 19:50:04 3887

3887 大型语言模型能识别、总结、翻译、预测和生成文本及其他内容。

2023-03-08 13:57:00 6989

6989 为AI驱动的应用构建自定义模型 加利福尼亚州圣克拉拉 – GTC – 太平洋时间 2023年3月21日 – 为了加速企业应用生成式AI,NVIDIA今日宣布推出一套云服务,使企业能够构建、完善

2023-03-22 13:45:40 261

261

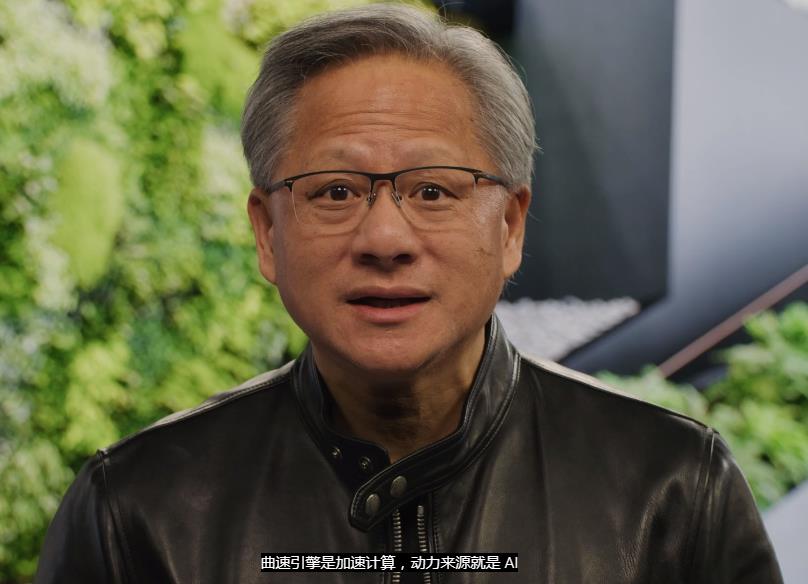

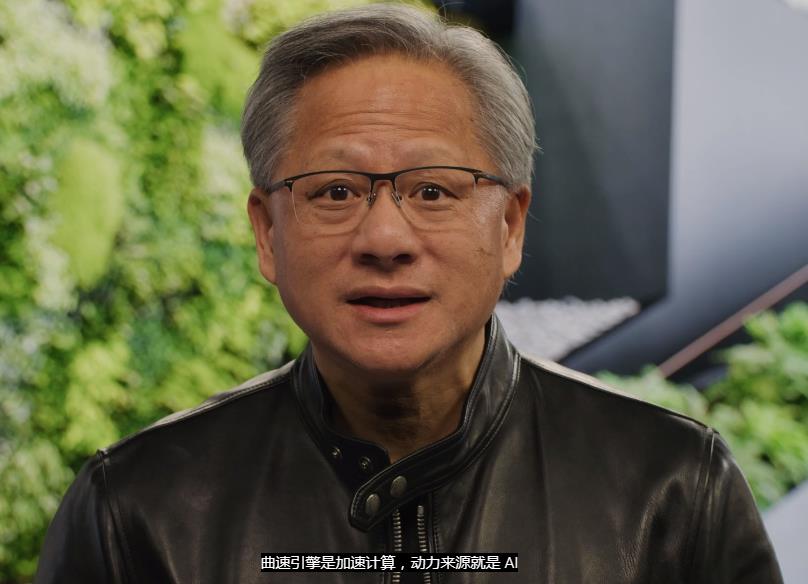

NVIDIA 创始人兼首席执行官黄仁勋将在 GTC 2023 上介绍生成式 AI、元宇宙、大型语言模型、云计算等领域的最新进展。 同时黄仁勋不仅阐述了NVIDIA 在人工智能时代的诸多成就和对未来发展

2023-03-22 15:23:28 2900

2900

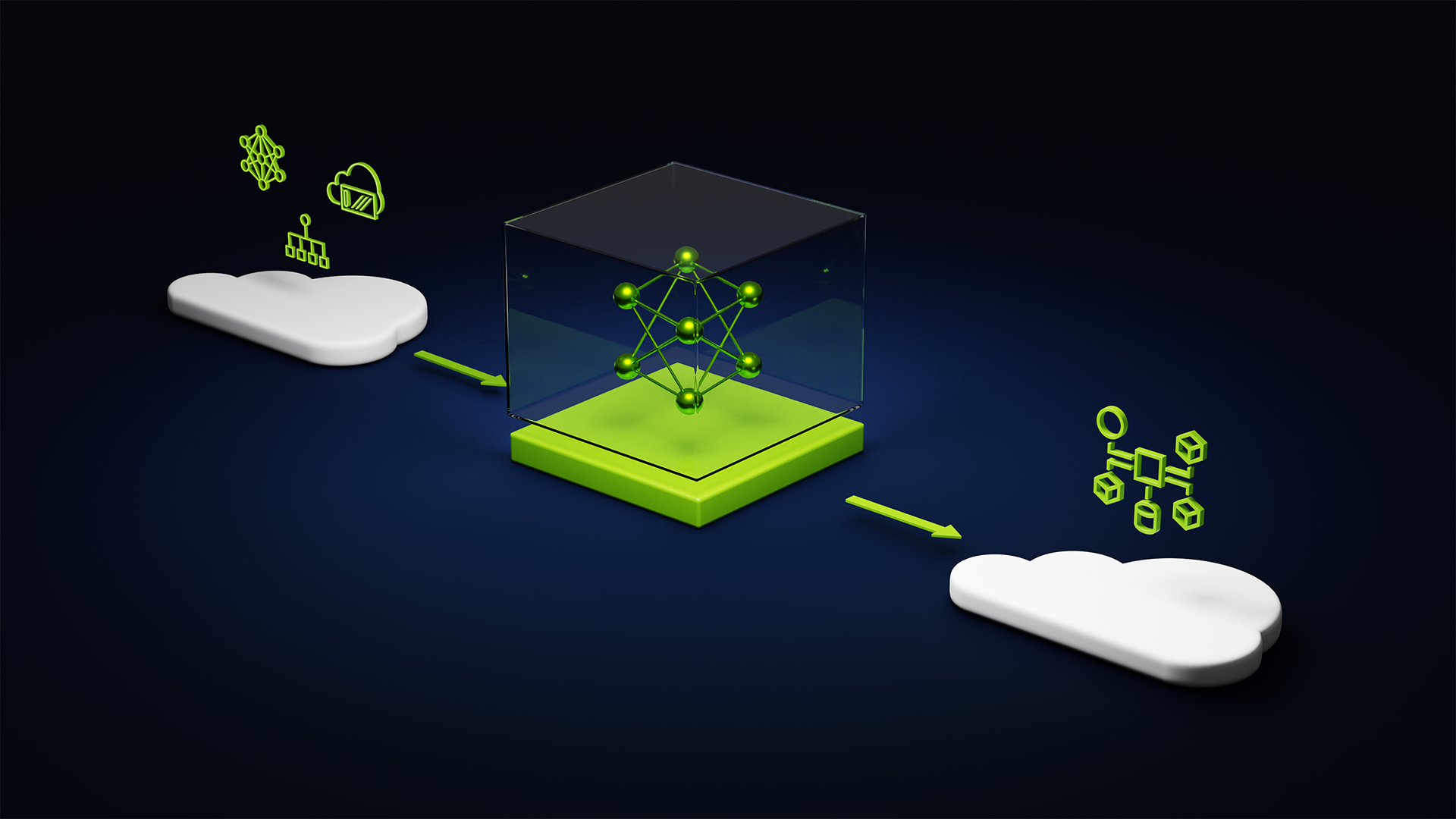

,NVIDIA AI Foundations云服务系列为需要构建、完善和运行自定义大型语言模型及生成式AI的客户提供服务,他们通常使用专有数据进行训练并完成特定领域的任务。 图源 NVIDIA 直播截图 Audio2Face 可以支持中文

2023-03-22 17:14:33 1621

1621

Foundations 云服务为 AI 驱动的应用构建 自定义模型 加利福尼亚州圣克拉拉 – GTC – 太平洋时间 2023年3月21日 – 为了加速企业应用生成式 AI,NVIDIA 宣布推出一套云服务,使企业

2023-03-23 06:50:04 365

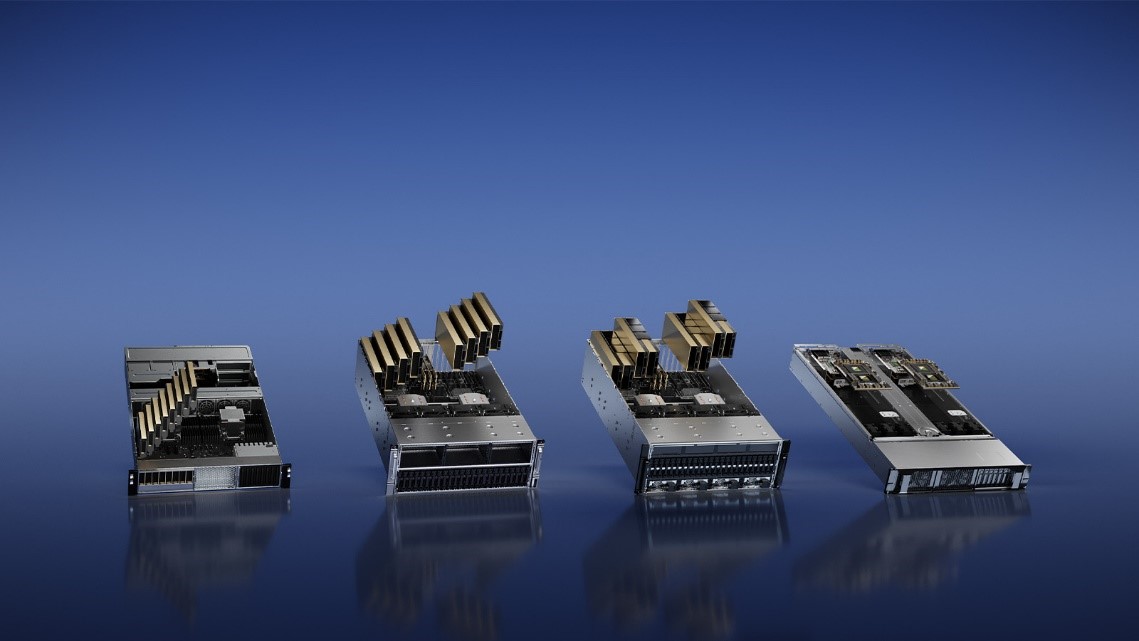

365 日 – NVIDIA 于今日推出四款推理平台。这些平台针对各种快速兴起的生成式 AI 应用进行了优化,能够帮助开发人员快速构建用于提供新服务和洞察的 AI 驱动的专业应用。 这些平台将 NVIDIA

2023-03-23 06:55:02 654

654 NVIDIA 生成式 AI 推理平台将集成至谷歌云 Vertex AI 中;谷歌云成为首家提供 NVIDIA L4 GPU 实例的云服务商 加利福尼亚州圣克拉拉 – GTC – 太平洋时间 2023

2023-03-23 06:55:02 438

438 年 3 月 21 日 – NVIDIA 今日推出一整套用于自定义 AI 基础模型的生成式 AI 云服务。这些服务将加速新蛋白质和治疗方法的创建以及基因组学、化学、生物学和分子动力学等领域的研究。 作为

2023-03-23 06:55:03 328

328 NVIDIA NeMo 服务帮助企业将大型语言模型与其专有数据相结合,赋能智能聊天机器人、客户服务等更多应用。 如今的大型语言模型知识渊博,但它们的工作方式有点像时间胶囊——所收集的信息仅限于第一次

2023-03-25 09:10:03 274

274 Foundations 云服务为 AI 驱动的应用构建 自定义模型 加利福尼亚州圣克拉拉 – GTC – 太平洋时间 2023年3月21日 – 为了加速企业应用生成式 AI,NVIDIA 宣布推出一套云服务,使企业

2023-03-25 15:20:04 285

285 在最新 MLPerf 基准测试中,NVIDIA H100 和 L4 GPU 将生成式 AI 和所有其他工作负载带到了新的水平,Jetson AGX Orin 则在性能和效率方面都有所提升。 作为独立

2023-04-08 00:30:08 389

389 基于 ServiceNow 平台并采用 NVIDIA AI 软件和 DGX 基础设施构建的自定义大型语言模型将为企业带来更智能的工作流自动化 ServiceNow 和 NVIDIA 宣布达成合作伙伴

2023-05-19 00:50:02 342

342

NVIDIA AI Enterprise 与 Azure 机器学习集成,提供端到端云平台,供开发者构建、部署和管理大型语言模型的 AI 应用 微软 Build 大会——太平洋时间 2023

2023-05-25 09:15:02 347

347

• Project Helix 使企业能够轻松构建和部署值得信赖的生成式 AI • 戴尔和 NVIDIA 的基础设施与软件包含内置的数据安全功能,用于本地生成式 AI 应用 戴尔科技集团全球大会

2023-05-25 09:15:02 349

349 行业领导者打破藩篱,使开发人员能够轻松地在 Windows 11 上训练并部署先进的 AI 模型,并在配备 RTX 的 PC 和工作站上提供节能的推理。 生成式 AI,以 ChatGPT 等大型语言

2023-05-25 09:15:02 509

509

大型语言模型能否捕捉到它们所处理和生成的文本中的语义信息?这一问题在计算机科学和自然语言处理领域一直存在争议。然而,MIT的一项新研究表明,仅基于文本形式训练、用于预测下一个token的语言模型

2023-05-25 11:34:11 434

434

Switch System 驱动的 NVIDIA DGX 超级计算机 ,旨在助力开发面向生成式 AI 语言应用、推荐系统和数据分析工作负载的巨型、下一代模型。 NVIDIA DGX GH200 的超大共享内存空间通过 NVLink 互连技术 以及 NV

2023-05-30 01:40:01 1459

1459

全新的 NVIDIA Spectrum-X 网络平台集 NVIDIA Spectrum-4、BlueField-3 DPU 和加速软件于一身;全球头部云服务提供商采用该平台来横向扩展其生成式 AI

2023-05-30 01:40:02 352

352

搭载 Tensor Core 的 NVIDIA RTX GPU 正在加速生成式 AI 模型的开发与部署;即将推出的 Max-Q 低功耗 AI 推理将提高能效比。 生成式 AI 正在迅速开创一个计算

2023-05-31 03:50:02 344

344 随着越来越多的 AI 推理在本地设备上运行,工作站将需要强大而高效的硬件以支持这些复杂的任务。为了满足这一需求,RTX GPU 将添加用于 AI 工作负载的 Max-Q 低功耗推理。在执行轻量级

2023-06-07 14:55:24 442

442

本文旨在更好地理解基于 Transformer 的大型语言模型(LLM)的内部机制,以提高它们的可靠性和可解释性。 随着大型语言模型(LLM)在使用和部署方面的不断增加,打开黑箱并了解它们的内部

2023-06-25 15:08:49 991

991

大型语言模型(LLM) 是一种深度学习算法,可以通过大规模数据集训练来学习识别、总结、翻译、预测和生成文本及其他内容。大语言模型(LLM)代表着 AI 领域的重大进步,并有望通过习得的知识改变

2023-07-05 10:27:35 1463

1463 使用集成模型在 NVIDIA Triton 推理服务器上为 ML 模型管道提供服务

2023-07-05 16:30:34 1082

1082

通过降低认知负载和为即时管理、工单系统和代码生成等任务提供支持,人工智能(AI)和大型语言模型(LLMs)可能在云计算和 DevOps 领域发挥重要作用。主要的云计算供应商,如微软、谷歌和亚马逊云科技等,已经将 AI 集成到他们的产品和服务中,充分展示了行业在 AI 技术上的投入。

2023-08-03 15:26:42 813

813

年 8 月 8 日 — NVIDIA 与 Hugging Face 宣布建立合作伙伴关系,为数百万开发者提供生成式 AI 超级计算服务,帮助他们构建大语言模型(LLM)和其他高级 AI 应用。 此次

2023-08-09 11:41:59 100

100

计算密集型的复杂应用,包括 AI 训练与推理、3D 设计与可视化、视频处理以及工业数字化等。 这款全新 GPU 将加速生成式 AI 的计算工作负载。生成式 A

2023-08-09 19:10:06 264

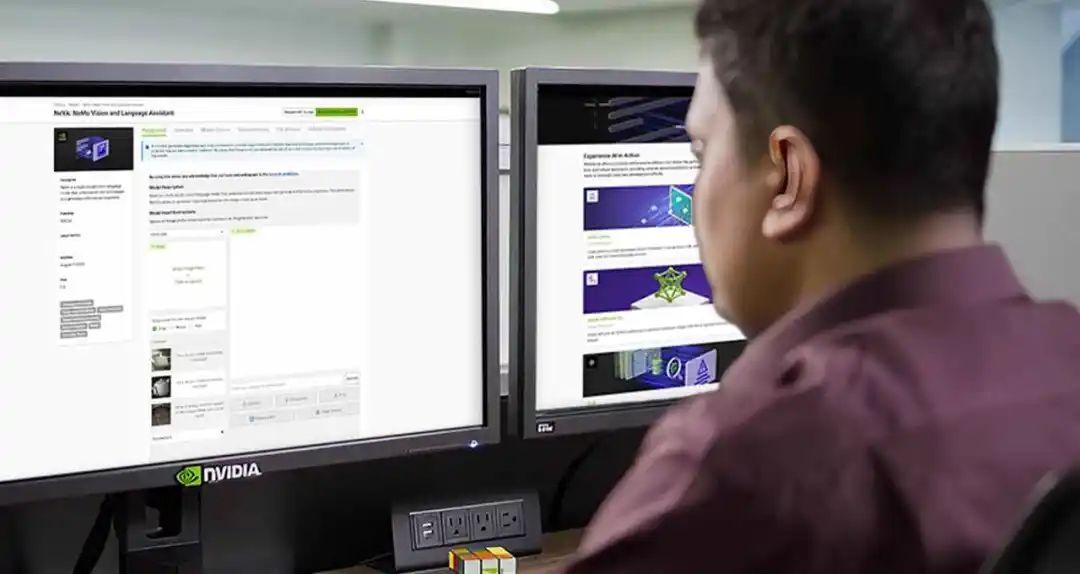

264 从 PC 和工作站到企业数据中心、公有云和 NVIDIA DGX 云,新推出的开发者套件在 NVIDIA AI 平台上引入了简化的模型优化与部署。 洛杉矶 — SIGGRAPH — 太平洋时间

2023-08-09 19:10:09 261

261 2023年8月8日,NVIDIA创始人兼CEO黄仁勋在计算机图形年会SIGGRAPH上发布了HBM3e内存新一代GH200 Grace Hopper超级芯片。这款芯片被黄仁勋称为“加速计算和生成式AI时代的处理器”,旨在用于任何大型语言模型,以降低推理成本。

2023-08-11 16:29:17 767

767 近日,清华大学新闻与传播学院发布了《大语言模型综合性能评估报告》,该报告对目前市场上的7个大型语言模型进行了全面的综合评估。近年,大语言模型以其强大的自然语言处理能力,成为AI领域的一大热点。它们

2023-08-10 08:32:01 607

607

这些性能强大的新系统将利用 NVIDIA Omniverse 平台加速高计算密集度的复杂应用,包括 AI 训练和推理、3D 设计和可视化、视频处理、工业数字化等。

2023-08-23 14:20:18 224

224 全新 VMware Private AI Foundation With NVIDIA 帮助企业为生成式 AI 在业务中的应用做好准备;该平台将在数据隐私性、安全性和可控性方面提供进一步支持

2023-08-23 19:10:07 446

446

戴尔科技、慧与和联想即将推出采用 NVIDIA L40S GPU 和 NVIDIA BlueField 的服务器,以支持 VMware Private AI Foundation

2023-08-23 19:10:09 350

350 今天,Meta发布了Code Llama,一款可以使用文本提示生成代码的大型语言模型(LLM)。

2023-08-25 09:06:57 885

885

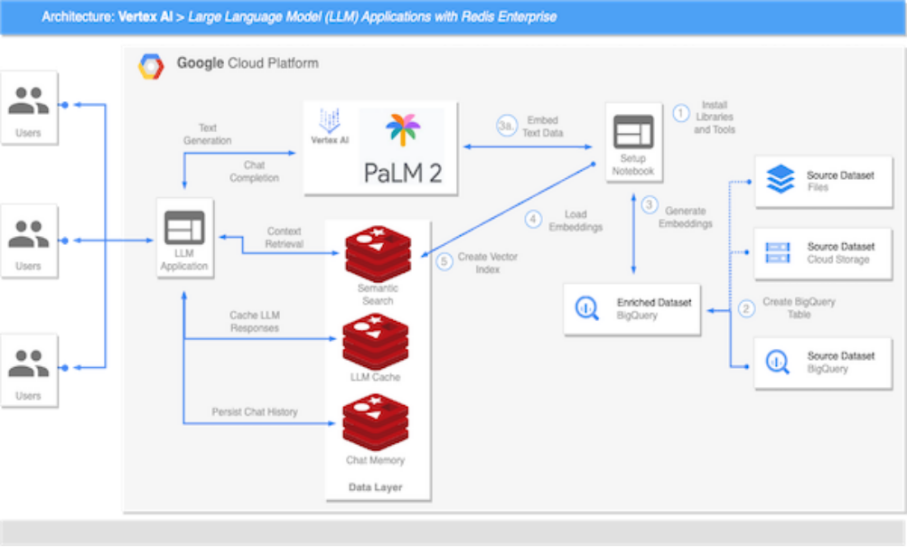

两家 AI 领军企业一同优化谷歌云,使更多生成式 AI 领域的初创企业能够构建下一代应用。 生成式 AI 和大语言模型(LLM)不断推动创新,使训练和推理工作的算力需求以惊人的速度增长。 为了满足

2023-08-31 13:00:03 230

230

生成式AI和大语言模型(LLM)正在以难以置信的方式吸引全世界的目光,本文简要介绍了大语言模型,训练这些模型带来的硬件挑战,以及GPU和网络行业如何针对训练的工作负载不断优化硬件。

2023-09-01 17:14:56 1046

1046

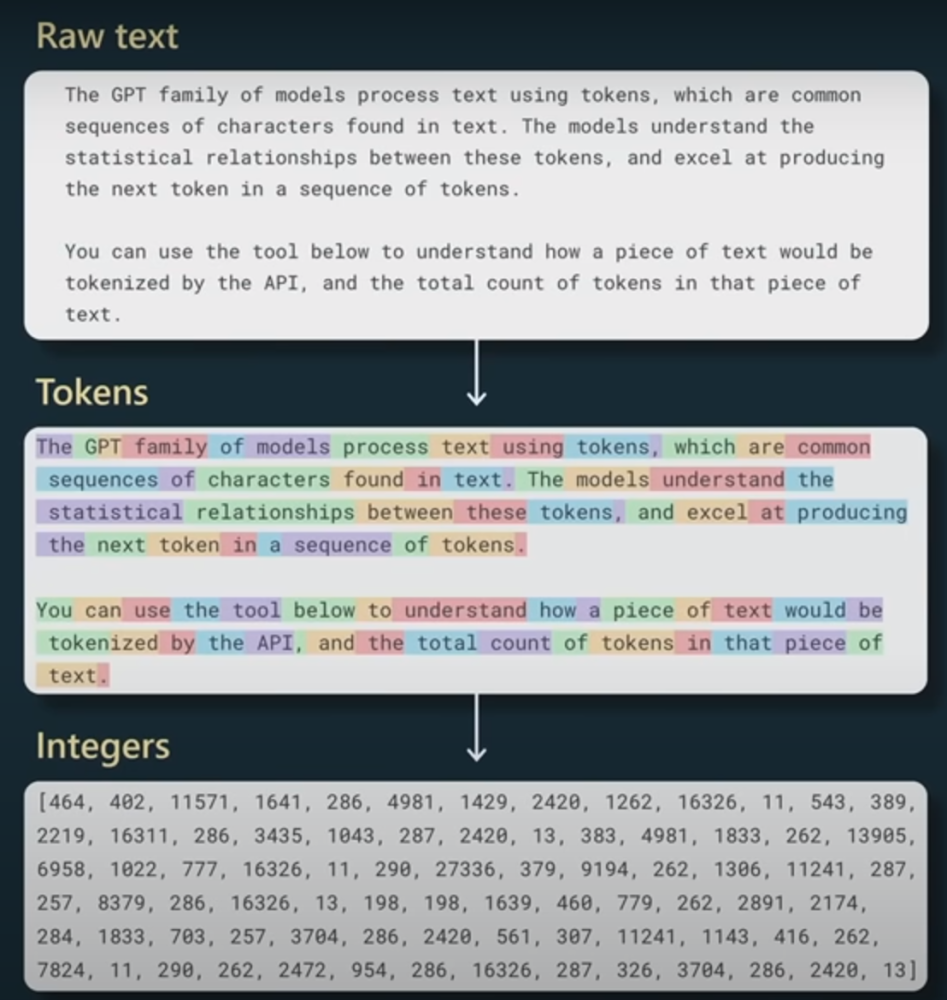

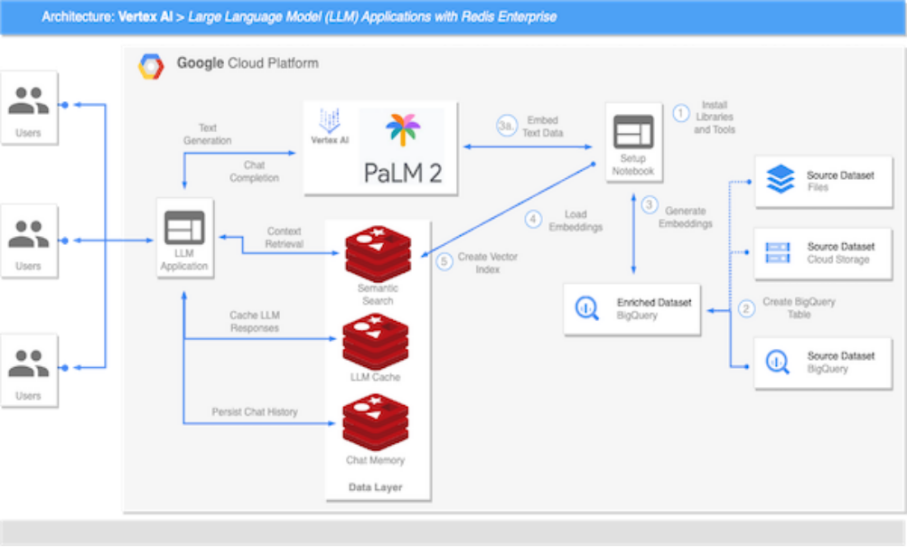

化。有Redis加持的大语言模型可应用于文档检索、虚拟购物助手、客户服务助理等,为企业带来益处。 一、语言模型构件 应用程序生成、理解和使用人类语言的能力正变得越来越重要,从客服机器人到虚拟助手,再到内容生成,人们对AI应用功能的需求横跨众多领

2023-09-18 11:26:49 316

316

生成式 AI 和大语言模型(LLM)不断推动突破性创新,训练和推理对算力的需求也随之急剧上升。 这些现代生成式 AI 应用需要全栈加速计算,首先要有能够快速、准确处理大量工作负载的先进基础设施

2023-09-25 20:40:02 269

269

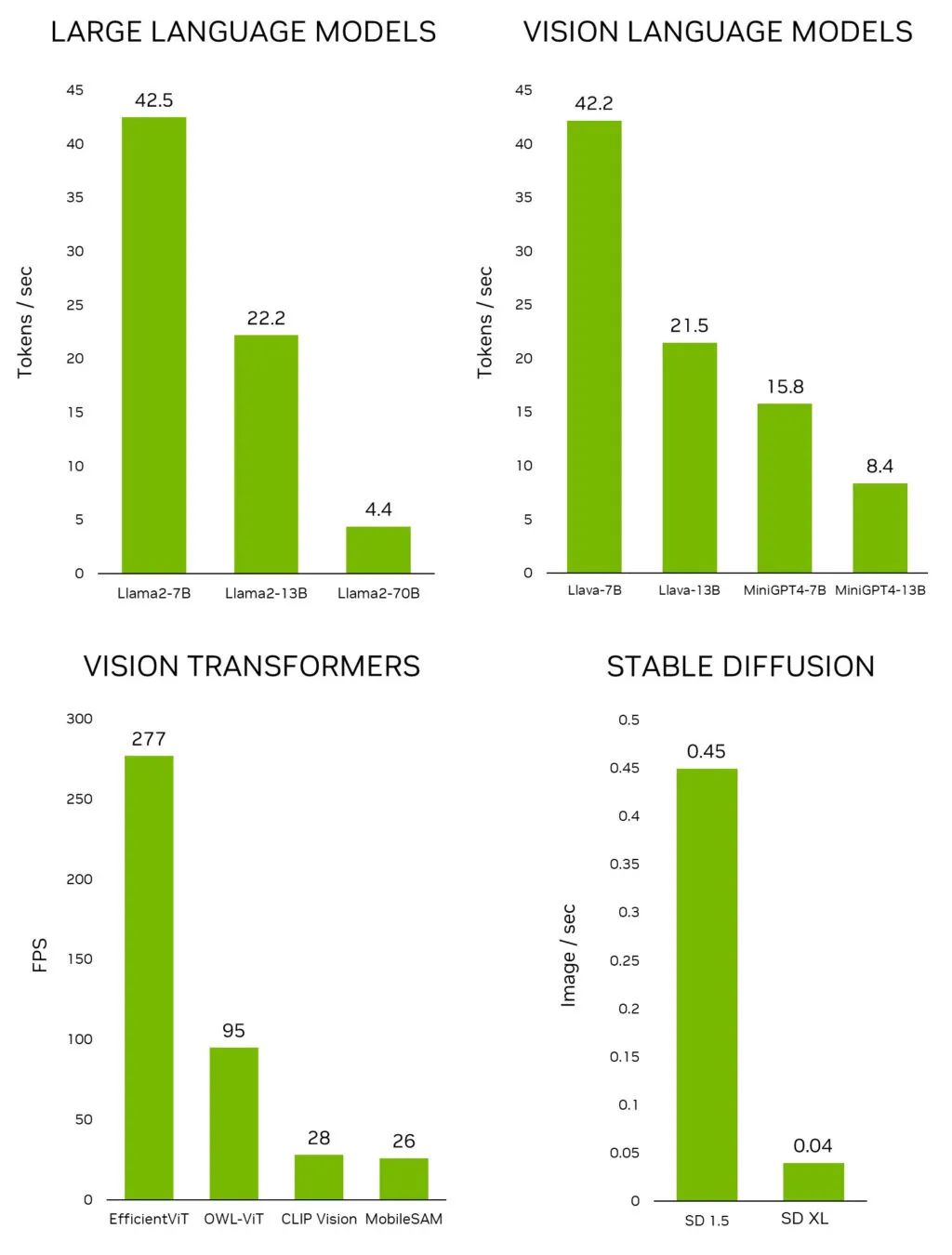

基于 NVIDIA Jetson 平台进行开发的 1 万多家公司现在可以利用全新的生成式 AI、API 和微服务来加快推进行业数字化 强大的生成式 AI 模型、云原生应用程序接口( API

2023-10-19 17:16:24 121

121

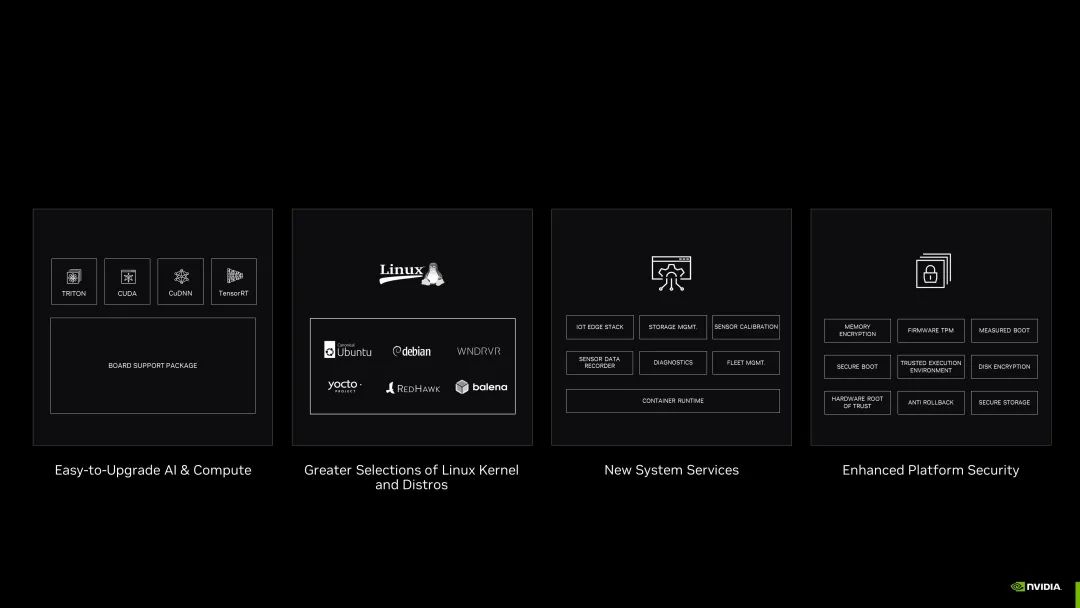

务已应用于边缘。 生成式 AI 正在将 Transformer 模型和大语言模型的强大力量带到各行各业,应用范围现已扩展到边缘、机器人和物流系统相关领域,如缺陷检测、实时资产追踪、自主规划和导航以及人机交互等。 NVIDIA 今日宣布,对适用于边缘 AI 和机器人的 NVIDIA Jetson 平台上的两个框

2023-10-20 02:05:02 320

320

OCI 在业内率先扩展了企业对 NVIDIA DGX 云 AI 超级计算平台和 NVIDIA AI Enterprise 软件的访问权限。 训练生成式 AI 模型变得更容易了。 NVIDIA DGX

2023-10-24 10:30:02 206

206

由 CSDN 举办的 NVIDIA AI Inference Day - 大模型推理线上研讨会,将帮助您了解 NVIDIA 开源大型语言模型(LLM)推理加速库 TensorRT-LLM 及其功能

2023-10-26 09:05:02 174

174 NVIDIA 于 2023 年 10 月 19 日公开发布 TensorRT-LLM ,可在 NVIDIA GPU 上加速和优化最新的大语言模型(Large Language Models)的推理

2023-10-27 20:05:02 478

478

芯片工程师展示了一个高度专业化的行业如何使用 NVIDIA NeMo 来定制大语言模型,以获得竞争优势。 10 月 31 日,NVIDIA 发布的一篇研究论文描述了生成式 AI

2023-11-01 14:45:08 141

141

全新 NVIDIA Spectrum-X 网络平台构筑阿里生成式 AI 云底座。

2023-11-02 09:07:25 300

300

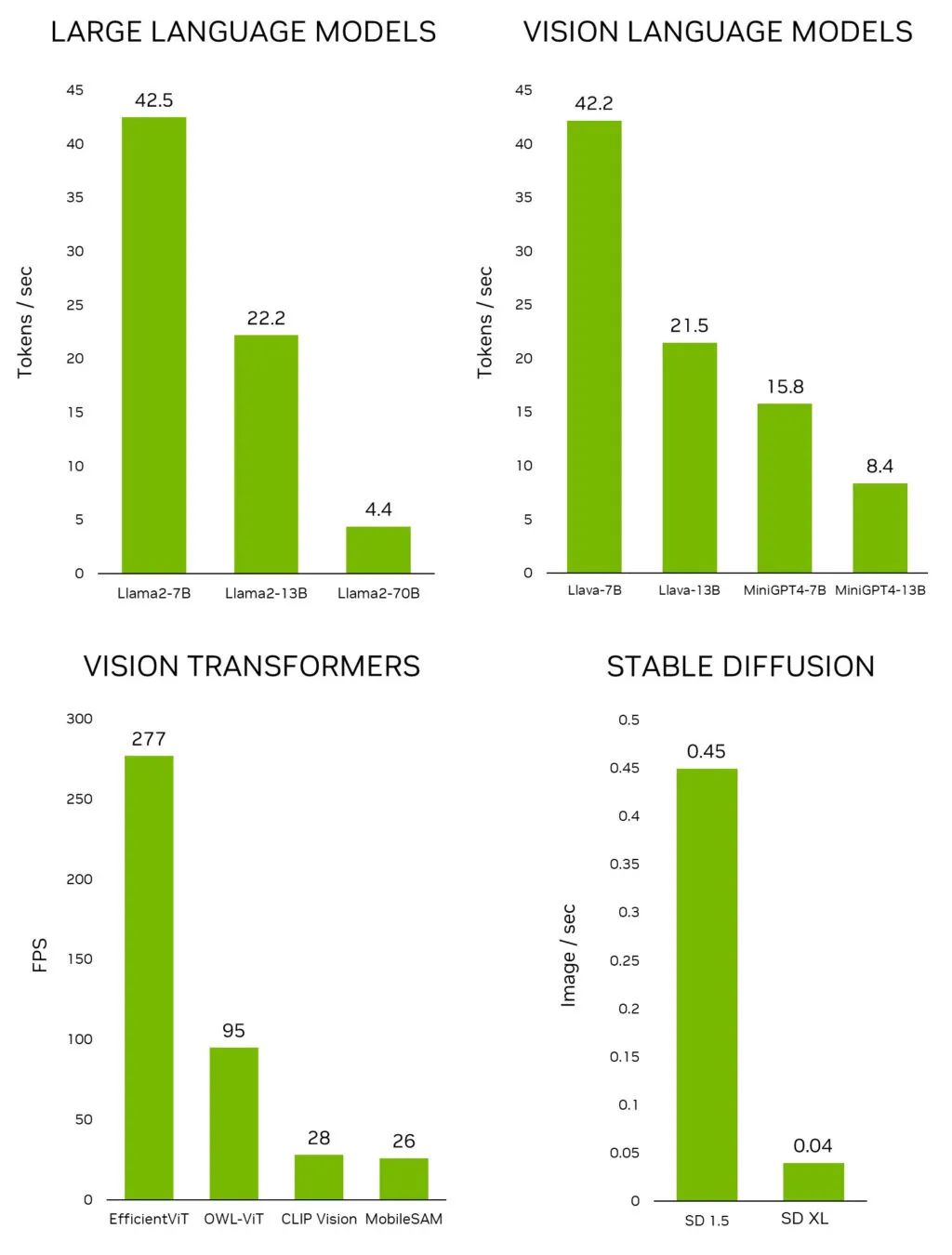

上以交互速率运行的 Llama-2-70B 模型。 图 1. 领先的生成式 AI 模型在 Jetson AGX Orin 上的推理性能 如要在 Jetson 上快速测试最新的模型和应用,请使用 Jetson 生成式 AI 实验室提供的教程和资源。

2023-11-07 21:25:01 398

398

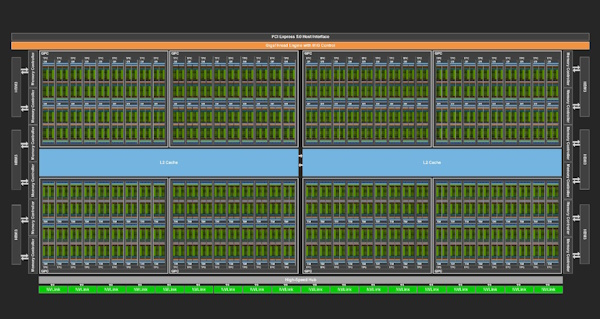

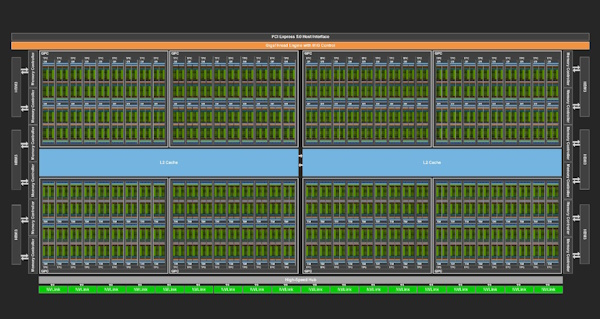

Tensor Core GPU 和领先的显存配置,可处理生成式 AI 与高性能计算工作负载的海量数据。 NVIDIA H200 是首款采用 HBM3e 的 GPU,其运行更快、更大的显存容量将进一步加速生成式 AI 与大语言模型,同时

2023-11-14 14:30:01 85

85

再添新动力。 NVIDIA H200 是首款采用 HBM3e 的 GPU,其运行更快、更大的显存容量将进一步加速生成式 AI 与大语言模型,同时推进用于 HPC 工作负载的科学计算。凭借 HBM3e

2023-11-14 20:05:01 269

269

Models、NVIDIA NeMo™ 框架和工具,以及 NVIDIA DGX™ 云 AI 超算服务三大要素,为企业提供创建自定义生成式 AI 模型

2023-11-16 14:13:08 116

116

AI Enterprise 软件进行部署 NVIDIA 于今日推出一项 AI foundry 服务,助力企业和初创公司在 Microsoft Azure 上开发、调优和部署其自定义生成式 AI

2023-11-16 21:15:02 270

270 的业务数据进行自定义。 如今,免费、开源的大语言模型对企业来说就像是一顿“自助餐”。但对于构建自定义生成式 AI 应用的开发者来说,这顿“大餐”可能会让他们应接不暇,因为他们需要满足各种不同的项目和业务

2023-11-16 21:15:02 312

312

— 太平洋时间 2023 年 11 月 28 日 — NVIDIA 今日宣布推出一项生成式 AI 微服务,支持企业将自定义大语言模型与企业数据相连接,使其 AI 应用能够提供高度准确的响应

2023-11-29 14:37:12 121

121

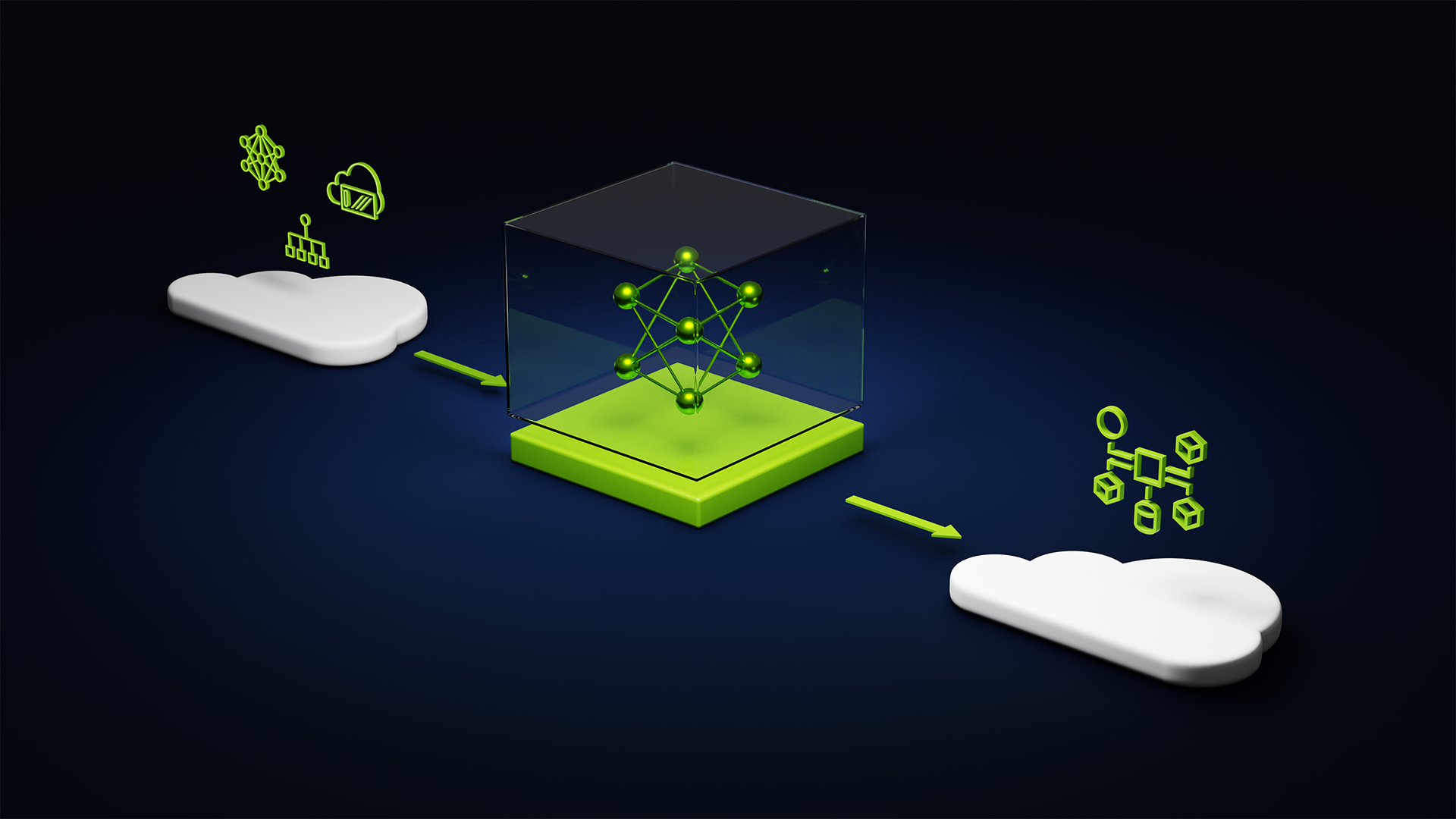

微服务,支持企业将自定义大语言模型与企业数据相连接,使其 AI 应用能够提供高度准确的响应。 NVIDIA NeMo Retriever 是 NVIDIA NeMo (一个用于构建、自定义和部署生成

2023-11-29 21:05:02 340

340 GPU 和海量的数据集上所训练而成。 不过这可能会给想要使用生成式 AI 的企业带来很多巨大的挑战。 NVIDIA NeMo (一个用于构建、自定义和运行 LLM 的框架)能够帮助企业克服上述挑战

2023-11-29 21:15:02 295

295

本文基于亚马逊云科技推出的大语言模型与生成式AI的全家桶:Bedrock对大语言模型进行介绍。大语言模型指的是具有数十亿参数(B+)的预训练语言模型(例如:GPT-3, Bloom, LLaMA)。这种模型可以用于各种自然语言处理任务,如文本生成、机器翻译和自然语言理解等。

2023-12-04 15:51:46 356

356 安霸在CES 2024上发布了全新的N1系列生成式AI芯片,这是一款专门为前端设备设计的芯片,支持本地运行大型语言模型(LLM)应用。其单颗SoC能够支持1至340亿参数的多模态大模型(Multi-Modal LLM)推理,从而实现低功耗的生成式AI功能。

2024-01-09 15:32:54 602

602 NVIDIA 即将推出一项新的生成式 AI 专业认证,助力开发者在这一重要领域证明自身技术实力。

2024-03-14 09:43:34 286

286 NVIDIA 的 AI 平台适用于任何高瞻远瞩的企业使用,而且比以往任何时候都更加易于应用。

2024-03-21 09:39:27 109

109 NVIDIA Isaac 机器人平台利用最新的生成式 AI 和先进的仿真技术,加速 AI 机器人技术的发展。

2024-03-22 10:06:21 56

56

电子发烧友App

电子发烧友App

评论