Microsoft Teams借助AI生成的实时字幕和转录功能,帮助全球学生和职场人士顺利进行在线会议。用于训练的NVIDIA AI计算技术和用于推理语音识别模型的NVIDIA Triton推理服务器进一步提升了这两个功能。

Microsoft Teams 是全球沟通和协作的重要工具,每月有近2.5亿活跃用户。Microsoft Azure 认知服务为Teams提供28种语言的字幕和转录,并将很快能够在NVIDIA GPU上运行关键的计算密集型神经网络推理。

实时字幕功能帮助与会者实时跟踪对话,转录功能方便与会者在日后回顾当时的创意或回看未能参与的会议。

实时字幕对聋哑人、听力障碍者,或者异国与会者特别有用。

NVIDIA Triton开源推理服务软件能够帮助Teams使用认知服务优化语音识别模型。

使用Triton,认知服务能够支持高度先进的语言模型,以极低的延迟实时提供高度准确、个性化的语音转文本结果。同时,可以保证运行这些语音转文本模型的NVIDIA GPU充分发挥其潜力,在消耗更少计算资源的同时,为客户提供更高的吞吐量,进而降低成本。

底层语音识别技术作为认知服务中的一个API,开发人员可以使用它定制和运行自己的应用程序——客服电话转录、智能家居控制或为急救人员提供AI助手。

字字达意的AI

认知服务会生成Teams的转录和字幕,将语音转换为文本,并识别说话人。同时也能够识别专业术语 、姓名和其他会议背景,提高字幕的准确性。

Microsoft Teams的通话、会议及设备首席项目经理Shalendra Chhabra表示:“这样的AI模型非常复杂,需要数千万个神经网络参数才能识别几十种不同的语言。但模型越大,就越难以经济高效地实时运行。”

NVIDIA GPU和Triton软件能够帮助微软在不牺牲低延迟的情况下,通过强大的神经网络,实现高准确性,确保语音-文本的实时转换。

当启用转录功能时,与会者可以在会议结束后轻松补上错过的内容。

Triton三大功能推动效率提升

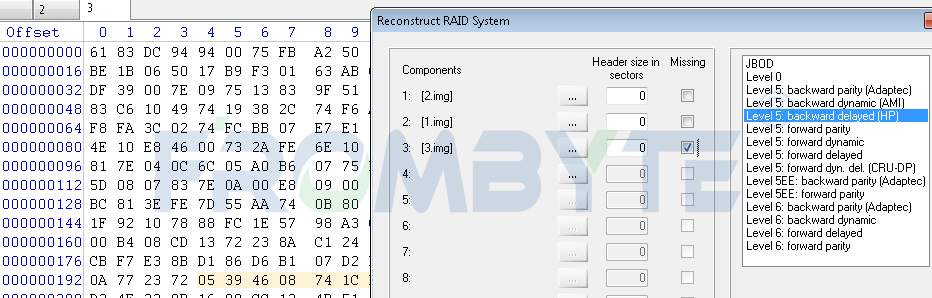

NVIDIA Triton有助于简化AI模型部署,并解锁高性能推理。用户甚至可以为自己的应用开发自定义后端。软件的一些关键功能可将Microsoft Teams的字幕和转录功能扩展到更多会议和用户,包括:

流推理:新型流推理功能——通过跟踪语音上下语境,提高延迟、敏感性字幕的准确度,它助力NVIDIA和Azure认知服务合作定制语音转文本的应用程序。

动态合批:批大小指神经网络同时处理的输入样本数量。通过Triton的动态合批,单项推理请求被自动组合成一个批次,因此能够在不影响模型延迟的情况下更好地利用GPU资源。

并发模型执行:实时字幕和转录需要同时运行多个深度学习模型。Triton使开发人员能够在单个GPU上同时完成这些工作,包括使用不同深度学习框架的模型。

即刻启程,借助Azure 认知服务,在您的应用中使用语音转文本的功能,并进一步了解NVIDIA Triton 推理服务软件如何帮助团队大规模部署AI模型。

NVIDIA 将参加 CES 2022, 并将在 1 月 5 日凌晨 0 点(北京时间)发表 NVIDIA 特别演讲。

NVIDIA GeForce 高级副总裁 Jeff Fisher 和 NVIDIA 汽车部门副总裁兼总经理 Ali Kani 将展示加速计算在设计、仿真、游戏和自动驾驶汽车方面的新突破。

原文标题:Microsoft Azure 认知服务和NVIDIA AI提升Microsoft Teams实时字幕和转录功能

文章出处:【微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

-

NVIDIA

+关注

关注

14文章

5731浏览量

110329 -

服务器

+关注

关注

14文章

10459浏览量

91876 -

智能家居

+关注

关注

1945文章

10058浏览量

198075

原文标题:Microsoft Azure 认知服务和NVIDIA AI提升Microsoft Teams实时字幕和转录功能

文章出处:【微信号:NVIDIA_China,微信公众号:NVIDIA英伟达】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

Supermicro率先发布NVIDIA BlueField-4 STX存储服务器,提升AI推理性能

Microchip推出模型语境协议服务器

ai服务器是什么?与普通服务器有什么区别

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

NVIDIA Triton推理服务器帮助Teams使用认知服务优化语音识别模型

NVIDIA Triton推理服务器帮助Teams使用认知服务优化语音识别模型

评论