出国旅行,多多少少都会被语言问题绊住脚步。想必很多人都遇过这种尴尬时刻:手机没信号、网速卡顿,翻译软件直接罢工,沟通全靠手舞足蹈,干着急又无奈!拥有一款翻译精准,还能在端侧本地运行的翻译模型,和烦恼说拜拜!

腾讯混元将翻译大模型 Hy-MT1.5 压缩至最小 440MB(1.25-bit 模型),轻轻松松装进手机。不仅如此,依托第二代 Arm 可伸缩矩阵扩展 (Arm SME2) 技术加持,推理表现进一步提升,随时随地让你解锁丝滑流畅的端侧翻译体验!

Hy-MT1.5 是腾讯混元团队打造的专业翻译大模型,原生支持 33 种语言,5 种方言/民汉,1056 个翻译方向。为了进一步在有限的手机内存下,实现更好的使用体验,腾讯推出了两种量化压缩方案,以适配不同的手机用户需求。其中,1.25-bit 模型主打极致压缩;而 2-bit 模型则是在性能和质量间取得了出色平衡。2-bit 模型通过采用拉伸弹性量化 (SEQ),并结合量化感知蒸馏,在几乎不牺牲翻译质量的同时,将模型体积压缩至 574MB。此外,得益于 Arm SME2 技术,在支持该技术的移动设备上,2-bit 模型的推理速度更快、运行能效更高,移动端翻译体验夯爆了!

2-bit 模型运行在支持与未支持 SME2 技术的移动设备上的速度对比演示

SME2 作为 Armv9 架构中的一组高级 CPU 指令,专为在端侧直接加速面向矩阵的计算工作负载而设计,使 CPU 能够处理支撑着当今大语言模型等用例的密集数学运算,同时显著降低功耗与延迟。由此打造出可在数十亿台移动设备上运行的更具吸引力、更智能、更直观的应用,并带来切实可量化的提升表现。对用户而言,应用体验将因此变得更加迅捷、本地化且安全可信。SME2 现已应用在多款智能手机上(具体机型详见设备列表),你的手机是否也已搭载了这项技术了呢?

设备列表:https://learn.arm.com/learning-paths/cross-platform/multiplying-matrices-with-sme2/1-get-started#devices

而对于移动端开发者来说,SME2 技术为他们带来了端侧 AI 加速功能,有助于实现更迅捷、更智能的端侧体验,革新移动应用功能。得益于 Arm 的软件加速层 —— Arm KleidiAI,它能够无缝集成到主流运行时库和 AI 框架中,开发者无需改动现有代码、模型或应用,即可直接获取 SME2 带来的性能提升。除此之外,SME2 通过 CPU 实现 AI 加速的标准化,为开发者提供了统一、可移植的移动端 AI 基础,基于 SME2 构建的应用在 iOS 和安卓系统上都能实现一致的性能表现。开发者一次构建应用与工作负载,即可部署至海量基于 Arm 架构的设备上。

端侧 AI 的核心并非单纯为设备堆砌更多智能功能,而是让智能更贴近用户的应用场景,切实升级大家的日常使用体验。一直以来,Arm 与腾讯混元持续依托技术创新,携手推动端侧应用功能与用户体验的优化升级,助力本土开发者更高效、顺畅地开展端侧 AI 创新开发。

端侧 AI 正在重塑移动体验,而 Arm 正是实现这些无缝交互体验的计算基础和强劲驱动力!

-

ARM

+关注

关注

135文章

9596浏览量

393838 -

cpu

+关注

关注

68文章

11336浏览量

226009 -

大模型

+关注

关注

2文章

3805浏览量

5280

原文标题:畅游异国无惧语言!Arm SME2 加速腾讯翻译大模型推理,端侧体验又快又准

文章出处:【微信号:Arm社区,微信公众号:Arm社区】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

利用ExecuTorch和Arm SME2加速端侧机器学习推理

Arm率先适配腾讯混元HY-1.8B-2Bit模型

Arm SME2技术赋能端侧AI加速实现卓越移动端体验

LLM推理模型是如何推理的?

沐曦曦云C500/C550 GPU产品适配腾讯混元开源翻译模型1.5版本

壁仞科技壁砺166M产品适配腾讯混元开源翻译模型1.5版本

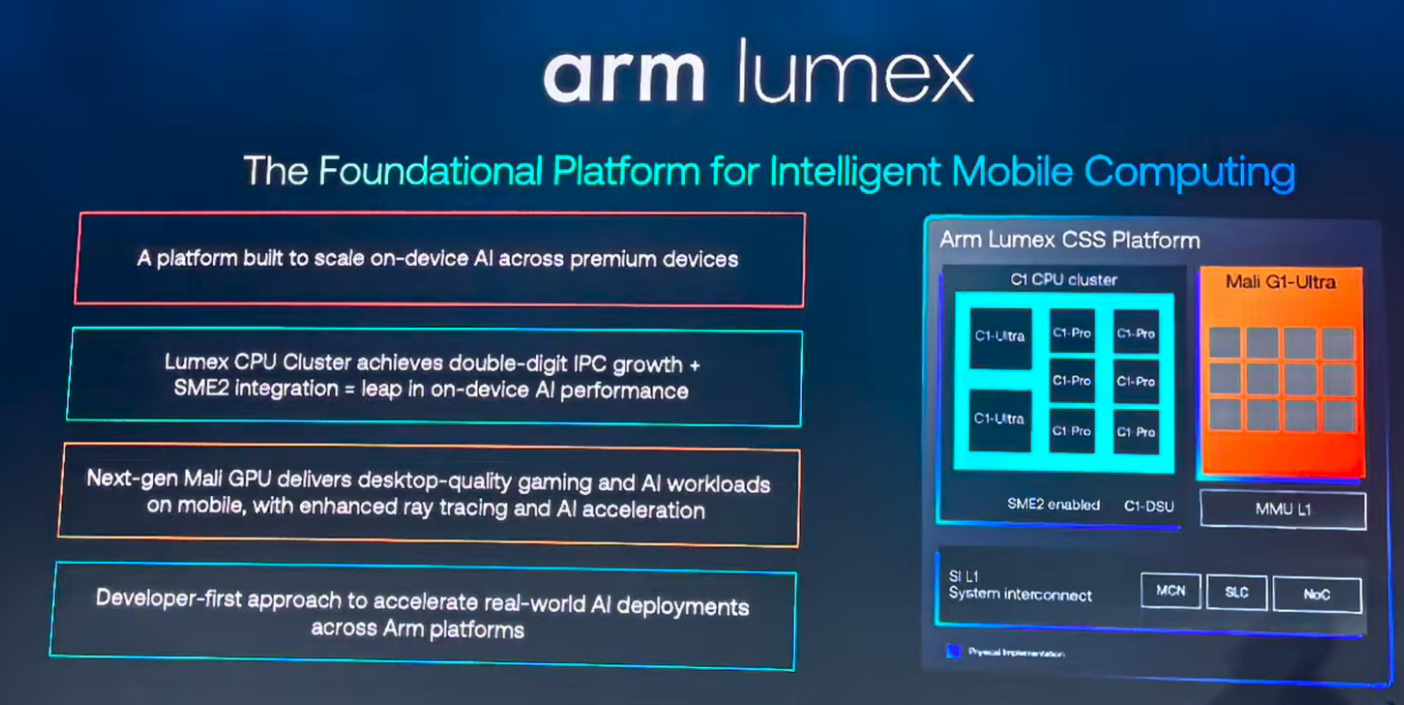

Arm Lumex平台赋能新一代旗舰智能手机体验升级

Arm助力MediaTek天玑9500重塑旗舰体验

什么是AI模型的推理能力

Arm正式取消Cortex命名!CPU向着高算力进发,Lumex CSS平台加持!

全新Arm Lumex CSS平台实现两位数性能提升

Arm率先适配腾讯混元开源模型,助力端侧AI创新开发

Arm SME2技术加速腾讯翻译大模型推理

Arm SME2技术加速腾讯翻译大模型推理

评论