在人工智能技术日新月异的今天,成都华微科技股份有限公司(以下简称“成都华微”)始终站在科技创新的前沿,致力于为全球用户提供前沿的智能解决方案。

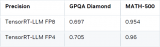

近日,成都华微正在全力推进DeepSeek R1推理模型的在端侧推理芯片部署,这一举措将为边缘和端侧AI应用的商用落地奠定坚实基础。DeepSeek R1推理模型通过优化算法和计算路径,显著降低了大模型的训练成本,并为大模型在边缘设备及端侧的高效部署提供了有力支撑。这意味着,AI技术将能够更快速、更广泛地渗透到各类实际应用场景中,为我们的生活带来前所未有的便捷与智能。

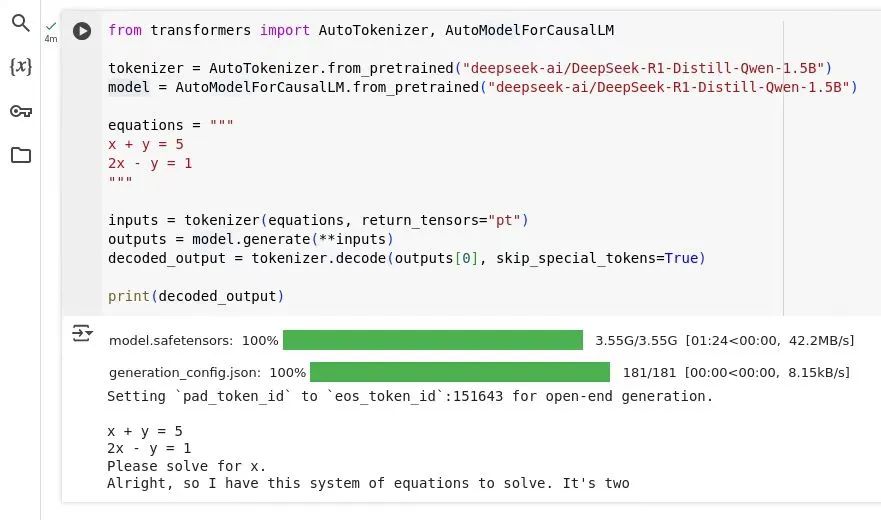

成都华微R1蒸馏测试代码

随着物联网(IoT)和智能设备的普及,边缘计算逐渐成为科技发展的新趋势。公司作为专注于边缘和端侧人工智能处理器开发的企业,DeepSeek R1模型的部署无疑将为我们在这一领域的发展注入新的活力。我们计划继续深入研究DeepSeek Janus-Pro视觉多模态大模型在端侧的部署,为智能机器人、机器狗等方向的智能化赋能,推动AI技术的深入发展。

未来,公司将继续密切关注前沿技术发展趋势,跟进市场及客户需求,适时拓展产品可能的应用场景。

成都华微致力于打造一个多层次、立体化的智能生态,让AI技术更好地服务于人类社会的发展。

-

芯片

+关注

关注

463文章

54463浏览量

469711 -

人工智能

+关注

关注

1821文章

50367浏览量

267060 -

DeepSeek

+关注

关注

2文章

855浏览量

3416

原文标题:成都华微:聚焦AI边缘计算,DeepSeek R1模型部署使得大模型在端侧应用全面加速

文章出处:【微信号:gh_7bc74d60773b,微信公众号:成都华微】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

如何在NVIDIA Blackwell GPU上优化DeepSeek R1吞吐量

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

信而泰×DeepSeek:AI推理引擎驱动网络智能诊断迈向 “自愈”时代

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

成都华微全力推进DeepSeek R1推理模型部署

成都华微全力推进DeepSeek R1推理模型部署

评论