随着人工智能技术的飞速发展,自然语言处理(NLP)领域迎来了革命性的进步。其中,大型语言模型(LLM)的出现,标志着我们对语言理解能力的一次飞跃。LLM通过深度学习和海量数据训练,使得机器能够以前所未有的精度和效率处理和生成自然语言。

LLM的基本原理

LLM基于深度学习技术,尤其是变换器(Transformer)架构。变换器模型因其自注意力(Self-Attention)机制而闻名,这种机制使得模型能够捕捉文本中的长距离依赖关系。LLM通过在大规模语料库上进行预训练,学习语言的通用模式和结构,然后可以在特定任务上进行微调,以适应不同的应用场景。

LLM在自然语言处理中的应用

1. 语言翻译

LLM在机器翻译领域展现出了巨大的潜力。通过学习多种语言之间的对应关系,LLM能够提供高质量的翻译结果。与传统的基于规则的翻译系统相比,LLM能够更好地理解和处理语言的复杂性和多样性。

2. 文本摘要

LLM可以自动生成文本的摘要,无论是提取式摘要还是生成式摘要。通过理解文本的核心内容,LLM能够生成简洁、准确的摘要,这对于信息过载的时代尤为重要。

3. 情感分析

LLM能够识别和分类文本中的情感倾向,这对于客户服务、市场研究和社交媒体监控等领域非常有用。通过分析用户评论、反馈和帖子,LLM可以帮助企业更好地理解客户的情绪和需求。

4. 问答系统

LLM在问答系统中扮演着关键角色,能够理解用户的查询意图,并从大量信息中提取出准确的答案。这种能力使得LLM在智能助手和虚拟客服等领域得到了广泛应用。

5. 文本生成

LLM的文本生成能力使其在创意写作、内容创作和代码生成等领域具有广泛的应用前景。通过模仿训练数据中的模式和风格,LLM能够生成连贯、有趣的文本内容。

6. 语音识别和合成

虽然LLM主要处理文本数据,但其在语音识别和合成领域也有应用。通过与声学模型结合,LLM可以提高语音识别的准确性,并生成更自然、流畅的语音输出。

LLM的优势与挑战

优势

- 高准确性 :LLM通过大量数据训练,能够捕捉语言的细微差别,提供更准确的语言处理结果。

- 灵活性 :LLM可以适应多种语言和领域,具有很好的泛化能力。

- 自动化 :LLM减少了人工干预的需求,提高了处理效率。

挑战

- 数据依赖 :LLM的性能高度依赖于训练数据的质量。数据偏见和不均衡可能导致模型的不公平和不准确。

- 计算成本 :训练和运行LLM需要大量的计算资源,这对于许多组织来说是一个挑战。

- 可解释性 :LLM的决策过程往往是黑箱,缺乏透明度,这限制了其在关键领域的应用。

结论

LLM作为自然语言处理领域的一个突破,已经在多个领域展现出了巨大的潜力。随着技术的不断进步,LLM将继续推动NLP的发展,为人类提供更加智能和高效的语言处理工具。然而,我们也需要关注其带来的挑战,如数据偏见、计算成本和可解释性问题,以确保LLM的健康发展和广泛应用。

-

模型

+关注

关注

1文章

3878浏览量

52352 -

深度学习

+关注

关注

73文章

5614浏览量

124774 -

自然语言处理

+关注

关注

1文章

630浏览量

14763 -

LLM

+关注

关注

1文章

352浏览量

1414

发布评论请先 登录

Google正式发布LLM评测基准Android Bench

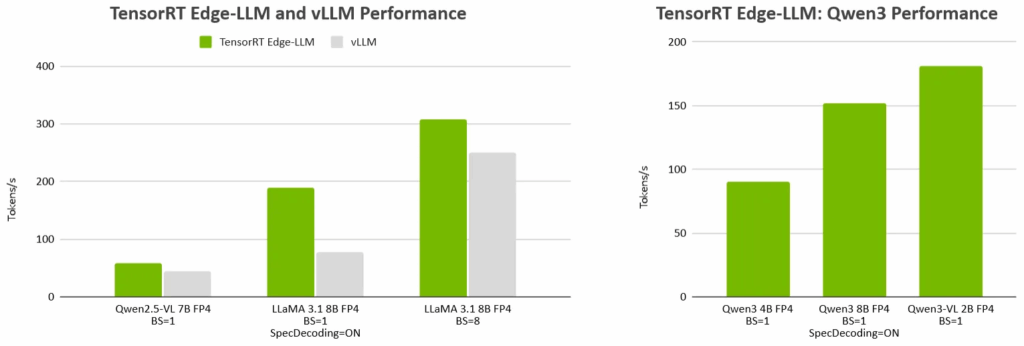

NVIDIA TensorRT Edge-LLM在汽车与机器人行业的落地应用

【CIE全国RISC-V创新应用大赛】+ 一种基于LLM的可通过图像语音控制的元件库管理工具

NVIDIA TensorRT LLM 1.0推理框架正式上线

广和通发布端侧情感对话大模型FiboEmo-LLM

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

TensorRT-LLM中的分离式服务

Votee AI借助NVIDIA技术加速方言小语种LLM开发

如何在魔搭社区使用TensorRT-LLM加速优化Qwen3系列模型推理部署

Qualys TotalAI 降低 Gen AI 和 LLM 工作负载的风险

使用 llm-agent-rag-llamaindex 笔记本时收到的 NPU 错误怎么解决?

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

什么是LLM?LLM在自然语言处理中的应用

什么是LLM?LLM在自然语言处理中的应用

评论