“魔搭社区是中国最具影响力的模型开源社区,致力给开发者提供模型即服务的体验。魔搭社区利用NVIDIA TensorRT-LLM,大大提高了大语言模型的推理性能,方便了模型应用部署,提高了大模型产业应用效率,更大规模地释放大模型的应用价值。”

——周文猛,魔搭社区技术负责人,阿里巴巴通义实验室技术总监

魔搭上线 NVIDIA TensorRT-LLM

支持开源LLM 推理加速

魔搭社区于 2022 年 11 月初创建,首次在业界提出了 “模型即服务” (MaaS, Model as a Service) 的理念。在过去一年半的时间里,MaaS 这一理念不仅实现了技术落地,也被行业广泛接纳,并成为继 IaaS、PaaS、SaaS 服务的又一新的技术范式。

2023 年 7 月,Meta 宣布开源 Llama 2 模型,改变了整个大语言模型 (LLM) 行业的竞争格局。通过繁荣的开源生态,大语言模型迎来了群策群力的技术迭代和突破。

国内外优秀的大语言模型,如 ChatGLM、零一万物、书生·浦语系列、通义千问等,都将魔搭社区作为开源模型首发平台。魔搭社区成为了大模型发展的技术风向标,在中国的开发者群体中,形成了广泛的 “找模型,用模型,上魔搭社区” 的观念认同,从而建成了中国最大开源模型社区。

魔搭社区现在上线了 NVIDIA TensorRT-LLM,TensorRT-LLM 提供了易于使用的应用程序编程接口 (API),以定义和运行大语言模型,支持社区上的各类开源大语言模型 (LLM) 的推理加速。开发者仅通过简短几行代码即可将优化的模型部署到 GPU 上。

目前 NVIDIA TensorRT-LLM 在魔搭社区上已支持的模型类型和推理精度,几乎涵盖了所有主流的大语言/多模态模型以及常用的量化方法,包括 FP32、FP16、BF16、INT8 和 INT4,适用于不同的环境。

LLM 推理面临的挑战

计算资源消耗巨大:开源大语言模型参数规模越来越大,比如 Qwen1.5-110B 参数规模高达千亿级,对计算资源的需求庞大。在没有优化的情况下直接部署,不仅成本高昂,而且对硬件要求高。

推理延迟高:大语言模型的推理时间长,尤其是在实时交互式应用中,如聊天机器人、语音助手等,高延迟会严重影响用户体验。

能效比低:计算密集型工作流意味着更高的能耗,这对于追求绿色计算和可持续发展的现代数据中心而言是一个重要问题。

部署复杂度高:模型优化、适配不同硬件平台、以及持续维护升级等都是挑战,尤其对于非专业用户来说,部署一个高性能的语言模型服务并不容易。

NVIDIA TensorRT-LLM

如何提升 LLM 推理效率

极致性能优化:NVIDIA TensorRT-LLM 是基于 NVIDIA TensorRT API 生态系统构建的,专为大规模语言模型优化的推理引擎。它利用 GPU 的强大并行计算能力,通过算法优化、层融合、量化等技术显著减少模型推理所需的计算量和内存占用,从而提升推理速度,降低延迟。

高效率与低功耗:通过精心设计的优化策略,TensorRT-LLM 能够在不牺牲模型精度的前提下,大幅提高能效比,这对于数据中心的成本控制和环境友好至关重要。

简化部署流程:提供一键式的模型优化与部署工具,简化了从训练到推理的整个流程。即便是复杂的模型结构,开发者也能轻松地将其部署到 GPU 上,大大降低了技术门槛,加速了产品上市时间。

广泛兼容性与可扩展性:支持魔搭社区的多种主流的深度学习框架和开源模型架构,如 Transformer 系列模型。TensorRT-LLM 设计灵活,便于未来适应更多先进的模型技术和算法创新的更新,保持技术领先性。

在 NVIDIA TensorRT-LLM 和NVIDIA Triton 推理服务器的加持下,魔搭社区正在为开发者提供更为全面、高效、快捷的模型推理部署方案。未来,魔搭社区计划将在生成式 AI 的模型和软件加速库层面,与 NVIDIA 相关团队继续开展合作,推动大语言模型的广泛应用和落地。

-

NVIDIA

+关注

关注

14文章

5687浏览量

110113 -

模型

+关注

关注

1文章

3818浏览量

52265 -

LLM

+关注

关注

1文章

350浏览量

1394

原文标题:魔搭社区利用 NVIDIA TensorRT-LLM 加速开源大语言模型推理

文章出处:【微信号:NVIDIA-Enterprise,微信公众号:NVIDIA英伟达企业解决方案】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

Google正式发布LLM评测基准Android Bench

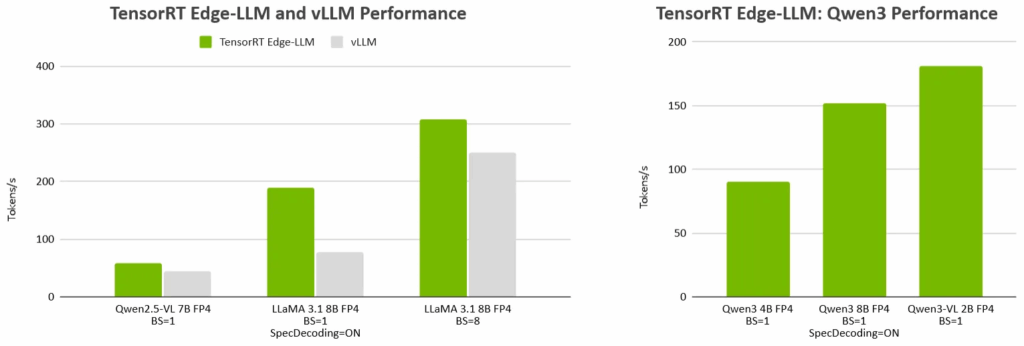

NVIDIA TensorRT Edge-LLM在汽车与机器人行业的落地应用

NVIDIA TensorRT LLM 1.0推理框架正式上线

大规模专家并行模型在TensorRT-LLM的设计

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

TensorRT-LLM中的分离式服务

Votee AI借助NVIDIA技术加速方言小语种LLM开发

如何在魔搭社区使用TensorRT-LLM加速优化Qwen3系列模型推理部署

NVIDIA Blackwell GPU优化DeepSeek-R1性能 打破DeepSeek-R1在最小延迟场景中的性能纪录

使用 llm-agent-rag-llamaindex 笔记本时收到的 NPU 错误怎么解决?

使用NVIDIA Triton和TensorRT-LLM部署TTS应用的最佳实践

魔搭社区借助NVIDIA TensorRT-LLM提升LLM推理效率

魔搭社区借助NVIDIA TensorRT-LLM提升LLM推理效率

评论