北京2023年8月11日 /美通社/ -- 8月10日,在2023年开放计算社区中国峰会(OCP China Day 2023)上,《开放加速规范AI服务器设计指南》(以下简称《指南》)发布。《指南》面向生成式AI应用场景,进一步发展和完善了开放加速规范AI服务器的设计理论和设计方法,将助力社区成员高效开发符合开放加速规范的AI加速卡,并大幅缩短与AI服务器的适配周期,为用户提供最佳匹配应用场景的AI算力产品方案,把握生成式AI爆发带来的算力产业巨大机遇。

当前,生成式AI技术飞速发展,引领了新一轮AI创新浪潮。AI大模型是生成式AI的关键底座,对生产效率提升、传统产业转型升级具有重大的价值潜力,而大模型的高效训练通常需要具备千卡以上高算力AI芯片构成的AI服务器集群支撑。随着生成式AI加速落地,业界对配置高算力AI芯片的AI服务器需求也不断高涨。在此背景下,全球已有上百家公司投入新型AI加速芯片的开发,AI计算芯片多元化趋势凸显。由于缺乏统一的业界规范,不同厂商的AI加速芯片存在显著差异,导致不同芯片需要定制化的系统硬件平台承载,带来更高的开发成本和更长的开发周期。

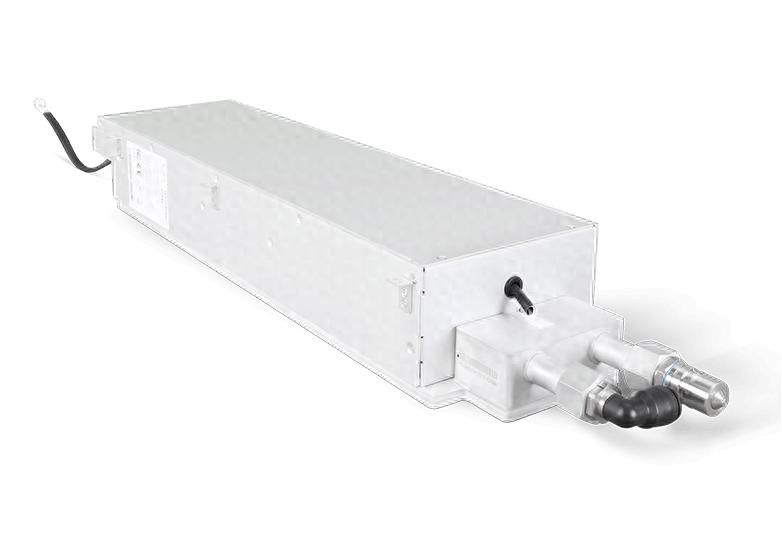

OCP是全球基础硬件技术领域覆盖面最广、最有影响力的开源组织。2019年OCP成立OAI(Open Accelerator Infrastructure)小组,对更适合超大规模深度学习训练的AI加速卡形态进行了定义,以解决多元AI加速卡形态和接口不统一的问题。2019年底,OCP正式发布了OAI-UBB(Universal Baseboard)1.0设计规范,并随后推出了基于OAI-UBB1.0规范的开放加速硬件平台,无需硬件修改即可支持不同厂商的OAM产品。近年来,以浪潮信息为代表的系统厂商研制了多款符合开放加速规范的AI服务器,实现了开放加速AI服务器的产业化实践。

基于在开放加速计算领域的产品研发和工程实践经验,《指南》进一步发展和完善了开放加速规范AI服务器的设计理论和设计方法,提出四大设计原则、全栈设计方法,包括硬件设计参考、管理接口规范和性能测试标准,旨在帮助社区成员更快更好地开发AI加速卡并适配开放加速AI服务器,应对生成式AI的算力挑战。

《指南》指出,开放加速规范AI服务器设计应遵循四大设计原则,即应用导向、多元开放、绿色高效、统筹设计。在此基础上,应采用多维协同设计、全面系统测试和性能测评调优的设计方法,以提高适配部署效率、系统稳定性、系统可用性。

多维协同设计是指系统厂商和芯片厂商在规划初期要做好全方位、多维度的协同,最大化减少定制开发内容。大模型计算系统通常是一体化高集成度算力集群,包含计算、存储、网络设备,软件、框架、模型组件,机柜、制冷、供电、液冷基础设施等。只有通过多维协同,才能实现全局最优的性能、能效或TCO指标,提高系统适配和集群部署效率。《指南》给出了从节点到集群的软硬全栈参考设计。

全面系统测试是指异构加速计算节点通常故障率高,需要更加全面、严苛的测试,才能最大程度降低系统生产、部署、运行过程中的故障风险,提高系统稳定性,减少断点对训练持续性的影响。《指南》对结构、散热、压力、稳定性、软件兼容性等方面的测试要点进行了全面梳理。

性能测评调优是指需要对大模型加速计算系统开展多层次的性能评测和软硬件深度调优。《指南》给出了基础性能、互连性能、模型性能测试的要点和指标,并指出了针对大模型训练和推理性能调优的要点,以确保开放加速规范AI服务器能够有效完成当前主流大模型的创新应用支撑。

审核编辑 黄宇

-

芯片

+关注

关注

463文章

54463浏览量

469679 -

服务器

+关注

关注

14文章

10371浏览量

91773 -

AI

+关注

关注

91文章

41315浏览量

302701 -

算力

+关注

关注

2文章

1697浏览量

16838 -

生成式AI

+关注

关注

0文章

538浏览量

1133

发布评论请先 登录

AI服务器PCBA加工技术解析:高算力时代的核心制造能力

AI算力时代的热挑战:宏展高发热大负载Walk-in试验箱的技术应对

边缘AI算力临界点:深度解析176TOPS香橙派AI Station的产业价值

AI服务器大电流电感选型指南

算力高达 1570 TOPS!支持多硬盘的高算力服务器 CSB2-N10

AI服务器电源测试解决方案:为算力巨擘注入稳定之魂

算力觉醒 · AI共生——上海永铭电子2025AI服务器电容应用专题会议圆满落幕

AI 服务器备用电源:高效、可靠与智能的未来保障

泰克科技解析AI服务器电源架构的技术演进

《开放加速规范AI服务器设计指南》发布,应对生成式AI算力挑战

《开放加速规范AI服务器设计指南》发布,应对生成式AI算力挑战

评论