Colossal-AI的改变:

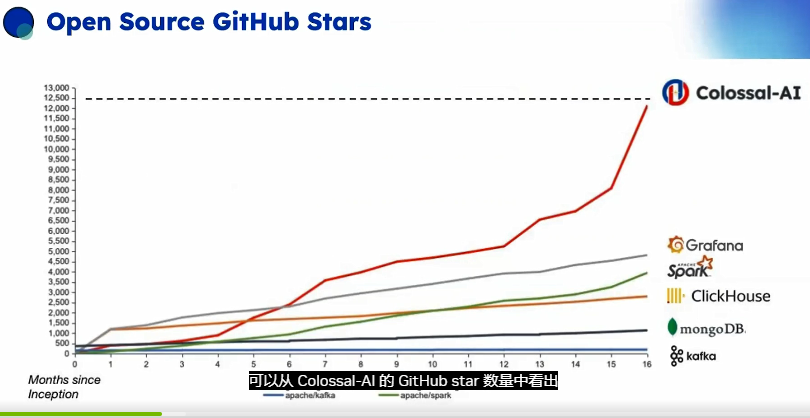

从Colossal-AI的GitHub star数量中看出,这是衡量其开源社区的指标。与其它非常流行的开源系统(如Spark、 MongoDB等)相比,在相同时间内Colossal-AI使用增长速度是最快的。

世界上37个国家的用户正在使用Colossal-AI,还有各种其他人工智能生态系统使用Colsssal-AI。

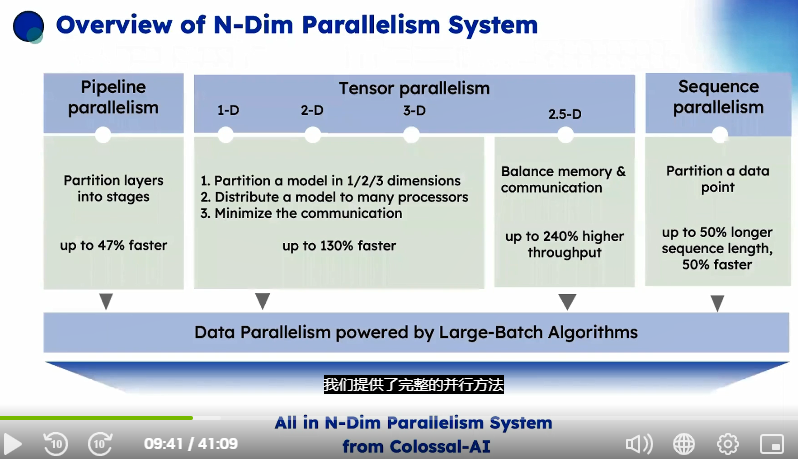

Colsssal-AI的重要功能——N-Dim并行系统

这可以将你的复杂模型可用硬件上,以便最大化使用并行同时最小化通信。

Colsssal-AI提供了完整的并行方法,包括数据并行、张量并行、流水线并行和序列并行,同时还有团队提出的2维、2.5维和3维张量并行以及序列并行。

其中优化了数据并行,可以让你以最小的损失在相当大的规换下训练模型。

大规模优化器如何优化数据并行

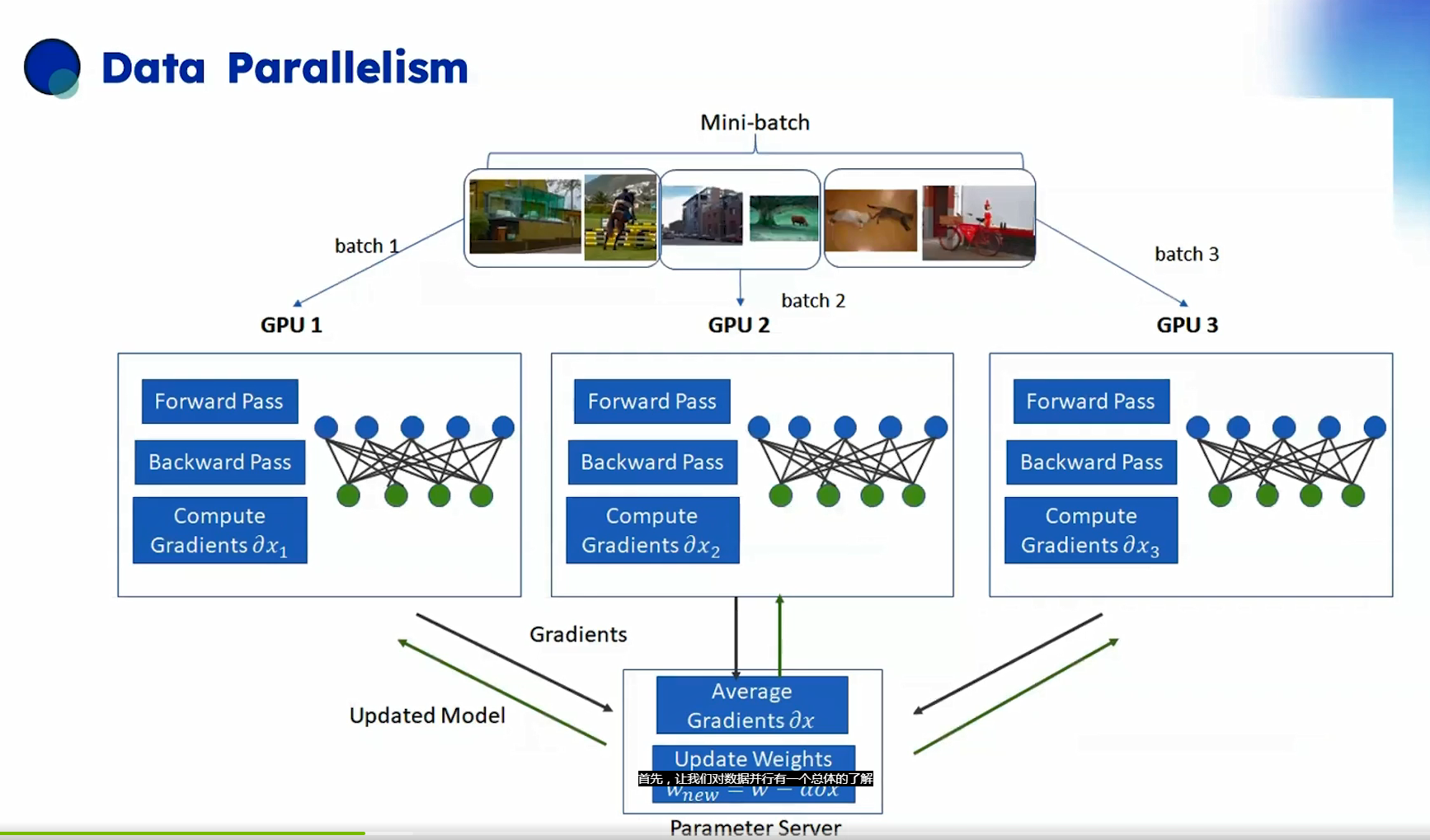

与单个GPU训练相比数据并行训练将整个数据集分为几个分区。

每个GPU拥有1个数据集分区,模型在每个GPU上复制,开在其本地数据集分区进行训练,在反向传播期间计算的梯度,被平均并用于更新模型副本,可以确保在不同GPU之间同步模型。

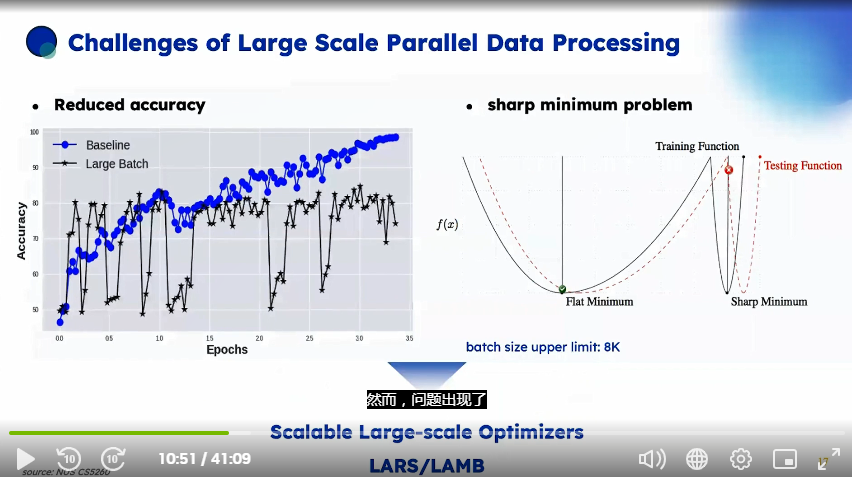

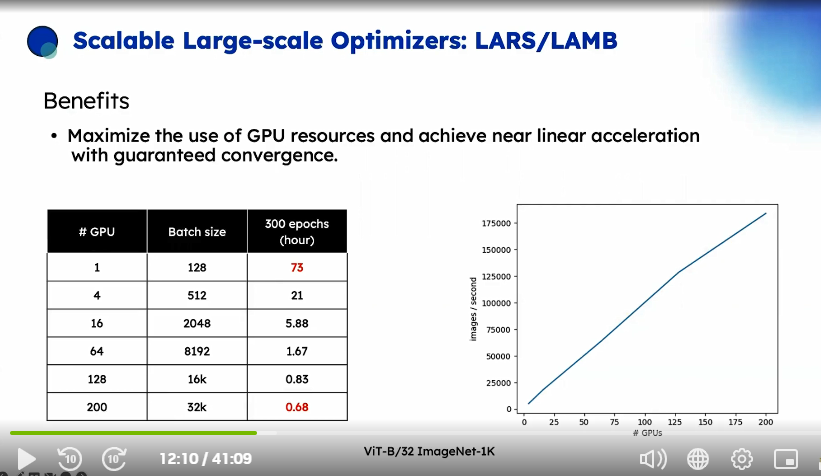

然而,简单的增加批次大小,通常会导致泛化性能下降并降低计算精度。为了解决这些问题,研究出一种新的方法,可扩展的大规模优化器LARS和LAMB,适合大批量设置。

在ViT模型和ImageNet数据集上对可扩展的大规模优化器LARS和LAMB进行理论分析。他们可最大程度使用GPU资源,将ViT-B/32的训练时间从一个GPU的73小时减少到200个GPU的0.68小时,并实现几乎线性增加的加速度,并保证收敛。

编辑:黄飞

-

gpu

+关注

关注

28文章

5266浏览量

136041 -

英伟达

+关注

关注

23文章

4113浏览量

99600 -

深度学习

+关注

关注

73文章

5604浏览量

124610 -

gtc

+关注

关注

0文章

75浏览量

4775

发布评论请先 登录

寻找对RISCV众核并行计算感兴趣的伙伴、朋友

寻找对RISCV众核并行计算感兴趣的伙伴

达索系统于NVIDIA GTC 2026展示AI驱动的虚拟孪生

宜鼎亮相英伟达GTC 2026:智能医疗、智能车载两大亮点,展现技术整合与AI落地实力

研华科技受邀亮相NVIDIA GTC 2026

益登科技携手生态伙伴亮相NVIDIA GTC 2026

慧荣科技于Embedded World 2026展示AI优化的启动存储与企业级解决方案

一文看懂AI大模型的并行训练方式(DP、PP、TP、EP)

GTC 2023|Colossal-AI系统的数据并行优化方案

GTC 2023|Colossal-AI系统的数据并行优化方案

评论