2026年被视为舱驾一体技术规模化量产的“元年”。传统的智能汽车普遍采用“双芯分立”架构,即智能驾驶和智能座舱各用一颗独立的芯片,这导致了硬件冗余、线束复杂和成本高昂。舱驾一体芯片通过“一颗芯片统驭座舱与智驾”,可以大幅减少芯片、内存、散热、PCB板等元器件的数量。成本的降低才能使高阶智驾和智能座舱功能得以快速向10万到20万元主流车型普及。此外,汽车电子电气架构正从“分布式”向“域集中式”再到“中央集成式”演进,舱驾融合是这一进程的必然趋势。

4月25日,芯擎科技发布5nm车规级舱驾融合芯片“龍鹰二号”,龍鹰二号正是为AI舱驾融合而生。该芯片为12核CPU和10核GPU,AI算力高达200 TOPS,内置多核CPU 360KDMIPS,GPU达到2800GFLOPS,原生支持7B+多模态大模型,具备主动意图感知能力,带宽高达518GB/s,支持LPDDR6/5X/5,彻底消除了多屏交互与AI计算的数据瓶颈。

龍鹰二号更像是在把座舱体验做到极致的同时,预留了支持中高阶智驾的能力。龍鹰二号内存带宽高达 518 GB/s,这意味着在驱动多屏交互、运行超大参数座舱AI模型时,数据吞吐更流畅,彻底消除了数据瓶颈。

芯擎科技CEO汪凯博士表示,“龍鹰二号”将推动汽车智能化从“功能驱动”迈向“AI驱动”,加速实现“无AI不座舱”的下一代体验。“龍鹰二号”可覆盖AI座舱、舱驾融合全场景需求,适配主机厂从入门级到旗舰级的中央计算平台演进。这是芯擎基于百万级座舱SoC的量产经验,坚持全域覆盖、平台兼容的产品策略,率先完成对未来中央计算平台需求的战略占位。

龍鹰二号采用柔性架构,可以灵活适配从入门到旗舰的不同平台,对于不想彻底推翻现有架构的车企来说,升级门槛相对较低。

除了龍鹰二号外,芯擎科技将“龍鹰一号”工业级芯片和天工AI加速芯片及全新的SerDes芯片产品线均在北京车展对外展出。据悉,芯擎科技宣布龍鹰二号芯片最快将于2027年第一季度开始适配。

-

5nm

+关注

关注

1文章

343浏览量

26672 -

芯擎科技

+关注

关注

1文章

16浏览量

1362

发布评论请先 登录

国产RK182X算力协处理器 + RK3588实测,大模型“极速流畅”

边缘AI算力临界点:深度解析176TOPS香橙派AI Station的产业价值

算力高达 1570 TOPS!支持多硬盘的高算力服务器 CSB2-N10

算力高达 1100 TOPS!内置 Jetson AGX Orin 模组的高算力服务器

从云端到边缘:联发科MT8371/MT8391平台实现7B大模型本地部署

基于合众恒跃rk3576 开发板deepseek-r1-1.5b/7b 部署指南

MWC Doha 2025|美格智能全新发布60 Tops AI算力、支持Linux系统的SNM982高算力AI模组

国产AI芯片真能扛住“算力内卷”?海思昇腾的这波操作藏了多少细节?

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

基于米尔瑞芯微RK3576开发板的Qwen2-VL-3B模型NPU多模态部署评测

华为宣布开源盘古7B稠密和72B混合专家模型

华为正式开源盘古7B稠密和72B混合专家模型

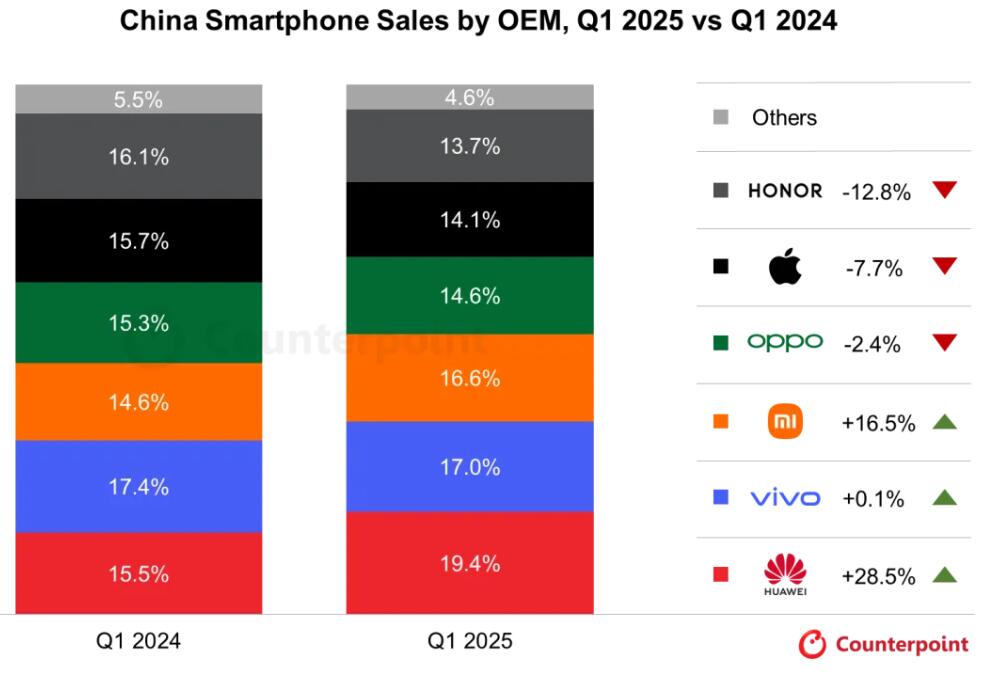

手机AI大模型成焦点,华为领跑Q1中国智能手机市场

芯擎首发5nm“龍鹰二号”! 200TOPS算力+7B大模型,2027年Q1量产适配

芯擎首发5nm“龍鹰二号”! 200TOPS算力+7B大模型,2027年Q1量产适配

评论