在机器学习的世界里,有句老话尤为贴切:“ garbage in, garbage out ”(输入垃圾,输出垃圾)。无论模型架构多先进、算法多精妙,数据的质量始终是决定模型性能的核心。本文聚焦数据处理中两个至关重要的环节——数据验证与数据标记,前者为数据“守门”,后者为模型“立标”,共同筑牢机器学习的根基。

数据验证:为管道装上“过滤网”

你是否遇到过这样的情况:精心训练的模型在新数据流入后突然“失灵”?可能是某列数据类型莫名改变,可能是数值超出了合理范围,也可能是出现了从未见过的分类值——这些“隐形故障”的根源,往往是数据验证的缺失。

数据验证,顾名思义,是确保流入机器学习管道的输入数据干净、完整、符合预期格式的过程。它就像管道前的过滤网,提前拦截“坏数据”,避免其进入下游破坏模型训练或推理,从而减少静默故障、扭曲预测,甚至节省大量调试时间。

为什么数据验证不可或缺?

防止模型漂移:当输入数据因损坏或异常发生变化时,模型会逐渐偏离预期性能,而验证能及时捕捉这种变化。

减少下游调试成本:提前发现数据问题,比等模型出问题后再倒推排查要高效得多。

规避架构 mismatch:在模型重训练或部署前,检查数据 schema(列名、类型、可空性等)是否匹配,避免“牛头不对马嘴”。

提升管道可靠性:稳定的数据输入是建立可信模型的前提,验证让整个流程更可控。

数据验证要“查”什么?

1. 架构一致性:列名是否正确?数据类型(如int、string)是否与预期一致?是否有不该出现的空值?

2. 缺失值:检测异常空值或空白,避免因关键特征缺失导致模型误判。

3. 值范围:数值型特征是否在合理区间内?比如“年龄”出现负数、“概率”超过1,都需要警惕。

4. 类别漂移:分类特征是否出现新类别或丢失旧类别?比如“性别”字段突然出现“未知”,可能影响模型判断。

5. 数据分布:均值、方差、类别平衡是否发生显著偏移?比如二分类任务中正负样本比例从110,模型很可能“跑偏”。

6. 重复与异常值:识别重复记录或离群点,避免它们干扰模型学习规律。

数据验证的实现思路

数据验证的核心是将 “预期规则” 转化为可执行的检查逻辑,具体可根据团队技术栈和数据规模灵活选择方案:

轻量场景:用基础脚本语言(如 Python)编写自定义函数,通过条件判断检查数据是否符合规则(例如用 if 语句检测数值范围、用集合对比检查分类值是否完整)。

中等规模:基于数据处理库封装验证逻辑,例如用 SQL 查询统计缺失值比例、用 Pandas 的 describe () 函数对比数据分布变化,再结合可视化工具(如 Matplotlib)直观呈现异常。

大规模场景:构建分布式验证框架,将规则拆解为可并行的任务,适配海量数据处理(例如通过 MapReduce 思想分散检查压力,再汇总结果判断是否触发警报)。

自动化集成:将验证逻辑嵌入数据管道的关键节点,设置触发条件(如缺失值超过阈值时暂停流程),并联动日志系统记录异常详情,便于追溯。

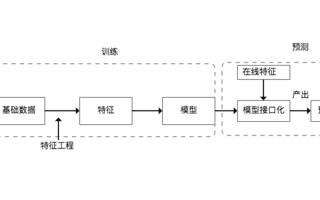

验证环节该“嵌”在哪里?

训练前:在模型学习数据前拦截坏数据,避免模型“学歪”。

推理时:实时验证输入数据,防止异常值导致预测出错。

批处理评分中:大规模预测前确保数据质量,减少无效计算。

数据验证的最佳实践

让验证测试与代码一起版本化,便于追溯和复现。

在CI/CD管道中自动化验证检查,减少人工干预。

明确故障阈值(如缺失值超过5%触发警报)和通知机制。

记录验证结果,方便审计和事后调试。

随着数据变化持续更新验证逻辑(比如新业务场景带来新的类别值)。

数据标记:为监督学习立“标尺”

如果说数据验证是确保“原料合格”,那么在监督学习中,数据标记就是为这些原料“贴标签”——告诉模型“什么是对的”。无论是垃圾邮件检测(“垃圾”vs“正常”)还是欺诈识别(“欺诈”vs“正常”),模型都是通过学习带标签的数据来掌握规律的。

但标记工作往往成本高、耗时长,还容易出现不一致(比如两个标注者对同一段文本的分类不同)。一套合理的标记策略,能在保证质量的同时提升效率,直接影响模型性能和项目进度。

- 为什么数据标记很关键?

标签定义了模型要学习的“真相”(ground truth),是模型训练的“标尺”。

标记质量差会导致模型“困惑”,预测结果杂乱无章。

高质量标签能减少对复杂算法的依赖——简单模型+好标签,往往比复杂模型+差标签效果更好。

高效的标记流程能加速模型迭代,让团队更快验证想法。

- 常见的标记方法有哪些?

1. 手动标记:由领域专家或众包人员逐一对数据贴标签,精度高但成本也高。

2. 程序化标记:用规则、启发式方法或正则表达式自动生成标签(比如“包含‘免费领取’的邮件标记为垃圾邮件”)。

3. 弱监督:结合多个噪声标签源(如规则、启发式、低质量标注),用概率模型(如Snorkel)生成更可靠的标签。

4. 主动学习:让模型自己“挑”出不确定的样本(如预测概率接近0.5的样本),只让人工审核这些难例,节省成本。

5. 预训练模型辅助:用在类似任务上训练好的模型生成“伪标签”(pseudo-labels),再人工校正,快速启动新数据集。

- 不同场景该选哪种方法?

当精度至关重要时(如医疗诊断、法律文本分类),优先用手动标记。

处理大规模未标记数据且需要快速扩量时,选程序化标记或弱监督。

标记预算有限、追求效率时,主动学习能让每一分钱花在“刀刃”上(只标记最有价值的样本)。

需快速搭建新数据集时,用预训练模型生成伪标签能大幅缩短启动时间。

- 标记项目的最佳实践

制定清晰的标记指南,附具体示例(比如“什么情况下算‘欺诈’?举3个例子”),减少标注者理解偏差。

让多个标注者标注同一批数据,计算“标注一致性”(inter-annotator agreement),不一致的样本需二次审核。

定期抽查已标记样本,确保质量稳定(比如每标记1000条数据随机抽50条检查)。

从小规模标记开始,基于模型反馈迭代优化标签(比如模型总错分某类样本,可能是标签定义不清)。

简单案例自动化标记,只手动审核边缘案例(比如模糊不清的文本或图像)。

- 标记流程的搭建要点

构建高效的标记流程,核心是平衡 “质量” 与 “效率”,可从以下几个方面着手:

规则标准化:提前定义标签体系(如标签层级、边界条件),编写详细的操作手册,对标注者进行统一培训,减少主观偏差。

工具轻量化:根据数据类型(文本、图像、音频等)选择或搭建简单工具,例如用 Excel 表格标记结构化数据、用网页表单标记文本分类,避免因工具复杂降低效率。

质量监控机制:通过 “抽查 + 反馈” 闭环提升质量,例如随机插入已知标签的样本(“校验题”),若标注者错误率超过阈值则暂停工作并重新培训。

迭代优化:定期用标记数据训练模型,分析错误样本的标记是否存在问题(如标签冲突、定义模糊),反向优化标记规则。

协作分工:将标记任务拆解为 “初标 - 审核 - 校正” 环节,由不同人员负责,例如初级标注者处理简单样本,专家审核复杂样本,形成流水线作业。

机器学习的 pipeline 中,数据验证和数据标记是前后衔接的“质量双关”:验证确保数据“合格入场”,标记为模型“明确目标”。无论是处理百万级数据还是小规模样本,重视这两个环节,才能让模型在复杂的真实世界中保持稳定和可靠。

毕竟,模型的能力边界,永远由它所“见”的数据质量决定。

详细的标记规则和示例,减少歧义

多人标注校验:使用多个标注者并测量标注一致性,降低个体误差

定期质量审计:随机抽查已标记样本,确保长期质量稳定

迭代式标记:从小规模样本开始,根据模型反馈逐步扩展

自动化 + 人工结合:简单案例自动标注,仅手动审核边缘案例

机器学习的成功从来不是单一环节的胜利,而是数据全流程质量管控的结果。数据验证确保 “输入干净”,数据标记确保 “目标清晰”,二者共同构成了模型性能的基石。

无论是处理百万级数据集还是小规模专项任务,重视数据验证与标记策略,才能让你的机器学习项目在效率、质量与成本之间找到最佳平衡点,最终构建出真正可靠且高性能的模型。

本文转自:善思开悟科技

本文内容经过翻译、整理,文章来源于Medium,作者Sopan Deole,旨在分享信息传播价值,非商用目的。如有不妥请联系我们,将立即处理。

-

人工智能

+关注

关注

1820文章

50325浏览量

266952 -

机器学习

+关注

关注

67文章

8565浏览量

137224

发布评论请先 登录

基于多模态特征数据的多标记迁移学习方法的早期阿尔茨海默病诊断

多标记学习的分类器圈方法

谈谈四个无法从学校或各种线上平台学习到的机器学习技巧

如何从各种来源获取数据并将其输入到机器学习模型中以预测流量

详谈机器学习模型算法的质量保障方案

机器学习中的数据质量双保障:从“验证”到“标记”

机器学习中的数据质量双保障:从“验证”到“标记”

评论