[首发于智驾最前沿微信公众号]就在前一段时间,某品牌车语音控制灯光失误的视频在网上疯传,在深夜的高速公路上,车主只是随口说了一句“关闭所有阅读灯”,想要调暗车内光线。然而,车载语音系统却出现了一次致命的误判,它不仅关掉了车内的阅读灯,连带着车头最关键的大灯也一并熄灭。驾驶员在惊恐中连声呼喊“打开灯光”,但伴随着车辆撞上护栏撞击声外,只传来语音助手那温柔却又无比机械的回复:“暂时还不会哟”。

这起事故之所以引发全网热议,除了发生事故外,更多是因为它精准地击中了人们对“软件定义汽车”时代的某种担忧。当车内的物理按键消失,当灯光、空调甚至挡位都交给一串代码和那个看起来聪明的语音助手时,我们真的更安全了吗?语言模型对于自动驾驶和智能座舱来说,到底是必不可少?还是一个华丽装饰?

为语音助手有时会显得有点“聋”?

为什么在家里能听懂你讲冷笑话的AI,到了高速公路上有时就成了“半个聋子”。车内其实是一个杂音非常多的环境。当车速达到一百公里每小时,轮胎摩擦地面的胎噪、划破空气的风噪,以及发动机或电机的高频振动会混合成一种巨大的背景噪音。

对于人类耳朵来说,我们有一套极其精密的滤波机制,能自动把同伴的说话声从噪音中拎出来。但对车载麦克风来说,它接收到的是一个混杂了各种波形的信号。

在这次的事故视频中,车主发出的指令是“关闭所有阅读灯”。从普通话的发音和语义向量来看,“阅读灯”和“全车灯光”在某些解析算法里可能非常接近。特别是在高速行驶的背景噪音下,声音的特征码会发生扭曲。

图片源自:网络

语音识别系统(ASR)可能在第一步就把“阅读”这两个字的特征给弄丢了,只剩下一个“灯”字和“关闭”的动作。接着,自然语言理解(NLU)模块就会根据概率去猜,最后它猜出了一个权重最高的动作,即关闭所有灯光。

其实在整个视频中,最后一句“暂时还不会哟”的回复最耐人寻味。这其实反映出了当前车载语音系统的另一个技术软肋,在极端压力下的识别能力。当灯光熄灭、生死攸关时,车主会产生剧烈的生理反应,呼吸急促、音调升高、语速极快。

传统的语音模型是基于平稳、冷静的语音库训练出来的,它们面对这种充满了恐慌情绪的“求救信号”,会因为置信度太低而触发预设的兜底回复。这种预设回复本是为了显得有亲和力,但在那个瞬间,它却显得有些不合时宜。

说到底,目前的语音助手还是一个坐在副驾上的“翻译官”,它只是在翻译指令,而没有真正理解这些指令对于一个正在高速移动的车辆意味着什么。

| 场景 | 背景噪音水平 | 语言特征 | 容错处理要求 | 核心挑战 |

| 居家办公 | 较低(30~40dB) | 语速平缓,日产词汇 | 较低,可重复输入 | 远场拾音与回声消除 |

| 喧闹商场 | 中高(60~70dB) | 碎片化、方言多 | 中等,会有提示 | 杂乱的人声干扰 |

| 高速行驶 | 极高(70~85dB) | 压力状态下语速极快 | 极高,涉及行车安全 | 宽频噪音掩盖,情绪特征畸变 |

域隔离的崩塌与消失的保命按键

很多人不理解,既然语音助手可能听错,那为什么它能有权限直接关掉行驶中的大灯?这其实涉及到了一个汽车电子架构的专业概念,域隔离。一辆汽车的电子系统通常被划分为不同的“域”,比如负责娱乐、导航、语音的座舱域;负责灯光、雨刷、车窗的车身域以及负责动力和制动的底盘域。

按照安全逻辑,座舱域应该只是一个多话的导游,它不应该有权直接插手驾驶员的“方向盘”和“外灯光”。

然而,为了追求所谓的“全智能交互”,让车主动动嘴就能控制车内的一切,厂家会在座舱域和车身域之间开辟一条通信快速通道。这次事故其实就暴露出这条通道在权限管理上存在巨大的安全风险。

原本属于高安全等级的大灯控制权,被过于随意地交给了低安全等级的语音识别模块。在汽车功能安全标准ISO 26262中,这属于严重的逻辑缺陷。在车辆处于高速行驶状态下,系统不仅没有对“关闭大灯”这种危险指令设置二次确认,甚至没有对车速、环境光线和大灯状态进行联合校验。

这种“极简主义”的代价是沉重的。随着物理按键的消失,驾驶员在失去视觉引导时,无法再依靠肌肉记忆通过拨杆打开灯光。事故后,该车企紧急推送了OTA更新,将行驶状态下的大灯关闭权限修改为“仅支持手动控制”。

图片源自:微博

这其实是一种权力的收回。它说明在现有的技术条件下,非确定性的语音交互不应拥有管理安全核心件的最高权限。那些被网友称为“保命按键”的物理拨杆,提供的是一种超越软件算法的物理确定性。在生死瞬间,确定性比所谓的智能更重要。

语言模型是自动驾驶的解药还是毒药

既然传统的语音系统容易听错,那最近大热的大语言模型(LLM)能解决这个问题吗?在自动驾驶领域,专家们经常提到“系统1”和“系统2”。系统1是直觉性的、快速的,就像我们开车时的肌肉记忆,看到红灯就刹车;系统2是理性的、慢速的,用来处理复杂的博弈和意料之外的状况。

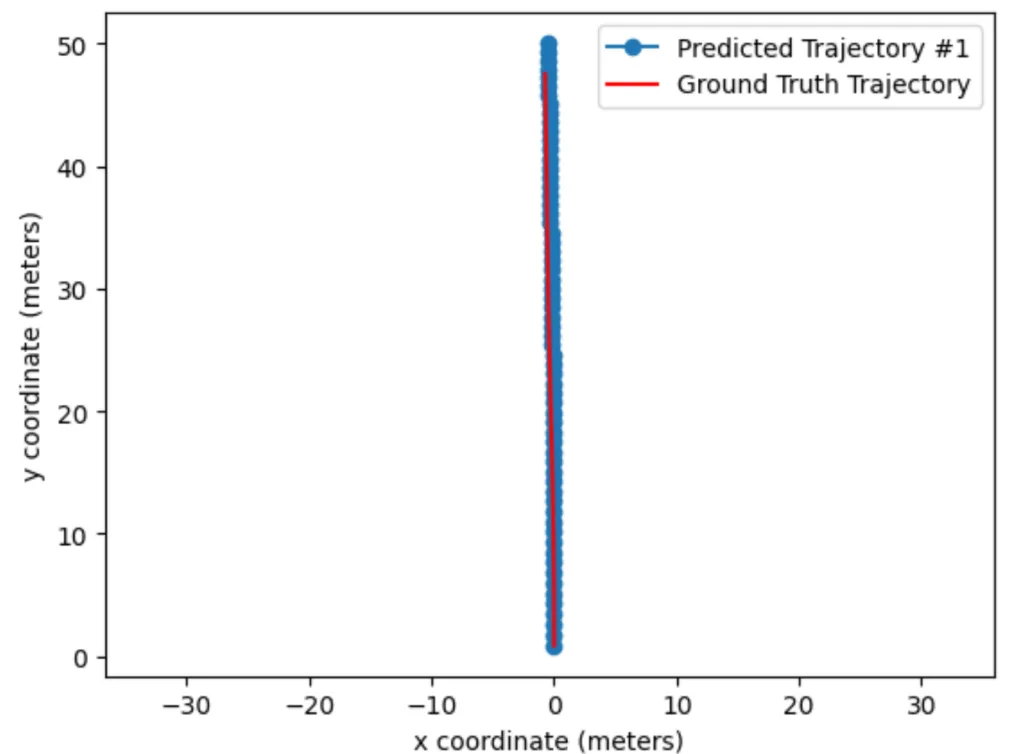

目前的自动驾驶和语音助手大多还在系统1的水平。它们是在死板地匹配关键词。如果你说“关掉阅读灯”,它就去匹配那几个字,一旦听错就全盘皆错。而大模型的意义在于它为汽车装上了一个具有常识推理能力的“系统2”。如果是搭载了大模型的系统,在听到“关闭所有灯光”时,它的第一反应不是去执行,而是进行逻辑自检。

图片源自:网络

它会调动视觉传感器发现现在是深夜,GPS会告诉它正在高速上,它的常识库会提示它,在深夜的高速上关掉大灯是自杀行为。于是,它会拒绝执行这个离谱的指令,或者用更有逻辑的方式向车主确认。

这种能力被称为“多模态理解”。未来的语言模型不再仅仅是处理文字,它会将视觉(摄像头看到的黑夜)、动作(正在高速行驶的速度)和语义(车主的要求)结合在一起。这就是大家熟知的VLA(视觉-语言-动作)模型。

但大模型也并非完美。它最大的问题在于“幻觉”。大模型本质上是一个概率预测器,它吐出的每一个指令都是基于统计的最大可能性,而不是逻辑上的绝对必然。

对于驾驶来说,哪怕只有万分之一的概率出现幻觉,都是不可接受的。所以,大模型在车上的应用,目前更多是作为一个“大脑”去思考,而真正的“手脚”控制依然需要严密的硬性代码逻辑来把关。

如何在软件定义的未来里守住安全的底线

要确保语音识别的准确性和安全性,我们不能只指望AI变得更聪明,还要在系统架构上做加法。硬件层面的冗余是非常有必要的,比如通过多麦克风阵列的波束成形技术,像探照灯一样定向采集驾驶员的声音,以此来抵消外界的宽频噪音。同时,核心指令的解析必须具备“离线处理”能力,不能因为隧道里没信号,就无法应答和处理。

更核心的改进应该是语义校验机制的引入。一个合格的智能座舱,不应该只是听话的助手,而应该是有安全底线的管家。系统需要建立一套基于场景的“敏感指令库”。在高速行驶、雨雪天气或夜间等特定场景下,所有涉及车辆行驶安全的功能(如大灯、驻车制动、车门开启等),语音助手的权限就应该是被锁定的,或者必须经过物理确认。

此外,我们还必须认识到,智能化的目的应该是减少人为失误,而不是增加新的风险。当车企在追求智能座舱的智能化时,不能忘了汽车只是一种交通工具,其最底层的逻辑永远是安全。语言模型确实是未来自动驾驶通往“拟人化”的桥梁,但在桥梁搭建好之前,物理拨杆依然是科技给予我们的最后一份体面。

最后的话

科技进步不应该是一场博取流量的冒险。正如许多老司机所言,最好的科技应在平时让你感觉不到它的存在,但在危急时刻能给你最确定的响应。在追逐智能化的浪潮中,我们不能跑得太快。大模型很好,语音控制也很酷,但在那个能让我们抓牢的物理拨杆面前,它们暂时还只能算是助手,而不是主宰。

审核编辑 黄宇

-

智能驾驶

+关注

关注

5文章

3040浏览量

51376 -

语言模型

+关注

关注

0文章

575浏览量

11341

发布评论请先 登录

人工智能多模态与视觉大模型开发实战 - 2026必会

理想汽车发布下一代自动驾驶基础模型MindVLA-o1

如何构建适合自动驾驶的世界模型?

黑芝麻智能华山A2000 BaRT工具链助力辅助驾驶模型部署

基于NVIDIA Alpamayo构建具备推理能力的辅助驾驶汽车

VLA与世界模型有什么不同?

VLA和世界模型,谁才是自动驾驶的最优解?

自动驾驶中常提的世界模型是个啥?

AUDI携手Momenta打造豪华智能辅助驾驶新范式

如何借助大语言模型打造人工智能生态系统

智能驾驶真的需要语言模型吗?

智能驾驶真的需要语言模型吗?

评论