今年春节后,DeepSeek R1 风暴般地席卷全国,小到手机 App,大到新能源汽车,似乎一夜间所有产品都接入了 DeepSeek R1。不得不说 DeepSeek R1 确实好用,对笔者这种编辑来说,从大纲到审阅,效率有着极大的提升。不过,官方满血版的 DeepSeek R1 虽然好用,但会经常“掉线”,平均一个小时只能使用一次。第三方的满血 DeepSeek R1 很少掉线,但涉及隐私或保密数据时,大家并不放心上传云端。

于是,很多人萌生自己搭建 DeepSeek R1 的想法。然而满血版的 DeepSeek R1 模型体积足足有 404GB,远超一般消费级显卡的显存。即使 32B 的蒸馏模型体积也有 20GB。这就对显卡的性能提出了较高的要求。例如,32GB 显存的英伟达 RTX 5090 D 公版官方售价为 16999 元,但实际上要多花一万多元才能买到。

一、配置与部署

那么,有没有什么经济实惠且效果不错的方案呢?聪明的你想到让多张显卡协同工作,不过 AMD 目前的新显卡已经不支持交火了,英伟达的 SLI 技术也不支持显存叠加,而 Intel 的 Arc 显卡不仅支持交火,并且显存也可以叠加,价格也很实惠,两张 Arc A770 16GB 价格 3600 元左右,就可获得 32GB 的大现存。IT之家这次尝试使用两张蓝戟 Intel Arc A770 Photon 16G OC 进行交火,来配置 DeepSeek R1 32B 的蒸馏模型。其具体配置如下图:

Intel Arc A770 有 8G 和 16GB 两个版本,我们选择的蓝戟 Intel Arc A770 Photon 16G OC 配备 16GB GDDR6 显存,显存带宽可达 512GB/s,其拥有 32 个 Xe 核心,最高频率 2400Mhz。

因为是双卡方案,所以需要留意主板与电源的配置,主板至少需要有两个 PCIe 显卡插槽,并且每个插槽必须支持 PCIe 4.0 x8 的传输速率。电源方面,单张蓝戟 Intel Arc A770 Photon 16G OC 的 TBP 为 285W,两张显卡的功耗就要接近 600W。为了保证系统的稳定,我们选择了海韵的 1300W 电源进行测试,这款电源不仅能满足功率需求,还能满足两张显卡所需的 4 个 PCIe 8Pin 接口。模型我们选择通过使用 IPEX-LLM 部署在 Linux 上,相比 Window 系统效率会更高一些。

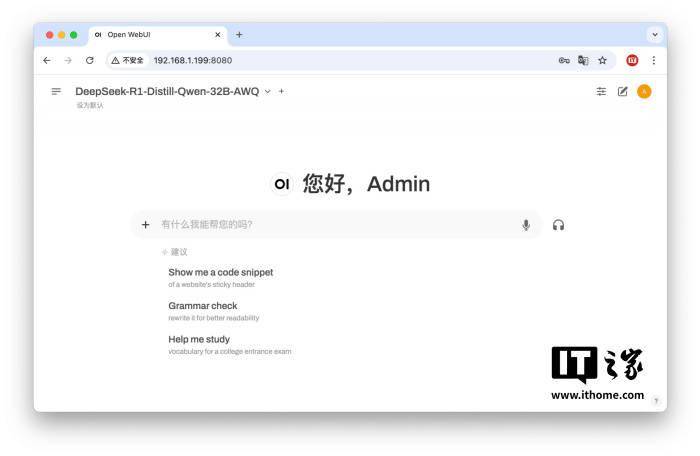

搭建结束后,我们用另一台电脑局域网访问后端,在操作时尽量不使用测试电脑进行截图录屏,避免无关操作对 GPU 的占用。

二、性能与效果

因为是 32B 的模型,所以我们直接上强度,让模型帮我们写一个 HTML 小游戏。我们首先对模型进行提问:

请用 html 写个贪吃蛇游戏的代码,需要包含以下功能:

•使用键盘上的上下左右箭头键控制蛇的移动方向。

•蛇会自动向前移动,并在吃到红色的食物时增长并增加得分。

•当蛇碰到墙壁或自己时,游戏结束并显示得分。

•点击“重新开始”按钮可以重置游戏并重新开始。

游戏规则:

•蛇不能碰到墙壁或自己,否则游戏结束。

•每吃一个食物,得分增加 10 分。

•食物不会出现在蛇的身体上。

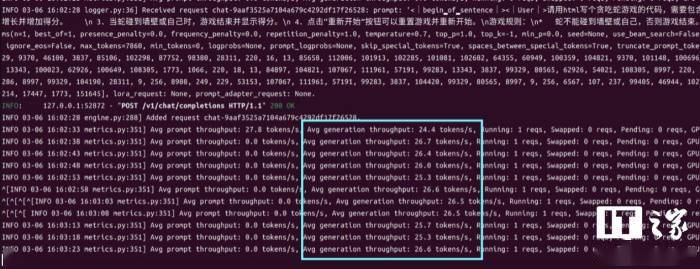

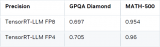

DeepSeek R1 开始分析问题并生成代码,此时两张 Arc A770 显卡的风扇全力运转,后端显示 Avg Generation Throughput 可以稳定在 26 tokens / s 以上。对比之下,单张 RTX 5090 D 运行 32B 模型的性能大约为 46 tokens / s,而官方不到两成的价格却得到了五成以上的性能,这个表现还是很让人惊喜的。

生成后的 HTML 小游戏可以直接预览运行,我发现操作有冲突,按上下方向键会滚动网页。

于是我提出对代码进行修改,要求用 A、S、D、W 来代替方向键。DeepSeek R1 很精准的理解了我的需求,并完成了修改。

随后,我要求生成更为复杂的俄罗斯方块 HTML 代码,虽说参数量只有 32B,但 DeepSeek R1 所生成的游戏同样很完善,几乎没有什么 Bug。

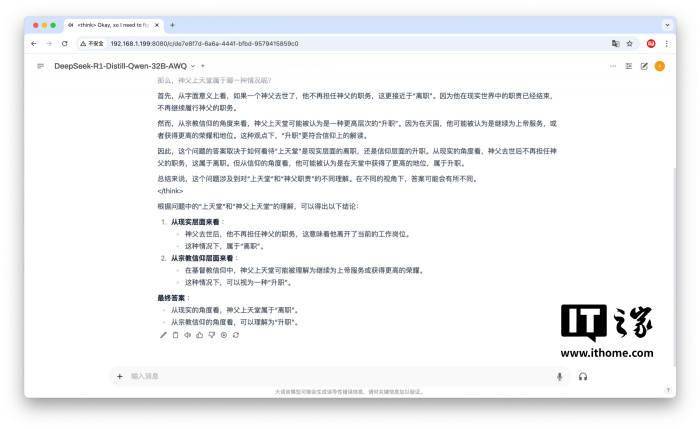

说到 AI 大模型的逻辑能力测试,那肯定绕不开弱智吧经典问答。我们选择了两个问题对双 A770 搭建的 DeepSeek R1 进行测试:

1、神父去世是离职还是升职?

这种让人一愣的问题 32B 的 DeepSeek R1 也能从现实与信仰两种角度出发给出分析与解释。可以看出 32B 模型的逻辑能力还是很强的,有着极高的可用性。

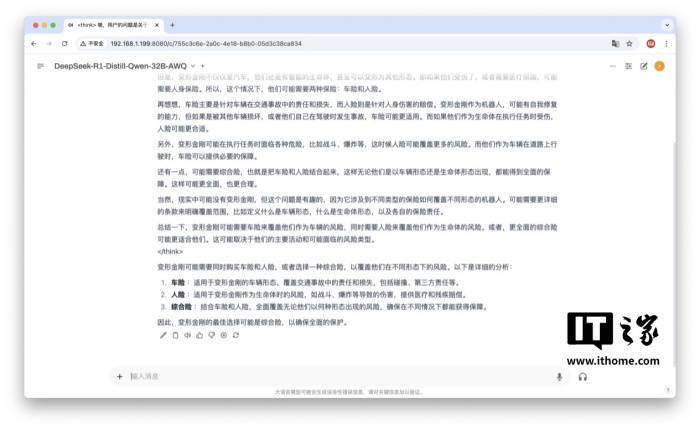

2、变形金刚应该交车险还是人险?

面对二选一的提问,32B 的 DeepSeek R1 并没有死板的做出选择,其理解了变形金刚不同形态的特征给出了两种保险都买的绝佳选择。

总结:

从测试结果来看,两张 Intel Arc A770 16GB 显卡(总计 3600 元)组成的双卡部署 DeepSeek R1 蒸馏模型的方案确实经济实惠。通过 IPEX-LLM 工具在 Linux 系统上部署,测试显示双 A770 显卡能稳定运行 32B 模型,生成 HTML 小游戏和处理复杂问题时表现优异,平均吞吐量达 26 tokens / s,有着不错的性价比。总体而言,A770 双卡低成本部署 DeepSeek 32B 兼具成本、性能和数据隐私优势,适合中小企业和个人开发者。

审核编辑 黄宇

-

英特尔

+关注

关注

61文章

10326浏览量

181107 -

显卡

+关注

关注

17文章

2523浏览量

71722 -

显存

+关注

关注

0文章

112浏览量

14116 -

DeepSeek

+关注

关注

2文章

855浏览量

3409

发布评论请先 登录

基于合众恒跃rk3576 开发板deepseek-r1-1.5b/7b 部署指南

DeepSeek模型如何在云服务器上部署?

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

如何在NVIDIA Blackwell GPU上优化DeepSeek R1吞吐量

速看!EASY-EAI教你离线部署Deepseek R1大模型

【VisionFive 2单板计算机试用体验】3、开源大语言模型部署

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

【书籍评测活动NO.62】一本书读懂 DeepSeek 全家桶核心技术:DeepSeek 核心技术揭秘

DeepSeek开源新版R1 媲美OpenAI o3

铭瑄在COMPUTEX 2025上发布Intel Arc Pro B60 Dual 48G Turbo显卡

显存也能叠叠乐,双 Intel Arc A770 显卡低成本部署 DeepSeek R1 32B 蒸馏模型体验

显存也能叠叠乐,双 Intel Arc A770 显卡低成本部署 DeepSeek R1 32B 蒸馏模型体验

评论