在DeepSeek启动的“开源周”上(Open Source Week)DeepSeek将陆续开源5个代码库,大家关心的DeepSeek扔的第二枚开源王炸是什么?我们这里来简单介绍一下。

DeepSeek在其开源周活动中连续扔出了两枚震撼业界的“开源王炸”--FlashMLA与DeepEP。

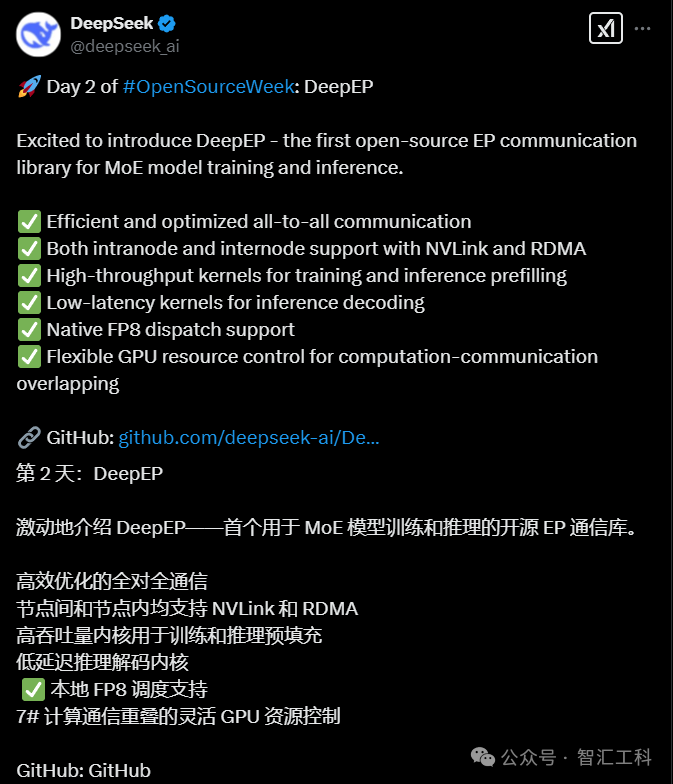

在25日,也就是DeepSeek开源周的第二天,DeepSeek发布了名为DeepEP的开源代码库。DeepEP是全球首个专为MoE(混合专家)模型训练和推理设计的通信库,它的出现填补了该领域专用工具的空白。MoE模型作为一种能够有效提升AI模型性能和扩展性的架构,近年来在自然语言处理、计算机视觉等领域得到了广泛应用。然而,MoE模型在训练和推理过程中,面临着通信开销大、算力需求高等挑战。DeepEP正是针对这些痛点,通过优化GPU之间的信息传输效率,极大地缓解了从业者的算力焦虑。

业界人士多认为DeepEP是首个用于 MoE 模型训练和推理的开源 EP 通信库,它填补了MoE模型专用通信工具的空白,为大规模分布式AI训练和实时推理场景提供了更高效的底层支持。

DeepEP的核心优势在于其高效的通信机制。在传统的分布式AI训练中,GPU之间的通信往往成为性能瓶颈。DeepEP通过一系列创新技术,如低延迟通信协议、智能数据调度等,显著提升了GPU之间的通信效率。这意味着,原本需要庞大算力支持的重型任务,现在可以在更少的GPU上高效完成。据DeepSeek官方介绍,使用DeepEP后,某些MoE模型的训练速度可提升数倍,同时降低了对硬件资源的依赖。

DeepEP的技术性能特点概述:

EP为Expert Parallelism(专家并行),是一种在大规模分布式AI模型训练中使用的技术,能用于提升模型并行处理能力和训练效率。

1、高效通信架构

支持优化的全对全通信模式,实现节点内和节点间的NVLink与RDMA互联,提升数据传输效率

2、多精度与调度优化

原生支持FP8低精度运算调度,降低计算资源消耗。

3、重性能内核

据介绍,高吞吐量内核可适用于训练和推理预填充场景,最大化数据处理能力;

4、低延迟内核

它针对推理解码场景设计,采用纯RDMA通信和自适应路由技术,减少延迟。

5、资源控制与重叠机制

通过灵活的GPU资源控制策略,实现计算与通信过程的高效重叠,避免资源闲置。

6、深度优化场景

针对NVLink到RDMA的非对称带宽转发场景进行专项优化,提升异构网络下的传输性能;

支持SM(Streaming Multiprocessors)数量动态控制,平衡不同任务(如训练与推理)的吞吐量需求。

DeepEP与FlashMLA的对比

DeepSeek在其开源周活动中首个开源的项目是FlashMLA;FlashMLA让AI大模型低成本却有高性能。

DeepSeek扔的第二枚开源王炸是全栈通信库DeepEP。与第一枚开源王炸FlashMLA相比,两者在多个方面存在显著差异。以下是对这两者的详细对比以及外媒的热议:

1. 功能定位:

● DeepEP:它是全球首个面向MoE(Mixture of Experts)模型的全栈通信库,旨在优化GPU之间的信息传输效率,从而极大提升AI模型的训练与推理效率。

● FlashMLA:专为英伟达Hopper架构GPU(如H800/H100)优化的高效MLA解码内核,旨在显著提升AI的加速能力,特别是在处理长短句子并行任务时能够动态调整计算资源分配,避免算力浪费。

2. 技术特点:

● DeepEP:具备高效的全员通信能力,支持NVLink与RDMA技术,提供高吞吐量的训练预填充内核以及低延迟的推理解码内核。原生支持FP8调度,灵活的GPU资源管理能力使得计算和通信可以重叠进行。

● FlashMLA:专为高性能显卡设计,能够充分挖掘显卡性能潜力,被视为AI加速的“涡轮增压器”。

3. 硬件兼容性:

● DeepEP:具有更广泛的硬件兼容性,不受特定GPU架构的限制。

● FlashMLA:目前仅适配Hopper架构GPU,国产GPU的兼容性尚待验证。

DeepSeek的这两枚开源王炸在国际上引起了广泛关注。外媒对DeepSeek的评价普遍较高,认为其打破了人们对人工智能研发需要“高投入、长周期”的传统认知,提供了低成本、高效能的解决方案。同时,DeepSeek的开源策略也被视为一种促进全球科技进步的积极举措。

具体来说,外媒对DeepEP和FlashMLA的关注点有所不同。对于DeepEP,外媒主要关注其在优化GPU通信效率、提升AI模型训练与推理效率方面的潜力。而对于FlashMLA,外媒则更侧重于其在提升AI加速能力、挖掘显卡性能潜力方面的表现。

DeepSeek的第二枚开源王炸DeepEP与第一枚开源王炸FlashMLA在功能定位、技术特点、硬件兼容性和开源时间等方面存在显著差异。外媒对这两者的评价普遍积极,认为它们为人工智能领域带来了新的突破和进步。

我们知道每一次技术的突破都可能成为推动行业发展的关键力量。也能够带来更多产业链的机遇。比如AI 能力和性能不断提升,模型的规模和复杂度持续增长,面对信息速率和密度不断提升的AI,技术进步也会遵循摩尔定律,那硬件互连准备好了吗?

DeepSeek启动的“开源周”连续5天(2月24日至28日);欢迎大家继续关注DeepSeek的大招。期待更多让我们惊喜的东西能够面世。

-

开源

+关注

关注

3文章

4346浏览量

46442 -

DeepSeek

+关注

关注

2文章

839浏览量

3405

发布评论请先 登录

百度腾讯抢滩布局!DeepSeek-R1升级和开源背后,国产AI的逆袭之路

海光信息DCU平台完成对DeepSeek V4模型极速适配

开源鸿蒙教育委员会(筹)2026师资培训第二站——西安

【开源旅行团,第二批中奖名单揭晓!】RT-Thread 20 周年暨开发者大会火热报名中

沐曦受邀出席第二届开源产业生态大会

成都汇阳投资关于国产开源模型持续突破,国产AI 竞争力增强

第二届中国研究生操作系统开源创新大赛总决赛圆满落幕

深开鸿王成录:以七大使能厚植生态,推进开源鸿蒙全面落地

【「DeepSeek 核心技术揭秘」阅读体验】+混合专家

【「DeepSeek 核心技术揭秘」阅读体验】--全书概览

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

DeepSeek扔的第二枚开源王炸是什么

DeepSeek扔的第二枚开源王炸是什么

评论