在DeepSeek迅速成为行业焦点之际,香橙派昇腾系列产品已经率先完成了与 DeepSeek 模型的深度适配,通过在边缘进行离线部署,帮助用户实现高效端侧智能,确保数据处理的安全性和可控性。

紧接着,香橙派官方发布OrangePi5Plus运行Deepseek-R1蒸馏模型实操指南,赶紧收藏起来吧!

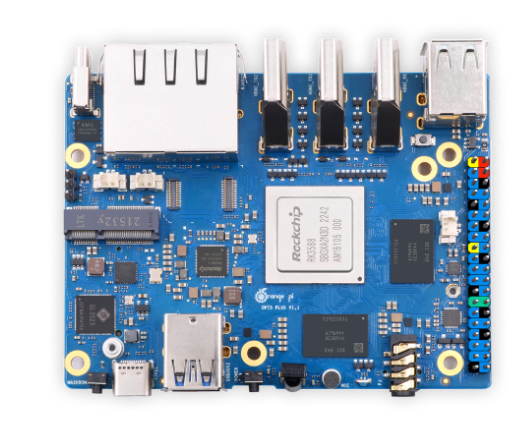

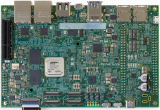

OrangePi 5 Plus采用了瑞芯微RK3588八核64位处理器,具体为四核A76+四核A55,8nm工艺设计,主频最高可达2.4GHz,集成ARM Mali-G610,内置3D GPU,兼容OpenGL ES1.1/2.0/3.2、OpenCL 2.2和Vulkan 1.2;内嵌的NPU支持INT4/INT8/INT16/FP16混合运算,算力高达6TOPS,可以满足绝大多数终端设备的边缘计算需求;拥有4GB/8GB/16GB(LPDDR4/4X)、32GB LPDDR4X,和eMMC闪存插座,可以外接16GB/32GB/64GB/128GB/256GB eMMC模块。OrangePi 5 Plus支持OrangePi官方研发的操作系统Orangepi OS,同时,支持Android12、Debian11、Ubuntu22.04等操作系统。OrangePi 5 Plus顺利通过开放原子开源基金会XTS认证,并获颁OpenHarmony生态产品兼容性证书。

实操指南:OrangePi5Plus运行Deepseek-R1蒸馏模型

1.1.6.DeepSeek-R1-Distill-Qwen-1.5B

1)参考用户手册在pc端安装RKLLM工具链。

2)参考用户手册在pc端编译llm_demo测试程序。

3)先在Ubuntu操作系统上安装GitLFS,如果已安装可跳过这一步。

test@test:~$sudo apt update

test@test:~$sudo apt install curl git git-lfs

4)接着下载DeepSeek-R1-Distill-Qwen-1.5B模型。

test@test:~$git clone https://huggingface.co/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B

5)参考下面的代码修改test.py文件。

a. modelpath:DeepSeek-R1-Distill-Qwen-1.5B文件夹所在的绝对路径。

b. llm.export_rkllm:转换后模型保存路径。

test@test:~$vimrknn-llm/rkllm-toolkit/examples/test.py

modelpath ="/path/your/DeepSeek-R1-Distill-Qwen-1.5B"#填你自己的路径

ret = llm.export_rkllm("./DeepSeek-R1-Distill-Qwen-1.5B.rkllm")

6) 创建一个名为“data_quant.json”的文件。内容可以参考下面的示例。

test@test:~$vimrknn-llm/rkllm-toolkit/examples/data_quant.json

[{"input":"Human: 你好!\nAssistant: ", "target": "你好!我是人工智能助手KK!"}]

7) 然后用python3运行test.py文件来转换大模型。

test@test:~$cdrknn-llm/rkllm-toolkit/examples

test@test:~/rknn-llm/rkllm-toolkit/examples$python3test.py

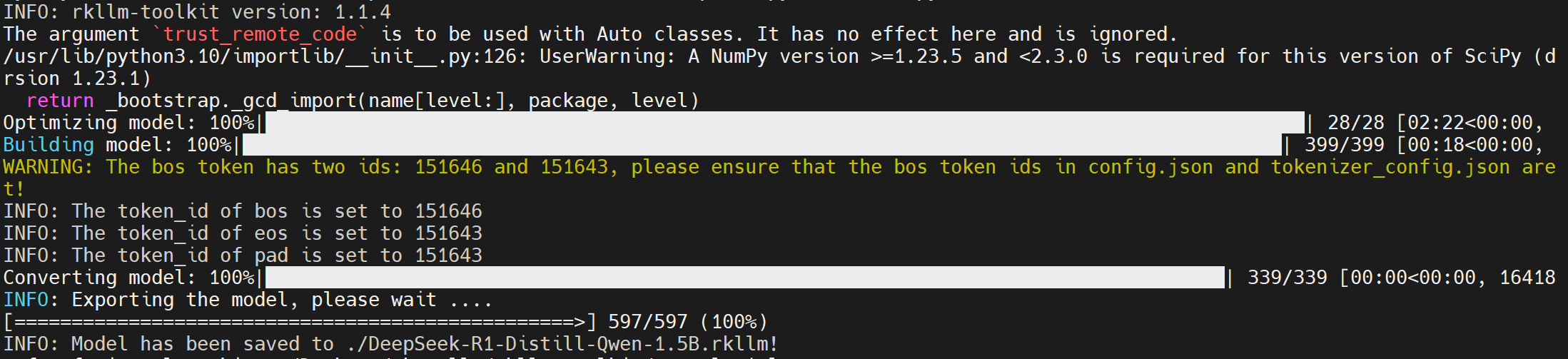

8) 转换成功的输出如下所示:

9) 最后转换成功会在当前目录下得到DeepSeek-R1-Distill-Qwen-1.5B.rkllm文件,大小约为1.9G。

test@test:~/rknn-llm/rkllm-toolkit/examples$ls

data_quant.json test.py DeepSeek-R1-Distill-Qwen-1.5B.rkllm

10) 参考用户手册更新NPU内核驱动和rknn-llm相关文件。这里使用的版本是:

rkllm-runtime version: 1.1.4, rknpu driver version: 0.9.6

11) 将在Ubuntu PC端编译好的llm_demo程序和DeepSeek-R1-Distill-Qwen-1.5B.rkllm模型文件上传到开发板中。

orangepi@orangepi:~$ls

llm_demo DeepSeek-R1-Distill-Qwen-1.5B.rkllm

12) 然后运行下面的命令限制最多打开的文件描述符(每开一个终端都要运行)。

orangepi@orangepi:~$ulimit -HSn 102400

13) 然后运行下面的命令来启动模型。

orangepi@orangepi:~$chmod 777 llm_demo

orangepi@orangepi:~$./llm_demo ./DeepSeek-R1-Distill-Qwen-1.5B.rkllm256 320

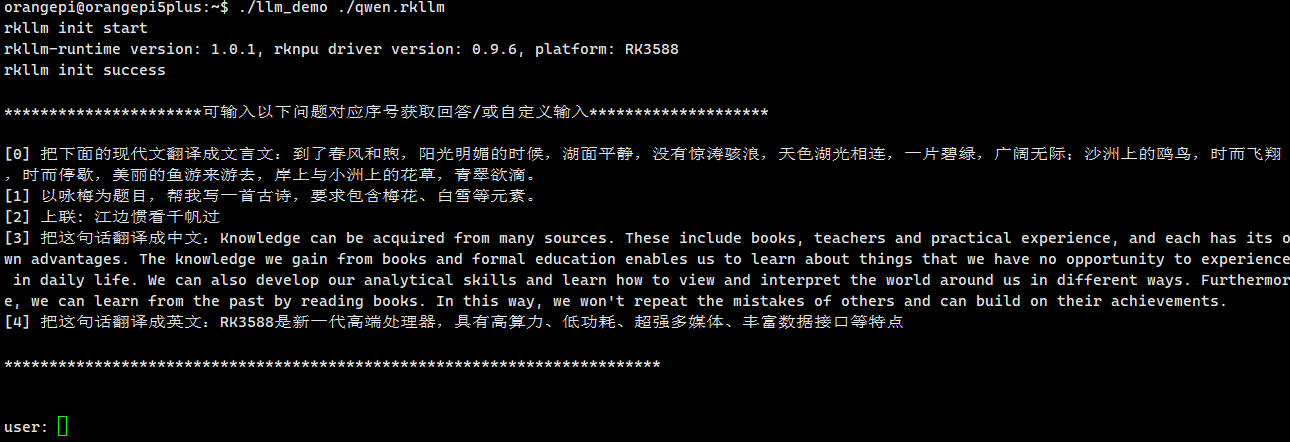

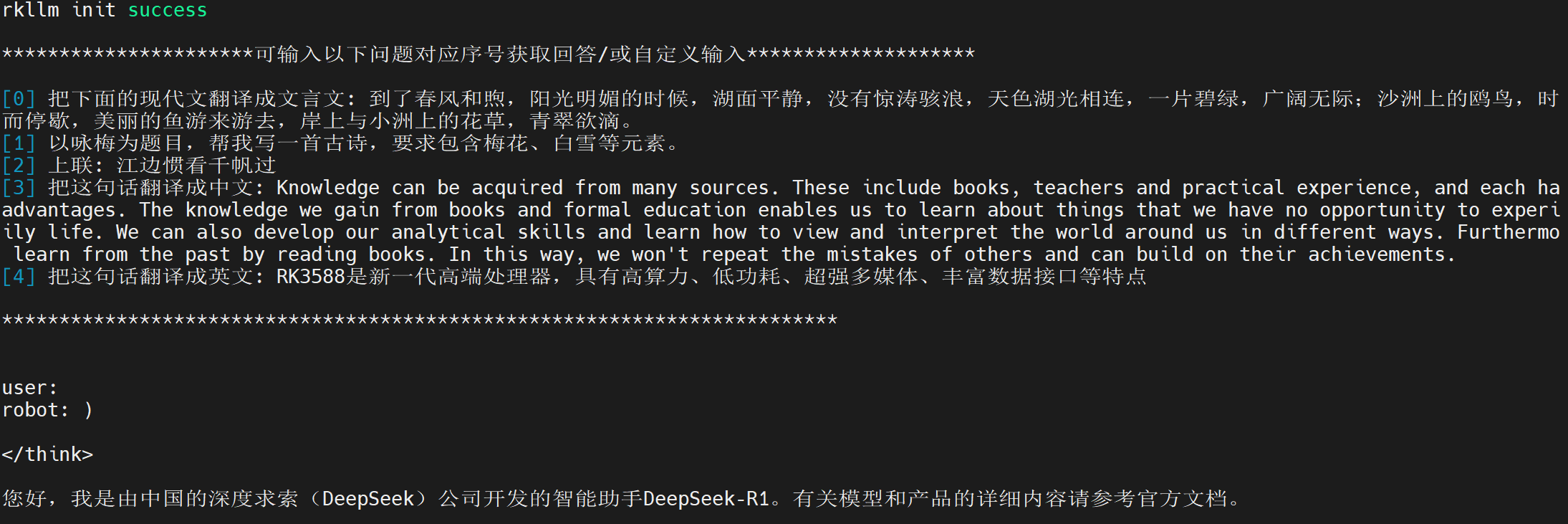

14) 运行成功的话就会弹出以下界面。

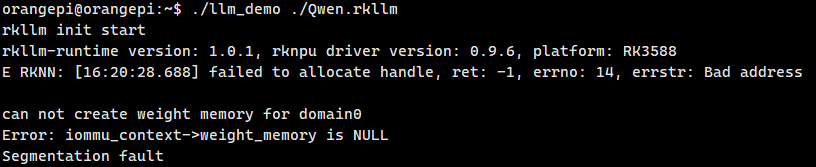

15) 如果运行完弹出以下失败界面的话,reboot重启开发板就可以了。第四步运行成功的话则跳过这一步。

orangepi@orangepi:~$sudo reboot

16) 在交互界面输入问题后按回车,测试成功的结果如下:

-

开发板

+关注

关注

26文章

6419浏览量

120805 -

香橙派

+关注

关注

2文章

52浏览量

12509 -

DeepSeek

+关注

关注

2文章

839浏览量

3397

发布评论请先 登录

百度腾讯抢滩布局!DeepSeek-R1升级和开源背后,国产AI的逆袭之路

OPi RK3588/RK3588S系列产品全面适配Openclaw,智能体“人人可及”时代正式开启

OPi 6Plus全面适配OpenClaw

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

NVIDIA Blackwell GPU优化DeepSeek-R1性能 打破DeepSeek-R1在最小延迟场景中的性能纪录

香橙派发布OrangePi 5Plus本地部署Deepseek-R1蒸馏模型指南

香橙派发布OrangePi 5Plus本地部署Deepseek-R1蒸馏模型指南

评论