DeepSeek R1模型本地部署与产品接入实操

近期,深度求索(DeepSeek)推出的DeepSeek V3/R1系列模型在人工智能领域掀起了一股热潮,引发了广泛的关注与深入探讨。该大模型凭借其卓越的推理能力和对硬件要求的显著降低,赢得了市场的热烈反响。DeepSeek的发布,标志着大模型产品正式迈入“普惠”时代,使得普通个人电脑乃至手机等便携式设备均能流畅运行大型模型。这一里程碑式的进展,不仅激发了部署的浪潮,更激发了人们对大模型潜在应用场景的无限遐想。

DeepSeek之所以备受瞩目,不仅在于其技术的先进性,更在于其为用户提供了前所未有的数据隐私与安全保障。在数据泄露风险日益严峻的今天,DeepSeek的本地化部署方案为用户提供了一个更为安心的选择。通过本地部署,所有数据运算和存储均在本地完成,有效规避了数据在传输和云端存储过程中可能面临的隐私泄露风险。这一特性,使得DeepSeek R1在企业和个人用户中均赢得了广泛的认可与信赖。

自DeepSeek大模型发布以来,深蕾半导体团队迅速展开了对DeepSeek大模型的相关研究,并积极探索DeepSeek大模型与SOC全系列产品结合的模式及市场机遇。

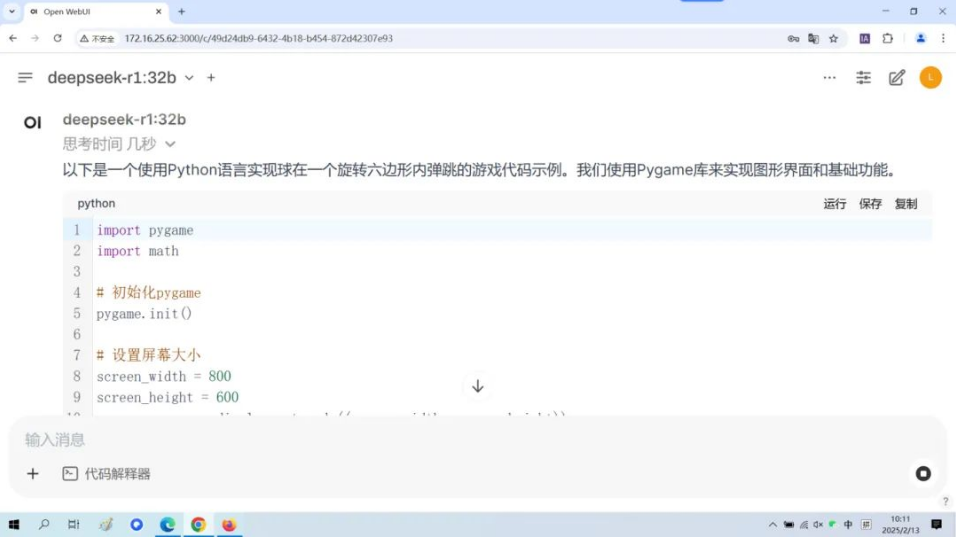

本地部署的私有化DeepSeek R1 32B大模型Web页面访问

通过本地部署私有化大模型,不仅为用户提供了更为便捷的访问途径,还进一步强化了数据的安全性和隐私保护。这一举措为后续SOC产品接入DeepSeek大模型降低了整体成本,同时也为企业内部应用DeepSeek大模型实现降本增效提供了坚实基础。

本地部署的私有化Web页面访问DeepSeek R1 32B大模型的截图

在Web应用页面中,用户可以清晰地查看DeepSeek R1 32B模型的运行状态、处理结果以及历史记录等信息。通过简单的点击和输入操作,用户即可轻松实现与模型的交互和数据处理。此外,该页面还支持语音交互输入方式,进一步提升了用户体验。

deepseekR1 32b本地部署-语音交互

DeepSeek R1 32B模型不仅支持通用知识问答,还具备代码编写、逻辑推理等技能:

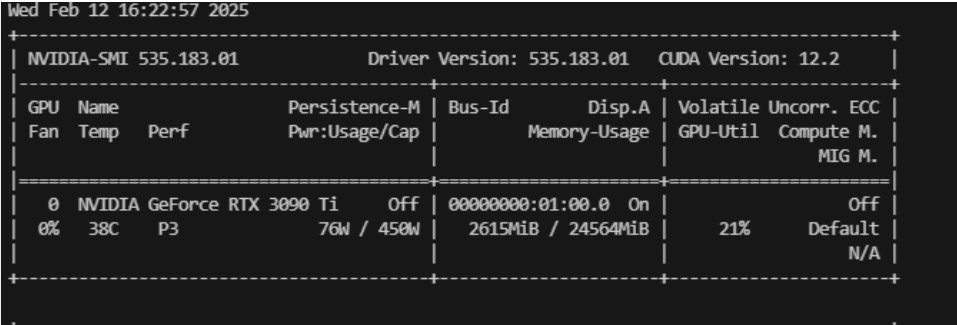

本地部署的服务器配置信息:

CPU:24核

内存:60G

配置信息图

VS680接入DeepSeek R1 32B模型API展示

我们还在VS680设备上的APP应用中成功接入了DeepSeek R1 32B模型的API。VS680作为一款高性能计算机设备,其强大的计算能力和稳定的系统环境为DeepSeek R1的运行提供了坚实的保障。特别是VS680自带的7.9T AI算力,为端云结合的应用模式创造了有利条件。

在演示中,我们可以看到VS680设备通过API接口与DeepSeek R1 32B模型实现了无缝连接。用户只需在设备上输入相应的指令或数据,DeepSeek R1模型即可迅速进行运算并返回结果。这一过程中,模型的响应速度、准确性和稳定性均得到了充分展现。

VS680接入字节豆包智能体DeepSeek R1 671B满血模型展示

在字节官方火山引擎大模型开发平台把“深蕾科技智能体”开发好,包括DeepSeek R1模型,角色定位,工作流等,然后发布到豆包应用平台,就可以在VS680上面直接实现满血版的DeepSeek R1大模型接入使用。

DeepSeek大模型与端侧SOC的产品结合方案

针对VS680/SL1680系列大算力芯片,我们的研发团队正在研究将蒸馏后的轻量级DeepSeek模型(DeepSeek-R1-Distill-Qwen-1.5B)部署到SOC本地,以便应用于相关业务场景,如产品AI助手(问答服务、产品介绍、产品售后、产品故障排查等)。我们采用端侧大模型与云端大模型相结合的方式,本地能处理的用户任务使用端侧大模型快速解决和输出,而较复杂的逻辑以及联网功能则通过请求云端大模型API的方式实现。

针对SL1640/SL1620/SR110系列小算力芯片,我们则通过API接入的方式进行产品赋能,如不带屏语音交互产品、小屏桌面音视频多媒体产品等。端侧的语音识别、机器视觉与云端的DeepSeek大模型相结合,是智能硬件的最优技术组合,能够显著提升产品的智能化程度,增加产品的附加值。

我们即将推出基于深蕾半导体SOC带机器视觉和语音交互的DeepSeek大模型应用解决方案,敬请期待!

-

人工智能

+关注

关注

1821文章

50524浏览量

267792 -

模型

+关注

关注

1文章

3875浏览量

52343 -

DeepSeek

+关注

关注

2文章

861浏览量

3475

发布评论请先 登录

DeepSeek爆火一周年的寂静

DeepSeek模型如何在云服务器上部署?

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

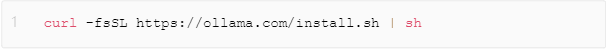

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

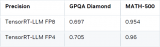

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

边缘计算AI硬件如何接入DeepSeek吗?需要具备哪些条件?

如何在NVIDIA Blackwell GPU上优化DeepSeek R1吞吐量

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

曙光AI解决方案助力北京农商银行提升业务效率

如何本地部署NVIDIA Cosmos Reason-1-7B模型

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

DeepSeek R1模型本地部署与产品接入实操

DeepSeek R1模型本地部署与产品接入实操

评论