日前,香橙派官方发布OrangePi AIpro(20T)运行Deepseek-R1蒸馏模型实操指南,帮助用户通过先进算力和硬件架构实现高效的端侧智能。

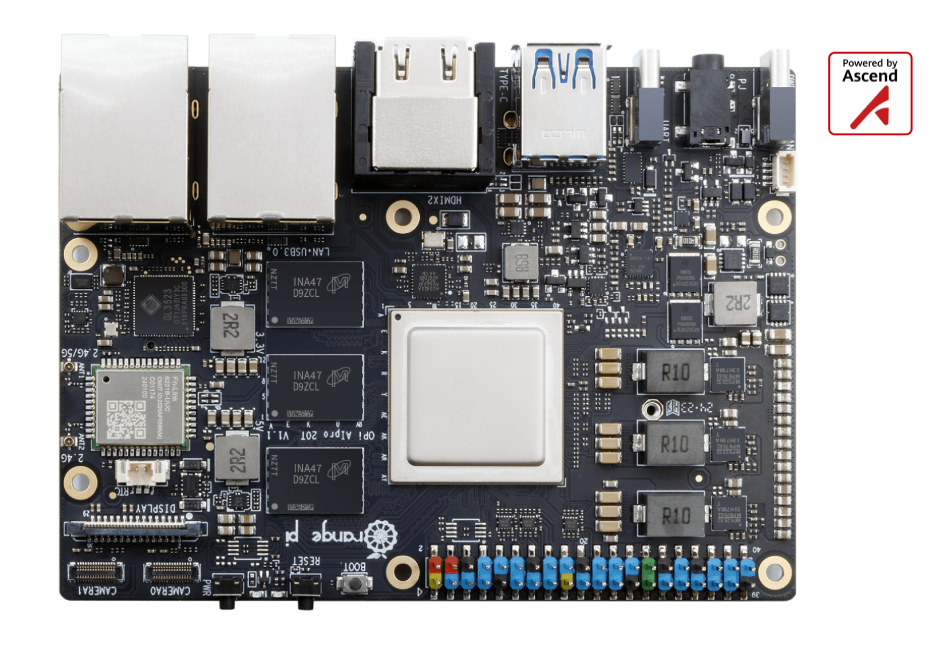

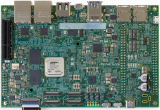

OrangePi AIpro(20T)是香橙派联合昇腾AI打造的高算力开发板,根植于昇腾AI技术,集AI计算、ISP、图形输出等功能于一体,释放高达20 TOPS的AI算力。可配24GB运行内存,汇聚了MIPI DSI、双MIPI CSI、USB3.0、Type-C、双HDMI2.0、双2.5G以太网、支持SATA/NVMe SSD 2280的M.2插槽等各类流行的接口。 OrangePi AIpro(20T)依托昇腾AI基础软硬件能力的基础,融合大模型与训推一体化优势,实现端边云全场景无缝部署,是构建昇腾计算产品、使能上层软件和应用的底座,有高算力、高能效等特性。

该产品广泛应用于AI边缘计算、深度视觉与视频流分析、自然语言处理、智能机器人(如小车、机械臂)、无人机、云计算、AR/VR、智能安防及家居等AIoT全领域,引领行业智能化转型。

基于昇腾硬件底座、昇腾异构计算架构CANN、昇思Mindspore AI框架以及MindlE推理引擎,用户可以通过OrangePi Alpro(20T)开展面向金融、教育、政务、智能制造、智能家居、智慧交通等行业的人工智能应用开发。

OrangePi AIpro(20T)运行Deepseek-R1蒸馏模型

据了解,DeepSeek-R1专为数学、代码生成和复杂逻辑推理任务设计,通过大规模强化学习(RL)提升推理能力,还摒弃监督微调(SFT),采用纯强化学习(GRPO算法)训练基座模型。同时,DeepSeek-R1提供了高效模型蒸馏技术,可将大规模模型能力迁移至更小、更高效的版本,优化模型性能、开源应用。经蒸馏后的DeepSeek-R1模型支持部署于端侧,大幅降低计算资源需求,显著提升端侧设备的AI推理效率。

除OrangePi AIpro(20T)之外,迅龙软件也发布了OrangePi AI Studio、OrangePi 5Plus运行Deepseek-R1蒸馏模型的实操指南。迅龙软件表示,未来将继续加大研发投入,携手行业伙伴,推动不同算力等级的开发板与DeepSeek等优质模型相结合,进一步降低端侧AI的门槛,为客户创造更大的AI价值。

实操指南

DeepSeek-R1-Distill-Qwen-1.5B

- 下载最新的desktop版本镜像。

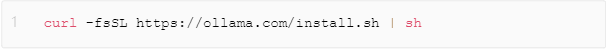

- 执行以下命令启动推理。

(base) HwHiAiUser@orangepiaipro-20t:~$cd orange-pi-mindspore/Online/17-DeepSeek-R1-Distill-Qwen-1.5B

(base) HwHiAiUser@orangepiaipro-20t:~/orange-pi-mindspore/Online/17-DeepSeek-R1-Distill-Qwen-1.5B$python deepseek-r1-distill-qwen-1.5b.py

- 第一次启动会自动下载模型,具体时间视网络环境而定,模型会被下载到“~/orange-pi-mindspore/Online/17-DeepSeek-R1-Distill-Qwen-1.5B/.mindnlp/model/deepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B/”文件夹内。

- 推理代码默认在启动的时候会检查相关的依赖,此时如果网络环境不好,会导致无法启动。如果不是第一次启动,且模型已经下载完成,可以按照下图所示,修改tokenizer和model参数,将路径改成本地绝对路径,这样就可以离线启动了。

(base) HwHiAiUser@orangepiaipro-20t:~/orange-pi-mindspore/Online/17-DeepSeek-R1-Distill-Qwen-1.5B$vimdeepseek-r1-distill-qwen-1.5b.py

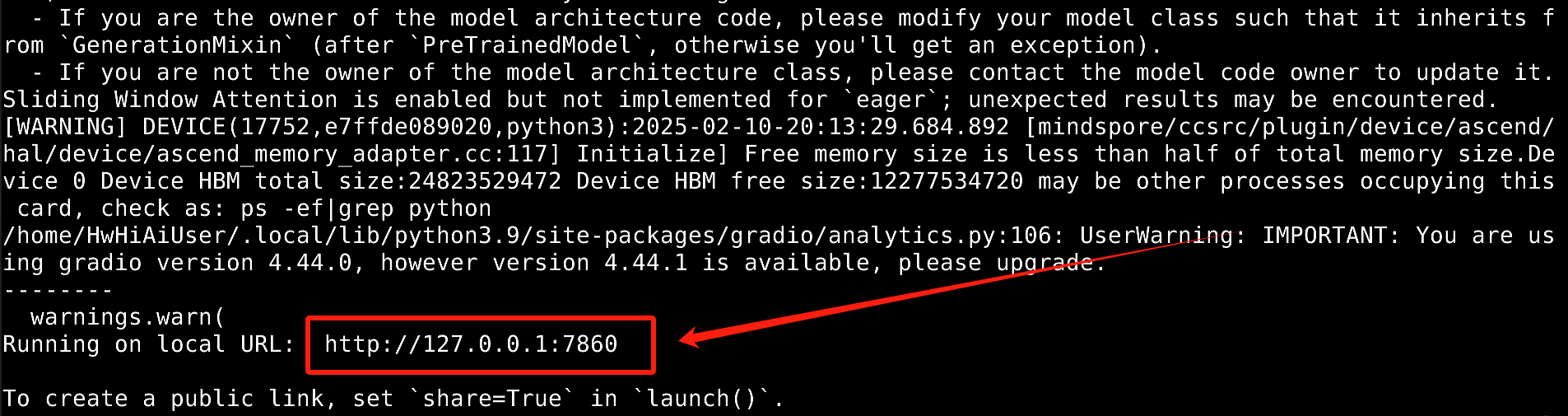

- 等待一会,会出现一个ip,复制到开发板上的浏览器的地址栏访问。

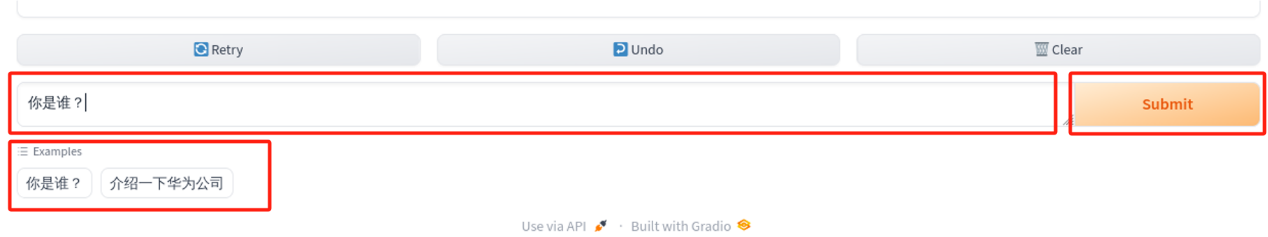

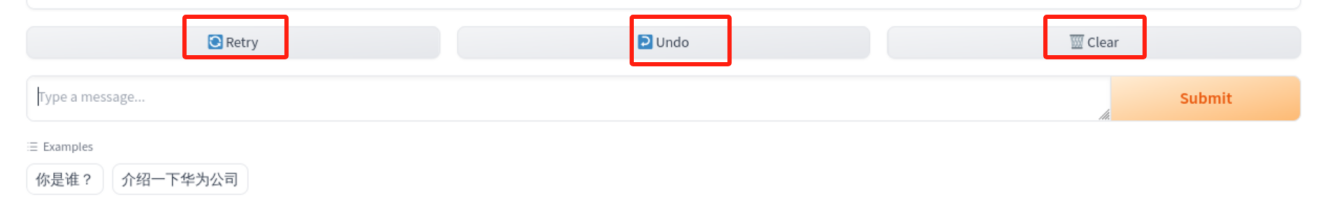

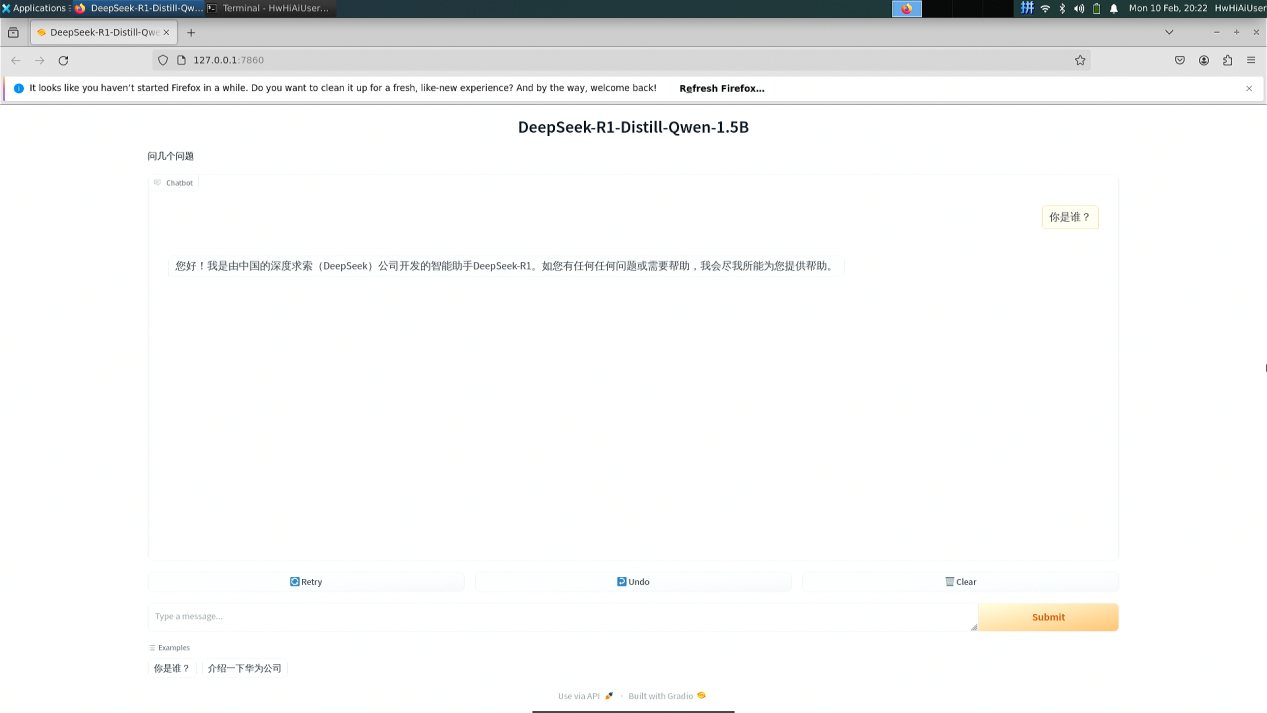

- 启动后,可在页面下方消息输入框“Type a message…”中输入任何问题,或者点击下方Examples中设置好的问题,然后点击右侧的“Submit”按钮,Qwen模型将对此进行回答。

- 第一次回答需要较长时间加载,大约需要1分钟,请耐心等待。回答将显示在上方聊天框中。

- 如果出现Error,可以点击“retry”按钮重新发送上一条消息,并让模型重新回答;点击“undo”按钮可撤回上一条消息;点击“clear”按钮将清空聊天框中的对话。

- 输出结果如下图所示:

-

开发板

+关注

关注

26文章

6402浏览量

120532 -

香橙派

+关注

关注

2文章

52浏览量

12503 -

大模型

+关注

关注

2文章

3747浏览量

5268 -

DeepSeek

+关注

关注

2文章

837浏览量

3392

发布评论请先 登录

百度腾讯抢滩布局!DeepSeek-R1升级和开源背后,国产AI的逆袭之路

广和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

速看!EASY-EAI教你离线部署Deepseek R1大模型

【「DeepSeek 核心技术揭秘」阅读体验】书籍介绍+第一章读后心得

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

NVIDIA Blackwell GPU优化DeepSeek-R1性能 打破DeepSeek-R1在最小延迟场景中的性能纪录

香橙派发布OrangePi AIpro(20T)本地部署Deepseek-R1蒸馏模型指南!

香橙派发布OrangePi AIpro(20T)本地部署Deepseek-R1蒸馏模型指南!

评论