华为技术有限公司宣布旗下 ModelEngine AI 平台全面支持 DeepSeek 大模型 R1&V3 和蒸馏系列模型的本地部署与优化,在 AI 领域引发广泛关注。

华为 ModelEngine 是大模型训练、推理和应用开发的 AI 平台,提供从数据预处理到模型训练、优化及部署的一站式服务。此次基于昇腾 AI 芯片,ModelEngine 通过推理框架优化和 MoE 存算协同,提供动态换入换出和全局统一缓存,实现推理高并发和低时延,让用户能更好地体验 DeepSeek 的推理能力。

对于开发者而言,这一支持意义重大。ModelEngine 全面兼容 DeepSeek 系列模型 R1&V3 671B 以及蒸馏系列模型,开发者借助它可实现 “一键部署”,免去硬件选型、兼容性验证和环境配置等繁琐流程,极大降低企业 AI 应用门槛。并且,ModelEngine 高度的开放性和模块化设计,大幅缩短了 DeepSeek 的本地部署时间。

在实际操作上,以 DeepSeek-R1 为例,开发者登录 ModelEngine 模型管理页面,上传 DeepSeek-R1 FP8 权重并进行格式转换,在模型服务页面选择 BF16 精度的模型权重版本下发推理服务、启动任务部署,随后 ModelEngine 使用 MindIE 推理框架启动 DeepSeek-R1 推理服务,支持 OpenAI API 调用风格的推理服务接口和访问方式,用户便可将该 API 集成到对话、RAG 以及 Agent 应用中。

不仅如此,ModelEngine 还提供负载均衡、模型安全接入、多用户配额管理等高阶特性,支持大规模生产环境下的稳定运行。某证券公司引入 DCS AI 全栈解决方案后,运维成本降低 42%,便是有力证明。

-

华为

+关注

关注

218文章

36178浏览量

262664 -

AI

+关注

关注

91文章

41027浏览量

302555 -

DeepSeek

+关注

关注

2文章

837浏览量

3395

发布评论请先 登录

从云端到边缘:联发科MT8371/MT8391平台实现7B大模型本地部署

中科曙光AI超集群系统和scaleX640超节点等产品全面适配DeepSeek V3.2

DeepSeek模型如何在云服务器上部署?

曙光AI超集群系统全面支持DeepSeek-V3.2-Exp

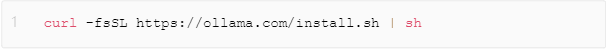

本地部署openWebUI + ollama+DeepSeek 打造智能知识库并实现远程访问

信而泰×DeepSeek:AI推理引擎驱动网络智能诊断迈向 “自愈”时代

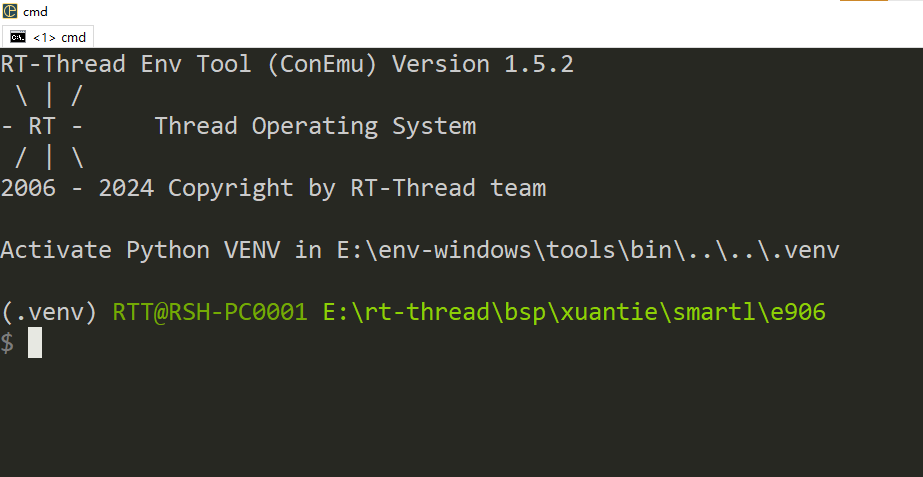

RT-Thread BSP全面支持玄铁全系列RISC-V 处理器 | 技术集结

Arm Neoverse N2平台实现DeepSeek-R1满血版部署

华为ModelEngine AI平台全面支持DeepSeek全系列本地部署

华为ModelEngine AI平台全面支持DeepSeek全系列本地部署

评论