4 月 16 日,据报道,百度公司首席执行官李彦宏在其举办的Create 2024 AI 开发者大会上指出,开源模型正在逐渐过时。

李彦宏解释道,百度自研的基础模型——文心 4.0,能够根据需求塑造出适应各类场景的微型版模型,并支持精细调整以及后预训练。相较于直接使用开源模型,这种经过降维处理的模型在同等尺寸下表现更为出色,且在相同效果下成本更低,因此,“开源模型将逐步被淘汰”。

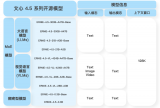

此外,李彦宏还推出了文心大模型 4.0 的工具版本,该模型的算法训练效率已提高至原有的 5.1 倍,每周训练有效率高达 98.8%,推理性能提升了 105 倍,而推理成本则降低至原先的 1%。

值得关注的是,360 集团创始人周鸿祎在哈佛大学的一场演讲中提出了不同观点。他认为“没有开源便无Linux、无互联网,甚至包括我们自身的发展也离不开开源技术”。同时,他预测在未来一至两年内,开源技术的影响力或将超越闭源技术。

周鸿祎表示:“尽管目前开源模型的能力尚未达到GPT 4水平,但若专注于某一领域,利用企业内部的专属数据及专业训练进行强化,便有望在专业能力上超越GPT 4。”

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

算法

+关注

关注

23文章

4807浏览量

98566 -

开源

+关注

关注

3文章

4348浏览量

46445 -

模型

+关注

关注

1文章

3819浏览量

52270

发布评论请先 登录

相关推荐

热点推荐

今日看点:小米正式发布并开源新模型 MiMo-V2-Flash;磷酸铁锂开启涨价潮

模型 Claude 4.5 Sonnet,但推理价格仅为其 2.5% 且生成速度提升至 2 倍,成功将大模型效果和

在Ubuntu20.04系统中训练神经网络模型的一些经验

模型。

我们使用MNIST数据集,训练一个卷积神经网络(CNN)模型,用于手写数字识别。一旦模型被训练并保存,就可以用于对新图像进行

发表于 10-22 07:03

借助NVIDIA Cosmos模型提升机器人训练效率

随着物理 AI 系统的不断发展,对丰富标记数据集的需求正在急速增长,已经超出了在现实世界中通过人工采集所能满足的范围。世界基础模型(WFMs)是经过训练的生成式 AI 模型,能够根据现实世界环境的动态,对未来的世界状态进行仿真、

百度文心大模型X1.1正式发布

今天,在WAVE SUMMIT深度学习开发者大会2025上,文心大模型X1.1正式发布,在事实性、指令遵循、智能体等能力上均提升显著。

中兴努比亚启动接入百度文心4.5系列开源大模型

近日,中兴努比亚启动接入文心4.5系列开源大模型,为星云智能提供新引擎,共同推动人工智能在AI手机的创新应用,加速AI技术落地,进一步提升用

大模型推理显存和计算量估计方法研究

随着人工智能技术的飞速发展,深度学习大模型在各个领域得到了广泛应用。然而,大模型的推理过程对显存和计算资源的需求较高,给实际应用带来了挑战。为了解决这一问题,本文将探讨大

发表于 07-03 19:43

百度文心大模型X1 Turbo获得信通院当前大模型最高评级证书

百度在520居然还领了个证?是它, 信通院当前大模型最高评级证书 ! 在5月20日的百度AI Day 上,中国信通院公布了大模型推理能力评估结果—— 百度文

百度发布文心4.5 Turbo、X1 Turbo和多款AI应用

近日,Create2025百度AI开发者大会在武汉举办。百度创始人李彦宏发布了文心大模型4.5

李彦宏:开源模型将逐渐滞后,文心大模型提升训练与推理效率

李彦宏:开源模型将逐渐滞后,文心大模型提升训练与推理效率

评论