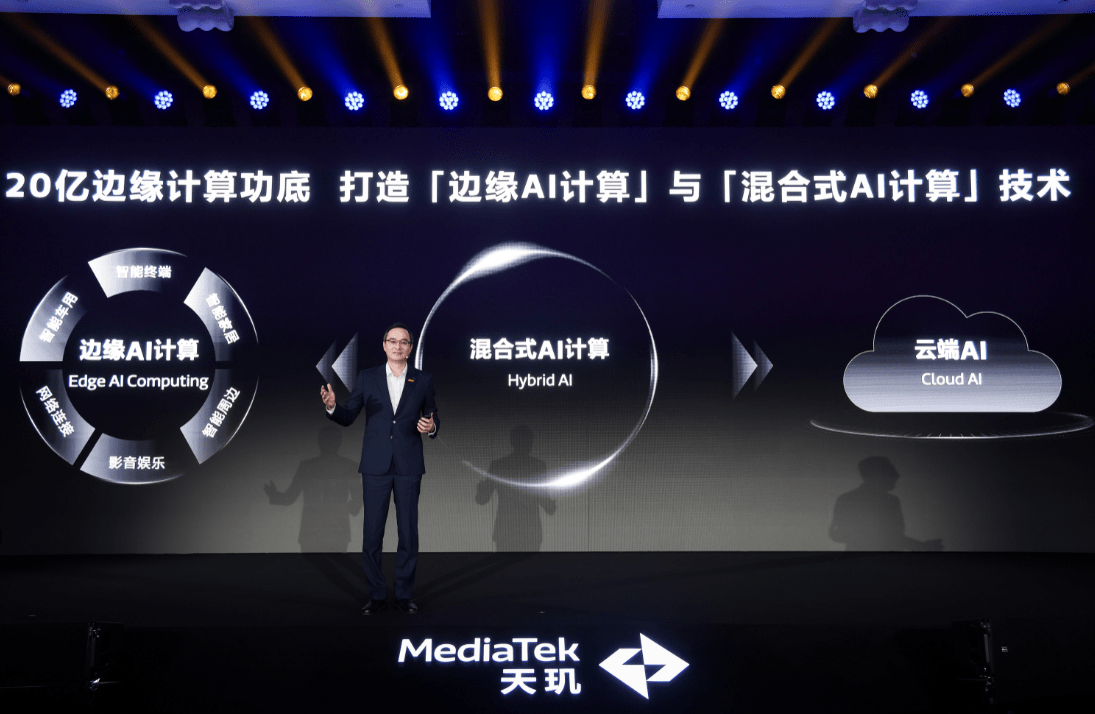

近期,联发科发布了全新一代旗舰级5G生成式AI移动芯片天玑9300。创新的全大核架构设计结合新一代AI处理器APU和联发科特有的前沿技术,为端侧生成式AI应用提供强劲性能,带来精彩、丰富的端侧生成式AI体验。联发科还与众多业内AI企业深度合作,在移动端构建了丰富的AI生态。

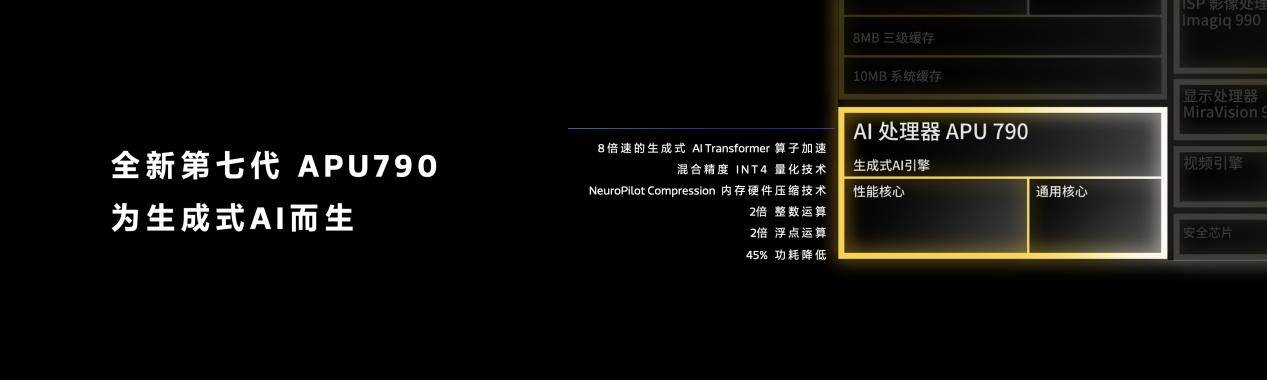

全新第七代AI处理器APU 790,为生成式AI而生

随着用户对生成式AI应用需求日益增长,端侧生成式AI便捷、安全性等优势便凸显出来。当然,部署端侧AI大语言模型需要强大的AI算力支撑。

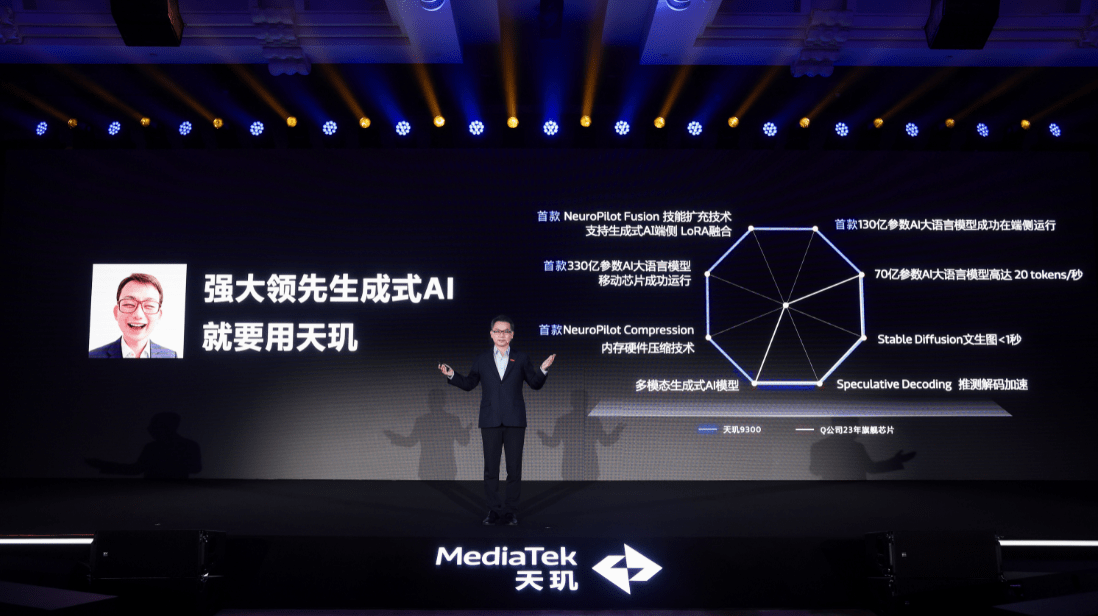

天玑9300搭载联发科第七代AI处理器APU 790,为生成式AI而设计,拥有硬件级的生成式AI引擎,可以实现更加高速且安全的边缘AI计算,深度适配Transformer模型进行算子加速,速度是上一代的8倍。

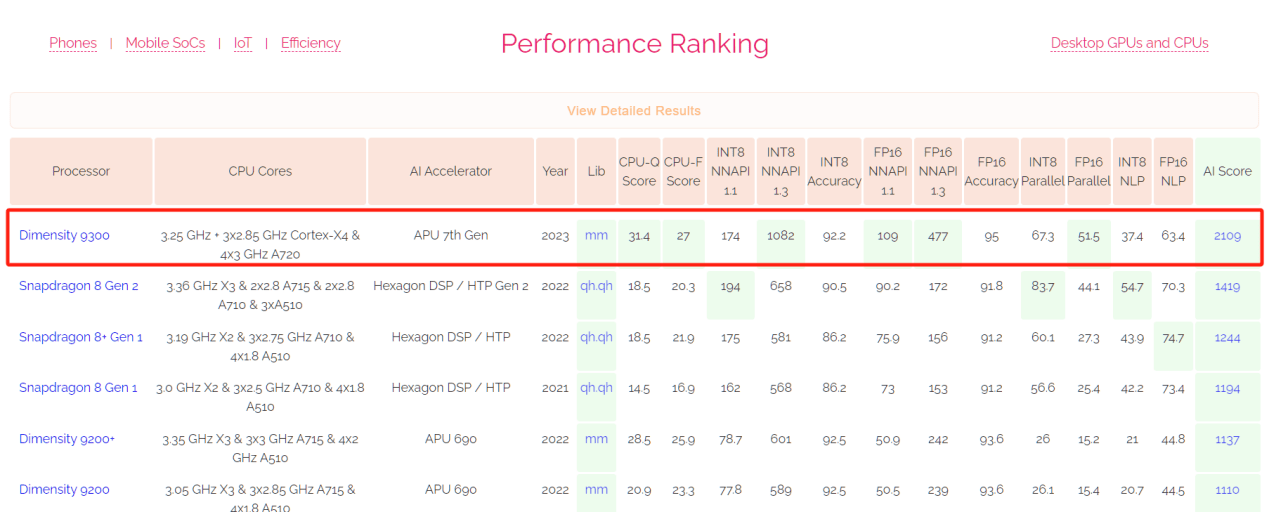

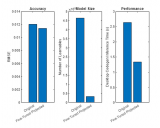

同时APU 790的性能和能效得到显著提升,整数运算和浮点运算能力提升至前一代的2倍,苏黎世ETHZv5.1 AI-Benchmark Mobile Soc跑分2109 分,AI性能成功霸榜,功耗更是降低了45%。在强大的AI性能支持下,1秒以内即可生成图片。天玑9300强悍的AI算力、创新的全大核CPU架构和Immortalis-G720 GPU都为端侧运行生成式AI打下坚实的性能基础。

同时,基于亿级参数大语言模型的特性,联发科开发了混合精度 INT4 量化技术,结合联发科特有的内存硬件压缩技术NeuroPilot Compression,可以更高效地利用内存带宽,大幅减少AI大模型占用终端内存,为端侧运行AI大语言模型突破手机内存限制,助力更大参数模型在端侧落地。

基于以上,天玑9300首次在vivo旗舰手机端侧落地70亿参数AI大语言模型,处理速度可达20 Tokens每秒。不仅如此,联发科突破了行业极限,已经与vivo成功在端侧运行了130亿参数的大语言模型。甚至,天玑9300已率先实现在移动芯片上成功运行330亿参数的AI大语言模型,领跑业界。

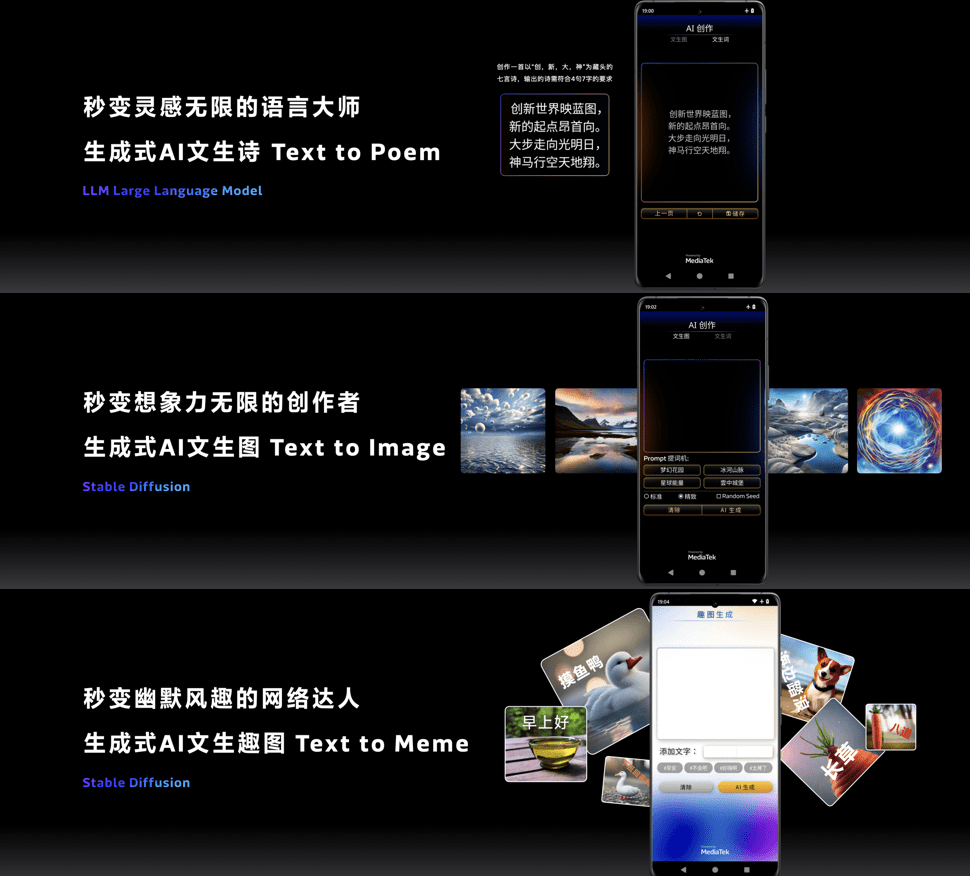

天玑9300还支持多模态生成式AI大模型,打造出“文生诗”“文生图”“文生趣图”等丰富有趣的端侧体验。

可见,天玑9300的AI算力和端侧生成式AI能力已领先行业,足以让用户随时随地AI创造力全飙。

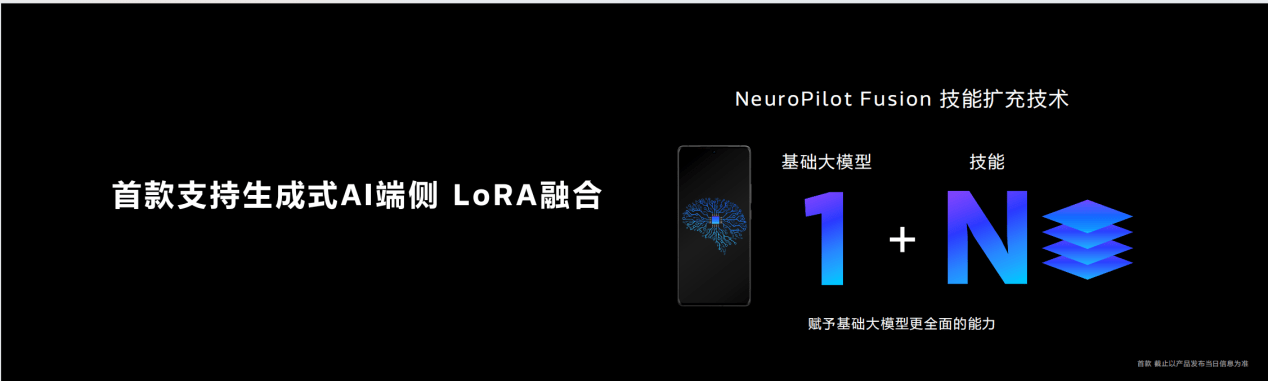

生成式AI模型端侧技能扩充,带来全面、丰富的端侧生成式AI体验

与云侧生成式AI解决方案不同,由于硬件环境的差异,部署端侧生成式AI也需要考虑手机内存、存储容量、负载上限等因素。为此,联发科率先提出了先进的解决方案。

APU 790 支持生成式AI模型端侧技能扩充技术NeuroPilot Fusion,它可以基于基础大模型持续在端侧进行低秩自适应(LoRA,Low-Rank Adaptation)融合,在混合式AI的赋能下,可以基于1个基础大模型,通过云端训练,在端侧完成N个功能的融合,赋予基础大模型更全面、更丰富的生成式AI应用能力。

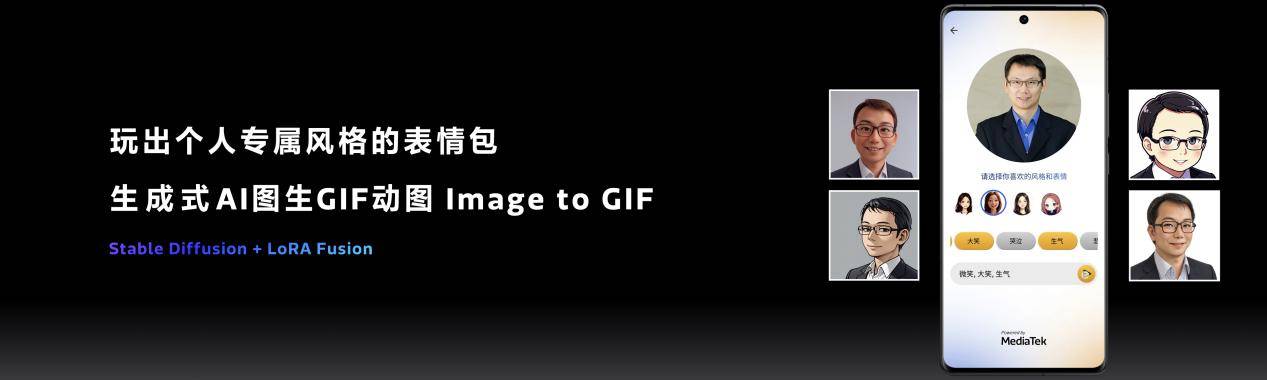

比如基于AI模型端侧技能扩充技术的“图生GIF动图”功能,用户可以根据一张照片更换不同的风格甚至表情,玩出个人专属风格的表情包,秒变表情包小达人。

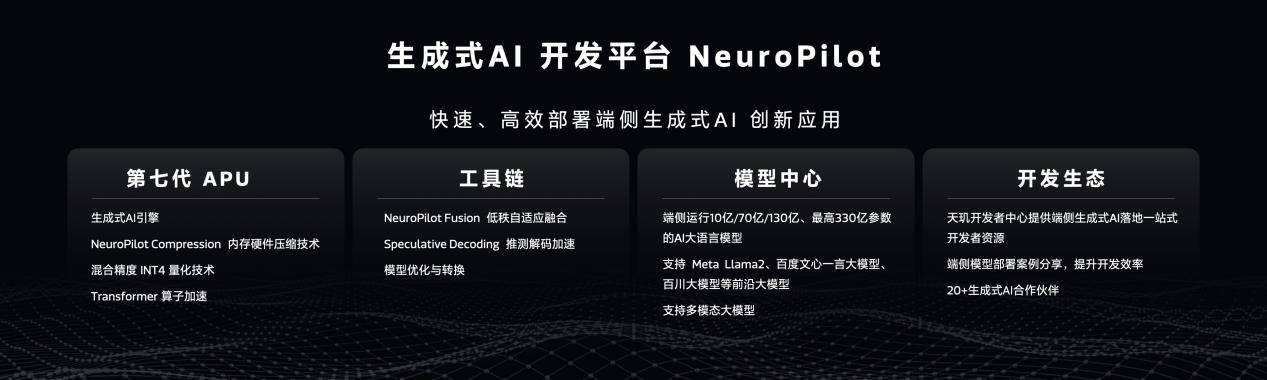

AI开发平台NeuroPilot加速端侧生成式AI生态布局

基于强大的AI算力和先进的内存硬件压缩技术、AI模型端侧技能扩充等技术,天玑9300的APU 790将端侧生成式AI的速度和广度提升到了全新的水平。同时,为加速生成式AI在端侧部署和普及,联发科也凭借其AI开发平台NeuroPilot构建了丰富的AI生态,从底层硬件到工具链、模型中心以及开发生态,助力生态快速、高效地部署端侧生成式AI应用。

AI开发平台NeuroPilot支持Android、Meta LIama 2、百度文心一言大模型、百川智能百川大模型等前沿主流AI大模型。

更为重要的是,NeuroPilot拥有一套完整且先进的工具链,除了NeuroPilot Compression低秩自适应融合,还有Speculative Decoding推测解码加速和模型优化与转化技术。

联发科的天玑开发者中心还可提供端侧生成式AI落地一站式开发者资源,分享端侧模型部署案例提升开发效率。目前已有20多个生成式AI合作伙伴加入生态共建。

联发科还携手业界合同伙伴打造精彩的生成式AI应用体验。虹软的生成式AI超级分辨率技术基于天玑9300 APU 边缘计算能力,相比前代,性能可提升30%。在25倍放大的拍摄时,利用生成式AI超级分辨率技术,可以拍出细节更真实的图像效果。

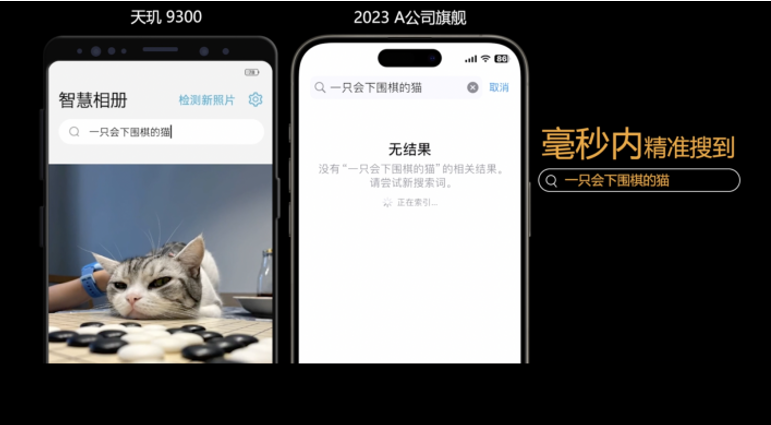

极感科技的生成式AI语意搜索技术也基于天玑9300 APU边缘计算能力,对比前代,性能可提升260%。比如在手机的相册中搜索照片,描述照片的内容即可在毫秒内精准搜到对应的照片。而且在断网状态下也能搜索,隐私也不会泄露。

Morpho的视频通话实时数字分身生成技术,同样基于天玑9300 APU边缘计算能力,对比前代,性能提升26%。一般的虚拟人像生成器需手动选取容貌样式花费时间。但基于视频通话实时数字分身生成技术,用户操作容易,仅需打开摄像头单帧图片即可瞬间生成数字分身。

基于天玑9300 APU边缘计算能力,慧鲤生成式AI防眩光技术性能可提升60%。在此技术加持下,无论是室外还是室内,在拍摄时如有眩光,只要轻松一暗即可消除眩光干扰。

可以看到,在AI端云融合的趋势下,天玑9300在AI算力、生成式AI用户体验和生态方面展现出全面的优势,为新一代旗舰级端侧生成式AI体验树立了新的标杆,强大生成式AI就要用天玑。

其同时,联发科等领军生成式AI的公司无时无刻不在通过技术创新和生态建造,积极推进混合式AI计算,开创出具有特色和效率的途径来推动端侧生成式AI部署的发展,以期将生成式AI在端侧普及,让越来越多的用户享有特色化的端侧AI体验,构建智能全域新体验,让科技更普惠大众。

-

联发科

+关注

关注

57文章

2750浏览量

259877 -

内存

+关注

关注

9文章

3234浏览量

76512 -

AI

+关注

关注

91文章

41109浏览量

302597 -

大模型

+关注

关注

2文章

3771浏览量

5272 -

天玑9300

+关注

关注

3文章

53浏览量

652 -

AI大模型

+关注

关注

0文章

407浏览量

1038

发布评论请先 登录

存储芯片闪崩!谷歌发布新算法,AI内存占用只需原来1/6?

忆联自研芯片以压缩技术重塑KV Cache存储效率

南亚科技3D堆叠AI内存UltraWIO技术

如何利用NPU与模型压缩技术优化边缘AI

天玑9300内存硬件压缩技术大幅降低手机AI大模型内存占用 行业第一

天玑9300内存硬件压缩技术大幅降低手机AI大模型内存占用 行业第一

评论