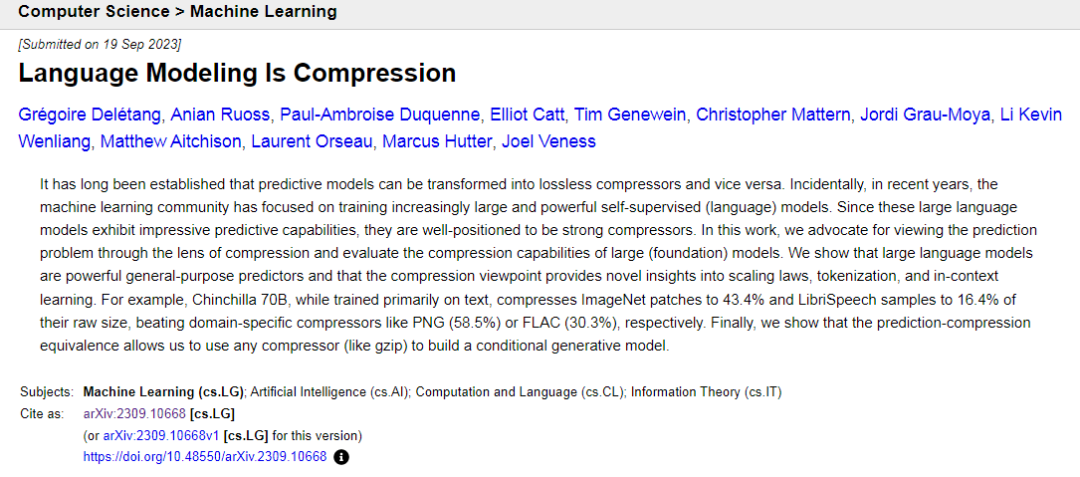

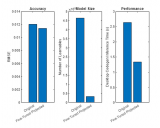

Google DeepMind 和 Meta 的研究人员发表论文《Language Modeling Is Compression》,他们发现 DeepMind 的大语言模型 Chinchilla 70B 在图像和音频的无损压缩上超过了 PNG 和 FLAC。

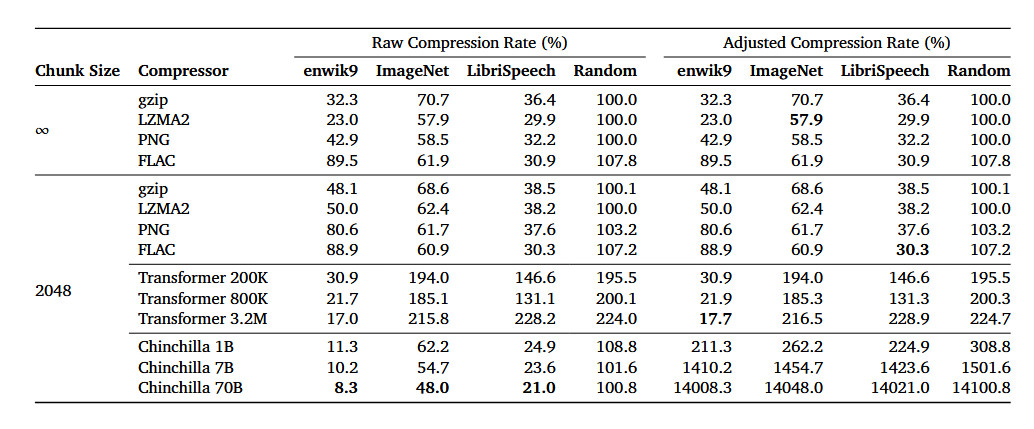

论文提到,Chinchilla 70B 能将 ImageNet 图像数据库中的图像无损压缩到原始大小 43.4%,超过了 PNG 算法的 58.5%。

Chinchilla 能将 LibriSpeech 音频数据集中的样本无损压缩到原始大小 16.4%,超过 FLAC 算法的 30.3%。

据介绍,Chinchilla 70B 主要是训练用于处理文本,但它在压缩其它类型的数据集上的效果也表现优异,甚至优于专门的算法。

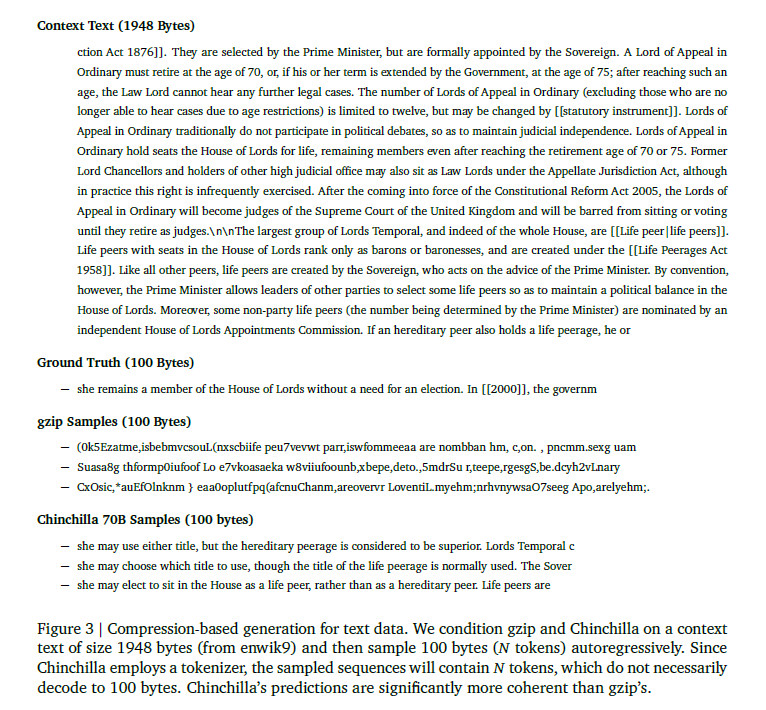

下面的例子比较了 gzip 和 Chinchilla 在示例文本上的压缩效果。可以看到,gzip 的输出没有可读性。

编辑:黄飞

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

无损压缩

+关注

关注

0文章

12浏览量

8609 -

FLAC

+关注

关注

0文章

4浏览量

8768 -

png

+关注

关注

0文章

14浏览量

4716 -

大模型

+关注

关注

2文章

3772浏览量

5273

原文标题:大模型在无损压缩方面超越PNG和FLAC

文章出处:【微信号:OSC开源社区,微信公众号:OSC开源社区】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

相关推荐

热点推荐

面向嵌入式部署的神经网络优化:模型压缩深度解析

1.为什么需要神经网络模型压缩? 神经网络已经成为解决复杂机器学习问题的强大工具。然而,这种能力往往伴随着模型规模和计算复杂度的增加。当输入维度较大(例如长时序窗口、高分辨率特征空间)时,模型

在AI基础设施中部署大语言模型的三大举措

文:Gartner研究副总裁周玲中国企业机构已逐步在生产环境中运行或者计划运行大语言模型,但在AI基础设施的生产部署与高效运营方面仍面临诸多挑战。目前,中国正加速提升其生成式AI能力,覆盖大语

什么是大模型,智能体...?大模型100问,快速全面了解!

一、概念篇1.什么是大模型?大模型是指参数规模巨大(通常达到数十亿甚至万亿级别)、使用海量数据训练而成的人工智能模型。2.什么是大语言模型(

linux的压缩和解压操作

进行压缩,然后传输压缩的文件,这样可以减少文件传输所需要的带宽和时间,在网络接收到文件之后再解压,就可以得到文件了。

文件的压缩有两种方式:有损压缩和

发表于 12-23 06:56

电能质量在线监测装置数据压缩对装置性能有哪些影响?

降至工业级可接受范围, 不会影响核心监测功能(如采样精度、故障响应) 。以下是分维度的专业解析: 一、核心性能影响维度(分装置定位 + 压缩类型) 1. CPU 占用:硬件加速是关键,无损压缩影响极小 数据压缩 / 解压本质是计

电能质量在线监测装置支持哪些数据压缩算法?

电能质量在线监测装置支持 无损压缩 和 有损压缩 两大类算法,适配不同数据类型(实时数据、历史数据、波形数据)与应用场景(存储 / 传输 / 故障追溯),且在基础型、增强型、电网级装置中支持力度逐步

国庆出国游,时空壶新T1翻译机,首个端侧模型突破助力跨语言交流

的旗舰机型,最大亮点是搭载业内首个端侧AI翻译模型。这一模型将原本依赖云端算力的复杂AI翻译模型,通过先进的模型剪枝、量化压缩等技术,巧妙部

3万字长文!深度解析大语言模型LLM原理

我们正在参加全球电子成就奖的评选,欢迎大家帮我们投票~~~谢谢支持本文转自:腾讯技术工程作者:royceshao大语言模型LLM的精妙之处在于很好地利用数学解决了工业场景的问题,笔者基于过往工程经验

利用自压缩实现大型语言模型高效缩减

随着语言模型规模日益庞大,设备端推理变得越来越缓慢且耗能巨大。一个直接且效果出人意料的解决方案是剪除那些对任务贡献甚微的完整通道(channel)。我们早期的研究提出了一种训练阶段的方法——自压缩

欧洲借助NVIDIA Nemotron优化主权大语言模型

NVIDIA 正携手欧洲和中东的模型构建商与云提供商,共同优化主权大语言模型 (LLM),加速该地区各行业采用企业级 AI。

小白学大模型:从零实现 LLM语言模型

在当今人工智能领域,大型语言模型(LLM)的开发已经成为一个热门话题。这些模型通过学习大量的文本数据,能够生成自然语言文本,完成各种复杂的任务,如写作、翻译、问答等。https

如何借助大语言模型打造人工智能生态系统

大语言模型(LLMs)正以革命性的姿态重塑我们与科技的互动模式。然而,由于其庞大的规模,它们往往属于资源密集型范畴,不仅大幅推高了成本,还造成了能源消耗的激增。本文深入剖析了大语言模型

大语言模型无损压缩方面超越PNG和FLAC

大语言模型无损压缩方面超越PNG和FLAC

评论