近日在北京举行的2023年中国国际服务贸易交易会(下文简称:服贸会)上,作为英特尔人工智能产品组合的重要成员,Habana Gaudi2实力亮相,它在海内外诸多大语言模型(Large Language Model,下文简称:LLM)的加速上,已展现了出众实力,成为业界焦点。

AI技术飞速发展,LLM风起云涌,但由于AI模型尤其是LLM的训练与推理需要消耗大量资源和成本,在生产环境部署和使用这些模型变得极具挑战。如何提升性能降低开销,使AI技术更快普及,是行业内共同关注的话题。

专为加速LLM的训练和推理设计

Habana Gaudi2 正是专为高性能、高效率大规模深度学习任务而设计的AI加速器,具备24个可编程Tensor处理器核心(TPCs)、21个100Gbps(RoCEv2)以太网接口、96GB HBM2E内存容量、2.4TB/秒的总内存带宽、48MB片上SRAM,并集成多媒体处理引擎。该加速器能够通过性能更高的计算架构、更先进的内存技术和集成RDMA实现纵向扩展,为中国用户提供更高的深度学习效率与更优性价比。Gaudi2 的计算速度十分出色,它的架构能让加速器并行执行通用矩阵乘法 (GeMM) 和其他运算,从而加快深度学习工作流。这些特性使 Gaudi2 成为 LLM 训练和推理的理想选择,亦将成为大规模部署AI的更优解。

在服贸会上,英特尔展示了Habana Gaudi2 对ChatGLM2-6B的加速能力。ChatGLM2-6B是开源中英双语对话模型ChatGLM-6B的第二代版本,加强了初代模型对话流畅等优质特性。得益于专为深度学习设计的架构,Habana Gaudi2 可以灵活地满足单节点、多节点的大规模分布式大语言模型训练,在ChatGLM2-6B上,能够支持更长的上下文,并带来极速对话体验。

在千亿参数大模型上大显身手

实际上,Habana Gaudi2 的卓越性能早已崭露头角。在今年6月公布的MLCommonsMLPerf基准测试中,Gaudi2在GPT-3模型、计算机视觉模型ResNet-50(使用8个加速器)、Unet3D(使用8个加速器),以及自然语言处理模型BERT(使用8个和64个加速器)上均取得了优异结果。近日,MLCommons又继续公布了针对60亿参数大语言模型及计算机视觉与自然语言处理模型GPT-J的MLPerf推理v3.1性能基准测试结果,其中包括基于Habana Gaudi2加速器、第四代英特尔至强可扩展处理器,以及英特尔至强CPU Max系列的测试结果。

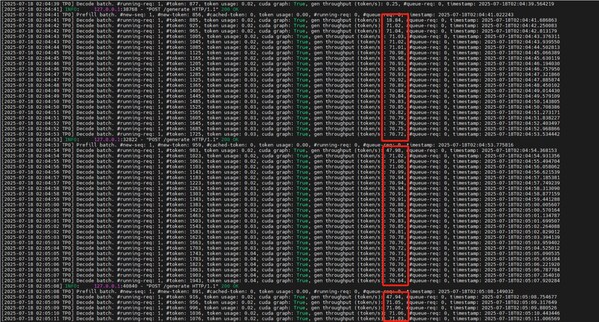

数据显示,Habana Gaudi2在GPT-J-99 和GPT-J-99.9 上的服务器查询和离线样本的推理性能分别为78.58 次/秒和84.08 次/秒。该测试采用 FP8数据类型,并在这种新数据类型上达到了 99.9% 的准确率,这无疑再一次印证了Gaudi2的出色性能。此外,基于第四代英特尔至强可扩展处理器的7个推理基准测试也显示出其对于通用AI工作负载的出色性能。截至目前,英特尔仍是唯一一家使用行业标准的深度学习生态系统软件提交公开CPU结果的厂商。

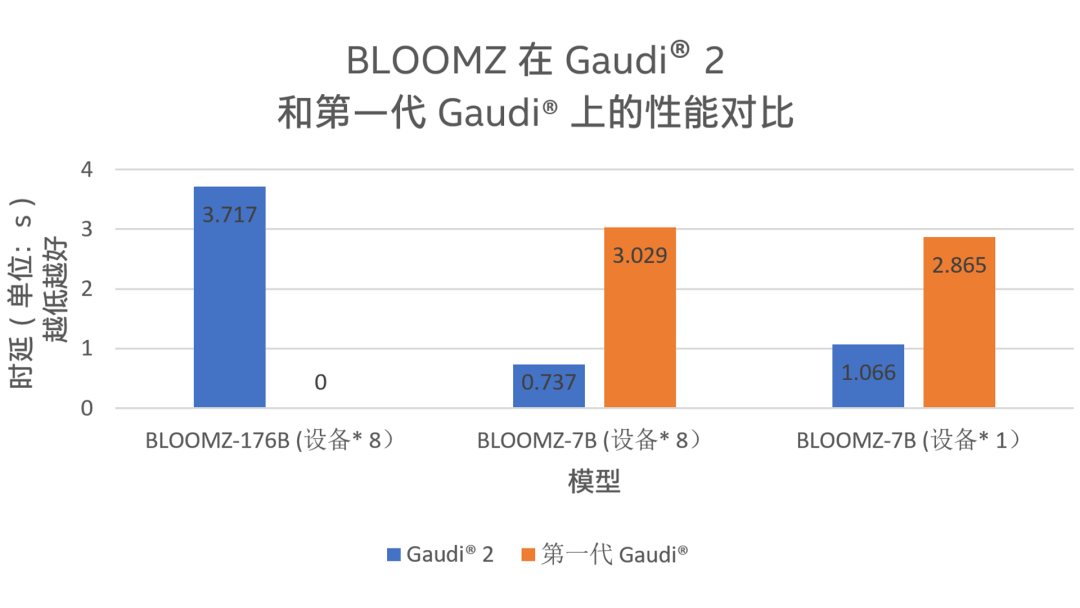

另一个让Habana Gaudi2 大显身手的模型是BLOOMZ。BLOOM是一个拥有 1760 亿参数的自回归模型,训练后可用于生成文本序列,它可以处理 46 种语言和 13 种编程语言,而BLOOMZ是与BLOOM架构完全相同的模型,它是BLOOM基于多个任务的调优版本。Habana与著名AI平台Hugging Face合作进行了 Gaudi2 在BLOOMZ模型上的基准测试1。如图1所示,对于参数量达1760亿的模型 BLOOMZ(BLOOMZ-176B),Gaudi2性能表现出色,时延仅为约3.7 秒;对于参数量为 70 亿的较小模型 BLOOMZ-7B,Gaudi2 的时延优势更加显著,单设备约为第一代 Gaudi 的37.21%,而当设备数量都增加为8后,这一百分比进一步下降至约24.33%。

图 1. BLOOMZ 在 Gaudi2 和第一代 Gaudi 上的推理时延测试结果

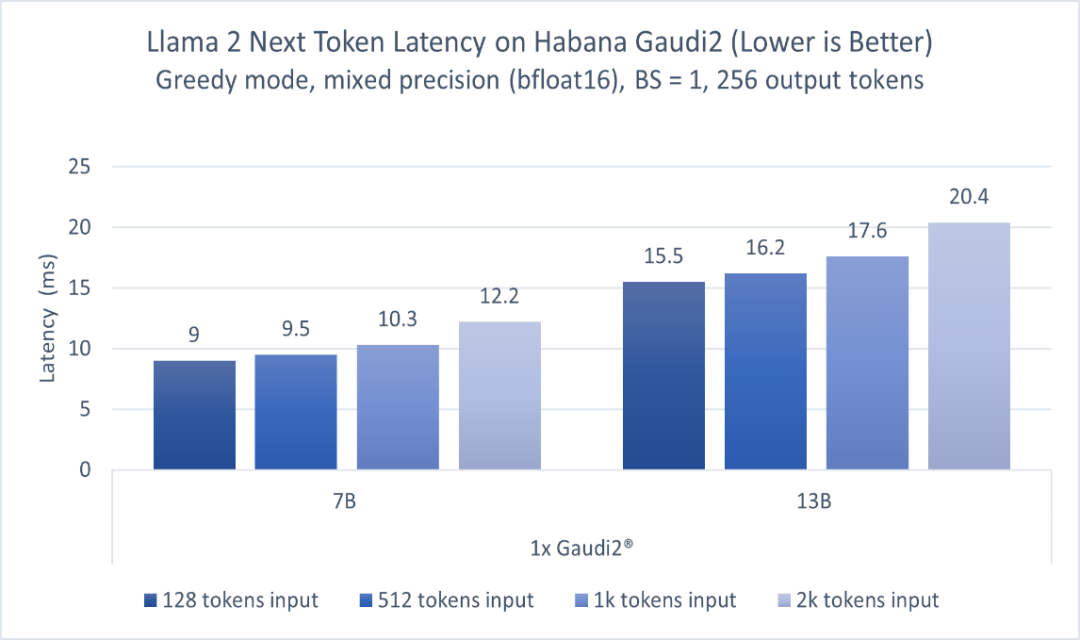

此外,在Meta发布的开源大模型Llama 2上,Gaudi2的表现依然出众。图2显示了70亿参数和130亿参数两种Llama 2模型的推理性能。模型分别在一台Habana Gaudi2设备上运行,batch size=1,输出token长度256,输入token长度不定,使用BF16精度。报告的性能指标为每个token的延迟(不含第一个)。对于128至2000输入token,在70亿参数模型上Gaudi2的推理延迟范围为每token 9.0-12.2毫秒,而对于130亿参数模型,范围为每token 15.5-20.4毫秒2。

图 2.基于HabanaGaudi2,70亿和130亿参数Llama 2模型的推理性能

值得一提的是,Habana 的SynapseAI 软件套件在模型部署和优化的过程中起到了至关重要的作用。SynapseAI 软件套件不仅支持使用 PyTorch 和 DeepSpeed 来加速LLM的训练和推理,还支持 HPU Graph和DeepSpeed-inference,这两者都非常适合时延敏感型应用。因此,在Habana Gaudi2上部署模型非常简单,尤其是对LLM等数十亿以上参数的模型推理具有较优的速度优势,且无需编写复杂的脚本。

LLM的成功堪称史无前例。有人说,LLM让AI技术朝着通用人工智能(AGI)的方向迈进了一大步,而因此面临的算力挑战也催生了更多技术的创新。Habana Gaudi2 正是在这一背景下应运而生,以其强大的性能和性价比优势加速深度学习工作负载。Habana Gaudi2的出色表现更进一步显示了英特尔AI产品组合的竞争优势,以及英特尔对加速从云到网络到边缘再到端的工作负载中大规模部署AI的承诺。英特尔将持续引领产品技术创新,丰富和优化包括英特尔 至强 可扩展处理器、英特尔 数据中心GPU等在内的AI产品组合,助力中国本地AI市场发展。

参考资料:

1.https://huggingface.co/blog/zh/habana-gaudi-2-bloom

2.Habana Gaudi2深度学习加速器:所有测量使用了一台HLS2 Gaudi2服务器上的Habana SynapseAI 1.10版和optimum-habana 1.6版,该服务器具有八个Habana Gaudi2 HL-225H Mezzanine卡和两个英特尔 至强 白金8380 CPU@2.30GHz以及1TB系统内存。2023年7月进行测量。

-

英特尔

+关注

关注

61文章

10321浏览量

181081 -

cpu

+关注

关注

68文章

11327浏览量

225887

原文标题:Hold住千亿参数大模型,Gaudi®2 有何优势

文章出处:【微信号:英特尔中国,微信公众号:英特尔中国】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

分体 T5 LED 灯管有何优势?郎特科技为你解答

VLA与世界模型有什么不同?

国产AI芯片真能扛住“算力内卷”?海思昇腾的这波操作藏了多少细节?

浅谈SPICE模型参数自动化提取

英特尔Gaudi 2E AI加速器为DeepSeek-V3.1提供加速支持

医院专用数据记录仪产品有哪些?有何推荐?

TC377配置SMU FSP时,如何配置频率参数;三种模式有何区别,配置上有何区别?

Groq LPU 如何让万亿参数模型「飞」起来?揭秘 Kimi K2 40 倍提速背后的黑科技

万亿参数!元脑企智一体机率先支持Kimi K2大模型

【VisionFive 2单板计算机试用体验】3、开源大语言模型部署

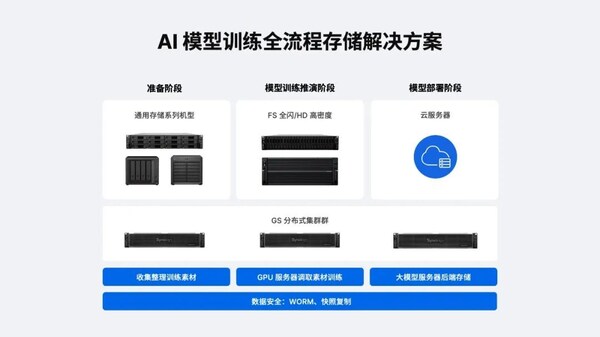

群晖发布AI模型全流程存储解决方案,破局训练效率与数据孤岛难题

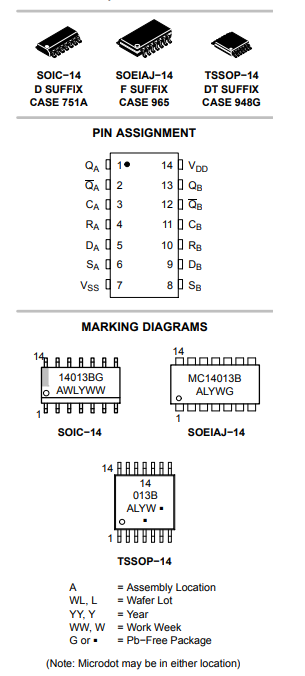

ON Semiconductor MC14013BDTR2G 双D型触发器参数特性 EDA模型 数据手册

Hold住千亿参数大模型,Gaudi®2 有何优势

Hold住千亿参数大模型,Gaudi®2 有何优势

评论