英特尔产品在全新MLCommons AI推理性能测试中尽显优势

今日,MLCommons公布针对 60 亿参数大语言模型及计算机视觉与自然语言处理模型GPT-J的 MLPerf推理v3.1 性能基准测试结果,其中包括英特尔所提交的基于Habana®Gaudi®2 加速器、第四代英特尔®至强®可扩展处理器,以及英特尔®至强®CPU Max 系列的测试结果。该结果显示了英特尔在AI推理方面极具竞争力的表现,并进一步加强了其对加速从云到网络到边缘再到端的工作负载中大规模部署AI的承诺。

英特尔执行副总裁兼数据中心与人工智能事业部总经理Sandra Rivera表示:“正如最新的 MLCommons结果显示,我们拥有强大的、具有竞争力的人工智能产品组合以满足客户对高性能、高效率的深度学习推理及训练的需求,同时,针对各种规模的人工智能模型,英特尔产品组合均具有领先的性价比优势。”

根据6月披露的MLCommonsAI训练结果和Hugging Face性能基准测试验证,Gaudi2 在先进的视觉语言模型上,性能可以超越英伟达的H100处理器,而今天的结果进一步证明了英特尔能够提供满足AI计算需求的、英伟达H100和A100的唯一可行的替代方案。

考虑到客户的个性化需求,英特尔正在通过能够帮助解决AI工作负载中推理与训练问题的产品,让AI无处不在。英特尔的AI产品为客户提供了可根据各自性能、效率及目标成本进行灵活匹配以获取最佳AI解决方案的理想选择,同时亦帮助客户开放生态系统。

关于Habana Gaudi2的测试结果:

Habana Gaudi2在GPT-J模型上的推理结果强有力地验证了其具有竞争力的性能。

·Gaudi2 在GPT-J-99 和GPT-J-99.9 上的服务器查询和离线样本的推理性能分别为78.58 次/秒和84.08 次/秒。

·与英伟达H100相比,Gaudi2提供了令人信服的卓越性能,H100相对于Gaudi2仅表现出 1.09 倍(服务器)和 1.28 倍(离线)的轻微性能优势。

·Gaudi2 拥有高于英伟达A100 2.4 倍(服务器)、 2 倍(离线)的性能。

·Gaudi2 提交的结果采用 FP8数据类型,并在这种新数据类型上达到了 99.9% 的准确率。

随着每6-8周公布的 Gaudi2 软件更新,英特尔将继续在 MLPerf 基准测试中展现其产品的性能提升,以及持续扩大的模型覆盖范围。

Habana Gaudi2 在GPT-J模型上的推理结果验证了其具有竞争力的性能

关于第四代至强可扩展处理器的测试结果:

英特尔提交了基于第四代英特尔至强可扩展处理器的7个推理基准测试,其中包括GPT-J模型。结果显示,包括视觉、语言处理、语音和音频翻译模型,以及更大的 DLRM v2 深度学习推荐模型及ChatGPT-J 模型在内,第四代至强处理器对于通用 AI 工作负载拥有出色的性能。此外,截至目前,英特尔仍是唯一一家使用行业标准的深度学习生态系统软件提交公开 CPU 结果的厂商。

·第四代英特尔至强可扩展处理器是通过流行的AI框架与库构建及部署通用AI工作负载的理想选择。对于GPT-J对约 1000-1500 字新闻稿进行100 字总结的任务,第四代至强可扩展处理器可在离线模式下完成每秒两段的总结提要,在实时服务器模式下完成每秒一段的总结提要。

·英特尔首次提交了英特尔至强CPU Max 系列的MLPerf 结果,该系列可提供高达64 GB的高带宽内存。对于 GPT-J而言,它是仅有的能够达到 99.9% 准确度的 CPU,这对于对精度要求极高的应用来说至关重要。

·英特尔与OEM厂商合作提交了测试结果,进一步展示了其AI性能的可扩展性,以及基于英特尔至强处理器的通用服务器的可获取性,充分满足客户服务水平协议 (SLA)。

第四代至强可扩展处理器是构建及部署通用AI工作负载的理想选择

MLPerf 是业内享有盛名的 AI 性能基准测试,旨在实现公平、可重复的产品性能比较。英特尔计划为下一个 MLPerf测试提交新的AI训练性能结果。持续的性能更新彰显了英特尔致力于帮助客户、助力AI技术演进所迈出的每一步,无论是低成本的AI处理器,还是面向网络、云和企业用户的高性能AI硬件加速器或是 GPU。

更多内容:基于MLPerf v.31 推理的性能指标(基准结果)|MLCommons公告

说明:相关配置说明,请查看MLCommons网页。 结果可能不同。

审核编辑 黄宇

-

处理器

+关注

关注

68文章

20368浏览量

255534 -

GPT

+关注

关注

0文章

375浏览量

17008 -

MLPerf

+关注

关注

0文章

37浏览量

990

发布评论请先 登录

DeepSeek V3.1发布!拥抱国产算力芯片

华为云首发适配DeepSeek-V4模型

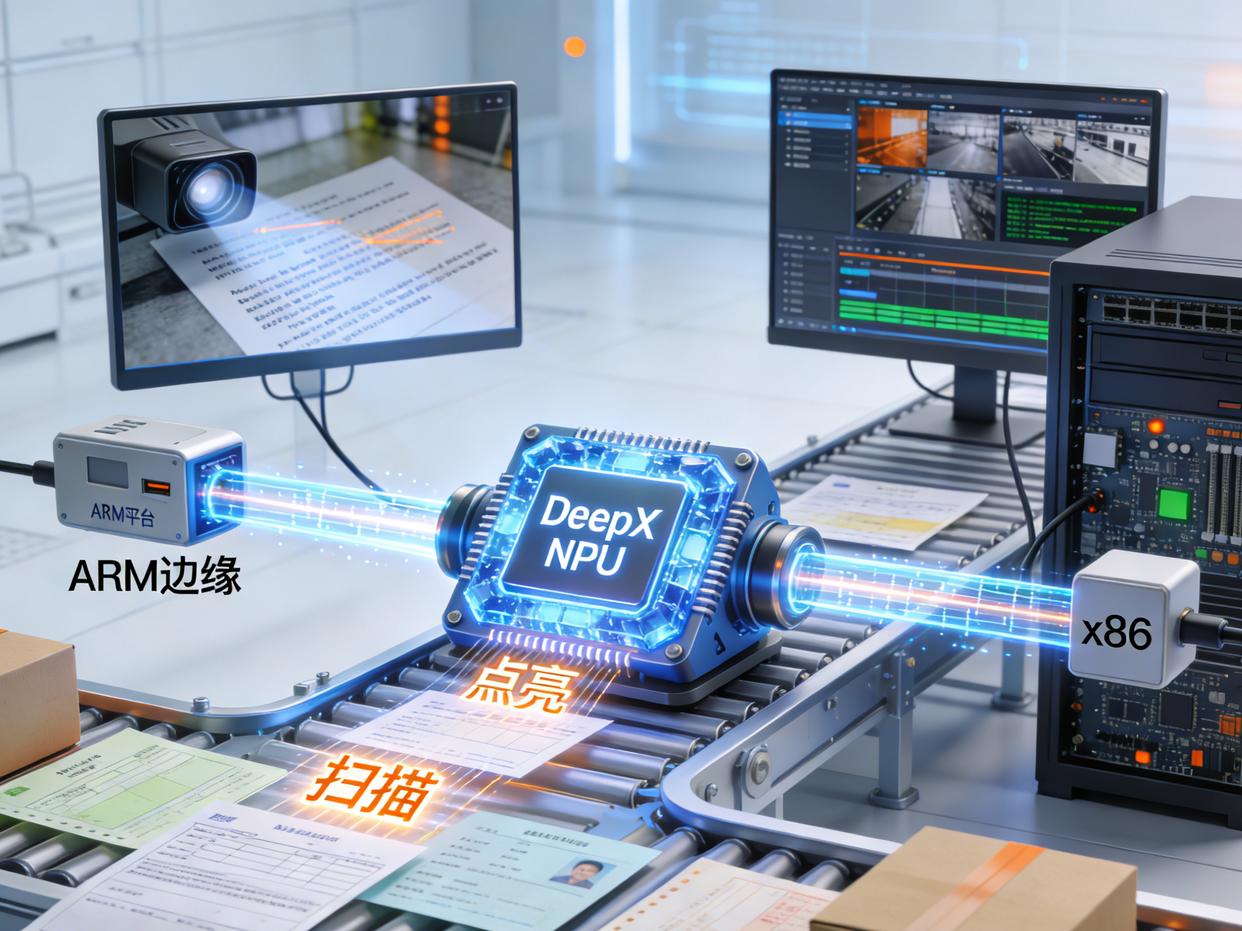

DeepX OCR:以 DeepX NPU 加速 PaddleOCR 推理,在 ARM 与 x86 平台交付可规模化的高性能 OCR 能力

Powered by XuanTie,Qwen Inside:阿里通义大模型携手玄铁 RISC-V开启“端侧智能”新纪元

GPT-5.1发布 OpenAI开始拼情商

NVIDIA TensorRT LLM 1.0推理框架正式上线

使用NVIDIA NVLink Fusion技术提升AI推理性能

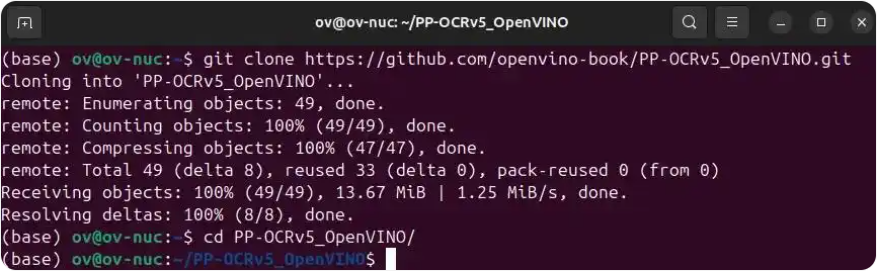

使用OpenVINO将PP-OCRv5模型部署在Intel显卡上

亚马逊云科技宣布推出Qwen3与DeepSeek-V3.1模型的完全托管服务

DeepSeek R1 MTP在TensorRT-LLM中的实现与优化

英特尔Gaudi 2E AI加速器为DeepSeek-V3.1提供加速支持

NVIDIA从云到边缘加速OpenAI gpt-oss模型部署,实现150万TPS推理

最新MLPerf v3.1测试结果认证,Gaudi2在GPT-J模型上推理性能惊人

最新MLPerf v3.1测试结果认证,Gaudi2在GPT-J模型上推理性能惊人

评论