电子发烧友网报道(文/李弯弯)日前,在2023世界半导体大会暨南京国际半导体博览会上,高通全球副总裁孙刚发表演讲时谈到,目前高通能够支持参数超过10亿的模型在终端上运行,未来几个月内超过100亿参数的模型将有望在终端侧运行。

大模型在终端侧运行的重要性

生成式AI正在快速发展,数据显示,2020年至2022年,生成式AI相关的投资增长425%,初步预估生成式AI市场规模将达到1万亿美元。

然而孙刚指出,云经济难以支持生成式AI规模化拓展,为实现规模化拓展,AI处理的中心正在向边缘转移。比如XR、汽车、手机、PC、物联网,生成式AI将影响各类终端上的应用。

高通在这方面展示出了领先的优势,高通AI引擎由多个硬件和软件组件组成,用于在骁龙移动平台上为终端侧AI推理加速。它采用异构计算架构,包括高通Hexagon处理器、Adreno GPU、Kryo CPU和传感器中枢,共同支持在终端上运行AI应用程序。

在7月初的2023年世界人工智能大会上,高通就已经展示了全球首个在终端侧运行生成式AI(AIGC)模型Stable Diffusion的技术演示,和全球最快的终端侧语言-视觉模型(LVM)ControlNet运行演示。这两款模型的参数量已经达到10亿-15亿,仅在十几秒内就能够完成一系列推理,根据输入的文字或图片生成全新的AI图像。

今年7月18日,Meta官宣将发布其开源大模型LLaMA的商用版本,为初创企业和其他企业提供了一个强大的免费选择,以取代OpenAI和谷歌出售的昂贵的专有模型。随后,高通发布公告称,从2024年起,Llama 2将能在旗舰智能手机和PC上运行。

高通技术公司高级副总裁兼边缘云计算解决方案业务总经理Durga Malladi表示,为了有效地将生成式人工智能推广到主流市场,人工智能将需要同时在云端和边缘终端(如智能手机、笔记本电脑、汽车和物联网终端)上运行。

在高通看来,和基于云端的大语言模型相比,在智能手机等设备上运行Llama 2 等大型语言模型的边缘云计算具有许多优势,不仅成本更低、性能更好,还可以在断网的情况下工作,而且可以提供更个性化、更安全的AI服务。

如何让大模型在终端规模化扩展

生成式AI进入未来生活的趋势已经不可阻挡,为了让生成式AI规模化扩展到更多终端设备中,高通提出了混合AI架构的运行方式,即在云端和设备终端的边缘侧之间分配算力,协同处理AI工作负载。

所谓混合AI,是指充分利用边缘侧终端算力支持生成式AI应用的方式,相比仅在云端运行的AI,前者能够带来高性能、个性化且更安全的体验。

比如,如果模型、提示或生成内容的长度小于某个限定值,且精度足够,推理就可以完全在终端侧进行;如果任务相对复杂,则可以部分依靠云端模型;如果需要更多实时内容,模型也可以接入互联网获取信息。

在未来,不同的生成式AI用不同分流方式的混合AI架构,AI也能在此基础上持续演进:

大量生成式AI的应用,比如图像生成或文本创作,需求AI能够进行实时响应。在这种任务上,终端可通过运行不太复杂的推理完成大部分任务。

在AI计算的实现上,软件和硬件同样重要,因为必须在端侧做到运算更快,效率更高,并推动AI应用在广泛终端上的部署和普及。

高通在2022年6月推出AI软件栈(Qualcomm AI Stack),其支持包括TensorFlow、Pytorch和ONNX在内的所有主流开发框架,所有runtimes(运行时,即某门编程语言的运行环境)和操作系统。借助高通AI软件栈,开发者在智能手机领域开发的软件可以快速扩展至汽车、XR、可穿戴设备等其他产品线进行使用。

高通技术公司产品管理高级副总裁兼AI负责人Ziad Asghar表示,未来公司需要加大终端侧技术上的研发,尤其是进一步提升量化的算法。例如服务器上训练的模型一般采用32位浮点运算(FP32),而我们在手机端现在能够支持INT4计算,这能大大提高端侧的处理能力。

小结

不仅仅是大模型的训练需要极大的算力和功耗,部署也同样如此。如果要让大模型在更多的领域实现落地应用,除了在云端部署之后,在终端侧部署也很关键。目前已经有诸多厂商在该领域进行探索,包括高通,期待未来大模型能够走进人们生活的方方面面。

-

高通

+关注

关注

78文章

7759浏览量

200516

发布评论请先 登录

AI大模型微调企业项目实战课

工作流大模型节点说明

深入剖析LM9061与LM9061 - Q1高侧保护控制器

如何在NVIDIA Jetson AGX Thor上部署1200亿参数大模型

TSC101 高侧电流检测放大器:特性、参数与应用全解析

广和通发布端侧情感对话大模型FiboEmo-LLM

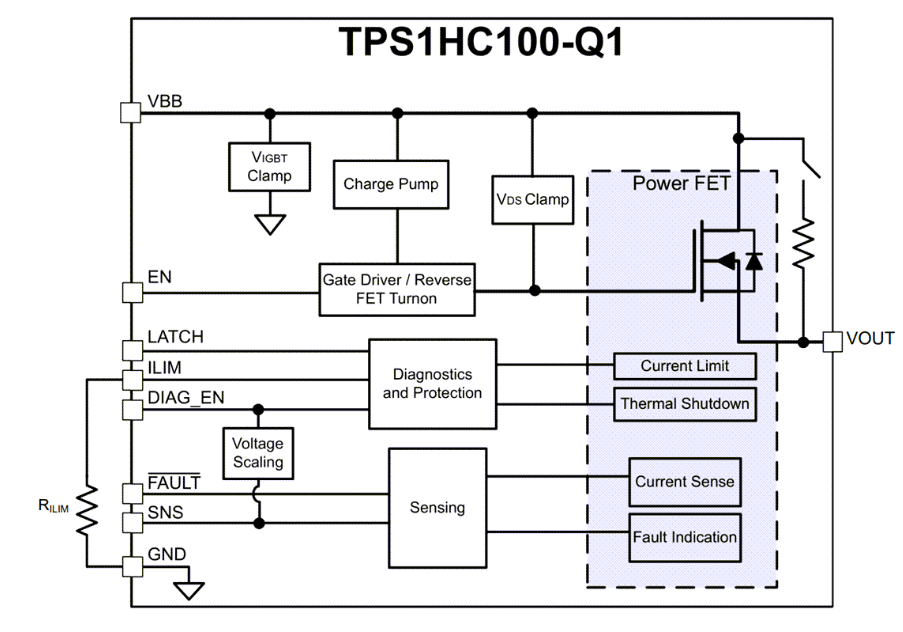

TPS1HC100-Q1智能高侧开关技术解析与应用指南

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI的未来:提升算力还是智力

谷歌推出AI模型Gemma 3 270M

米尔RK3576部署端侧多模态多轮对话,6TOPS算力驱动30亿参数LLM

ALINX VD100低功耗端侧大模型部署方案,运行3B模型功耗仅5W?!

高通:未来几个月有望在终端侧运行超100亿参数的模型

高通:未来几个月有望在终端侧运行超100亿参数的模型

评论