电子发烧友网报道(文/李弯弯)日前,工业富联举行2022年度股东大会,工业富联董事周泰裕在会上表示,工业富联已着手开发下一代AI服务器,并将和客户合作进行AI Cloud data center的托管服务及运维。此外,公司生产的云端游戏服务器已于今年3月量产出货。

工业富联(全称:富士康工业互联网股份有限公司),是国内主要的AI服务器企业之一。今年以来,ChatGPT与AI应用持续升温,工业富联也因此备受关注。

AI服务器市场需求强劲

AI服务器是一种能够提供人工智能(AI)的数据服务器。它既可以用来支持本地应用程序和网页,也可以为云和本地服务器提供复杂的AI模型和服务。

AI服务器采取GPU架构,相较CPU更适合进行大规模并行计算。通用服务器采用CPU作为计算能力来源,而AI服务器为异构服务器,可以根据应用范围采用不同的组合方式,如CPUGPU、CPUTPU、CPU其他加速卡等,主要以GPU提供计算能力。

常见的AI服务器分为四路、八路、十六路。一般来说,通用服务器主要采用以CPU为主导的串行架构,更擅长逻辑运算;而AI服务器主要采用加速卡为主导的异构形式,更擅长做大吞吐量的并行计算。按CPU数量,通用服务器可分为双路、四路和八路等。AI服务器一般仅搭载1-2块CPU,但GPU数量显著占优。按GPU数量,AI服务器可以分为四路、八路和十六路服务器,其中搭载8块GPU的八路AI服务器最常见。

工业富联CEO郑弘孟表示,训练AI大模型,需要有效的大数据和大算力及规模化的参数,因此对GPU的需求呈现直线上升态势,带动AI服务器市场需求走高。

关于下半年AI服务器出货预期,郑弘孟表示,多家全球头部云服务厂商仍在持续提升在AI领域的资本开支,看好下半年市场机会,AI服务器市场比市场预期更大,预期下半年有望强劲增长。换句话说,目前从需求来看AI服务器一季比一季好, 越来越好。

根据研究机构TrendForce近日发布的预测,预计2023年AI服务器的出货量将接近120万台,年增38.4%,占整体服务器出货量近9%,至2026年占比将进一步提升至15%。TrendForce还同步上修了2022-2026年AI服务器出货量年复合增长率至22%。

工业富联看好AI服务器市场

工业富联的云计算服务器产品具有很强的竞争力。郑弘孟此前在业绩说明会上谈到,2017年,工业富联联合合作方推出了全世界第一台AI服务器——HGX1,这台服务器的运算功耗是4.4KW,现在已经迭代到第四代,HGX4的运算能力是HGX1的32倍,出货成本却只是HGX1的3倍。

工业富联2022年年度报告显示,2022年,工业富联实现营收5118.49亿元,同比增长16.4%,首次突破5000亿元营收大关。2022年,工业富联云计算收入达2124.44亿元,同比增 19.56%,连续5年保持增长趋势,且保持了云计算服务器出货量全球第一的市场地位。

在此次举行的2022年度股东大会上,工业富联董事周泰裕表示,随着GPT的发展,未来10年内全球数据中心会不断的推陈出新,预计有超过60%的云服务都与AI应用相关。工业富联正在中国、亚太、北美、欧洲持续扩充服务器产能布局,可以满足当前及未来的业务需求。

此外,今年一季度开始,工业富联在服务器板块做结构性优化,有意下修OEM服务器占比,提升CSP(云服务商) ODM及AI服务器比例。

工业富联与英伟达有着深度合作,郑弘孟表示,过去的H100以及现在的H800都是在工业富联手上完成(组装)的。前几日英伟达创始人兼CEO黄仁勋宣布AI服务器H100已全面量产,并播放了H100自动化产线视频,该视频也是在工业富联自动化产线拍摄完成。

小结

在ChatGPT等AI大模型的训练和部署下,AI服务器的市场需求不断上升。很明显,今年一季度,工业富联等AI服务器厂商的相关营业收入也随之增加。而这可能还只是开始,从今年下半年,乃至未来几年,AI服务器的市场需求将持续增长。在这样的背景下,可以看到相关企业都在加大投资,包括工业富联。

工业富联(全称:富士康工业互联网股份有限公司),是国内主要的AI服务器企业之一。今年以来,ChatGPT与AI应用持续升温,工业富联也因此备受关注。

AI服务器市场需求强劲

AI服务器是一种能够提供人工智能(AI)的数据服务器。它既可以用来支持本地应用程序和网页,也可以为云和本地服务器提供复杂的AI模型和服务。

AI服务器采取GPU架构,相较CPU更适合进行大规模并行计算。通用服务器采用CPU作为计算能力来源,而AI服务器为异构服务器,可以根据应用范围采用不同的组合方式,如CPUGPU、CPUTPU、CPU其他加速卡等,主要以GPU提供计算能力。

常见的AI服务器分为四路、八路、十六路。一般来说,通用服务器主要采用以CPU为主导的串行架构,更擅长逻辑运算;而AI服务器主要采用加速卡为主导的异构形式,更擅长做大吞吐量的并行计算。按CPU数量,通用服务器可分为双路、四路和八路等。AI服务器一般仅搭载1-2块CPU,但GPU数量显著占优。按GPU数量,AI服务器可以分为四路、八路和十六路服务器,其中搭载8块GPU的八路AI服务器最常见。

工业富联CEO郑弘孟表示,训练AI大模型,需要有效的大数据和大算力及规模化的参数,因此对GPU的需求呈现直线上升态势,带动AI服务器市场需求走高。

关于下半年AI服务器出货预期,郑弘孟表示,多家全球头部云服务厂商仍在持续提升在AI领域的资本开支,看好下半年市场机会,AI服务器市场比市场预期更大,预期下半年有望强劲增长。换句话说,目前从需求来看AI服务器一季比一季好, 越来越好。

根据研究机构TrendForce近日发布的预测,预计2023年AI服务器的出货量将接近120万台,年增38.4%,占整体服务器出货量近9%,至2026年占比将进一步提升至15%。TrendForce还同步上修了2022-2026年AI服务器出货量年复合增长率至22%。

工业富联看好AI服务器市场

工业富联的云计算服务器产品具有很强的竞争力。郑弘孟此前在业绩说明会上谈到,2017年,工业富联联合合作方推出了全世界第一台AI服务器——HGX1,这台服务器的运算功耗是4.4KW,现在已经迭代到第四代,HGX4的运算能力是HGX1的32倍,出货成本却只是HGX1的3倍。

工业富联2022年年度报告显示,2022年,工业富联实现营收5118.49亿元,同比增长16.4%,首次突破5000亿元营收大关。2022年,工业富联云计算收入达2124.44亿元,同比增 19.56%,连续5年保持增长趋势,且保持了云计算服务器出货量全球第一的市场地位。

在此次举行的2022年度股东大会上,工业富联董事周泰裕表示,随着GPT的发展,未来10年内全球数据中心会不断的推陈出新,预计有超过60%的云服务都与AI应用相关。工业富联正在中国、亚太、北美、欧洲持续扩充服务器产能布局,可以满足当前及未来的业务需求。

此外,今年一季度开始,工业富联在服务器板块做结构性优化,有意下修OEM服务器占比,提升CSP(云服务商) ODM及AI服务器比例。

工业富联与英伟达有着深度合作,郑弘孟表示,过去的H100以及现在的H800都是在工业富联手上完成(组装)的。前几日英伟达创始人兼CEO黄仁勋宣布AI服务器H100已全面量产,并播放了H100自动化产线视频,该视频也是在工业富联自动化产线拍摄完成。

小结

在ChatGPT等AI大模型的训练和部署下,AI服务器的市场需求不断上升。很明显,今年一季度,工业富联等AI服务器厂商的相关营业收入也随之增加。而这可能还只是开始,从今年下半年,乃至未来几年,AI服务器的市场需求将持续增长。在这样的背景下,可以看到相关企业都在加大投资,包括工业富联。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

服务器

+关注

关注

14文章

10481浏览量

91946 -

AI

+关注

关注

91文章

42532浏览量

303445

发布评论请先 登录

相关推荐

热点推荐

AI产能虹吸效应:通用服务器面临结构性挑战,出货预期下调至+13%

TrendForce 发布的最新报告,2026 年全球整体服务器出货量增幅预估从此前的 + 20% 下调至 + 13%。这一调整的核心原因,在于 AI 服务器的

从8层到30层:AI服务器PCB层数进阶,PCle 5.0高速传输需求成关键

行业深度分析报告显示,当前 AI 服务器 PCB 层数已实现大幅跨越,普遍达到 16-40 层,胜宏科技针对下一代服务器研发的 10 阶 3

利用BigQuery MCP服务器开发面向数据分析的生成式AI应用

。借助 BigQuery MCP 服务器,您现在可以为 AI 智能体提供一种直接且安全的数据分析方式。这一全托管式 MCP 服务器不会带来额

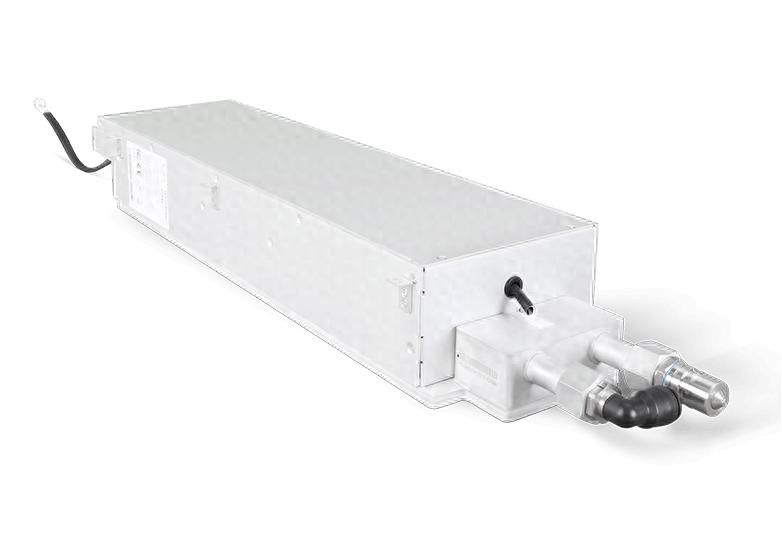

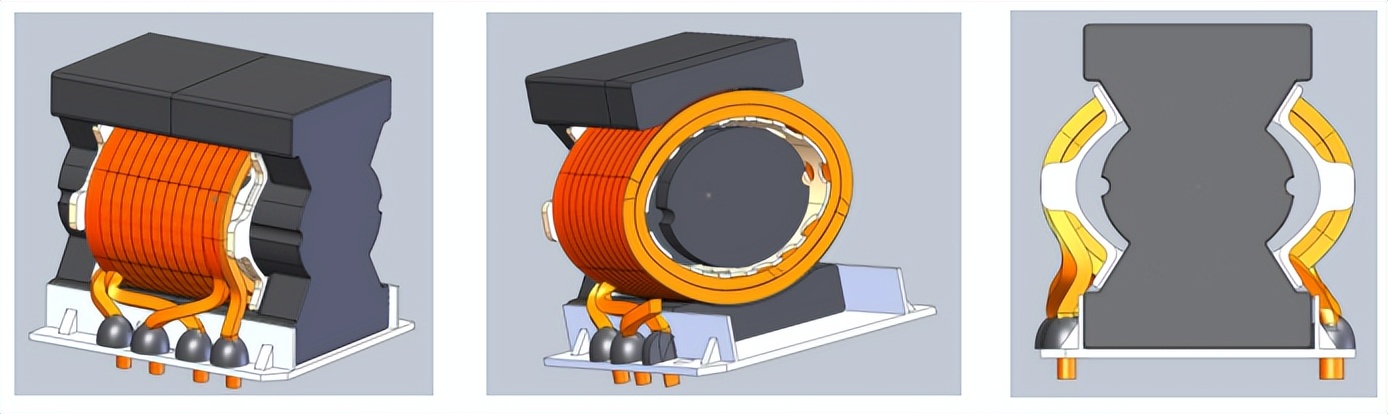

液冷散热时代:AI服务器如何重构磁元件设计

随着AI服务器功率密度的快速提升,传统的风冷散热方案在热管理方面逐渐面临挑战。在此背景下,液冷散热技术正加速应用于数据中心,特别是高算力的AI集群中。 这一散热方式的变革,并不仅仅是冷

AI 服务器备用电源:高效、可靠与智能的未来保障

运行,更需在高效率、高可靠性和智能管理方面实现突破,成为支撑 AI 算力爆发的关键基础设施。 AI 服务器对电源的迫切需求 AI

罗姆新一代MOSFET助力AI服务器与工业电源的能效优化

为了实现无碳社会,“提高用电量占全球一大半的电源和电机的效率”已成为全球性的社会问题。同时,随着AI技术的飞速发展,数据中心的负载急剧增加,服务器功耗也逐年攀升,特别是配备生成式AI和

继HBM之后,英伟达带火又一AI内存模组!颠覆AI服务器与PC

电子发烧友网综合报道,据韩媒报道,下一代低功耗内存模块 “SOCAMM” 市场已全面拉开帷幕。英伟达作为 AI 领域的领军企业,计划在今年为其 AI产品部署60至80万个 SOCAMM

AI服务器电源技术研讨会部分演讲嘉宾确认

AI服务器电源是2025-2026年AI硬件确定的增量,英伟达超级芯片GB200功率到2700W,是传统服务器电源的5-7倍,但其面临的挑战同样不小。 超高功率

AI 服务器电源如何迭代升级?

在AI 算力需求增长的今天,AI 服务器电源正陷入 “性能瓶颈与国产替代并行、场景适配与技术创新交织” 的双重挑战。 由Big-Bit商务网、广东省磁性元器件行业协会主办的2025中国

AI服务器需求强劲!工业富联:已着手开发下一代AI服务器

AI服务器需求强劲!工业富联:已着手开发下一代AI服务器

评论