为了助力大模型研究,复旦大学自然语言处理实验室开源了中文图书数据集合CBook-150K,包含15万本中文图书的下载和抽取方法,涵盖人文、教育、科技、军事、政治等众多领域。

当前很多研究表明,高质量数据对于训练大规模语言模型具有至关重要的作用。图书中的内容在质量、专业水准、可靠性等方面远高于互联网数据。OpenAI在训练GPT 3时,也使用了大量图书资源。但是目前还缺乏大规模的中文图书开放集合。此外,由于绝大多数电子书籍的保存方式为PDF格式,从其中抽取文本内容也需要分析工具支持。复旦大学自然语言处理实验室结合此前自主开发的相关PDF分析工具,开源了中文语料图书集合CBook-150K。

复旦大学自然语言处理实验室,自2019年起,自研了PDF处理工具DocAI,针对非扫描件PDF,具有能够处理复杂格式、高效、高准确率、可私有化部署等特点。DocAI在全CPU解决方案下,单核CPU处理100页文档仅需10秒。提取字符准确率100%,结构分析准确率95%。DocAI智能文档解析系统支持对DOC、PDF等常见电子文档进行智能解析,对文档中的标题、段落、表格等半结构化数据进行结构化分析还原。该应用场景具有文件类型多,格式复杂,兼容性要求高等特点,特别是对于跨页表格,多栏排版等复杂场景的支持。是目前支持段落、表格融合识别的为数不多的智能文档解析工具之一。DodAI不依赖第三方资源,支持离线环境下的私有化部署和使用,确保文档隐私与安全。

结合DocAI工具以及搜索引擎,复旦大学自然语言处理实验室从互联网中筛选了大量中文图书资源链接,并构造了内容抽取算法,助力广大学者NLP大模型研究,同时也在实践与操作中不断迭代更新,完善大型语料库的部署。

下载链接:

https://github.com/FudanNLPLAB/CBook-150K

审核编辑 :李倩

-

开源

+关注

关注

3文章

4426浏览量

46588 -

自然语言处理

+关注

关注

1文章

630浏览量

14758 -

nlp

+关注

关注

1文章

491浏览量

23375

原文标题:NLP大模型必备-FudanNLP开源中文图书集合CBook-150K

文章出处:【微信号:zenRRan,微信公众号:深度学习自然语言处理】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

腾讯Hy3 preview开源:重构AI大模型技术范式,开启智能计算新纪元

登临科技KS系列GPU产品Day 0适配Kimi-K2.6模型

壁仞科技壁砺166系列GPU产品率先支持Kimi K2.6模型

Kimi K2.6模型发布当天上线华为云

大晓机器人开源实时生成世界模型Kairos 3.0-4B

人工智能AI必备的5款开源软件推荐!

NVIDIA开源Audio2Face模型及SDK

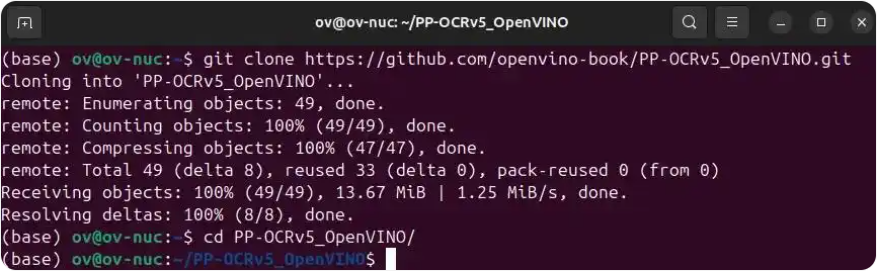

使用OpenVINO将PP-OCRv5模型部署在Intel显卡上

开放原子开源基金会发布150余个开源项目应用案例

万亿参数!元脑企智一体机率先支持Kimi K2大模型

NLP大模型必备-FudanNLP开源中文图书集合CBook-150K

NLP大模型必备-FudanNLP开源中文图书集合CBook-150K

评论