NLP中的迁移学习:利用预训练模型进行文本分类

- 转换器(141068)

- 机器学习(130423)

- nlp(21784)

相关推荐

ChatGPT爆火背后,NLP呈爆发式增长!

自然语言处理技术,用于计算机中模拟人类的对话和文本理解。主要源于AI大模型化的NLP技术突破是将深度学习技术与传统的NLP方法结合在一起,从而更好地提高NLP技术的准确性和效率。大模型化的NLP技术能够更好地支持企业进行大规模的语料内容分析,并为企业更好地进行文本分析提供帮助。 语言是人类区

2023-02-13 09:47:00 2771

2771

2771

2771一些解决文本分类问题的机器学习最佳实践

文本分类是一种应用广泛的算法,它是各种用于大规模处理文本数据的软件系统的核心,常被用于帮助电子邮箱过滤垃圾邮件,帮助论坛机器人标记不当评论。

2018-07-31 09:28:41 6965

6965

6965

6965介绍用迁移学习处理NLP任务的大致思路

文本分类是NLP领域重要的部分,它与现实生活中的场景密切相关,例如机器人、语音助手、垃圾或诈骗信息监测、文本分类等等。这项技术的用途十分广泛,几乎可以用在任意语言模型上。本论文的作者进行的是文本分类,直到现在,很多学术研究人员仍然用词嵌入训练模型,例如word2vec和GloVe。

2018-08-02 09:18:15 5982

5982

5982

5982构建中文网页分类器对网页进行文本分类

特征提取就是提取出最能代表某篇文章或某类的特征项,以达到降维的效果从而减少文本分类的计算量。典型特征提取方法:信息增益(Information Gain),互信息(MI)、文档频度(DF)。传统的MI特征提取方法:

2018-09-13 08:06:00 3906

3906

3906

390650多种适合机器学习和预测应用的API,你的选择是?(2018年版本)

网络服务上的简单JSON,被用于自然语言处理,能够对网络新闻媒体进行情感分析和文本分类。9.Geneea:该API可以对提供的原始文本、从给定的URL中提取到的文本或直接提供的文档进行分析

2018-05-03 16:41:16

迁移学习

的基本原理和编程思想。理解在一个新的场景或数据集下,何时以及如何进行迁移学习。利用PyTorch加载数据、搭建模型、训练网络以及进行网络微调操作。给定迁移场景,利用daib库和生成对抗技术独立完成图像分类中

2022-04-21 15:15:11

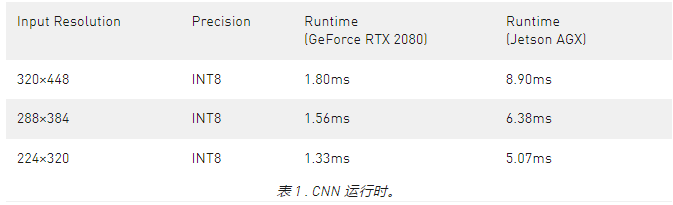

Edge Impulse的分类模型浅析

Edge Impulse是一个应用于嵌入式领域的在线的机器学习网站,不仅为用户提供了一些现成的神经网络模型以供训练,还能直接将训练好的模型转换成能在单片机MCU上运行的代码,使用方便,容易上手。本文

2021-12-20 06:51:26

NLPIR平台在文本分类方面的技术解析

文本分类问题就是将一篇文档归入预先定义的几个类别中的一个或几个,而文本的自动分类则是使用计算机程序来实现这种文本分类,即根据事先指定的规则和示例样本,自动从海量文档中识别并训练分类,文本为大家讲解

2019-11-18 17:46:10

Pytorch模型训练实用PDF教程【中文】

本教程以实际应用、工程开发为目的,着重介绍模型训练过程中遇到的实际问题和方法。在机器学习模型开发中,主要涉及三大部分,分别是数据、模型和损失函数及优化器。本文也按顺序的依次介绍数据、模型和损失函数

2018-12-21 09:18:02

pyhanlp文本分类与情感分析

关系如下:训练训练指的是,利用给定训练集寻找一个能描述这种语言现象的模型的过程。开发者只需调用train接口即可,但在实现中,有许多细节。分词目前,本系统中的分词器接口一共有两种实现: 但文本分类是否

2019-02-20 15:37:24

【KV260视觉入门套件试用体验】Vitis AI 通过迁移学习训练自定义模型

使用inspector检查模型

六、Vitis AI 进行模型校准和来量化

七、Vitis AI 通过迁移学习训练自定义模型

八、Vitis AI 将自定义模型编译并部署到KV260中

本文目的

使用迁移

2023-10-16 15:03:16

九眼公共安全语义智能分析平台,实现文本分析的公共安全应用

社会和科技的进步和现在行业对数据的利用率提高有很大关系,各行各业积累的数据量均在增加,公安领域也包括在内,有大量的案件信息数据需要进行文本分析。 现在的公安部门均使用信息管理系统管理数据,在实现

2019-10-08 15:56:16

使用KNN进行分类和回归

奇数。与分类任务不同,在回归任务中,特征向量与实值标量而不是标签相关联,KNN是通过对响应变量均值或加权均值来进行预测。惰性学习和非参数模型惰性学习是 KNN 的标志。惰性学习器,也称为基于实例的学习器

2022-10-28 14:44:46

基于Keras利用训练好的hdf5模型进行目标检测实现输出模型中的表情或性别gradcam

CV:基于Keras利用训练好的hdf5模型进行目标检测实现输出模型中的脸部表情或性别的gradcam(可视化)

2018-12-27 16:48:28

基于稀疏编码的迁移学习及其在行人检测中的应用

一定进展,但大都需要大量的训练数据.针对这一问题,提出了一种基于迁移学习的半监督行人分类方法:首先基于稀疏编码,从任意的未标记样本中,学习到一个紧凑、有效的特征表示;然后通过迁移学习,将学习到的特征表示

2010-04-24 09:48:05

机器学习简介与经典机器学习算法人才培养

思想。理解在一个新的场景或数据集下,何时以及如何进行迁移学习。利用PyTorch加载数据、搭建模型、训练网络以及进行网络微调操作。给定迁移场景,利用daib库和生成对抗技术独立完成图像分类中的领域适配

2022-04-28 18:56:07

深入挖掘通用句子编码器的每个组成部分

检测、聚类、智能回复、文本分类和许多其他NLP任务。结果需要注意的是,在USE论文中没有一个章节是关于与其他的句子嵌入方法在标准基准上的比较。这篇论文似乎是从工程学的角度出发,从Gmail和谷歌Books的Inbox等产品中汲取了经验。原作者:Amit Chaudhary

2022-11-02 15:23:25

基于文章标题信息的汉语自动文本分类

文本分类是文本挖掘的一个重要组成部分,是信息搜索领域的一项重要研究课题。该文提出一种基于文章标题信息的汉语自动文本分类方法,在HNC理论的领域概念框架下,通过标题

2009-04-13 08:31:16 10

10

10

10基于GA和信息熵的文本分类规则抽取方法

文本分类是文本数据挖掘中一个非常重要的技术,已经被广泛地应用于信息管理、搜索引擎、推荐系统等多个领域。现有的文本分类方法,大多是基于向量空间模型的算法。这

2009-06-03 09:22:50 26

26

26

26用于文本分类和文本聚类的特征抽取方法的研究

文本信息处理已成为一门日趋成熟、应用面日趋广泛的学科。文本分类和聚类技术是应信息检索和查询需要而出现的自然语言处理领域的重要研究课题。面对急速膨胀的各种文本信

2009-12-22 14:19:46 3

3

3

3基于Rough集的web文本分类研究

随着Internet的飞速发展,网络上的web信息资源迅速膨胀,如何在浩瀚的web文本信息资源中高效精确地挖掘出有用的知识已经成为目前的研究热点之一。本文首先介绍了web文本分类

2010-01-27 13:39:41 4

4

4

4基于文本分类计数识别平台设计(JAVA实现)

根据电力企业舆情管控工作的需要,设计了一种基于文本分类技术的企业舆情主题识别实验平台,技术人员只需根据需要设定文本分类中不同的基本参数,即可针对相应的舆情文本测试不同参数方案下主题文本的识别效果

2017-10-30 17:26:36 11

11

11

11基于apiori算法改进的knn文本分类方法

的,通过实例去学习分类在这方面就很有优势。 一般的文本分类分为这几个步骤,首先是建立文档的表示模型,即通过若干特征去表示一个文本,因为一般情况下一篇文章都有着成百上千的特征向量,直接进行分类会有很大的时间和空

2017-11-09 10:25:02 9

9

9

9文本分类中CTM模型的优化和可视化应用研究

如何从海量文本中自动提取相关信息已成为巨大的技术挑战,文本分类作为解决该问题的重要方法已引起广大关注,而其中文本表示是影响分类效果的关键因素。为此采用相关主题模型进行文本表示,以保证信息完整同时表现

2017-11-22 10:46:30 10

10

10

10融合词语类别特征和语义的短文本分类方法

LDA主题模型从背景知识中选择最优主题形成新的短文本特征,在此基础上建立分类器进行分类。采用支持向量机SVM与是近邻法k-NN分类器对搜狗语料库数据集上的搜狐新闻标题内容进行分类,实验结果表明该方法对提高短文本分类的性能是

2017-11-22 16:29:58 0

0

0

0基于超像素融合的文本分割

超像素分割并融合;最后利用超像素融合的局部相似性对初始二值化图像进行文本校验。实验结果表明,与最大稳定极值区域( MSER)及笔画超像素聚合(SSG)方法相比,所提方法在KAIST数据集上的分割精度分别提高了8. 00个百分点和

2017-12-08 16:59:18 1

1

1

1基于KNN的烟草企业档案文本分类

通过对云南某卷烟厂历史档案文本数据的分析研究,结合实际情况,对档案文本主题词的获取和自动分类算法进行了详细的设计。且在主题词获取算法中引入了TFIDF算法,解决了档案文本缺少题名、文号及责任者

2017-12-12 18:04:47 0

0

0

0基于多模态特征数据的多标记迁移学习方法的早期阿尔茨海默病诊断

特征选择模块和多模态多标记分类回归学习器模块。首先,通过稀疏多标记学习模型对分类和回归学习任务进行有效结合;然后,将该模型扩展到来自多个学习领域的训练集,从而构建出多标记迁移学习特征选择模型;接下来,针对异

2017-12-14 11:22:37 3

3

3

3基于直推判别字典学习的零样本分类方法

零样本分类的目标是对训练阶段未出现过的类别的样本进行识别和分类,其主要思路是,借助类别语义信息,将可见类别的知识转移到未见类别中.提出了一种直推式的字典学习方法,包含以下两个步骤:首先,提出一个判别

2017-12-25 10:15:44 0

0

0

0详细解析scikit-learn进行文本分类

而多类别分类指的是y的可能取值大于2,但是y所属类别是唯一的。它与多标签分类问题是有严格区别的。所有的scikit-learn分类器都是默认支持多类别分类的。但是,当你需要自己修改算法的时候,也是可以使用scikit-learn实现多类别分类的前期数据准备的。

2017-12-27 08:36:01 4385

4385

4385

4385

基于分布特征迁移加权算法

传统机器学习面临一个难题,即当训练数据与测试数据不再服从相同分布时,由训练集得到的分类器无法对测试集文本准确分类。针对该问题,根据迁移学习原理,在源领域和目标领域的交集特征中,依据改进的特征分布相似

2018-01-09 14:49:36 0

0

0

0一种新型朴素贝叶斯文本分类算法

针对在文本分类中先验概率的计算比较费时而且对分类效果影响不大、后验概率的精度损失影响分类准确率的现象,对经典朴素贝叶斯分类算法进行了改进,提出了一种先抑后扬(抑制先验概率的作用,扩大后验概率

2018-03-05 11:19:59 0

0

0

0如何用更少的数据自动将文本分类,同时精确度还比原来的方法高

计算机视觉领域迁移学习和预训练ImageNet模型的成功已经转移到了NLP领域。许多企业家、科学家和工程师目前都用调整过的ImageNet模型解决重要的视觉问题,现在这款工具已经能用于语言处理,我们希望看到这一领域会有更多相关应用产生。

2018-05-21 15:53:05 6150

6150

6150

6150

NLP的介绍和如何利用机器学习进行NLP以及三种NLP技术的详细介绍

本文用简洁易懂的语言,讲述了自然语言处理(NLP)的前世今生。从什么是NLP到为什么要学习NLP,再到如何利用机器学习进行NLP,值得一读。这是该系列的第一部分,介绍了三种NLP技术:文本嵌入、机器翻译、Dialogue 和 Conversations。

2018-06-10 10:26:10 76462

76462

76462

76462

一个深度学习模型能完成几项NLP任务?

对于机器翻译、文本摘要、Q&A、文本分类等自然语言处理任务来说,深度学习的出现一遍遍刷新了state-of-the-art的模型性能记录,给研究带来诸多惊喜。但这些任务一般都有各自的度量基准,性能也只在一组标准数据集上测试。

2018-06-26 15:19:09 4233

4233

4233

4233什么是迁移学习?NLP迁移学习的未来

只用了100个案例,他们就达到了和用2万个案例训练出的模型同样的错误率水平。除此之外,他们还提供了对模型进行预训练的代码,因为维基百科有多种语言,这使得我们能快速地进行语言转换。除英语之外,其他语种并没有很多经过标记的公开数据集,所以你可以在语言模型上对自己的数据进行微调。

2018-08-17 09:18:18 3649

3649

3649

3649面向NLP任务的迁移学习新模型ULMFit

除了能够更快地进行训练之外,迁移学习也是特别有趣的,仅在最后一层进行训练,让我们可以仅仅使用较少的标记数据,而对整个模型进行端对端训练则需要庞大的数据集。标记数据的成本很高,在无需大型数据集的情况下建立高质量的模型是很可取的方法。

2018-08-22 08:11:54 5410

5410

5410

5410如何使用CNN和BiLSTM网络特征融合进行文本情感分析

卷积神经网络( CNN)和循环神经网络(RNN)在自然语言处理,上得到广泛应用,但由于自然语言在结构上存在着前后依赖关系,仅依靠卷积神经网络实现文本分类将忽略词的上下文含义,且传统的循环神经网络存在梯度消失或梯度爆炸问题,限制了文本分类的准确率。

2018-11-22 16:01:45 9

9

9

9NVIDIA迁移学习工具包 :用于特定领域深度学习模型快速训练的高级SDK

,并在 TeslaGPU 上使用 DeepStream SDK 3.0 进行部署。这些模型针对 IVA 特定参考使用场景(如检测和分类)进行了全面地训练。

2018-12-07 14:45:47 2848

2848

2848

2848如何使用Spark计算框架进行分布式文本分类方法的研究

针对传统文本分类算法在面对日益增多的海量文本数据时效率低下的问题,论文在Spark计算框架上设计并实现了一种并行化朴素贝叶斯文本分类器,并着重介绍了基于Spark计算框架的文本分类实现过程。实验阶段

2018-12-18 14:19:57 3

3

3

3使用深度模型迁移进行细粒度图像分类的方法说明

针对细粒度图像分类方法中存在模型复杂度较高、难以利用较深模型等问题,提出深度模型迁移( DMT)分类方法。首先,在粗粒度图像数据集上进行深度模型预训练;然后,使用细粒度图像数据集对预训练模型

2019-01-18 17:01:50 5

5

5

5SiATL——最新、最简易的迁移学习方法

许多传统的迁移学习方法都是利用预先训练好的语言模型(LMs)来实现的,这些模型已经非常流行,并且具有翻译上下文信息的能力、高级建模语法和语义语言特性,能够在对象识别、机器翻译、文本分类等许多任务中生成高质量的结果。

2019-03-12 15:13:59 3319

3319

3319

3319

深度学习框架PaddlePaddle在百度内部的战略地位进行了定调

服务平台则主要由可定制化训练深度学习模型的EasyDL以及一站式开发平台AI Studio组成。EasyDL目前已经支持图像识别、文本分类、声音分类等深度学习模型的训练,而AI Studio则集合了AI教程、代码环境、算法算力、数据集和比赛,属于百度大脑的深度学习实训平台。

2019-04-29 10:58:19 4537

4537

4537

4537

如何结合改进主动学习的SVD-CNN进行弹幕文本分类算法资料说明

采样的主动学习算法(DBC-AL)选择对分类模型贡献率较高的样本进行标注,以低标注代价获得高质量模型训练集;然后,结合SVD算法建立SVD-CNN弹幕文本分类模型,使用奇异值分解的方法代替传统CNN模型池化层进行特征提取和降维,并在此基础上完成弹幕文

2019-05-06 11:42:47 6

6

6

6训练一个机器学习模型,实现了根据基于文本分析预测葡萄酒质量

我们可以把上述的其他信息也引入作为特征参数,这样就能构建出一个更全面的模型来预测葡萄酒质量。为了将文字描述与其他特征结合起来进行预测,我们可以创建一个集成学模型(文本分类器就是集成在内的一部分);也可以创建一个层级模型,在层级模型中,分类器的输出会作为一个预测变量。

2019-05-16 18:27:39 5662

5662

5662

56628个免费学习NLP的在线资源

此在线课程涵盖从基础到高级NLP,它是Coursera上高级机器学习专业化的一部分。你可以免费注册本课程,你将学习情绪分析、总结、对话状态跟踪等。你将学习的主题包括文本分类介绍、语言建模和序列标记、语义向量空间模型、序列到序列任务等等。

2019-07-07 07:44:00 6408

6408

6408

6408迁移学习与模型预训练:何去何从

把我们当前要处理的NLP任务叫做T(T称为目标任务),迁移学习技术做的事是利用另一个任务S(S称为源任务)来提升任务T的效果,也即把S的信息迁移到T中。至于怎么迁移信息就有很多方法了,可以直接利用S的数据,也可以利用在S上训练好的模型,等等。

2019-07-18 11:29:47 7440

7440

7440

7440

NLP迁移学习面临的问题和解决

自然语言处理(NLP)最近取得了巨大的进步,每隔几天就会发布最新的结果。排行榜疯狂是指最常见的NLP基准,如GLUE和SUPERGLUE,它们的得分越来越接近人类的水平。这些结果大多是通过超大(数十亿个参数)模型从大规模数据集中迁移学习得到的。

2020-05-04 12:03:00 2821

2821

2821

2821

如何利用机器学习思想,更好地去解决NLP分类任务

NLP分类任务我们每个NLPer都异常熟悉了,其在整个NLP业务中占据着举足轻重的地位,更多领域的子任务也常常转化为一个分类任务,例如新闻分类、情感识别、意图识别、关系分类、事件类型判断等等。

2020-08-28 10:02:21 1901

1901

1901

1901

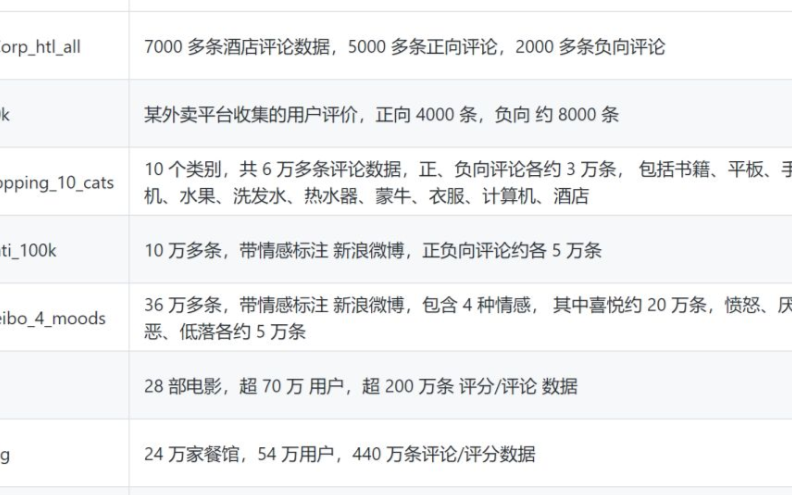

NLP中文自然语言处理数据集、平台和工具整理

资源整理了文本分类、实体识别词性标注、搜索匹配、推荐系统、指代消歧、百科数据、预训练词向量or模型、中文完形填空等大量数据集,中文数据集平台和NLP工具等。 本文内容整理自:https

2020-11-05 09:29:06 2443

2443

2443

2443

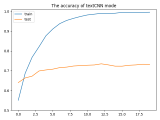

textCNN论文与原理——短文本分类

包是处理图片的torchvision,而处理文本的少有提及,快速处理文本数据的包也是有的,那就是torchtext[1]。下面还是结合上一个案例:【深度学习】textCNN论文与原理——短文本分类(基于pytorch)[2],使用torchtext进行文本数据预处理,然后再使用torchtext进

2020-12-31 10:08:42 2217

2217

2217

2217

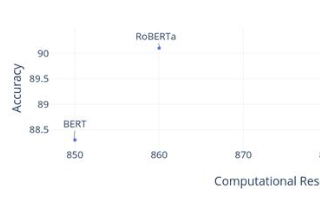

小米在预训练模型的探索与优化

大家带来小米在预训练模型的探索与优化。 01 预训练简介 预训练与词向量的方法一脉相承。词向量是从任务无关和大量的无监督语料中学习到词的分布式表达,即文档中词的向量化表达。在得到词向量之后,一般会输入到下游任务中,进行后续的计

2020-12-31 10:17:11 2217

2217

2217

2217

NLP:序列标注

0 小系列初衷 自己接触的项目大都是初创,没开始多久的项目,从0到1的不少,2020年快结束,感觉这个具有一定个人特色的技术经验可以在和大家分享一下。 计划篇章: (已完成)文本分类篇。针对NLP

2021-01-13 09:46:21 2243

2243

2243

2243深度学习:基于语境的文本分类弱监督学习

高成本的人工标签使得弱监督学习备受关注。seed-driven 是弱监督学习中的一种常见模型。该模型要求用户提供少量的seed words,根据seed words对未标记的训练数据生成伪标签,增加训练

2021-01-18 16:04:27 2657

2657

2657

2657一种处理多标签文本分类的新颖推理机制

研究动机 多标签文本分类(multi-label text classification, 简称MLTC)的目的是在给定文本后要求模型预测其多个非互斥的相关标签。该任务在许多自然语言处理任务上都有

2021-02-05 09:21:13 2593

2593

2593

2593

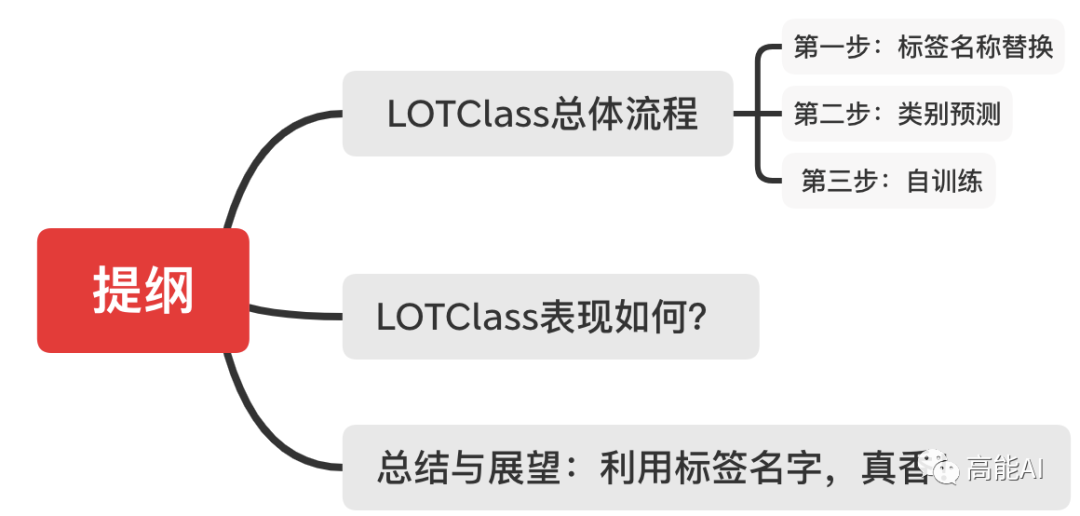

文本分类的一个大型“真香现场”来了

任何标注数据啦!哇,真香! 当前的文本分类任务需要利用众多标注数据,标注成本是昂贵的。而半监督文本分类虽然减少了对标注数据的依赖,但还是需要领域专家手动进行标注,特别是在类别数目很大的情况下。 试想一下,我们人类是如何对新闻文本进行分

2021-02-05 11:02:24 1596

1596

1596

1596

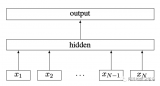

fastText有两大用途——文本分类和Word Embedding

N-gram 是一种基于统计语言模型的算法,常用于 NLP 领域。其思想在于将文本内容按照字节顺序进行大小为 N 的滑动窗口操作,从而形成了长度为 N 的字节片段序列,其片段我们称为 gram。

2021-03-05 15:38:54 2910

2910

2910

2910

基于深度神经网络的文本分类分析

随着深度学习技术的快速发展,许多研究者尝试利用深度学习来解决文本分类问题,特别是在卷积神经网络和循环神经网络方面,出现了许多新颖且有效的分类方法。对基于深度神经网络的文本分类问题进行分析,介绍

2021-03-10 16:56:56 36

36

36

36结合BERT模型的中文文本分类算法

针对现有中文短文夲分类算法通常存在特征稀疏、用词不规范和数据海量等问题,提出一种基于Transformer的双向编码器表示(BERT)的中文短文本分类算法,使用BERT预训练语言模型对短文本进行句子

2021-03-11 16:10:39 6

6

6

6一种基于神经网络的短文本分类模型

、词向量以及短文本的概念集作为模型的输入,运用编码器-解码器模型对短文本与概念集进行编码,利用注意力机制计算每个概念权重值,减小无关噪声概念对短文本分类的影响,在此基础上通过双向门控循环单元编码短文本输入序

2021-03-12 14:07:47 7

7

7

7集成WL-CNN和SL-Bi-LSTM的旅游问句文本分类算法

学习词序列子空间向量和句序列深层语义信息,通过多头注意力机制将两种深度学习模型进行集成以实现旅游问句文本的语法和语义信息互补,并通过 Softmax分类器得到最终的旅游问句文本分类结果。实验结果表明,与基于传统深度学习模型的旅游问句文本分类算法相比,该算法在准

2021-03-17 15:24:34 4

4

4

4一种侧重于学习情感特征的预训练方法

transformers编码表示)的基础上,提岀了一种侧重学习情感特征的预训练方法。在目标领域的预练阶段,利用情感词典改进了BERT的预训练任务。同时,使用基于上下文的词粒度情感预测任务对掩盖词情感极性进行分类,获取偏向情感特征的文本表

2021-04-13 11:40:51 4

4

4

4一种基于BERT模型的社交电商文本分类算法

基于BERT模型的社交电商文本分类算法。首先,该算法采用BERT( Bidirectional Encoder Representations from Transformers)预训练语言模型来完成社交电商文本的句子层面的特征向量表示,随后有针对性地将获得的特征向量输入分类器进行分类,最后采

2021-04-13 15:14:21 8

8

8

8基于BERT+Bo-LSTM+Attention的病历短文分类模型

病历文本的提取与自动分类的方法具有很大的临床价值。文中尝试提出一种基于BERT十 BI-LSTM+ Attention融合的病历短文本分类模型。使用BERT预处理获取短文本向量作为模型输入,对比BERT与 word2vec模型的预训练效果,对比Bⅰ-LSTM十 Atten

2021-04-26 14:30:20 13

13

13

13融合文本分类和摘要的多任务学习摘要模型

质量,使用K- means聚类算法构建 Cluster-2、 Cluster-10和 Cluster-20文本分类数据集训练分类器,并研究不同分类数据集参与训练对摘要模型的性能影响,同时利用基于统计分布的判别法全面评价摘要准确性。在CNNDM测试集上的实验结果表明,

2021-04-27 16:18:58 11

11

11

11基于BERT的中文科技NLP预训练模型

深度学习模型应用于自然语言处理任务时依赖大型、高质量的人工标注数据集。为降低深度学习模型对大型数据集的依赖,提出一种基于BERT的中文科技自然语言处理预训练模型 ALICE。通过对遮罩语言模型进行

2021-05-07 10:08:16 14

14

14

14基于主题相似度聚类的文本分类算法综述

传统的文本分类方法仅使用一种模型进行分类,容易忽略不同类别特征词出现交叉的情况,影响分类性能。为提高文本分类的准确率,提岀基于主题相似性聚类的文本分类算法。通过CH和 Wordcount相结合的方法

2021-05-12 16:25:20 6

6

6

6基于协同训练的电商领域文本短语挖掘方法

电商领域的文本通常不遵循通用领域文本的表达方式,导致传统短语挖掘方法在电商领域文本中的挖掘精度较低。为此,提出一种基于协同训练的电商领域短语挖掘方法。通过基于语义特征的短语分类模型来有效检测电商领域

2021-05-13 15:01:15 0

0

0

0基于不同神经网络的文本分类方法研究对比

神经网络、时间递归神经网络、结构递归神经网络和预训练模型等主流方法在文本分类中应用的发展历程比较不同模型基于常用数据集的分类效果,表明利用人工神经网络伂构自动获取文本特征,可避免繁杂的人工特征工程,使文本分类

2021-05-13 16:34:34 48

48

48

48低频词词向量优化在短文本分类中的应用

的下游任务时,往往需要通过微调进行一定的更新和调整,使其更适用于目标任务。但是,目标语料集中的低频词由于缺少训练样夲,导致在微调过程中无法获得稳定的梯度信息,使得词向量无法得到有效更新。而在短文本分类任务中,这些低频词对分类结果同样有着重要的指示性。

2021-05-17 15:37:24 13

13

13

13一种为小样本文本分类设计的结合数据增强的元学习框架

01 研究背景及动机 近些年,元学习已经成为解决小样本问题的主流技术,并且取得不错的成果。然而,由于现有的元学习方法大多数集中在图像分类上,而对文本分类上的关注比较少。与图像不同,同一类别中文本具有

2021-05-19 15:54:15 4012

4012

4012

4012

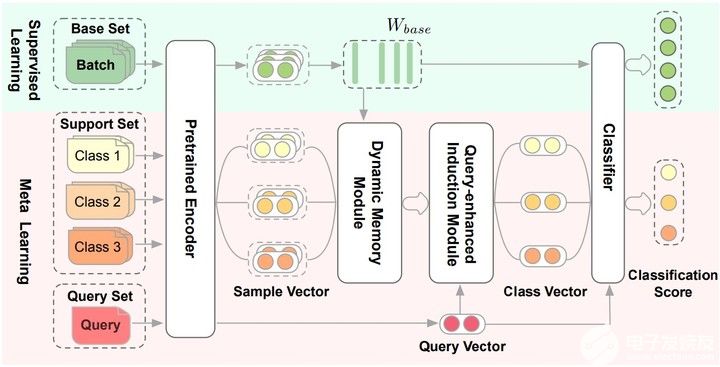

胶囊网络在小样本做文本分类中的应用(下)

论文提出Dynamic Memory Induction Networks (DMIN) 网络处理小样本文本分类。 两阶段的(two-stage)few-shot模型: 在监督学习阶段(绿色的部分

2021-09-27 17:46:08 1833

1833

1833

1833

基于双通道词向量的卷积胶囊网络文本分类算法

的词向量与基于特定文本分类任务扩展的语境词向量作为神经网络的2个输入通道,并采用具有动态路由机制的卷积胶囊网络模型进行文本分类。在多个英文数据集上的实验结果表明,双通道的词向量训练方式优于单通道策略,与LSTM、RAE、 M

2021-05-24 15:07:29 6

6

6

6基于神经网络与隐含狄利克雷分配的文本分类

主题概率分布,提出一种文本分类算法NLDA。在 Thucnews语料库和复旦大学语料库上进行实验,结果表明,与传统LDA模型相比,该算法的平均分类准确率分别提升5.53%和4.67%,平均训练时间分别减少8%和10%。

2021-05-25 15:20:59 0

0

0

0基于主题分布优化的模糊文本分类方法

在对类别模糊的文本进行分类时,主题模型只考虑文档和主题级别信息,未考虑底层词语间的隐含信息且多数主题信息复杂、中心不明确。为此,提出一种改进的文本分类方法。通过分位数选择中心明确的主题,将其映射

2021-05-25 16:33:29 5

5

5

5一种特征假期朴素贝叶斯文本分类算法

朴素贝叶斯(NB)算法应用于文本分类时具有简单性和高效性,但算法中属性独立性与重要性一致的假设,使其在精确度方面存在瓶颈。针对该问题,提出一种基于泊松分布的特征加权NB文本分类算法。结合泊松分布模型

2021-05-28 11:30:24 4

4

4

4基于LSTM的表示学习-文本分类模型

的关键。为了获得妤的文本表示,提高文本分类性能,构建了基于LSTM的表示学习-文本分类模型,其中表示学习模型利用语言模型为文本分类模型提供初始化的文本表示和网络参数。文中主要采用对抗训练方法训练语言模型,即在词向量

2021-06-15 16:17:17 18

18

18

18基于新型文本块分割法的简历解析器

近些年,基于神经网络的文本分类器和词嵌入在自然语言处理中被广泛应用。然而,传统的简历解析器采用基于关键字的模糊匹配或正则表达式来进行文本块分割。文中提岀了一种基于神经网络文本分类器和词向量

2021-06-16 11:47:21 17

17

17

17文本分类任务的Bert微调trick大全

1 前言 大家现在打比赛对预训练模型非常喜爱,基本上作为NLP比赛基线首选(图像分类也有预训练模型)。预训练模型虽然很强,可能通过简单的微调就能给我们带来很大提升,但是大家会发现比赛做到后期

2021-07-18 09:49:32 2165

2165

2165

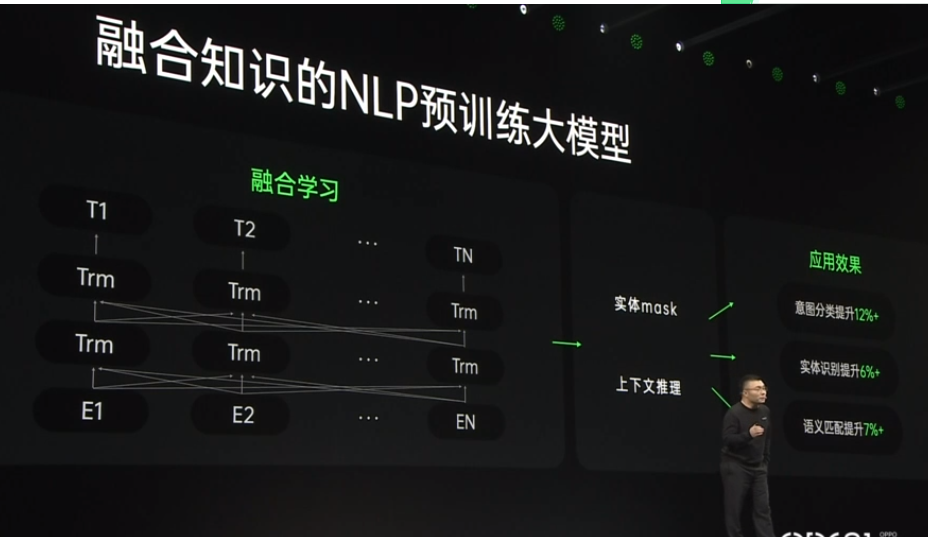

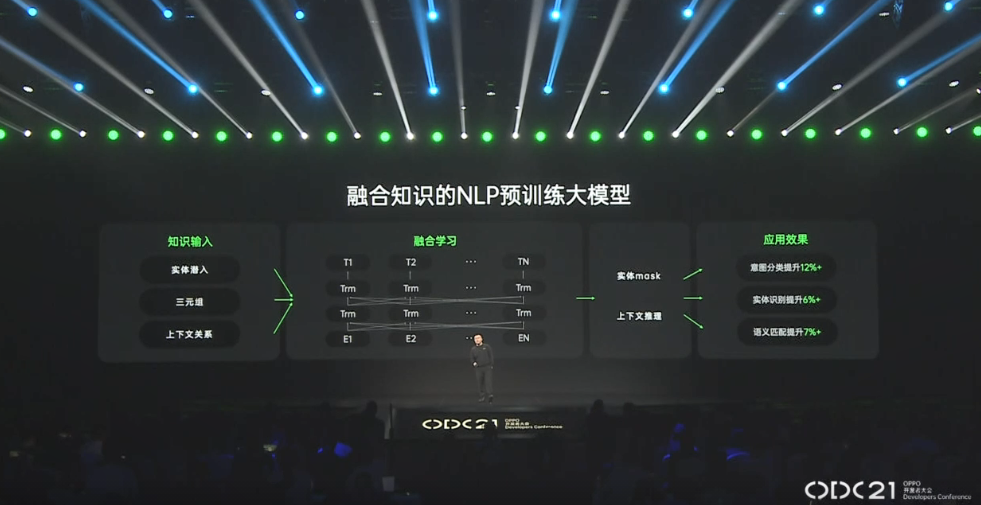

21652021 OPPO开发者大会:NLP预训练大模型

2021 OPPO开发者大会:NLP预训练大模型 2021 OPPO开发者大会上介绍了融合知识的NLP预训练大模型。 责任编辑:haq

2021-10-27 14:18:41 1492

1492

1492

1492

2021年OPPO开发者大会 融合知识的NLP预训练大模型

2021年OPPO开发者大会刘海锋:融合知识的NLP预训练大模型,知识融合学习运用在小布助手里面。

2021-10-27 14:48:16 2251

2251

2251

2251

如何实现更绿色、经济的NLP预训练模型迁移

NLP中,预训练大模型Finetune是一种非常常见的解决问题的范式。利用在海量文本上预训练得到的Bert、GPT等模型,在下游不同任务上分别进行finetune,得到下游任务的模型。然而,这种方式

2022-03-21 15:33:30 1843

1843

1843

1843带你从头构建文本分类器

文本分类是 NLP 中最常见的任务之一, 它可用于广泛的应用或者开发成程序,例如将用户反馈文本标记为某种类别,或者根据客户文本语言自动归类。另外向我们平时见到的邮件垃圾过滤器也是文本分类最熟悉的应用场景之一。

2022-03-22 10:49:32 2904

2904

2904

2904一种基于标签比例信息的迁移学习算法

摘要: 标签比例学习问题是一项仅使用样本标签比例信息去构建分类模型的挖掘任务,由于训练样本不充分,现有方法将该问题视为单一任务,在文本分类中的表现并不理想。考虑到迁移学习在一定程度上能解决训练数据

2022-03-30 15:46:31 343

343

343

343迁移学习Finetune的四种类型招式

迁移学习方法。例如NLP中的预训练Bert模型,通过在下游任务上Finetune即可取得比直接使用下游数据任务从零训练的效果要好得多。

2022-04-02 17:35:55 2509

2509

2509

2509用NVIDIA迁移学习工具箱如何训练二维姿态估计模型

本系列的第一篇文章介绍了在 NVIDIA 迁移学习工具箱中使用开源 COCO 数据集和 BodyPoseNet 应用程序的 如何训练二维姿态估计模型 。

2022-04-10 09:41:20 1445

1445

1445

1445

深度学习——如何用LSTM进行文本分类

简介 主要内容包括 如何将文本处理为Tensorflow LSTM的输入 如何定义LSTM 用训练好的LSTM进行文本分类 代码 导入相关库 #coding=utf-8 import

2022-10-21 09:57:07 1018

1018

1018

1018PyTorch文本分类任务的基本流程

文本分类是NLP领域的较为容易的入门问题,本文记录文本分类任务的基本流程,大部分操作使用了**torch**和**torchtext**两个库。

## 1. 文本数据预处理

2023-02-22 14:23:59 729

729

729

729基于预训练模型和语言增强的零样本视觉学习

Stable Diffusion 多模态预训练模型 考虑多标签图像分类任务——每幅图像大于一个类别 如果已有图文对齐模型——能否用文本特征代替图像特征 训练的时候使用文本组成的句子 对齐总会有 gap,选 loss 的时候使用 rank loss,对模态 gap 更稳定 拿到文本后有几种选择,比如

2023-06-15 16:36:11 277

277

277

277

一文详解迁移学习

迁移学习需要将预训练好的模型适应新的下游任务。然而,作者观察到,当前的迁移学习方法通常无法关注与任务相关的特征。在这项工作中,作者探索了重新聚焦模型注意力以进行迁移学习。作者提出了自上而下的注意力

2023-08-11 16:56:17 3048

3048

3048

3048

视觉深度学习迁移学习训练框架Torchvision介绍

Torchvision是基于Pytorch的视觉深度学习迁移学习训练框架,当前支持的图像分类、对象检测、实例分割、语义分割、姿态评估模型的迁移学习训练与评估。支持对数据集的合成、变换、增强等,此外还支持预训练模型库下载相关的模型,直接预测推理。

2023-09-22 09:49:51 391

391

391

391

人工智能中文本分类的基本原理和关键技术

在本文中,我们全面探讨了文本分类技术的发展历程、基本原理、关键技术、深度学习的应用,以及从RNN到Transformer的技术演进。文章详细介绍了各种模型的原理和实战应用,旨在提供对文本分类技术深入理解的全面视角。

2023-12-16 11:37:31 435

435

435

435

电子发烧友App

电子发烧友App

评论