可通行区域检测对于自动驾驶车辆的环境感知和路径规划至关重要。过去十年基于学习的可通行区域检测算法取得了很大的成功,但是基本上都是关注城市场景的可通行区域检测。相比于规则的城市场景道路,越野场景道路复杂多变,可通行区域检测更加困难,另外目前缺少开源的越野场景可通行检测数据集和算法基准。因此,本文开源第一个覆盖多种越野场景的可通行区域检测数据集,ORFD。ORFD采集了包括草原、林地、农田和乡村道路等不同场景道路,覆盖晴天、雨天、雾天和雪天等不同无人车行驶天气状况,包含强光、日光、微光和黑暗等光照条件。ORFD一共有12198帧激光雷达点云和图像对数据,在图像视角进行了标注,包含三种类别:可通行区域、不可通行区域和不可到达区域(如天空)。我们同时还提出了一个基于Transformer的越野场景可通行区域检测模型OFF-Net,利用交叉注意力机制自适应融合点云和图像的多模态信息。数据集和基准代码下载链接:https://github.com/chaytonmin/Off-Road-Freespace-Detection。

主要工作与贡献![]()

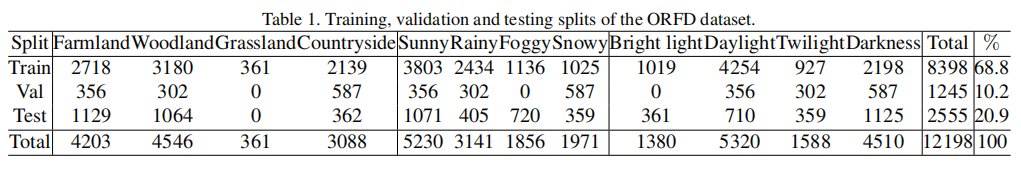

我们开源了第一个越野场景可通行区域检测数据集ORFD,包括草原、林地、农田和乡村道路等不同场景道路,覆盖晴天、雨天、雾天和雪天等不同无人车行驶天气状况,包含强光、日光、微光和黑暗等光照条件。

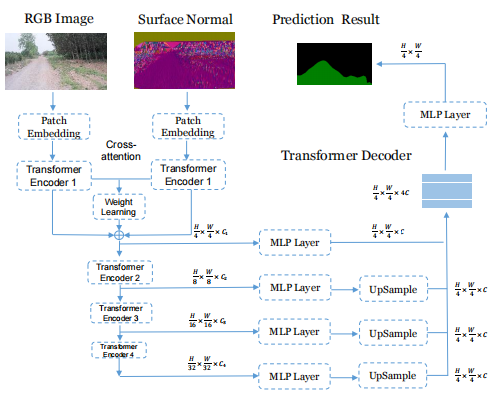

我们提出了一个越野场景可通行区域检测基准算法OFF-Net,采用Transformer结构聚合全局信息,设计cross-attention自适应挖掘点云和图像的多模态信息。

我们的越野场景可通行区域检测数据集ORFD和算法基准OFF-Net,有助于提高无人车在越野场景的自主行使能力。

算法流程![]()

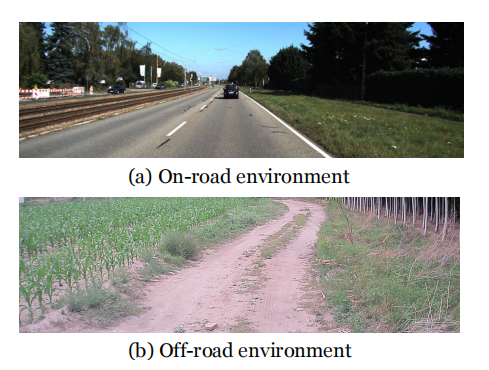

城市场景道路和越野场景道路对比

图1 (a) 城市场景道路有清晰的道路边界 (b)越野场景可通行区域难以准确定义。

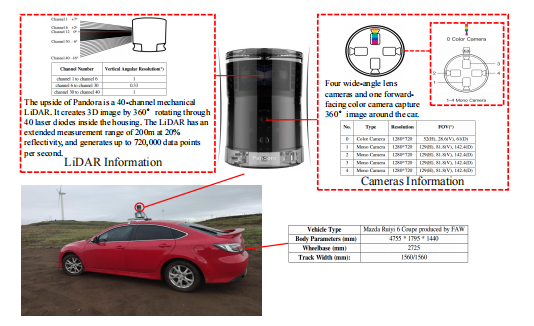

数据采集装置

图2 越野场景可通行区域检测数据集ORFD采集装置:Pandora 40线的激光雷达,相机和激光雷达一体。联合标注激光雷达和相机。

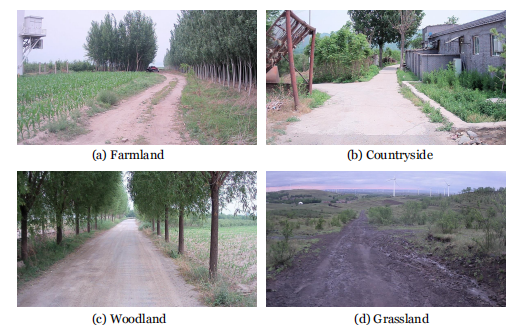

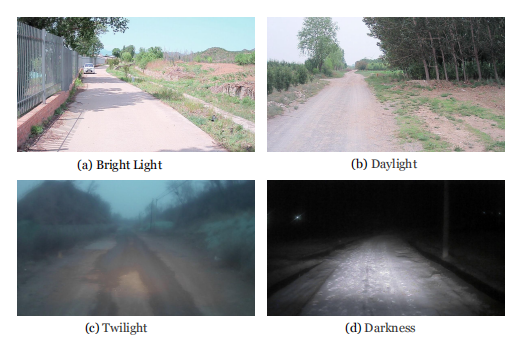

越野场景可通行区域检测数据集ORFD

图3 越野场景可通行区域检测数据集ORFD,包括草原、林地、农田和乡村道路等不同场景道路,覆盖晴天、雨天、雾天和雪天等不同无人车行驶天气状况,包含强光、日光、微光和黑暗等光照条件。采集了30段道路数据,一共有12198帧激光雷达点云和图像对数据。在图像视角进行了标注,包含三种类别:可通行区域、不可通行区域和不可到达区域(如天空)。

数据集划分

越野场景可通行区域检测基准算法OFF-Net

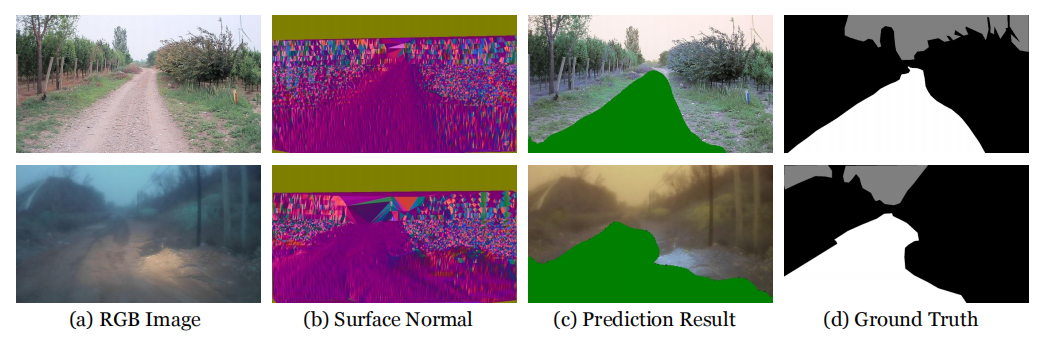

图4 提出的越野场景可通行区域检测基准算法OFF-Net。首先将激光雷达点云投到相机视角得到深度图,然后计算得到法向量图,再利用Transformer网络融合法向量图和图像,得到道路分割结果。

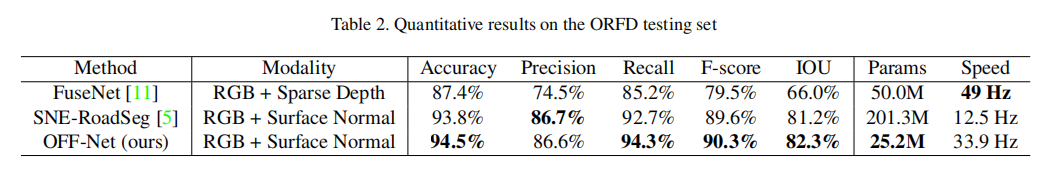

实验结果

![]()

审核编辑:郭婷

-

数据集

+关注

关注

4文章

1242浏览量

26310 -

自动驾驶

+关注

关注

795文章

15069浏览量

182057

原文标题:ORFD: 第一个开源的越野环境可通行区域检测数据集和基准

文章出处:【微信号:3D视觉工坊,微信公众号:3D视觉工坊】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

敏源宠物场景多类型检测方案,赋能宠物智能硬件升级

《多模态大模型 前沿算法与实战应用 第一季》精品课程简介

零基础手写大模型资料2026

Firefly-RK1828 赋能视频大模型:多目标+全场景,引领智能分析新风向

变频器OFF3与ON/OFF1的关系

Transformer 入门:从零理解 AI 大模型的核心原理

Transformer如何让自动驾驶大模型获得思考能力?

场景向——CD7377CZ/CD7388场景适配全解析:通勤、改装、商用各选对款

倍加福全新推出R305反射板式区域传感器

隼眼科技亮相2025交通行业低空场景应用技术研讨会

【「AI芯片:科技探索与AGI愿景」阅读体验】+第二章 实现深度学习AI芯片的创新方法与架构

自动驾驶中Transformer大模型会取代深度学习吗?

Transformer架构中编码器的工作流程

Transformer架构概述

基于Transformer的越野场景可通行区域检测模型OFF-Net

基于Transformer的越野场景可通行区域检测模型OFF-Net

评论