NVIDIA GPU曾于去年12月和今年7月两度树立了数据中心神经网络训练的性能标杆。今天发布的行业基准测试结果显示,NVIDIA也引领着数据中心内部与外部AI网络的趋势。

NVIDIA Turing GPU和Xavier芯片系统在首个独立AI推理基准测试 ——MLPerf Inference 0.5中取得第一名。由于推理一直是AI市场中最大、同时也是最具竞争力的领域,业内此前一直希望能够有一套客观的推理性能测试指标。

在参与此次测试的十二家公司中,只有NVIDIA AI平台提交了MLPerf的全部五项推理测试成绩(MLPerf是一个于2018年5月成立的行业基准测试小组)。这证明了NVIDIA CUDA-X AI和TensorRT软件的成熟程度。它们让用户能够更加轻松地将所有的NVIDIA GPU应用于数据中心、边缘等领域。

MLPerf定义了五项推理基准,涵盖了三个现有的人工智能应用:图像分类、目标检测和翻译。每项基准分为四个场景:与数据中心应用关联性最高的服务器和离线场景,以及用于满足边缘设备地芯片系统需求的单流和多流场景。

图1:NVIDIA在两个数据中心场景(离线和服务器)的全部五项基准测试中均排在第一位,Turing GPU被评为市面上单处理器性能最高的GPU。

图2:NVIDIA Turing在MLPerf数据中心场景中的成绩超过了其他市面上的处理器。

离线场景中具有代表性的场景有图像标记等,该场景下所有数据可在本地使用;而服务器场景代表性场景有在线翻译服务等,此场景下会突然或间歇性随机出现数据和请求工作。

Xavier在两个边缘场景(单流和多流)中被评为市面上性能最佳的边缘和移动芯片系统。

工业检测相机主要被用来在快速移动的生产线上发现不合格品,这是一种典型的单流任务。多流场景则是测试芯片能够处理多少个数据源 —— 该性能对于一辆可能需要使用6台以上摄像机的自动驾驶汽车而言,是一项关键的能力。

图3:NVIDIA Xavier在MLPerf边缘场景中成为市面上最佳的边缘和移动芯片系统。

该结果显示了NVIDIA CUDA和TensorRT软件的性能。它们为用户提供了一个通用平台,使用户可以在多个产品和应用中取得领先结果,而这正是NVIDIA所独有的能力。

在数据中心场景中,NVIDIA的两款GPU还出现了相互竞争的场面。NVIDIA TITAN RTX展示了Turing级 GPU的巨大潜力,尤其是在各种要求苛刻的任务中,比如运行用于语言翻译的GNMT模型等。

功能丰富、应用广泛的NVIDIA T4 Tensor Core GPU在多个场景取得了优秀的成绩。这个功耗仅为70瓦的GPU能够轻松安装到任何带有PCIe槽的服务器中,使用户能够根据需要扩展其计算力,进而大幅扩展其推理工作。

MLPerf已经获得行业和学术界的广泛支持。其成员包括Arm、Facebook、Futurewei、通用汽车、Google、哈佛大学、Intel、MediaTek、微软、NVIDIA及Xilinx。值得一提的是,相比于之前的两次训练比赛,此次基准测试吸引了更多的参与者。

NVIDIA此次共采用了三款产品,共计四种配置参加此次测试,并提交了全部20个场景中的19个场景的成绩,以此表明公司对这项工作的支持。NVIDIA的合作伙伴Dell EMC,以及NVIDIA的客户阿里巴巴同样使用NVIDIA GPU提交了成绩。相比于其他参与者,NVIDIA与合作伙伴和客户一同向用户全面地展示了NVIDIA产品组合的潜力。

全新的视角与产品

推理指的是在实时生产系统中,通过运行AI模型,从大量数据中筛选出可执行洞察的过程。这是一项仍处于发展中的新兴技术,而NVIDIA也在该领域中不断前进,未曾停止脚步。今天,NVIDIA发布了用于MLPerf测试的Xavier芯片系统低功耗版本——Jetson Xavier NX,其最大功率仅为15瓦,却具有最高21 TOPS的性能。它将为那些对性能要求高、但功率有限的新一代机器人、无人机和其他自主设备提供驱动力。

除了新的硬件之外,NVIDIA还发布了在MLPerf基准测试中所使用的最新TensorRT 6优化,并在GitHub上以开源方式为用户提供该软件。用户可以在MLPerf 开发者博客中了解更多关于这些优化的信息。NVIDIA不断地对该软件进行升级,使用户可以从日益增加的AI自动化与性能中获益。

让推理变得更简单

今天的MLPerf测试还说明了一个结论,那就是推理很困难。例如,在实际工作负载中,由于推理还需要大量预处理和后处理步骤,那么在实际工作负载中其对推理性能的需求甚至比基准测试更高。NVIDIA创始人兼首席执行官黄仁勋在去年GTC大会的主题演讲中就曾将这种复杂性概括为一个词:PLASTER。他表示,现代AI推理对可编程性(Programmability)、延迟性(Latency)、准确性(Accuracy)、模型大小(Accuracy)、吞吐量(Throughput)、能效(Energy efficiency)和学习率(Rate of Learning)的要求很高。

这就是为何用户越来越喜欢使用高性能的NVIDIA GPU和软件来处理各种要求苛刻的推理工作,其中就包括:BMW、Capital One、思科、Expedia、John Deere、微软、PayPal、Pinterest、宝洁、Postmates、Shazam、Snap、Shopify、Twitter、Verizon和沃尔玛等极具远见的公司。

本周,全球最大的邮政服务系统——美国邮政,也加入了此行列,使用NVIDIA GPU进行AI训练和推理。

硬盘制造商希捷希望通过在NVIDIA GPU上运行的AI推理将生产量提高10%。该公司预计,通过提高效率和质量,其将获得高达300%的投资回报。

Pinterest依靠NVIDIA GPU训练和评估其识别模型并对其1750亿条Pin贴文执行实时推理。

Snap使用NVIDIA T4加速器在谷歌云平台上执行推理。相比于仅采用了CPU的系统,这提高了其广告的效果,同时降低了成本。

Twitter发言人就这一趋势表示:“GPU的使用不仅大大缩短了训练时间,还让我们在推理时能够实时了解直播视频,让我们可以在自己的平台上了解各媒体。”

AI会话:关于推理

未来,会话式AI将带来大量的机会以及技术方面的挑战。NVIDIA在这一领域同样是当之无愧的领导者。NVIDIA已经为会话式AI服务提供了经过优化的参照设计,比如自动语音识别、文本-语言转换和自然语言理解等。NVIDIA们的BERT、GNMT和Jasper等AI模型开源优化帮助开发者实现顶尖推理性能。NVIDIA的客户和合作伙伴中包括有会话式AI领域的一流公司,比如Kensho、微软、Nuance、Optum等。

最后要补充的是,MLPerf小组已经开始致力于改进其当前的0.5推理测试。NVIDIA将努力在基准测试中继续发挥领导作用。

声明:本文内容及配图由入驻作者撰写或者入驻合作网站授权转载。文章观点仅代表作者本人,不代表电子发烧友网立场。文章及其配图仅供工程师学习之用,如有内容侵权或者其他违规问题,请联系本站处理。

举报投诉

-

gpu

+关注

关注

28文章

5271浏览量

136070 -

人工智能

+关注

关注

1820文章

50325浏览量

266967 -

推理

+关注

关注

0文章

9浏览量

7425

发布评论请先 登录

相关推荐

热点推荐

是德科技推出全新AI推理仿真平台

是德科技(NYSE: KEYS)近日推出KAI推理构建器(Keysight AI Inference Builder),这款仿真与分析平台旨在大规模验证针对推理进行优化的AI基础设施。

NVIDIA推出代理式AI蓝图与电信推理模型

借助全新开源大型电信模型与 NVIDIA Blueprint,电信运营商能够利用自有数据训练 AI 智能体,构建自主网络。

礼来与NVIDIA宣布成立AI联合创新实验室以应对药物研发挑战

NVIDIA 与礼来公司在今日共同宣布,将合作成立一家开创性的 AI 联合创新实验室,致力于运用 AI 技术解决制药行业长期面临的诸多挑战。

生命科学领先企业采用 NVIDIA BioNeMo 平台加速 AI 驱动的药物研发

新闻摘要: l 礼来与 NVIDIA 宣布成立 AI 联合创新实验室以应对药物研发挑战。 l NVIDIA 携手赛默飞打造自主实验室基础设施

NVIDIA 推出 Alpamayo 系列开源 AI 模型与工具,加速安全可靠的推理型辅助驾驶汽车开发

新闻摘要 : l NVIDIA 率先发布为应对辅助驾驶长尾场景挑战而设计的开源视觉-语言-动作推理模型(Reasoning VLA);NVIDIA

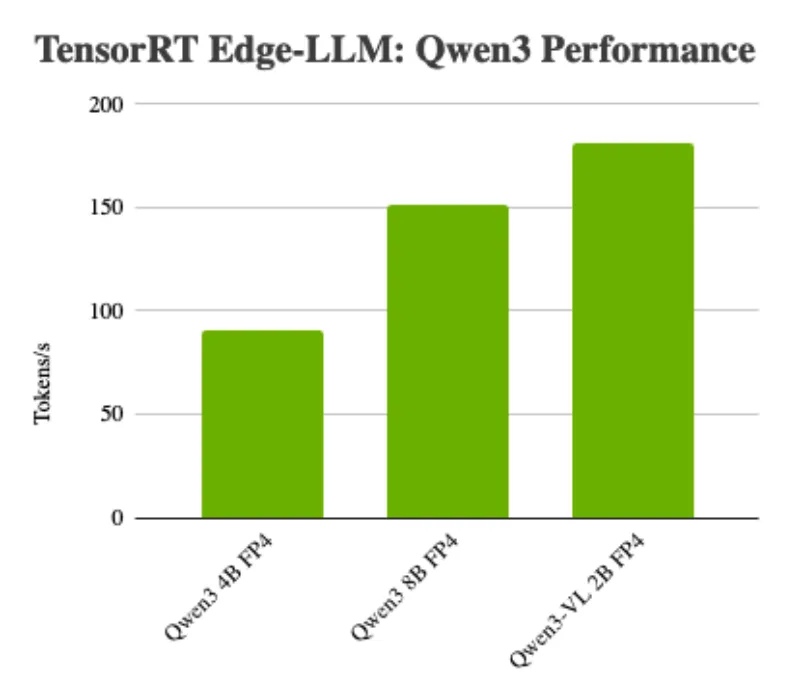

NVIDIA TensorRT LLM 1.0推理框架正式上线

TensorRT LLM 作为 NVIDIA 为大规模 LLM 推理打造的推理框架,核心目标是突破 NVIDIA 平台上的推理性能瓶颈。为实

MediaTek携手NVIDIA开启个人AI算力新纪元

Spark 助力开发者能在本地端对大型 AI 模型进行原型设计(Prototype)、微调(Fine-tune)和推理(Inference)。NVIDIA DGX Spark 将于 10 月 15 日上市,将驱动各产业迎来新一

什么是AI模型的推理能力

NVIDIA 的数据工厂团队为 NVIDIA Cosmos Reason 等 AI 模型奠定了基础,该模型近日在 Hugging Face 的物理推理模型排行榜中位列榜首。

使用NVIDIA NVLink Fusion技术提升AI推理性能

本文详细阐述了 NVIDIA NVLink Fusion 如何借助高效可扩展的 NVIDIA NVLink scale-up 架构技术,满足日益复杂的 AI 模型不断增长的需求。

【「AI芯片:科技探索与AGI愿景」阅读体验】+AI芯片的需求和挑战

当今社会,AI已经发展很迅速了,但是你了解AI的发展历程吗?本章作者将为我们打开AI的发展历程以及需求和挑战的面纱。

从2017年开始生成式

发表于 09-12 16:07

信而泰×DeepSeek:AI推理引擎驱动网络智能诊断迈向 “自愈”时代

,还是工业协议时序混乱,均可完整还原端到端业务会话链条,为智能分析提供坚实基础。2.AI根因定位:推理引擎驱动秒级精准诊断l 知识图谱驱动:将网络拓扑、流量统计、历史趋势、会话日志、异

发表于 07-16 15:29

润和软件发布StackRUNS异构分布式推理框架

当下,AI模型规模持续膨胀、多模态应用场景日益复杂,企业正面临异构算力资源碎片化带来的严峻挑战。为应对行业痛点,江苏润和软件股份有限公司(以下简称“润和软件”)正式发布自主研发的Sta

NVIDIA 如何应对会话式AI带来的推理挑战?

NVIDIA 如何应对会话式AI带来的推理挑战?

评论