完善资料让更多小伙伴认识你,还能领取20积分哦,立即完善>

标签 > transformer

文章:145个 浏览:6809次 帖子:3个

理解Transformer背后的理论基础,比如自注意力机制(self-attention), 位置编码(positional embedding),目标...

2023-07-09 标签:自动驾驶深度学习Transformer 900 0

来源:机器之心 SAM (Segment Anything )作为一个视觉的分割基础模型,在短短的 3 个月时间吸引了很多研究者的关注和跟进。如果你想系...

2023-07-05 标签:检测方法自动驾驶Transformer 1.9k 0

预训练的2D图像或语言Transformer:作为基础Transformer模型,具有丰富的特征表示能力。作者选择了先进的2D Transformer模...

2023-07-03 标签:模型数据集Transformer 1.5k 0

多阶段策略在图像修复任务中被广泛应用,虽然基于Transformer的方法在单图像超分辨率任务中表现出高效率,但在立体超分辨率任务中尚未展现出CNN-b...

2023-06-27 标签:数据变换器Transformer 1.8k 0

基于Transformer的大型语言模型(LLM)的内部机制

本文旨在更好地理解基于 Transformer 的大型语言模型(LLM)的内部机制,以提高它们的可靠性和可解释性。 随着大型语言模型(LLM)在使用和部...

2023-06-25 标签:存储语言模型Transformer 2.3k 0

Transformer在下一个token预测任务上的SGD训练动态

【导读】 AI理论再进一步,破解ChatGPT指日可待? Transformer架构已经横扫了包括自然语言处理、计算机视觉、语音、多模态等多个领域,...

2023-06-12 标签:Transformer自然语言ChatGPT 1.4k 0

与基于 RNN 的编码器-解码器模型类似,基于 transformer 的编码器-解码器模型由一个编码器和一个解码器组成,且其编码器和解码器均由 残差注...

2023-06-11 标签:解码器编码器Transformer 3.1k 0

PyTorch教程-11.9. 使用 Transformer 进行大规模预训练

11.9. 使用 Transformer 进行大规模预训练¶ Colab [火炬]在 Colab 中打开笔记本 Colab [mxnet] Op...

2023-06-05 标签:Transformerpytorch 1.9k 0

现在比较先进的目标跟踪方法采用了“分而治之”的策略,即将跟踪问题解耦成多个子任务,例如中心点预测、前景/背景二分类、边界框回归、角点预测等。尽管在各个跟...

2023-05-16 标签:建模函数Transformer 1.6k 0

Thinking Like Transformers 这篇论文中提出了 transformer 类的计算框架,这个框架直接计算和模仿 Transform...

2023-03-08 标签:Transformer 1.4k 0

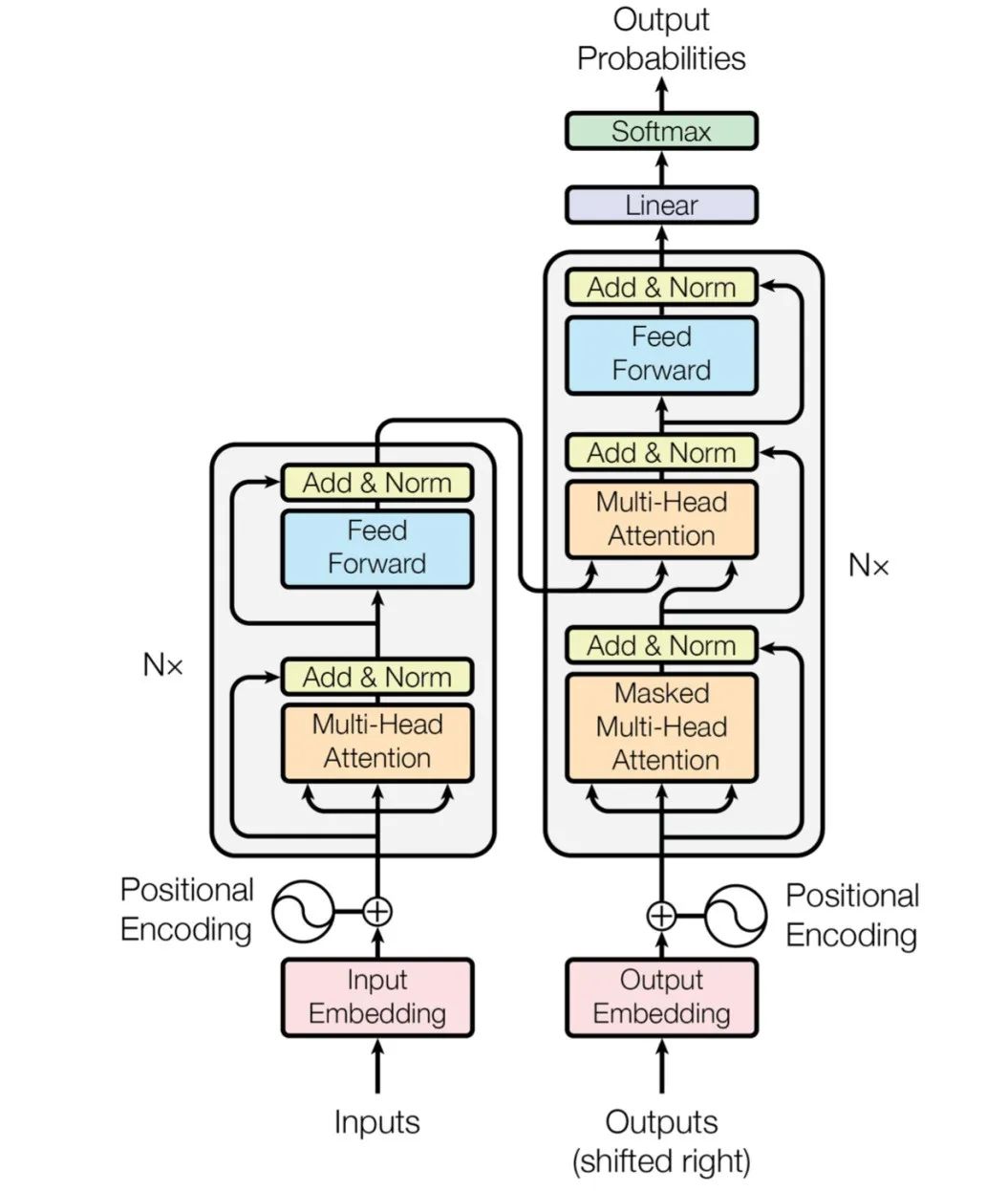

Transformer的主要优点是它可以并行地处理输入序列中的所有位置,因此在训练和推理时都有着很好的效率。此外,Transformer没有使用循环结构...

2023-03-08 标签:TransformernlpChatGPT 1.5k 0

如何让Transformer在征程5上跑得既快又好?以SwinT部署为例的优化探索

摘要:SwinT是目前视觉transformer模型中的典型代表,在常见视觉任务,如分类、检测、分割都有非常出色的表现。虽然在相同计算量的模型指标上,S...

2023-03-03 标签:gpu模型Transformer 1.5k 0

之前的文章和大家详细的介绍了静态的词向量表示word2vec理论加实战,但是word2vec存在一个很大的问题,由于是静态词向量所以无法表示一词多义,对...

2023-02-28 标签:GPTELMOSTransformer 10.5万 0

ChatGPT 由 GPT-3.5 模型提供支持,与传统思路不同,它采用了一种半监督式的训练机器说话。这是它的创新所在,也是它的独到之处。 GPT...

2023-02-21 标签:TransformernlpChatGPT 836 0

GPT家族与BERT模型都是知名的NLP模型,都基于Transformer技术。GPT-1只有12个Transformer层,而到了GPT-3,则增加到96层。

2023-02-21 标签:TransformernlpChatGPT 3.5k 0

ChatGPT 是一种专注于对话生成的语言模型。它能够根据用户的文本输入,产生相应的智能回答。这个回答可以是简短的词语,也可以是长篇大论。其中GPT是G...

2023-02-21 标签:TransformerOpenAIChatGPT 5.3k 0

ChatGPT的计算逻辑来自于一个名为transformer的算法,它来源于2017年的一篇科研论文《Attention is all your nee...

2023-02-21 标签:AITransformerChatGPT 1.1k 0

编辑推荐厂商产品技术软件/工具OS/语言教程专题

| 电机控制 | DSP | 氮化镓 | 功率放大器 | ChatGPT | 自动驾驶 | TI | 瑞萨电子 |

| BLDC | PLC | 碳化硅 | 二极管 | OpenAI | 元宇宙 | 安森美 | ADI |

| 无刷电机 | FOC | IGBT | 逆变器 | 文心一言 | 5G | 英飞凌 | 罗姆 |

| 直流电机 | PID | MOSFET | 传感器 | 人工智能 | 物联网 | NXP | 赛灵思 |

| 步进电机 | SPWM | 充电桩 | IPM | 机器视觉 | 无人机 | 三菱电机 | ST |

| 伺服电机 | SVPWM | 光伏发电 | UPS | AR | 智能电网 | 国民技术 | Microchip |

| 开关电源 | 步进电机 | 无线充电 | LabVIEW | EMC | PLC | OLED | 单片机 |

| 5G | m2m | DSP | MCU | ASIC | CPU | ROM | DRAM |

| NB-IoT | LoRa | Zigbee | NFC | 蓝牙 | RFID | Wi-Fi | SIGFOX |

| Type-C | USB | 以太网 | 仿真器 | RISC | RAM | 寄存器 | GPU |

| 语音识别 | 万用表 | CPLD | 耦合 | 电路仿真 | 电容滤波 | 保护电路 | 看门狗 |

| CAN | CSI | DSI | DVI | Ethernet | HDMI | I2C | RS-485 |

| SDI | nas | DMA | HomeKit | 阈值电压 | UART | 机器学习 | TensorFlow |

| Arduino | BeagleBone | 树莓派 | STM32 | MSP430 | EFM32 | ARM mbed | EDA |

| 示波器 | LPC | imx8 | PSoC | Altium Designer | Allegro | Mentor | Pads |

| OrCAD | Cadence | AutoCAD | 华秋DFM | Keil | MATLAB | MPLAB | Quartus |

| C++ | Java | Python | JavaScript | node.js | RISC-V | verilog | Tensorflow |

| Android | iOS | linux | RTOS | FreeRTOS | LiteOS | RT-THread | uCOS |

| DuerOS | Brillo | Windows11 | HarmonyOS |