为了改进LLM的推理能力,University of California联合Meta AI实验室提出将Contrastive Decoding应用于多种任务的LLM方法。实验表明,所提方法能有效改进LLM的推理能力。让我们走进论文一探究竟吧!

2023-09-21 11:37:55 327

327

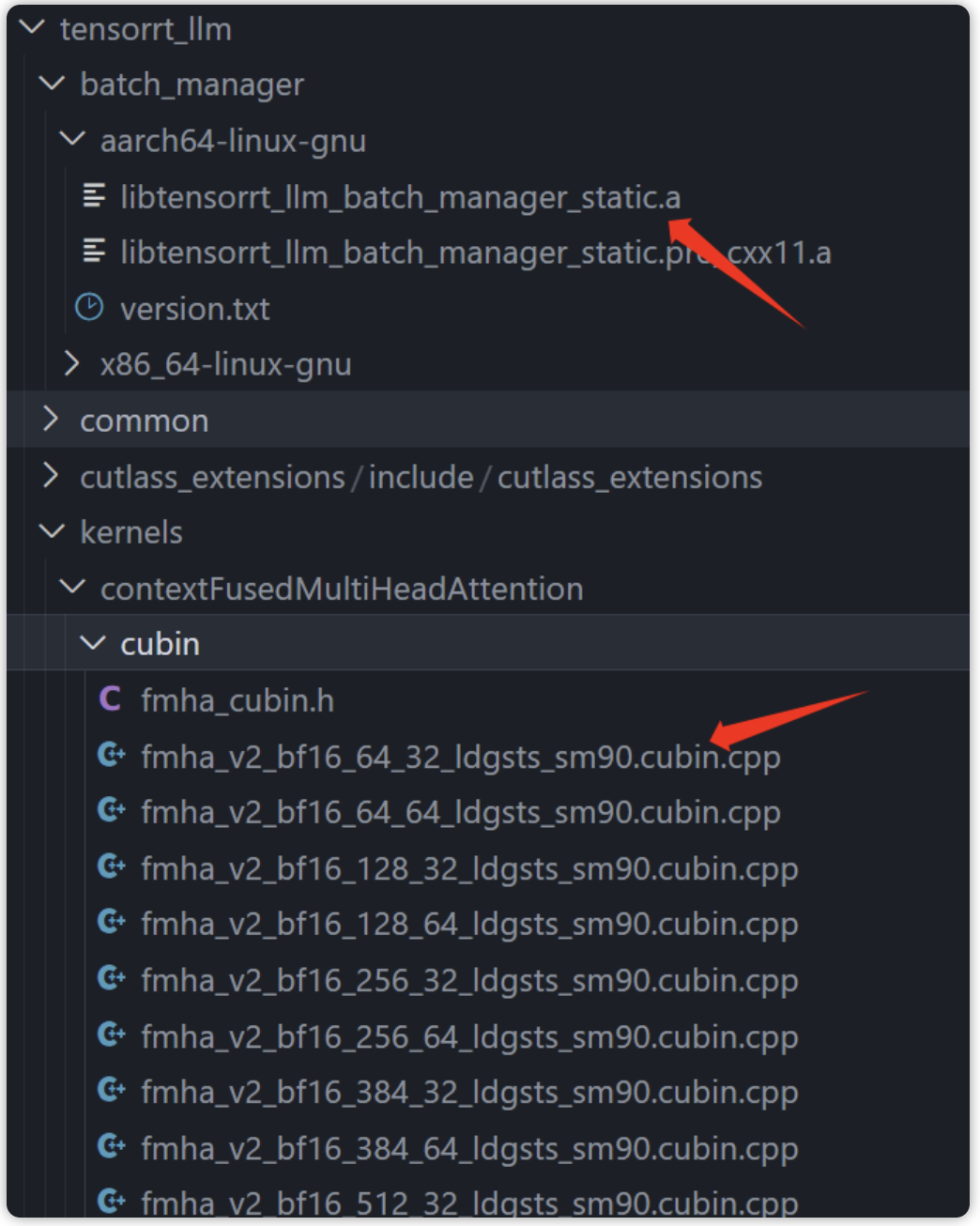

TensorRT-LLM正式出来有半个月了,一直没有时间玩,周末趁着有时间跑一下。

2023-11-16 17:39:34 772

772

针对大语言模型 (LLM) 在部署过程中的性能需求,低比特量化技术一直是优化效果最佳的方案之一,本文将探讨低比特量化技术如何帮助 LLM 提升性能,以及新版 OpenVINO 对于低比特量化技术的支持。

2023-12-08 15:26:45 554

554

LLM3225 - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R15H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R18H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R33H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R56H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R68H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

在生成EXE后,运行出现这个问题,求教大神指点是怎么原因,急急急!!!!!什么问题?如何解决?!

2015-06-19 17:21:32

`https://bbs.elecfans.com/forum.ph ... 7%94%9F%E6%88%90exe如题 按照上面这个链接的步骤生成exe预览的时候没有报错但是生成结果报如下错误

2015-11-19 09:38:41

在生成系统时runsimulator时为什么出现the HDL simulator path is not set.it can be set in the tools >options dialo怎么改

2014-08-13 17:59:28

在生成应用程序时,我想要得到两个单独的文件夹,一个是data,另一个是gongyi,在生成页中的目标项,程序自动生成了支持目录,我选择添加,修改目标标签为gongyi,预览时还是只有一个data文件,我该怎么做?

2013-03-13 11:01:10

CC2541oad在生成ImageB.bin超过256k flash?那个大神用过cc2541的 oad功能吗???在生成ImageB.bin时,ImageB.bin文件过大 ,超过

2016-03-16 14:56:17

用LABVIEW生成表格是很简单的事情,但如果在生成表格的同时用LABVIEW给表格加密,然后继续往这个表格里面写数据,求问大神该怎么实现

2018-04-10 10:09:57

同样的项目框架,其中一个改用调用很多类库的方式,另一个都是调用单独的vi,类库比较少。在生成EXE的时候,前者需要十几分钟,后者一分钟之内完成。是因为类库太多的原因导致生成EXE变慢吗?两个项目其他方面差异比较小。

2022-07-15 11:06:50

的地址可能已更改,并且启动文件可能不正确。“Reset-Handler”所需的“.text”空间是否在生成链接文件时预先计算并保留?或者它是一种迭代过程?gcc 工具链的哪个实例生成启动文件?谢谢

2023-01-05 09:06:52

生成pcb要注意那些方面

2017-03-03 09:31:38

labview在生成应用程序之后无法运行,运行停止选项都是灰色的,没办法运行,但是在出现意外报错终止之后会显示运行按钮,点击可正常运行,也就是说,我把报错那一块改对之后,怎么也运行不了,求大神解答!!!!

2016-01-22 08:36:59

本帖最后由 elecfans跑堂 于 2015-8-31 09:24 编辑

labview中生成excel报表,运行后,怎么excel一直在生成,停不下来,求解

2015-08-31 08:49:00

labview怎么在修改项目子vi的时候实时预览项目生成效果,而不是每次生成EXE出来再看效果??这样有点麻烦。望大神告知谢谢!!

2018-12-28 17:30:44

我在生成应用程序后要生成安装程序,如图,在源文件设置里要将“我的应用程序”添加到“目标视图”时,看到我的应用程序下显示错误生成预览,结果到时添加后,在生成安装程序时显示发生未定义错误,致使安装包无法正常生成。该问题是不是因为我在生成应用程序时发生了错误?哪位大侠可告知一二,,万分感激!!

2016-05-12 14:58:09

在生成的i2c1.c文件中有几个函数,利用中断进行读写从机,按照i2c1.h中的例子无论怎么改都不正确,每次都只能发送从机地址,既不能读也不能写。哪位成功过的朋友给讲一下到底怎么回事

2017-04-20 18:10:01

为什么我的LabVIEW项目在生成EXE后有些界面的自定义菜单可以实现,有些却不行呢?甚至有时候全部都不行了。但是在编辑模式下又是正常的,我感到很费解啊~!

2016-01-15 16:49:29

本帖最后由 一只耳朵怪 于 2018-5-25 17:36 编辑

在8168 DVR-RDK中,现在生成的.out 只可以在开发板上运行的,怎么修改能够生成可在linux的可调试程序?

2018-05-25 08:12:10

我有一个问题,在quartus ii 中编写一个程序,它的输出是自定义类型,编译安全通过,为什么在生成密封元件时会报错,说是不支持的类型。有没有解决办法。

2014-02-21 01:18:11

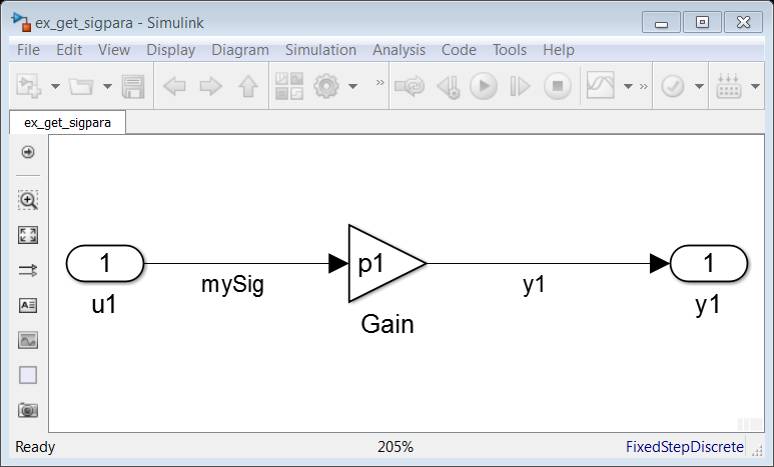

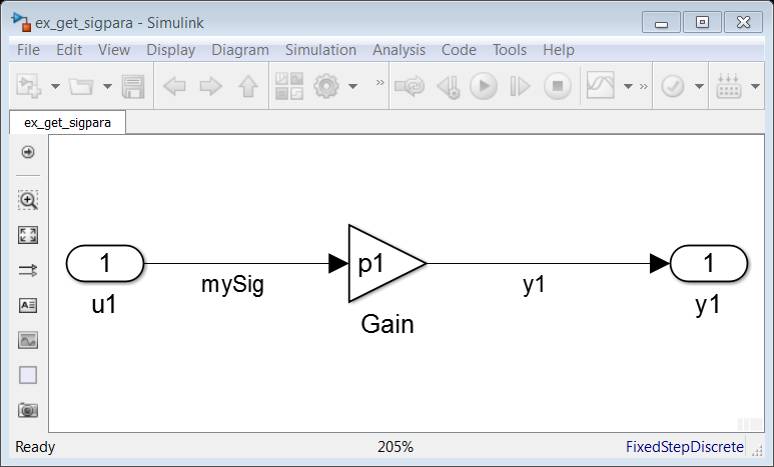

在做simulink+tasking自动代码生成时,编译找不到底层文件,将文件添加进去后,会出现RT或NRT等重复定义

2024-02-20 08:06:38

但我们无法在代码中配置 RTR 位,能否请你解释一下如何配置 RTR 位以在生成的 CAN_NODE_0 中接收远程帧。

2024-01-19 06:38:58

微波射频在生活中的应用有哪些方面? 1.网络通信,信号覆盖以及信息沟通。 2.微波射频能产生均匀的能量,也用于烹饪或者加热食物 3.因为微波射频产生的能量可控,可用于稳定照明。 4.在人体健康方面也有相关应用。

2022-03-30 13:51:57

想学HIFI,功放知识,效果器方面的知识想买个示波器,求推荐

2015-11-05 00:43:39

Y电容,到底怎么接效果才是最好的?

2021-03-17 06:42:17

labview在生成exe时怎么让启动项的vi不运行?

2018-12-14 11:16:06

请问为什么生成FFT ip 核会卡在生成这一步,前两天还好好的。求大神的解决办法,网上实在找不到方法

2016-11-01 13:42:43

LuxStudio增材制造晶格模型自动生成平台|LuxCreo目前,市面上大多数的晶格设计软件几乎都有局限性,比如晶格种类过少、生成的晶胞质量本身有问题、效果不理想,另外软件操作门槛较高等,种种弊端

2022-11-09 10:43:02

多文档自动摘要技术可以向用户提供一个简洁、全面的摘要信息,因此研究多文档自动摘要技术具有很重要的意义。本文提出了一种上下文敏感的基于词频统计的多文档自动摘要

2009-12-18 16:58:29 12

12 机器学习中常用的降维方法是主成分分析(PCA),而主成分分析常用奇异值分解(SVD)。那么SVD的效果到底如何呢?SVD常用来进行图像的压缩,我们就来实验一下。

2017-02-11 17:19:13 1595

1595 中存放的新值来描述循环语句的执行效果,并将该执行效果定义为循环摘要,同时,提出一种自动生成循环摘要的方法,可以为操作常用数据结构的循环自动生成循环摘要,包含嵌套循环.此外,基于循环摘要,可以自动生成循环语句

2017-12-29 11:12:57 0

0 网络中的脆弱节点进行补强。仿真实验结果显示这种结合K-means和脆弱性分析的拓扑生成算法在生成对意外风险具有较强抗性的电力网络拓扑方面具有比较好的效果。

2018-02-02 17:05:55 0

0 最近,经过研究证明,生成英文维基百科(English Wikipedia)文章的方法可以概述为源文档的多文档摘要。我们使用抽取式文摘(extractive summarization)来粗略地识别

2018-02-06 11:26:27 5775

5775

通过使用流量生成器创建示例设计,运行综合和实现以及查看摘要报告(利用率,功率等),了解如何运行内存接口生成器(MIG)GUI以生成RTL和约束文件

2018-11-23 06:16:00 4038

4038 GAN 可以将任意的分布作为输入,这里的 Z 就是输入,在实验中我们多取Z∼N(0,1),也多取 [−1,1] 的均匀分布作为输入。生成器 G 的参数为 θ,输入 Z 在生成器下得到 G(z;θ),输出可以被视为从分布中抽取的样本 G(z;θ)∼Pg。

2019-02-13 13:59:47 5251

5251

这样在生成代码的时候,参数p1就会定义为int32的数据类型,并且声明为extern。而且它的声明和定义代码会分别写入myHdr.h以及mySrc.c。

2019-09-17 16:18:40 2566

2566

的,好的特征可以显著地提升模型效果。这意味着通过特征生成(即从数据设计加工出模型可用特征),是特征工程相当关键的一步。 本文从特征生成作用、特征生成的方法(人工设计、自动化特征生成)展开阐述并附上代码。 1 特征生成的作用

2021-03-10 15:53:42 1860

1860

现有长文本自动摘要生成方法存在句子特征单一化和无法全面衡量句子相似特征的问题,导致摘要生成的准确率降低。为此,提岀一种基于图集成模型的自动摘要生成方法。在计算得到文本句子词频、语义和句法特征后,利用

2021-03-22 14:40:16 10

10 当前,古诗勺生成任务大多基于单一的循环神经网络(RNN结构,在生成时需事先给定一个起始字然后以该起始字为基础进行古诗勺生成,生成过程的可控性较差,往往达不到预期效果。针对以上问题,将注意力机制引入

2021-04-12 15:30:57 20

20 文本摘要应包含源文本中所有重要信息,传统基于编码器-解码器架构的摘要模型生成的摘要准确性较低。根据文本分类和文本摘要的相关性,提出一种多任务学习摘要模型。从文本分类辅助任务中学习抽象信息改善摘要生成

2021-04-27 16:18:58 11

11 文本摘要生成技术能够从海量数据中概括岀关键信息,有效解决用户信息过载的问题。目前序列到序列模型被广泛应用于英文文本摘要生成领域,而在中文文本摘要生成领域没有对该模型进行深λ硏究。对于传统的序列到序列

2021-05-28 15:45:25 2

2 文本摘要任务旨在通过对原文进行压缩提炼,得出简明扼要的内容描述。针对中文专利文本,提出了一种基于 PatentRank算法生成专利摘要的算法。首先,对候选勺群做冗余处理,以去除候选勺群中相似度较高

2021-06-15 17:03:06 5

5 任务和常识生成任务上的具体应用,指出了受控文本生成技术在具体应用场景下的改进方向。 0. 什么是受控文本生成 文本生成任务是自然语言处理领域十分重要的一类任务。文本摘要、语法纠错、人机对话等很多自然语言处理任务都可

2021-10-13 09:46:39 3033

3033

以往的标题模型产生的都是平实性标题,即简单语言描述的事实性标题。但是,实际上我们可能更需要有记忆点的爆款标题来增加点击量/曝光率。因此,衍生出了一个新任务——带有风格的标题生成,即 Stylistic Headline Generation,简称 SHG 。

2022-07-08 17:04:49 1835

1835 Abstract Intro 尽管基于预训练的语言模型的摘要取得了成功,但一个尚未解决的问题是生成的摘要并不总是忠实于输入文档。造成不忠实问题的原因可能有两个: (1)摘要模型未能理解或捕获

2022-11-01 11:37:57 692

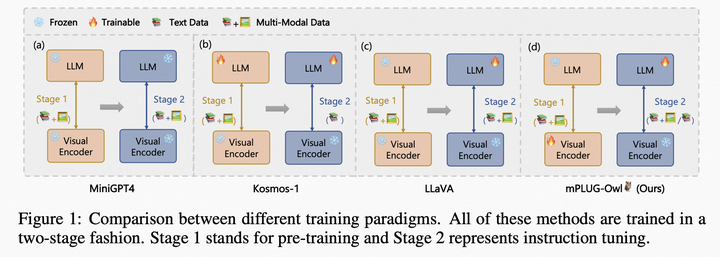

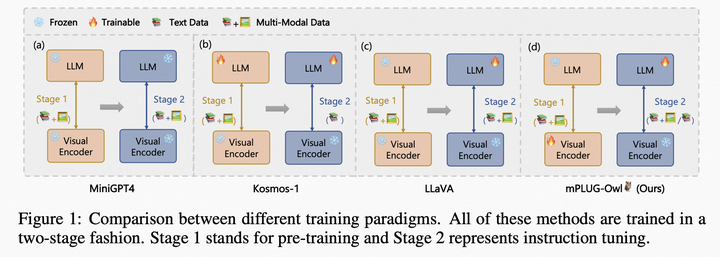

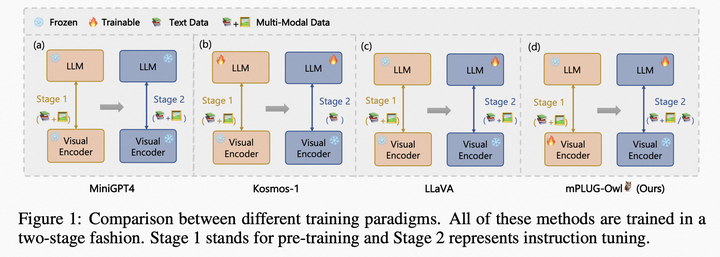

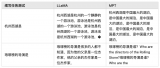

692 大型语言模型LLM(Large Language Model)具有很强的通用知识理解以及较强的逻辑推理能力,但其只能处理文本数据。虽然已经发布的GPT4具备图片理解能力,但目前还未开放多模态输入接口并且不会透露任何模型上技术细节。因此,现阶段,如何利用LLM做一些多模态任务还是有一定的研究价值的。

2023-05-11 17:09:16 648

648

本文整理了近两年来基于LLM做vision-lanuage任务的一些工作,并将其划分为4个类别:

2023-05-17 15:02:35 575

575

LLM 与通用人工智能(AGI)之间仍存在显著差距。首先,大多数当前 LLM 只能感知和理解多模态内容,而不能自然而然地生成多模态内容。其次,像图像和语音这样的连续信号不能直接适应接收离散 token 的 LLM。

2023-05-22 14:38:06 417

417

现在是2023年5月,截止目前,网络上已经开源了众多的LLM,如何用较低的成本,判断LLM的基础性能,选到适合自己任务的LLM,成为一个关键。 本文会涉及以下几个问题: 影响LLM性能的主要因素

2023-05-22 15:26:20 1148

1148

大型语言模型LLM(Large Language Model)具有很强的通用知识理解以及较强的逻辑推理能力,但其只能处理文本数据。虽然已经发布的GPT4具备图片理解能力,但目前还未开放多模态输入接口

2023-05-22 15:57:33 466

466

模型(LLM)应用、Stable Diffusion 和 Adobe Firefly 等图片生成器,以及 NVIDIA DLSS 3 Frame Generation (DLSS 3 帧生成技术

2023-05-25 09:15:02 509

509

最近几年,GPT-3、PaLM和GPT-4等LLM刷爆了各种NLP任务,特别是在zero-shot和few-shot方面表现出它们强大的性能。因此,情感分析(SA)领域也必然少不了LLM的影子

2023-05-29 17:24:41 1379

1379

近年来,像 GPT-4 这样的大型语言模型 (LLM) 因其在自然语言理解和生成方面的惊人能力而受到广泛关注。但是,要根据特定任务或领域定制LLM,定制培训是必要的。本文提供了有关自定义训练 LLM 的详细分步指南,其中包含代码示例和示例。

2023-06-12 09:35:43 1782

1782 当前,生成式人工智能(AI)技术的快速发展令人瞩目。它能够理解人类的描述,并在短时间内生成逼真的图像和视频。在生成式AI的应用中,图像深度信息具有重要的价值,准确的深度图像深度信息可以使生成的图像

2023-06-21 09:06:42 279

279 本文旨在更好地理解基于 Transformer 的大型语言模型(LLM)的内部机制,以提高它们的可靠性和可解释性。 随着大型语言模型(LLM)在使用和部署方面的不断增加,打开黑箱并了解它们的内部

2023-06-25 15:08:49 991

991

在这篇文章中,我们将尽可能详细地梳理一个完整的 LLM 训练流程。包括模型预训练(Pretrain)、Tokenizer 训练、指令微调(Instruction Tuning)等环节。 文末

2023-06-29 10:08:59 1202

1202

LLM 是黑箱模型,缺乏可解释性,因此备受批评。LLM 通过参数隐含地表示知识。因此,我们难以解释和验证 LLM 获得的知识。此外,LLM 是通过概率模型执行推理,而这是一个非决断性的过程。对于 LLM 用以得出预测结果和决策的具体模式和功能,人类难以直接获得详情和解释。

2023-07-10 11:35:00 1354

1354

ChatGLM2-6b是清华开源的小尺寸LLM,只需要一块普通的显卡(32G较稳妥)即可推理和微调,是目前社区非常活跃的一个开源LLM。

2023-07-24 09:04:22 1311

1311

LLM 对软件研发的单点提效,我之前录制过一段视频,大家可以直接观看,里面有详细的演示,我在这里就不再赘述了。

2023-07-24 15:39:06 766

766 苏神最早提出的扩展LLM的context方法,基于bayes启发得到的公式

2023-07-28 17:37:43 1484

1484

年 8 月 8 日 — NVIDIA 与 Hugging Face 宣布建立合作伙伴关系,为数百万开发者提供生成式 AI 超级计算服务,帮助他们构建大语言模型(LLM)和其他高级 AI 应用。 此次

2023-08-09 11:41:59 100

100

根据谷歌支持页面7月31日的信息显示,YouTube正在测试用人工智能(AI)自动生成视频摘要的功能,这是谷歌在探索生成型 AI 技术的最新尝试之一。 通过Android Police

2023-08-15 15:58:02 1316

1316 Stability AI 近日宣布了他们首个用于编程的生成式 LLM AI 产品 ——StableCode。该产品旨在帮助程序员完成日常工作,并为新手开发者提供实用的学习工具。

2023-08-24 11:27:03 562

562

今天,Meta发布了Code Llama,一款可以使用文本提示生成代码的大型语言模型(LLM)。

2023-08-25 09:06:57 885

885

MLC-LLM部署在各种硬件平台的需求,然后我就开始了解MLC-LLM的编译部署流程和RWKV World模型相比于MLC-LLM已经支持的Raven系列模型的特殊之处。 MLC-LLM的编译部署流程

2023-09-04 09:22:46 1569

1569

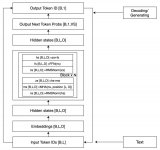

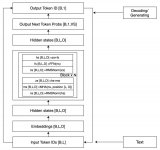

要理解大语言模型(LLM),首先要理解它的本质,无论预训练、微调还是在推理阶段,核心都是next token prediction,也就是以自回归的方式从左到右逐步生成文本。

2023-09-19 16:25:47 519

519

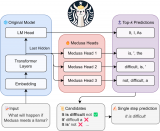

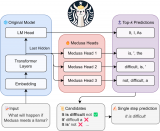

面对推测性解码的复杂性,研究人员推出了Medusa技术,这个框架回归了Transformer模型的本质,减少了复杂度,增强了效率,让每个生成阶段都能快速产出结果。当将Medusa与基于树的注意机制结合时,生成速度提高了2到3倍。

2023-09-20 11:23:59 409

409

在 MLC-LLM 部署RWKV World系列模型实战(3B模型Mac M2解码可达26tokens/s) 中提到要使用mlc-llm部署模型首先需要一个编译过程,将原始的基于Realx搭建的模型

2023-09-26 12:25:55 383

383

扩增通过条件生成模型生成新样本来扩展数据集,从而提高各种学习任务的分类性能。然而,很少有人从理论上研究生成数据增强的效果。为了填补这一空白,我们在这种非独立同分布环境下构建了基于稳定性的通用泛化误差

2023-11-05 20:15:02 358

358

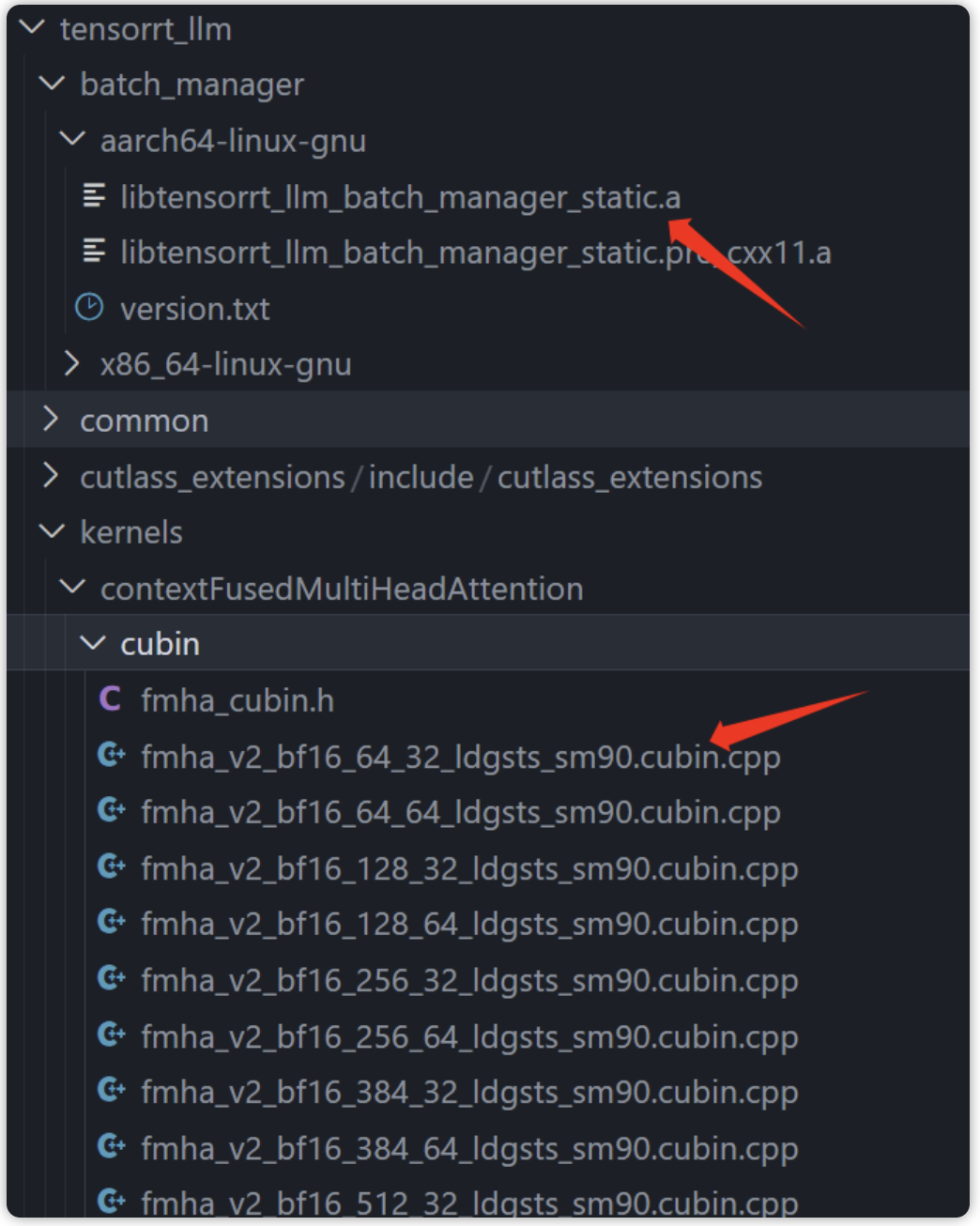

之前玩内测版的时候就需要cuda-12.x,正式出来仍是需要cuda-12.x,主要是因为tensorr-llm中依赖的CUBIN(二进制代码)是基于cuda12.x编译生成的,想要跑只能更新驱动。

2023-11-13 14:42:41 1746

1746

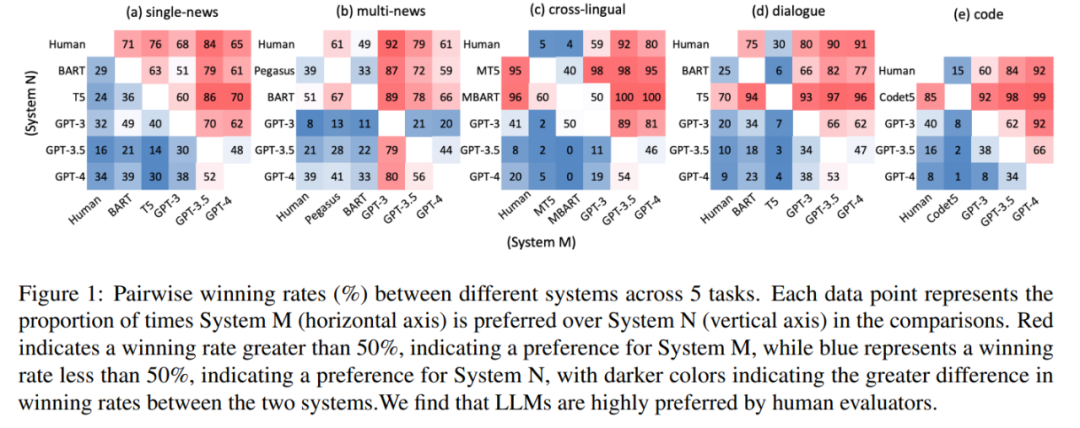

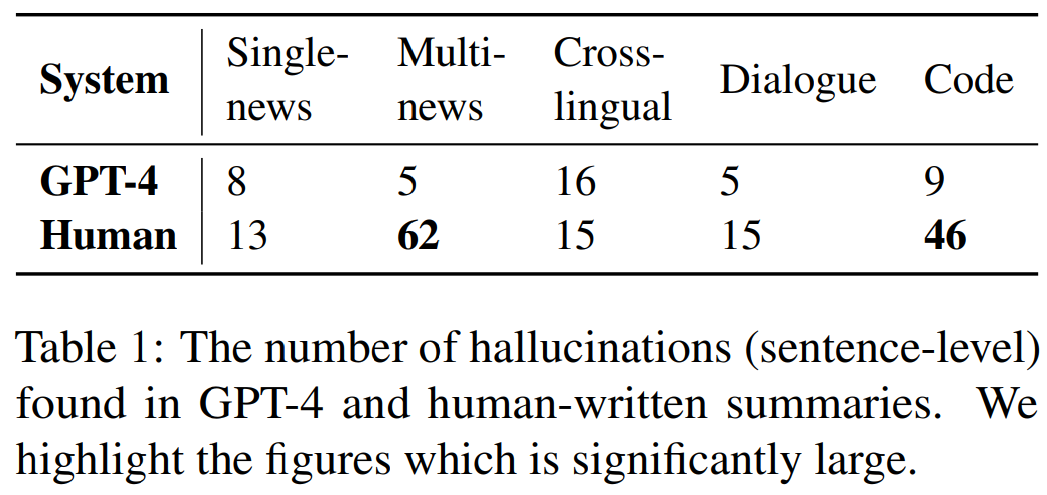

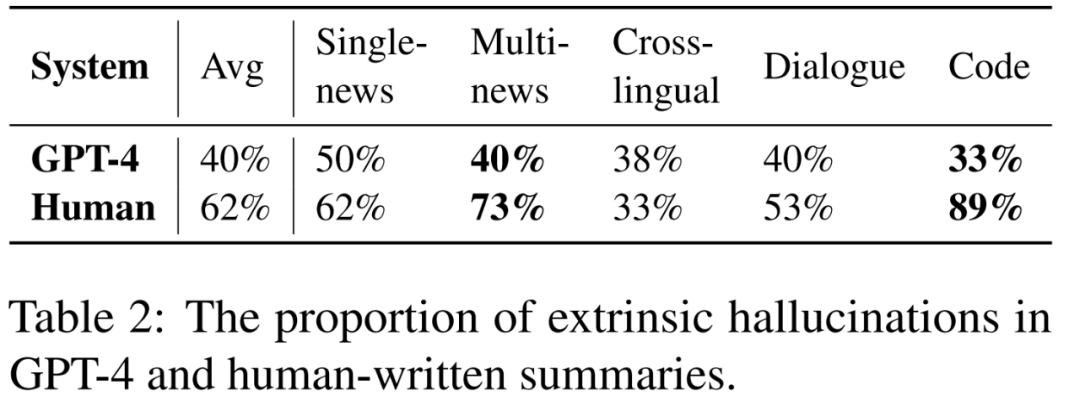

幻觉被描述为无意义或不忠实于所提供源内容的生成内容。根据与源内容的矛盾,这些幻觉又进一步分为内在幻觉和外在幻觉。在LLMs中,幻觉的范围包含了一个更广泛、更全面的概念,主要集中在事实错误上。本文重新定义了幻觉的分类,为LLM应用程序提供了一个更定制的框架。

2023-11-22 17:40:41 467

467

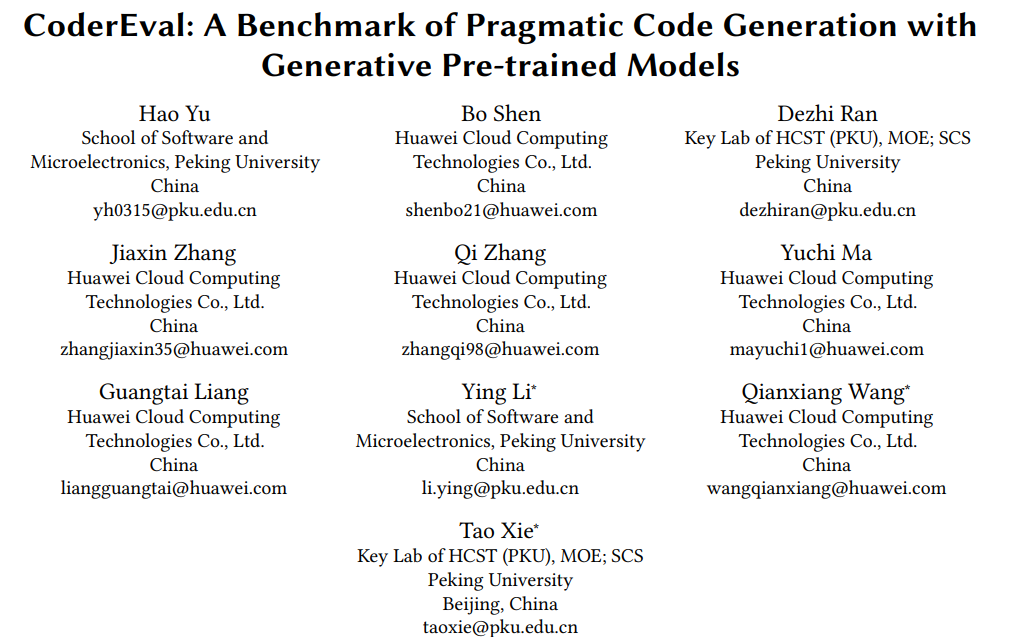

项目中的选取了代码生成任务来构建CoderEval,并根据对外部依赖的程度为标准将这些任务分为6个等级、根据生成的目标分为3类生成任务,以更多维地评估不同大模型在不同上下文场景中的生成效果。 实验结果表明,这三个模型在生成自包含函数方面的效果明显优于其他任务,但实际

2023-11-25 15:55:01 586

586

望创达2218亿美元。 年度机遇近在眼前,跨境出海企业如何抓住机遇、突破销售记录? 对此,LLM或许能够给出答案。 微软首席执行官萨提亚·纳德拉在刚刚结束的全球Ignite技术大会上曾表示,“生成式AI模型的参数范围很广,从需要 Azure 中最强大 GPU 的数万亿参数的 LLM,到数十亿参

2023-11-27 08:15:02 215

215

internal feedback:使用LLM去预测生成的plan取得成功的概率、Tree of Thought去对比不同的plan(有点类似AlphaGo的蒙特卡诺搜索的意思)、对中间结果进行评估并作为长期记忆存储

2023-12-05 14:49:47 857

857

LLM 中非常重要的一个概念是 Token,我们输入给 LLM 和它输出的都是 Token。Token 在这里可以看做语言的基本单位,中文一般是词或字(其实字也是词)。比如:”我们喜欢 Rust

2023-12-25 10:38:38 657

657

单颗 SoC 支持 1 至 340 亿参数的多模态大模型(Multi-Modal LLM)推理,实现前端低功耗生成式 AI。

2024-01-09 15:19:33 597

597 安霸在CES 2024上发布了全新的N1系列生成式AI芯片,这是一款专门为前端设备设计的芯片,支持本地运行大型语言模型(LLM)应用。其单颗SoC能够支持1至340亿参数的多模态大模型(Multi-Modal LLM)推理,从而实现低功耗的生成式AI功能。

2024-01-09 15:32:54 602

602 作为做LLM应用的副产品,我们提出了RLCD[11],通过同时使用正例和负例prompt,自动生成带标签的生成样本不需人工标注,然后可以接大模型微调,或者用于训练reward models

2024-01-19 13:55:33 178

178 这个问题随着LLM规模的增大愈发严重。并且,如下左图所示,目前LLM常用的自回归解码(autoregressive decoding)在每个解码步只能生成一个token。这导致GPU计算资源利用率

2024-01-29 15:54:24 261

261

ChatGPT的人性口语化回复相信许多人已体验过,也因此掀起一波大型语言模型(Large Language Model, LLM)热潮,LLM即ChatGPT背后的主运作技术,但LLM运作需要庞大运算力,因此目前多是在云端(Cloud)上执行。

2024-02-29 16:29:59 476

476

电子发烧友App

电子发烧友App

评论