Imagination Technologies (IMG.L) 表示,功耗和散热设计已成为移动SoC设计决策中的主要考量。

2013-02-28 16:16:16 1030

1030 领先的多媒体、处理器、通信和云技术提供商 Imagination Technologies (IMG.L) 表示,功耗和散热设计已成为移动SoC设计决策中的主要考量。

2013-03-01 13:57:14 805

805 针对Cellular的领域,LitePoint为您详解在测试时需要重点考量的因素以及解决方案。

2014-05-09 09:45:59 2919

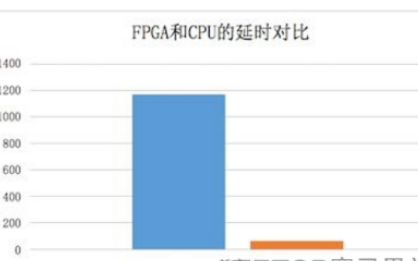

2919 Intel预计2020年将有1/3 的云数据中心节点采用FPGA 技术,CPU+FPGA 拥有更高的单位功耗性能、更低时延和更快加速性能。

2016-01-18 09:26:12 3303

3303 当前主流的AI芯片主要分为三类,GPU、FPGA、ASIC。GPU、FPGA均是前期较为成熟的芯片架构,属于通用型芯片。ASIC属于为AI特定场景定制的芯片。行业内已经确认CPU不适用于AI计算,但是在AI应用领域也是必不可少。

2023-02-14 11:03:56 4730

4730 FPGA 的性能比Titan X Pascal GPU 提高了60%,而性能/功耗比好2.3倍。结果表明,FPGA 可能成为下一代DNN 加速的首选平台7.深层神经网络中FPGA的未来FPGA 能否

2017-04-27 14:10:12

......

2) AI超算革命:FPGA集群功耗比GPU降低62%;混合精度计算效率提升5.8倍......

3) 6G通信突破:软件无线电实现Sub-6GHz/毫米波全频段覆盖;Massive MIMO波束

2025-03-03 11:21:28

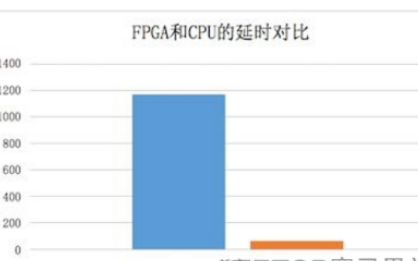

实现更低的延迟。因此对流水式计算的任务,FPGA比GPU天生有延迟方面的优势。ASIC在吞吐量、延迟、功耗单个方面都是最优秀的。但是其研发成本高,周期长。FPGA的灵活性可以保护资产。数据中心是租给

2018-08-16 09:54:23

,在数据中心高性能计算及 AI 训练中,CPU 这一“主角”的重要性下降,而以往的“配角们”,即 GPU、FPGA、TPU、DPU 等的加速器的重要性在上升。

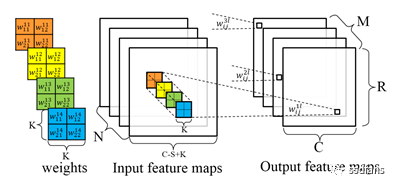

图3:MLP网络本质是并行的乘法和累加

2023-11-09 14:09:46

,并在运算速度和吞吐量方面提供了更高的性能。它们的使用寿命也更长,大约是 GPU 的 2-5 倍,并且对恶劣环境和其它特殊环境因素有更强的适应性。

有一些公司已经在他们的人工智能产品中使用了 FPGA

2024-03-21 15:19:45

本文重点介绍:1、各种处理器的特点:简要对比各种处理器的特点2、图片处理算法的特点:介绍图片处理算法的特点3、FPGA加速性能的主要因素:分析FPGA能够加速图片处理的原因4、HEVC算法之FPGA

2018-08-01 09:55:53

。如果使用 GPU 来加速,要想充分利用 GPU 的计算能力,batch size 就不能太小,延迟将高达毫秒量级。使用 FPGA 来加速的话,只需要微秒级的 PCIe 延迟(我们现在的 FPGA

2019-08-12 10:16:01

提升至通用CPU服务器的30倍以上。同时,与已经深入人心的高性能计算的代表GPU相比,FPGA具有硬件可编程、低功耗、低延时的特性,代表了高性能计算的未来发展趋势。而在人工智能(AI)里面火热的深度学习

2017-04-15 16:17:41

FPGA的方案选择 幸运的是,需要高性能DSP功能的便携式设备设计者还有其它选择。最近FPGA开始达到了应用所要求的成本竞争力。优选的FPGA方案可用来处理计算量繁重的高端DSP算法,同时还可

2011-02-17 11:21:37

。使用FPGA的大规模数据中心和其他领域的应用正在吸引人们对FPGA的单精度浮点性能的更多关注。虽然一些案例使用(包括百度示例),将GPU作为计算加速器和FPGA用在存储端,但Altera,Xilnix

2017-03-07 11:52:29

的任务,FPGA 比 GPU 天生有延迟方面的优势。ASIC 专用芯片在吞吐量、延迟和功耗三方面都无可指摘,但微软并没有采用,出于两个原因:1.数据中心的计算任务是灵活多变的,而 ASIC 研发成本高

2017-03-11 09:52:46

,GPU已经不再局限于3D图形处理了,GPU通用计算技术发展已经引起业界不少的关注,事实也证明在浮点运算、并行计算等部分计算方面,GPU可以提供数十倍乃至于上百倍于CPU的性能。GPU通用计算方面

2016-01-16 08:59:11

配置文件来了解3D / GPU / HDX性能。 XenApp服务器运行的是带有4个vCPU和48GB RAM的Windows Server 2016映像。在性能测试期间,我一直在使用GPU

2018-09-12 16:24:19

最近遇到了一个加速matlab程序的问题,不知道如何利用GPU,以及使用GPU的先决条件,是不是GPU加速必须要用cuda,最重要的是只用GPUArray和gather函数,加速效果不知道如何,主要是有多个函数调用关系?哪位前辈能指导一下?

2019-03-30 11:21:12

产生新需求,将带来高性能GPU市场快速增长。GPU分类与主要厂商,资料来源:架构师技术联盟、华西证券研究所云端AI服务器AI服务器通常搭载GPU、FPGA、ASIC等加速芯片,利用CPU与加速芯片的组合

2021-12-07 10:04:11

基于KU5P的双路100G光纤网络加速计算卡一、板卡概述 基于Xilinx UltraScale+16 nm KU5P芯片方案基础上研发的一款双口100 G FPGA光纤以太网PCI-Express

2022-07-13 10:05:03

的嵌入(embedding)4.GNN加速器设计挑战GNN的算法中涉及到大量的矩阵计算和内存访问操作,在传统的x86架构的服务器上运行此算法是非常低效的,表现在速度慢,能耗高等方面。新型GPU

2021-07-07 08:00:00

``提供个人超级计算机解决方案 高性能GPU运算服务器解决方案/集群解决方案 Nvidia Tesla C2050 CUDA核心频率:1.15 GHz CUDA核心数量:448 双精度浮点性能

2014-08-03 18:09:13

95 Gflops)单精度浮点性能:4577 Gigaflops(每颗 GPU 2288 Gflops)专用存储器总容量:8 GB(每颗 GPU 4GB)功耗:225W热设计功耗 被动散热 13000

2015-02-05 16:14:28

GPU 95 Gflops) 单精度浮点性能:4577 Gigaflops(每颗 GPU 2288 Gflops) 专用存储器总容量:8 GB(每颗 GPU 4GB) 功耗:225W热设计功耗 被动散热

2014-09-02 21:17:41

95 Gflops)单精度浮点性能:4577 Gigaflops(每颗 GPU 2288 Gflops)专用存储器总容量:8 GB(每颗 GPU 4GB)功耗:225W热设计功耗 被动散热 13000

2015-01-19 16:53:59

95 Gflops)单精度浮点性能:4577 Gigaflops(每颗 GPU 2288 Gflops)专用存储器总容量:8 GB(每颗 GPU 4GB)功耗:225W热设计功耗 被动散热 13000

2015-01-19 16:54:53

95 Gflops)单精度浮点性能:4577 Gigaflops(每颗 GPU 2288 Gflops)专用存储器总容量:8 GB(每颗 GPU 4GB)功耗:225W热设计功耗 被动散热 13000

2015-01-19 16:59:48

GPU架构设计者提供反馈,以改善和推进未来GPU的架构设计基本要求(其一即可): * 严谨的逻辑思维和分析能力* 有CUDA代码调优经验(或者SIMD等架构的调优经验)* 熟悉矩阵计算的优化和加速* 较强C++编程能力、算法分析和实现* 熟悉计算机体系结构*了解GPU架构与基于GPU的高性能计算

2017-09-01 17:22:28

big.LITTLE和GPU相结合实现性能和功耗的最佳匹配

2021-02-02 07:00:45

许可证模型的加速令牌或SIMULIA统一许可证模型的SimUnit令牌或积分授权。

4. GPU计算的启用

- 交互式模拟:通过加速对话框启用,打开求解器对话框,点击“加速”按钮,打开“硬件加速”并

2024-12-16 14:25:17

的合作力度,以进一步推动计算加速、计算存储及网络加速领域的创新与部署。数据中心是一个快速普及技术的领域,以此为重点,可以让客户迅速受益于赛灵思技术为各种应用所带来的数量级提升的性能和单位功耗性能优势,其中

2018-03-23 14:31:40

层迭代的结果进行标准化处理。7、多次迭代以结束对所有K层采样深度的处理。8、将最终的迭代结果zv嵌入到输入节点xv。GNN加速器设计所面临的挑战GNN算法涉及大量的矩阵计算和存储访问操作。在传统

2021-09-25 17:20:41

无论从微观到宏观、从延长电池寿命到减少全球变暖的温室效应等等,各种不同因素都在迅速推动系统设计人员关注节能问题。一项有关设计优先考虑事项的最新调查指出,大部分工程师已把功耗排在首位,或者是将其紧跟在性能、密度和成本之后。在功耗方面,FPGA带来了独特的挑战。为什么要设计优化FPGA功耗?

2019-08-08 07:39:45

,要尽可能快地返回搜索结果,就需要尽可能降低每一步的延迟。 如果使用 GPU 来加速,要想充分利用 GPU 的计算能力,batch size 就不能太小,延迟将高达毫秒量级。 使用 FPGA 来加速的话

2020-09-17 11:03:37

X1系列GPU芯片基准对比结果。数据显示,FPGA方案在单位功耗图像捕获速度方面优于GPU方案6倍,在计算机视觉处理帧速率方面优于GPU方案42倍,同时,FPGA时延为GPU时延1/5。•赛灵思

2021-07-04 08:30:00

X1系列GPU芯片基准对比结果。数据显示,FPGA方案在单位功耗图像捕获速度方面优于GPU方案6倍,在计算机视觉处理帧速率方面优于GPU方案42倍,同时,FPGA时延为GPU时延1/5。•赛灵思

2021-07-04 08:30:00

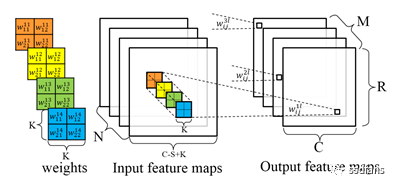

(FPGA)来构建硬件加速电路,来提升计算CNN的性能。

其中 ASIC 具备高性能、低功耗等特点,但 ASIC 的设计周期长,制造成本高,而 GPU 的并行度高,计算速度快,具有深度流水线结构,非常

2023-06-20 19:45:12

性能、更低时延和更快加速性能,在大数据和云计算领域将替代CPU+GPU,而Intel 的至强处理器+FPGA也将在2017 年量产。不难发现,本土FPGA厂商要先固本,然后求发展。通过产业化的单点产品

2017-01-12 18:54:15

DDR SDRAM。一般来说,FPGA实现中使用的外部存储器比GPU中使用的内存的访问速率要慢。甚至英特尔和赛灵思也承认,FPGA在所有性能指标上都不比GPU好。但是英特尔也指出,与GPU相比,FPGA

2023-02-08 15:26:46

能力的需求。因此,具有GPU、ASIC、 FPGA 或其它加速器(Accelerator)等高并行、高密集的计算能力的异构计算持续火热,而异构计算也将成为支撑先进和以后更复杂AI 应用的必然的选择

2019-08-07 08:39:19

,但也不会出现极度差异化的情况。其次CPU与GPU的关系将更加紧密,比如缓存一致和封装集成等,其他加速器在特定场景下声称的性能数据都很优秀,但要说通用计算性能,GPU还是要略胜一筹。而且依目前的趋势来看

2021-12-26 08:00:00

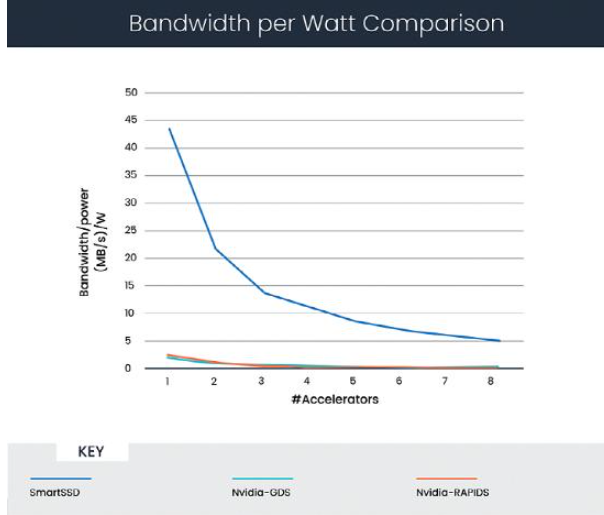

的功耗仅为30-45W。因此,从能效比来看,浪潮FPGA加速解决方案在图片识别分类应用上,相比GPU能效比能提升7倍以上!同样,与通用CPU对比,在处理这种高并行、小计算量的任务时,FPGA的优势将更明显

2021-09-17 17:08:32

影响存储器访问性能的因素有哪些?DSP核访问内部存储器和外部DDR存储器的时延有什么不同?

2021-04-19 08:32:10

基本概念和优缺点。在人工智能不断发展的今天,成本,功耗,灵活性,易用性都被提上了需求单。如果你也想体验一下异构计算的高效,可以试着购买一下阿里云的CPU+GPU和CPU+FPGA的实例方案。另外附上一些相关文章,让大神们继续带你飞。原文链接

2018-06-28 15:55:53

,GPU和GDDR之间的数据交换非常频繁。而DDR内存专注于与CPU进行数据交换的效率,因此对于整体存取性能、低延迟更为看重,所以在CPU和传统的FPGA中基本都是用DDR4。随着硬件加速需求对于

2021-12-21 08:00:00

最先进的人工智能模型在不到五年的时间内经历了超过 5,000 倍的规模扩展。这些 AI 模型严重依赖复杂的计算和大量内存来实现高性能深度神经网络 (DNN)。只有使用 CPU、GPU 或专用芯片等

2023-07-28 10:10:17

的嵌入(embedding)4. GNN加速器设计挑战GNN的算法中涉及到大量的矩阵计算和内存访问操作,在传统的x86架构的服务器上运行此算法是非常低效的,表现在速度慢,能耗高等方面。新型GPU

2020-10-20 09:48:39

的功耗取决于FPGA芯片及硬件设计本身,很难有较大的改善。可以优化是第3部分功耗:设计动态功耗,而且这部分功耗占总功耗的90%左右,因此所以降低设计动态功耗是降低整个系统功耗的关键因素。上面也提到过功耗

2014-08-21 15:31:23

嗨,我将从一个新项目开始。它涉及使用FPGA和GP / GPU加速PCIe板,这些板将被添加到常规计算机或服务器中。 GPU将是NVIDIA特斯拉。 FPGA板......还有待选择。我确实看到了

2019-01-24 10:55:48

经典蓝牙与低功耗蓝牙芯片功能性能对比

2020-12-28 07:55:50

随着工艺技术的越来越前沿化, FPGA器件拥有更多的逻辑、存储器和特殊功能,如存储器接口、 DSP块和多种高速SERDES信道,这些发展不断地对系统功率要求提出挑战。

功率计算的关键是两方面:静态

2024-07-31 22:37:59

也因而开始转向采用加速器来满足低时延、高吞吐量的需求,同时保持合理的功耗水平。 赛灵思FPGA所提供的功耗效率让加速器能部署于整个数据中心,而且可将单位功耗性能比提升10-20倍。百度优化的FPGA

2016-12-15 17:15:52

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-03-04 11:13:54

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-03-11 11:07:39

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-03-18 11:16:02

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-03-25 11:34:03

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-04-01 10:53:42

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-04-11 14:45:24

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-04-18 14:12:57

的高性能FPGA计算加速卡。作为基于服务器的PCI Express数据采集、处理、存储设备,该板卡可以实现2通道万兆光纤网络数据的高速采集、实时处理、实时记录和宽带回放,强大的FPGA处理性能,可以实现

2016-04-27 11:51:14

数据中心运维人员总是不断在寻求更高的服务器性能。目前,他们主要是通过易于编程的多核CPU 和GPU 来开发应用,但CPU 和GPU 都遇到了单位功耗性能的瓶颈壁垒。

2014-11-26 13:51:55 1660

1660

板为基于FPGA的、符合PCIe外形规范的扩展卡设计提供了最高的存储器带宽,而存储带宽往往是高性能计算系统的瓶颈。”

2016-06-27 17:47:52 3556

3556 基于FPGA的通用CNN加速设计,可以大大缩短FPGA开发周期,支持业务深度学习算法快速迭代;提供与GPU相媲美的计算性能,但拥有相较于GPU数量级的延时优势,为业务构建最强劲的实时AI服务能力

2017-11-15 11:44:52 8967

8967

加速的医学图像配准技术在国内外发展现状进行深入研究,并针对正电子发射型计算机断层显像( PET)和电子计算机断层扫描(CT)数据的非线性配准问题,分别基于中央处理器(GPU)和GPU平台进行配准实验,通过实验结果的对比,体现GPU加速配准技

2018-01-03 11:08:49 1

1 高性能硬件加速的资产模拟与FPGA

2018-01-30 16:14:29 15

15 目前处于AI大爆发时期,异构计算的选择主要在FPGA和GPU之间。尽管目前异构计算使用最多的是利用GPU来加速,FPGA作为一种高性能、低功耗的可编程芯片,在处理海量数据时,FPGA计算效率更高,优势更为突出,尤其在大量服务器部署时,隐形的运营成本会得到显著降低。

2018-04-25 09:17:27 11464

11464 硬件编程,可将性能提升至通用CPU服务器的30倍以上。同时,与已经深入人心的高性能计算的代表GPU相比,FPGA具有硬件可编程、低功耗、低延时的特性,代表了高性能计算的未来发展趋势。 而在人工智能(AI)里面火热的深度学习领域,企业同样可以将FPGA用于深度学习的

2018-05-29 13:44:24 5789

5789

将存储器带宽提升了20倍,而相比竞争性存储器技术,则将单位比特功耗降低4倍。这些新型器件专为满足诸如机器学习、以太网互联、8K视频和雷达等计算密集型应用所需的更高存储器带宽而打造,同时还提供CCIX IP,支持任何CCIX处理器的缓存一致性加速,满足计算加速应用要求。

2018-07-31 09:00:00 3068

3068 工智能 (AI) 加速。SKT 的自动语音识别 (ASR)系统采用赛灵思Kintex UltraScale FPGA为其声控助手 NUGU 加速。与使用 GPU 相比,SKT 的自动语音识别应用性能提高了 5 倍,单位功耗性能也提高了 16 倍。

2018-08-18 10:04:00 5291

5291 赛灵思公司(Xilinx)推出针对 OpenCL、C 和 C++的S DAccel 开发环境,将单位功耗性能提高达25倍,从而利用 FPGA 实现数据中心应用加速。SDAccel 是赛灵思 SDx

2018-08-30 17:00:00 1497

1497 在本演示中,Eideticom描述了NoLoad™,这是一款面向Xilinx FPGA的存储和计算加速平台。

2018-11-26 06:26:00 3699

3699 3月19日,全球第一大FPGA厂商赛灵思公司新任总裁兼CEOVictorPeng表示,要进一步推动计算加速、计算存储及网络加速领域的创新与部署,让客户在人工智能(AI)推断、视频与图像处理、基因组学等领域受益于芯片性能和单位功耗性能的提升。

2018-11-23 17:30:23 1375

1375 现在随着GPU通用计算能力增强,一些计算任务已经可以交由GPU去处理了。除了GPU外,现在还有一类芯片也在承担着高性能计算的任务,就是FPGA(可编程逻辑门电路)。英特尔现在就推出了全新的高端FPGA加速卡D5005,以加速一些特定应用。

2019-08-06 17:53:10 1871

1871 现在随着GPU通用计算能力增强,一些计算任务已经可以交由GPU去处理了。除了GPU外,现在还有一类芯片也在承担着高性能计算的任务,就是FPGA(可编程逻辑门电路)。

2019-08-07 17:48:37 875

875 作为GPU在算法加速上强有力的竞争者,FPGA是否立即支持不同硬件,显得尤为重要。FPGA与GPU不同之处在于硬件配置灵活,且FPGA在运行深入学习中关键的子程序(例如对滑动窗口的计算)时,单位能耗下通常能比GPU提供更好的表现。

2019-10-18 15:42:04 994

994 目前,在AI计算平台使用最广泛的两种加速部件是GPU和FPGA。GPU可适用于具备计算密集、高并行、SIMD(SingleInstructionMultipleData,单指令多数据流)应用等特点

2019-11-01 15:07:07 3256

3256 GPU是我们常用器件,采用GPU,才使得图形显示成为可能。在上期文章中,小编对GPU的加速原理等知识有所阐述。为增进大家对GPU的认识,本文将基于两点介绍GPU:1.选择GPU服务器需要考虑哪些情况,2.如何提升GPU存储性能。如果你对GPU具有兴趣,不妨继续往下阅读哦。

2021-02-08 17:37:00 3966

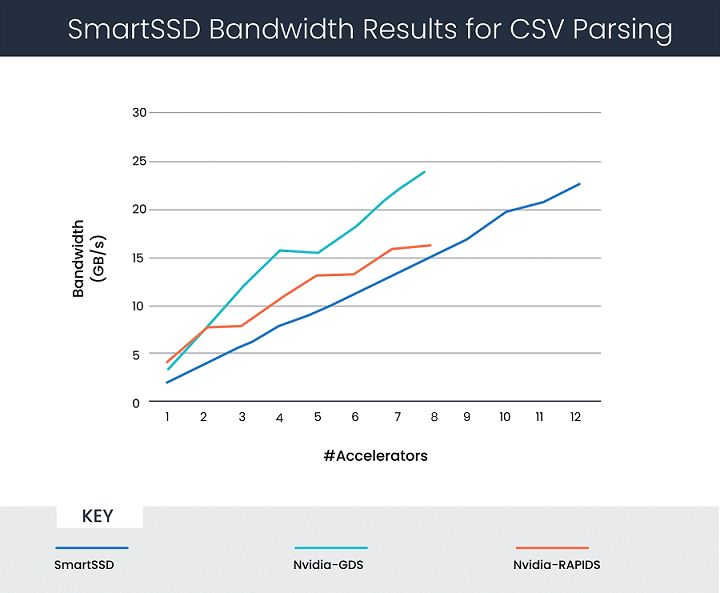

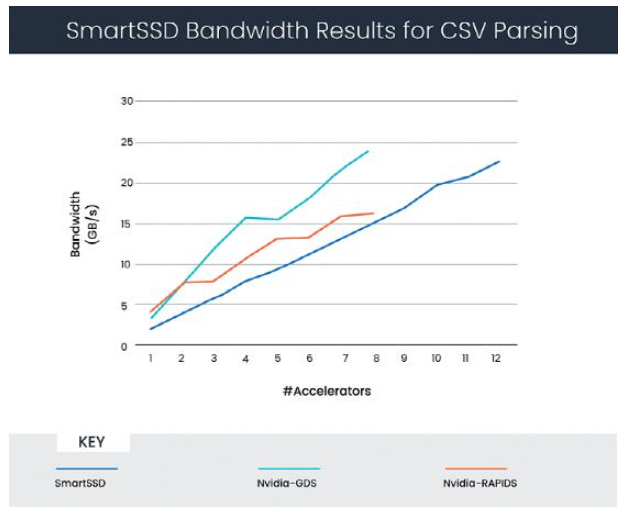

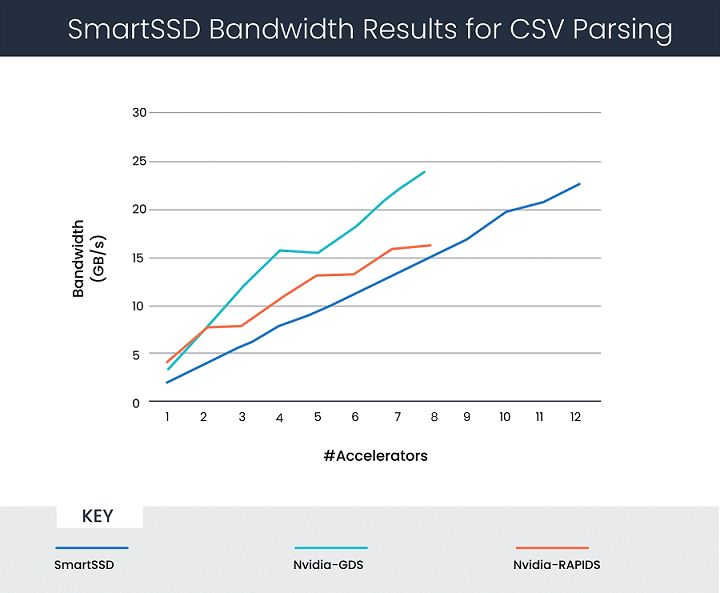

3966 为了提升计算基础设施的性能,并紧跟数据分析与 AI 不断攀升的需求,众多企业将硬件加速视为主要的解决方案。在大多数情况下,先进的可编程硬件(主要是指 GPU 和 FPGA)是加速的主要方式。通过

2021-08-09 11:00:09 6953

6953 为了提升计算基础设施的性能,并紧跟数据分析与 AI 不断攀升的需求,众多企业将硬件加速视为主要的解决方案。在大多数情况下,先进的可编程硬件(主要是指 GPU 和 FPGA)是加速的主要方式。通过

2021-08-13 17:45:31 8145

8145 NVIDIA 与智东西公开课共同策划推出「GPU 加速高性能计算(HPC)经典应用在线研讨会」。研讨会将聚焦经典高性能计算和科学计算应用,以及如何在 GPU 平台更好的加速这些应用。

2022-05-27 09:53:19 2339

2339 NVIDIA 与智东西公开课共同策划推出「GPU 加速高性能计算(HPC)经典应用在线研讨会」。研讨会将聚焦经典高性能计算和科学计算应用,以及如何在 GPU 平台更好的加速这些应用。

2022-06-22 10:06:32 2340

2340 为了提升计算基础设施的性能,并紧跟数据分析与 AI 不断攀升的需求,众多企业将硬件加速视为主要的解决方案。在大多数情况下,先进的可编程硬件(主要是指 GPU 和 FPGA)是加速的主要方式。通过使用这种先进的硬件,企业正在赢得计算优势;然而,对于编程难度,他们仍然存在合理的担忧。

2022-08-02 08:03:36 2798

2798

这本书研究了加速EDA算法的硬件平台,如ASIC,FPGA和GPU。覆盖范围包括讨论在何种条件下使用一个平台优于另一个平台,例如,当EDA问题具有高度的数据并行性时,GPU通常是首选平台,而当问题具有更多的控制因素时,FPGA可能是首选的。

2022-09-02 11:51:15 1080

1080 计算性能相对GPU:FPGA进行整数乘法、浮点乘法运算,性能相对GPU存在数量级差距,可通过配置乘法器、浮点运算部件接近GPU计算性能。

2022-11-08 09:23:13 1045

1045 新技术星期二:加速 FPGA 计算的 2 张卡

2022-12-30 09:40:20 1340

1340 因为CNN的特有计算模式,通用处理器对于CNN实现效率并不高,不能满足性能要求。 因此,近来已经提出了基于FPGA,GPU甚至ASIC设计的各种加速器来提高CNN设计的性能。

2023-06-14 16:03:43 3135

3135

GPU和FPGA都是现代计算机技术中的高性能计算设备,具有不同的特点和应用场景。本文将详细介绍GPU和FPGA的工作原理及其区别。

2023-08-06 16:50:49 3371

3371 电子发烧友网站提供《加速大数据和计算存储应用.pdf》资料免费下载

2023-09-15 15:05:35 0

0 电子发烧友网站提供《动力总成HIL测试的主要考量因素.pdf》资料免费下载

2023-09-18 10:29:01 1

1 选购边缘计算网关时需要注意的几个关键方面: 1. 性能与处理能力 首先,边缘计算网关的性能和处理能力是核心考量因素。这包括CPU的处理速度、内存大小、存储容量以及是否支持高性能的GPU或FPGA等加速单元。根据应用场景的不同

2024-09-30 14:39:46 957

957

GPU加速计算平台,简而言之,是利用图形处理器(GPU)的强大并行计算能力来加速科学计算、数据分析、机器学习等复杂计算任务的软硬件结合系统。

2024-10-25 09:23:17 1075

1075 它们在不同应用场景下的表现。 一、设计初衷与优化方向 NPU : 专为加速AI任务而设计,包括深度学习和推理。 针对神经网络的计算模式进行了优化,能够高效地执行矩阵乘法、卷积等操作。 拥有众多小型处理单元,配备专门的内存体系结构和数据流优化策略,对深度学习任务的处理特别高效。 GPU : 最初设

2024-11-14 15:19:51 6631

6631 运行。 一、性能与处理能力 边缘计算网关的性能和处理能力是核心考量因素。这包括CPU的处理速度、内存大小、存储容量以及是否支持高性能的GPU或FPGA等加速单元。 1、CPU与内存 CPU型号、主频、核心数以及内存大小是衡量其计算能力

2025-01-07 16:19:56 706

706

传统的CPU虽然在日常计算任务中表现出色,但在面对大规模并行计算需求时,其性能往往捉襟见肘。而GPU加速计算平台凭借其独特的优势,吸引了行业内人士的广泛关注和应用。下面,AI部落小编为大家分享GPU加速计算平台的优势。

2025-02-23 16:16:24 835

835 (Nvidia Jetson Orin与AMD Versal)上最佳GPU加速方案(FAST、Harris、SuperPoint)与对应FPGA加速方案的性能,得出全新结论。

2025-10-31 09:30:43 408

408

电子发烧友App

电子发烧友App

评论