在加拿大作家玛格丽特•阿特伍德的著作《盲人杀手》中有这样一段描述:“触觉,先于视觉也先于语言,既是第一语言也是最后的语言,并总是诉说真相。”

被编写为视觉或者触觉的机器人一般不能实现此两种感官信息的交互。为打破这种隔绝,来自MIT(麻省理工学院)CSAIL(计算机科学与人工智能实验室)的研究团队提出了一种可预测AI,它可以通过触觉信息的训练学习到视觉特征,反之亦然,也能通过视觉信息的训练学习到物体的触觉特征。

该团队所提出的模型可以从视觉信号中“创造”出逼真的触觉信号,并直接利用触觉信息预测所检测目标及触摸部位。他们使用的库卡机械臂上装有一个特殊的触觉传感器GelSight,这是由MIT的另一研究团队设计的。

该团队利用一个简单的网络摄像头采集了近200种物体图像,包括工具、家庭用品、纺织物等,这些物体被“触摸”超过12000次。通过将这12000个小视频分解为静态帧从而生成了名为“VisGel”的数据集,该数据集包含300多万个视觉-触觉对应的图像。

CSALL博士生Yunzhu Li在其一篇相关论文中谈到:“通过观察触摸情景,我们的模型可以“想象”出触摸平坦表面或者尖锐边缘的感觉”,“当机器人只有触觉感官的时候,此模型可以仅凭触觉信号来完成和周围环境的交互。将触觉和视觉这两种感官结合在一起无疑是锦上添花。它还可能减少机器人为完成抓取任务所需的数据集”。

目前使能机器人具备更多感官能力的研究,比如MIT在2016年的项目:利用深度学习实现声音可视化、预测物体对外力反应,都使用了大量的训练数据,但不能实现视觉和触觉的交互。该团队使用VisGel数据集和生成式对抗网络(GANs)实现上述功能。

此GANs算法利用视觉或触觉的图像生成其他形式的图像。其原理简而言之,就是GANs利用生成器(generator)捏造假的图像试图骗过判别器(discriminator),判别器将辨别结果反馈给生成器以调参,以使得生成器生成更高质量的预期图像,如此相得益彰。

所见即所触

人可以通过观察物体来判断其手感,欲将这种能力赋予机器人,首先要标定目标位置,其次要推断目标区域的形状和手感。

为此,需要一张参考图像,它记录了机器人没有与外界交互时的所处的环境信息。模型在识别过程中会对比当前捕捉到的帧图像和参考图像以轻松判断所触物体的位置和大小。

好比给模型“看”了一张鼠标的图像,模型将预测可能触碰到鼠标的区域,并告诉机器人从而使其实现安全高效的抓取任务。

所触即所见

利用触觉数据产生视觉图像即所谓“所触即所见”。模型通过观察触觉图像推断所接触位置的物体形状和材质,并和参考图像对比进而“想象”出交互过程。

举个例子,将一只鞋的触觉数据传给模型,其输出将是一张图像,这张图像则显示了最有可能触摸到这只鞋的区域位置。

当灯被关掉,或者盲人进入未知区域的时候,这种技能就可以发挥其作用了。

展望

目前的训练数据只能实现特定环境下的交互。该团队希望收集更复杂环境下的训练数据以提升模型的泛化性能。MIT的新设计——tactile glove或许可以帮助他们获取更多更密集的训练数据。

翘首以盼,此类模型将协助机器人和其视觉紧密合作以实现无缝的人机交互。这些合作包括对象识别、抓取、场景理解等。

加州大学伯克利分校的博士后Andrew Owens说:“这是首次提出的视觉和触觉信号可靠的转换方法,此类方法于机器人而言将大有裨益,彼时,它们就可以回答诸如‘这东西的硬度如何?’,‘如果我用手柄握住马克杯,我会握得多好?’的问题,这是一个十分有挑战性的项目,因为问题的信号是如此的不同,其优越性也可见一斑”。

李和MIT的教授Russ Tedrake 、 Antonio Torralba,博士后Jun-Yan Zhu共同完成这篇论文。它将于下周在加利福尼亚长沙滩上举办的计算机视觉及模式识别大会上发布。

-

人工智能

+关注

关注

1820文章

50324浏览量

266929 -

MIT

+关注

关注

3文章

254浏览量

25032

原文标题:所见即所触,教AI实现触觉和视觉的信息交互

文章出处:【微信号:BigDataDigest,微信公众号:大数据文摘】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

海光信息深度参与人工智能赋能新型工业化深度行活动

人工智能多模态与视觉大模型开发实战 - 2026必会

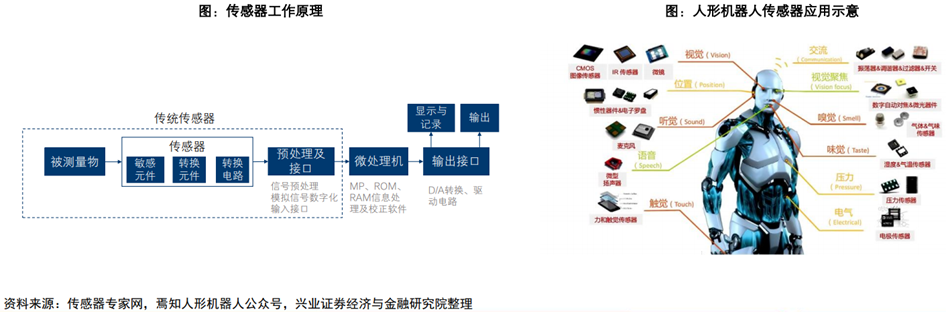

人形机器人传感器产业链最新分析:力、触觉、IMU、视觉传感器为主流!(全面)

利用超微型 Neuton ML 模型解锁 SoC 边缘人工智能

挖到宝了!人工智能综合实验箱,高校新工科的宝藏神器

挖到宝了!比邻星人工智能综合实验箱,高校新工科的宝藏神器!

关于人工智能处理器的11个误解

人工智能实现触觉和视觉的信息交互

人工智能实现触觉和视觉的信息交互

评论