TCP/BDP问题:网络延迟的隐形杀手

背景与概述

在运维工作中,我们经常遇到这样的问题:服务器配置很高、网络带宽也很充裕,但应用响应就是很慢。数据库查询、文件传输、API调用,各种操作都像是被什么东西拖住了。经过反复排查,CPU、内存、磁盘IO都没有问题,最后发现罪魁祸首竟然是网络延迟——具体来说,是TCP的BDP(Bandwidth-Delay Product,带宽延迟积)问题。

BDP是网络性能领域最重要的概念之一,它决定了在任意时刻,网络上"飞行中"(在传输途中)的数据量。如果窗口大小配置不当,再高的带宽也无法发挥出来。我在生产环境中见过太多因为不了解BDP而导致的性能问题:跨国专线带宽利用率只有10%、数据中心内部传输反而比跨洋还慢、5G网络下应用响应比4G还差。

本文将系统性地解析TCP BDP的原理,剖析它如何成为网络延迟的"隐形杀手",并提供详细的诊断方法和优化方案。通过大量实战案例和脚本,帮助读者在生产环境中识别和解决BDP相关的性能问题。

前置知识要求:

熟悉Linux基础命令操作

理解TCP/IP协议基础

具备网络故障排查经验

了解套接字编程基础概念

实验环境说明:

操作系统:Rocky Linux 9 / Ubuntu 24.04 LTS

内核版本:5.15+(支持BBR)

测试工具:iperf3, netperf, ping, traceroute, ss

网络环境:可模拟不同延迟和带宽的环境

1. TCP窗口与BDP基础概念

1.1 什么是带宽延迟积(BDP)

BDP(Bandwidth-Delay Product)是网络性能的核心指标,计算公式为:

BDP = 带宽 × 往返延迟(RTT)

BDP的物理含义:

BDP表示在任意时刻,网络上能够容纳的"飞行中"数据量

单位:比特(bits)或字节(bytes)

例如:1Gbps带宽,50ms RTT,BDP = 1Gbps × 50ms = 50Mb = 6.25MB

为什么BDP如此重要:

如果发送窗口小于BDP,带宽无法被充分利用

发送方在等待ACK时处于空闲状态

带宽被浪费,网络吞吐量远低于理论值

BDP计算实例:

# 示例1:本地数据中心 # 带宽:10Gbps = 10,000,000,000 bps # RTT:1ms = 0.001s # BDP = 10,000,000,000 × 0.001 = 10,000,000 bits = 10 Mb = 1.25 MB # 示例2:跨国专线 # 带宽:1Gbps = 1,000,000,000 bps # RTT:200ms = 0.2s # BDP = 1,000,000,000 × 0.2 = 200,000,000 bits = 200 Mb = 25 MB # 示例3:移动网络 # 带宽:100Mbps = 100,000,000 bps # RTT:50ms = 0.05s # BDP = 100,000,000 × 0.05 = 5,000,000 bits = 5 Mb = 625 KB

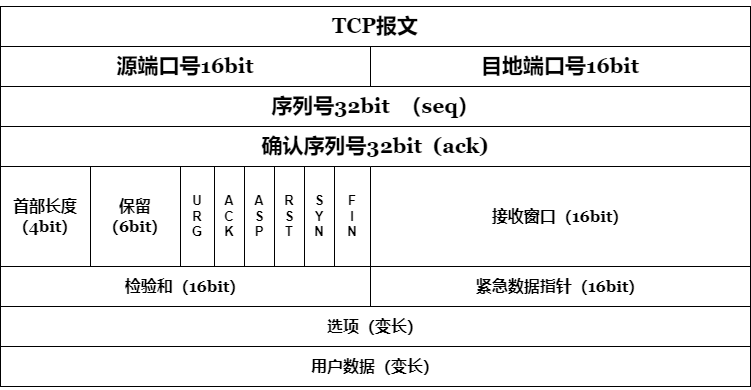

1.2 TCP窗口机制详解

发送窗口(Sender Window):

TCP使用滑动窗口机制控制发送数据量

窗口大小决定了未收到ACK时可以发送多少数据

窗口必须大于等于BDP才能充分利用带宽

接收窗口(Receiver Window):

接收方通告自己能接收的数据量(rwnd)

存在于TCP头部的Window字段

现代Linux默认配置已足够大

拥塞窗口(Congestion Window,cwnd):

发送方根据网络拥塞情况动态调整

慢启动、拥塞避免、快速恢复算法

cwnd和rwnd的最小值决定了实际窗口大小

TCP窗口工作流程:

发送方 接收方 | | |----- DATA (seq=1, len=1460) ---->| |----- DATA (seq=1461, len=1460) -->| |----- DATA (seq=2921, len=1460) -->| |<-------- ACK (ack=4381) ----------| 窗口大小=3个segment | | | 此时发送方可以继续发送3个segment | | |

1.3 窗口不足导致的性能问题

问题现象:

带宽很大但吞吐量很低

延迟越高性能越差

传输大量数据时速度上不去

根本原因:

TCP窗口小于BDP

发送方在等待ACK时网络空闲

带宽利用率 = 实际吞吐量 / 理论带宽

带宽利用率计算公式:

# 实际吞吐量 = 窗口大小 / RTT # 带宽利用率 = (窗口大小 / RTT) / 带宽 # 示例:窗口=64KB, RTT=50ms, 带宽=1Gbps # 实际吞吐量 = 64KB / 50ms = 64KB / 0.05s = 1280KB/s = 1.28MB/s # 带宽利用率 = 1.28MB/s / 125MB/s = 1.024% # 即使带宽是1Gbps,实际只能用到约10Mbps!

1.4 TCP窗口配置

Linux TCP窗口相关参数:

# 查看当前TCP窗口配置 sysctl net.ipv4.tcp_rmem # 接收窗口 sysctl net.ipv4.tcp_wmem # 发送窗口 sysctl net.core.rmem_max # 接收缓冲区最大值 sysctl net.core.wmem_max # 发送缓冲区最大值 sysctl net.core.rmem_default # 默认接收缓冲区 sysctl net.core.wmem_default # 默认发送缓冲区 # 查看当前连接的实际窗口大小 ss -i netstat -tn

参数说明:

# tcp_rmem:接收缓冲区(min, default, max) # tcp_wmem:发送缓冲区(min, default, max) # rmem_max/wmem_max:允许应用设置的最大值

2. BDP问题诊断

2.1 基础网络诊断

诊断脚本:基础网络状态检查

#!/bin/bash

# 文件名:network_diagnosis.sh

# 功能:基础网络诊断,检查延迟和带宽

TARGET_HOST=${1:-8.8.8.8}

TARGET_PORT=${2:-80}

echo"=========================================="

echo"网络基础诊断 -$(date '+%Y-%m-%d %H:%M:%S')"

echo"目标:$TARGET_HOST"

echo"=========================================="

# 1. 基础连通性

echo""

echo"【1】连通性检查"

echo"----------------------------------------"

ping -c 5$TARGET_HOST2>/dev/null

if[ $? -ne 0 ];then

echo"[警告] 无法ping通目标主机"

fi

# 2. 路由追踪

echo""

echo"【2】路由追踪(延迟分布)"

echo"----------------------------------------"

traceroute -m 15$TARGET_HOST2>/dev/null ||

tracepath -m 15$TARGET_HOST2>/dev/null ||

echo"traceroute不可用,跳过"

# 3. RTT测量

echo""

echo"【3】RTT统计"

echo"----------------------------------------"

PING_OUTPUT=$(ping -c 20$TARGET_HOST2>/dev/null)

AVG_RTT=$(echo"$PING_OUTPUT"| grep"rtt"| awk -F'/''{print $5}')

MIN_RTT=$(echo"$PING_OUTPUT"| grep"rtt"| awk -F'/''{print $4}')

MAX_RTT=$(echo"$PING_OUTPUT"| grep"rtt"| awk -F'/''{print $6}')

JITTER=$(echo"$PING_OUTPUT"| grep"rtt"| awk -F'/''{print $6}'| awk -F' ''{print $1}')

echo"平均延迟:${AVG_RTT}ms"

echo"最小延迟:${MIN_RTT}ms"

echo"最大延迟:${MAX_RTT}ms"

echo"延迟抖动:${JITTER}ms"

# 4. 端口检查

echo""

echo"【4】端口可达性"

echo"----------------------------------------"

nc -zv -w 5$TARGET_HOST$TARGET_PORT2>&1

# 5. 带宽评估(使用iperf3如果有)

echo""

echo"【5】带宽评估"

echo"----------------------------------------"

ifcommand-v iperf3 &> /dev/null;then

echo"iperf3可用,可使用以下命令进行带宽测试:"

echo" 服务端: iperf3 -s"

echo" 客户端: iperf3 -c$TARGET_HOST-t 10"

else

echo"iperf3未安装,跳过带宽测试"

fi

2.2 BDP计算分析

诊断脚本:BDP计算与分析

#!/bin/bash

# 文件名:bdp_calculator.sh

# 功能:计算和分析BDP

BANDWIDTH=${1:-1000}# Mbps

RTT=${2:-50}# ms

echo"=========================================="

echo"BDP计算器"

echo"=========================================="

# 转换为标准单位

BANDWIDTH_BPS=$(echo"scale=2;$BANDWIDTH* 1000000"| bc) # bits per second

RTT_SEC=$(echo"scale=6;$RTT/ 1000"| bc) # seconds

# 计算BDP

BDP_BITS=$(echo"scale=2;$BANDWIDTH_BPS*$RTT_SEC"| bc)

BDP_BYTES=$(echo"scale=2;$BDP_BITS/ 8"| bc)

BDP_KB=$(echo"scale=2;$BDP_BYTES/ 1024"| bc)

BDP_MB=$(echo"scale=2;$BDP_KB/ 1024"| bc)

echo""

echo"输入参数:"

echo" 带宽:$BANDWIDTHMbps"

echo" RTT:$RTTms"

echo""

echo"BDP计算结果:"

echo" BDP =$BANDWIDTHMbps ×$RTTms"

echo" BDP =$BANDWIDTH_BITSbits ×$RTT_SECseconds"

echo" BDP =$BDP_BITSbits"

echo" BDP =$BDP_BYTESbytes"

echo" BDP =$BDP_KBKB"

echo" BDP =$BDP_MBMB"

echo""

# 计算建议的TCP窗口大小

echo"推荐TCP窗口大小:"

echo" 最小窗口:$BDP_KBKB (实际需要的最小窗口)"

echo" 推荐窗口:$(echo "scale=2; $BDP_KB * 2" | bc)KB (2倍BDP,留有余量)"

echo""

# 当前系统窗口检查

echo"当前系统TCP窗口配置:"

echo"----------------------------------------"

sysctl net.ipv4.tcp_rmem 2>/dev/null | awk'{print " 接收窗口: "$0}'

sysctl net.ipv4.tcp_wmem 2>/dev/null | awk'{print " 发送窗口: "$0}'

sysctl net.core.rmem_max 2>/dev/null | awk'{print " 最大接收缓冲: "$0}'

sysctl net.core.wmem_max 2>/dev/null | awk'{print " 最大发送缓冲: "$0}'

# 判断是否需要调整

MIN_WINDOW_KB=64 # 常见最小窗口

if[ $(echo"$BDP_KB>$MIN_WINDOW_KB"| bc) -eq 1 ];then

echo""

echo"[注意] BDP ($BDP_KBKB) 大于默认窗口 ($MIN_WINDOW_KBKB)"

echo" 建议增大TCP窗口配置以充分利用带宽"

fi

2.3 TCP连接诊断

诊断脚本:TCP连接窗口分析

#!/bin/bash # 文件名:tcp_connection_analysis.sh # 功能:分析当前TCP连接的窗口使用情况 echo"==========================================" echo"TCP连接窗口分析" echo"==========================================" # 1. 查看所有TCP连接的窗口状态 echo"" echo"【1】所有TCP连接概览" echo"----------------------------------------" ss -tan state established | head -20 # 2. 查看详细窗口信息 echo"" echo"【2】高延迟连接(可能存在BDP问题)" echo"----------------------------------------" ss -ti state established | grep -E"rtt:|bytes_acked|bytes_received"| head -20 # 3. 查看监听队列溢出 echo"" echo"【3】半连接队列和全连接队列状态" echo"----------------------------------------" ss -ln | grep -E"LISTEN" ss -ln | awk'{print $1, $2, $5}'|whilereadproto queues addr;do if["$queues"="LISTEN"];then echo" $addr: 监听中" fi done # 4. 查看网络接口统计 echo"" echo"【4】网络接口统计" echo"----------------------------------------" ip -s link show | grep -E"RX|TX|errors|collisions" # 5. 查看TCP重传统计 echo"" echo"【5】TCP重传和错误统计" echo"----------------------------------------" netstat -s | grep -E"segments retransmitted|TCPLostRetransmit|fast retransmits|timeout" # 6. 查看当前连接按延迟排序 echo"" echo"【6】高延迟TCP连接" echo"----------------------------------------" ss -ti state established | sort -k 5 -t':'| tail -10

2.4 网络性能测试

诊断脚本:网络性能基准测试

#!/bin/bash

# 文件名:network_performance_test.sh

# 功能:进行网络性能测试,评估BDP问题

SERVER_IP=${1:-""}

TEST_DURATION=${2:-10}# 秒

BUFFER_SIZES=(64 128 256 512 1024 2048 4098 8192 16384 32768 65536)

echo"=========================================="

echo"网络性能测试"

echo"=========================================="

# 检查iperf3是否可用

if!command-v iperf3 &> /dev/null;then

echo"[错误] iperf3未安装"

echo"安装方法: yum install iperf3 或 apt install iperf3"

exit1

fi

if[ -z"$SERVER_IP"];then

echo"用法:$0<服务器IP> [测试时长秒]"

echo""

echo"注意: 需要在服务器端先运行: iperf3 -s"

exit1

fi

# 测试不同窗口大小下的吞吐量

echo""

echo"【1】不同窗口大小的吞吐量测试"

echo"----------------------------------------"

forBUFin"${BUFFER_SIZES[@]}";do

echo-n"窗口${BUF}KB: "

# 使用iwconfig测试(如果可用)

# 或使用sockperf

# 这里用iperf3测试

RESULT=$(iperf3 -c$SERVER_IP-t$TEST_DURATION-R -l${BUF}K 2>/dev/null | grep"receiver"| awk'{print $6, $7}')

if[ -n"$RESULT"];then

echo"$RESULT"

else

echo"测试失败"

fi

done

# TCP窗口扫描测试

echo""

echo"【2】TCP窗口扫描(检测BDP限制)"

echo"----------------------------------------"

# 测试不同并行连接数

forCONNSin1 5 10 20 50 100;do

echo-n"并行连接数$CONNS: "

RESULT=$(iperf3 -c$SERVER_IP-t$TEST_DURATION-P$CONNS2>/dev/null | grep"SUM"| grep"receiver"| awk'{print $6, $7}')

if[ -n"$RESULT"];then

echo"$RESULT"

else

echo"测试失败"

fi

done

# 延迟敏感性测试

echo""

echo"【3】延迟敏感性测试"

echo"----------------------------------------"

# 测试单线程大文件传输

echo"单线程大文件传输速率(检测窗口限制):"

iperf3 -c$SERVER_IP-t$TEST_DURATION-R 2>/dev/null | grep"receiver"

# 测试多线程文件传输

echo""

echo"多线程传输速率(可绕过单连接窗口限制):"

iperf3 -c$SERVER_IP-t$TEST_DURATION-P 10 -R 2>/dev/null | grep"SUM"

3. TCP窗口优化

3.1 系统级窗口配置

Linux内核TCP窗口参数详解:

# tcp_rmem:接收缓冲区大小(min, default, max) # 推荐配置(高延迟大带宽环境) sysctl -w net.ipv4.tcp_rmem="4096 131072 6291456" # 4KB, 128KB, 6MB # 解释: # min: 4KB,最小缓冲区 # default: 128KB,默认缓冲区 # max: 6MB,最大缓冲区 # tcp_wmem:发送缓冲区大小(min, default, max) # 推荐配置(高延迟大带宽环境) sysctl -w net.ipv4.tcp_wmem="4096 131072 4194304" # 4KB, 128KB, 4MB # 解释: # min: 4KB,最小缓冲区 # default: 128KB,默认缓冲区 # max: 4MB,最大缓冲区 # rmem_max和wmem_max:应用可设置的最大缓冲区 sysctl -w net.core.rmem_max=134217728 # 128MB sysctl -w net.core.wmem_max=134217728 # 128MB # TCP窗口缩放(RFC 1323) # 允许窗口大小超过65535字节 sysctl -w net.ipv4.tcp_window_scaling=1 # 时间戳(用于更精确的RTT测量) sysctl -w net.ipv4.tcp_timestamps=1 # 选择性确认(SACK) sysctl -w net.ipv4.tcp_sack=1

持久化配置:

# 将配置添加到 /etc/sysctl.conf cat >> /etc/sysctl.conf << 'EOF' # TCP窗口优化配置 net.core.rmem_default=262144 net.core.rmem_max=134217728 net.core.wmem_default=262144 net.core.wmem_max=134217728 net.ipv4.tcp_rmem=4096 131072 6291456 net.ipv4.tcp_wmem=4096 131072 4194304 net.ipv4.tcp_window_scaling=1 net.ipv4.tcp_timestamps=1 net.ipv4.tcp_sack=1 # 网络优化 net.core.netdev_max_backlog=5000 net.core.somaxconn=1024 net.ipv4.tcp_max_syn_backlog=2048 # TCP连接优化 net.ipv4.tcp_fin_timeout=30 net.ipv4.tcp_keepalive_time=300 net.ipv4.tcp_keepalive_probes=5 net.ipv4.tcp_keepalive_intvl=15 EOF # 应用配置 sysctl -p

3.2 应用程序窗口配置

应用程序设置socket缓冲区的方法:

C语言示例:

#include#include #include intset_socket_buffer(intsockfd,intrcvbuf,intsndbuf){ interr; // 设置接收缓冲区 err = setsockopt(sockfd, SOL_SOCKET, SO_RCVBUF, &rcvbuf,sizeof(rcvbuf)); if(err < 0) { perror("setsockopt SO_RCVBUF"); return -1; } // 设置发送缓冲区 err = setsockopt(sockfd, SOL_SOCKET, SO_SNDBUF, &sndbuf, sizeof(sndbuf)); if (err < 0) { perror("setsockopt SO_SNDBUF"); return -1; } return 0; } int set_tcp_nodelay(int sockfd) { int flag = 1; // 禁用Nagle算法,减少延迟 return setsockopt(sockfd, IPPROTO_TCP, TCP_NODELAY, &flag, sizeof(flag)); } int set_tcp_quickack(int sockfd) { int flag = 1; // 快速ACK模式 return setsockopt(sockfd, IPPROTO_TCP, TCP_QUICKACK, &flag, sizeof(flag)); }

Java语言示例:

importjava.net.*;

publicclassSocketBufferConfig{

publicstaticvoidconfigureSocket(Socket socket,intbufferSize)throwsSocketException{

// 设置socket缓冲区大小

socket.setReceiveBufferSize(bufferSize);

socket.setSendBufferSize(bufferSize);

// 设置TCP参数

socket.setTcpNoDelay(true); // 禁用Nagle算法

socket.setKeepAlive(true);

}

publicstaticvoidconfigureServerSocket(ServerSocketChannel serverChannel,intbufferSize)throwsException{

// 配置服务端socket

serverChannel.socket().setReceiveBufferSize(bufferSize);

}

publicstaticvoidmain(String[] args)throwsException{

// 高延迟大带宽环境下推荐缓冲区大小

// BDP = 带宽(Mbps) × RTT(ms) / 8 = buffer size(bytes)

intbufferSize =1024*1024; // 1MB缓冲区

Socket socket =newSocket();

socket.connect(newInetSocketAddress("example.com",80));

configureSocket(socket, bufferSize);

}

}

Python语言示例:

importsocket

defconfigure_high_performance_socket(sock, buffer_size=1024*1024):

"""

配置高性能socket

适用于高延迟大带宽环境

"""

# 设置缓冲区大小

sock.setsockopt(socket.SOL_SOCKET, socket.SO_RCVBUF, buffer_size)

sock.setsockopt(socket.SOL_SOCKET, socket.SO_SNDBUF, buffer_size)

# 禁用Nagle算法(低延迟场景)

sock.setsockopt(socket.IPPROTO_TCP, socket.TCP_NODELAY,1)

# 保活

sock.setsockopt(socket.SOL_SOCKET, socket.SO_KEEPALIVE,1)

returnsock

# 使用示例

sock = socket.socket(socket.AF_INET, socket.SOCK_STREAM)

sock = configure_high_performance_socket(sock, buffer_size=1024*1024) # 1MB

sock.connect(('example.com',80))

3.3 TCP拥塞控制算法

Linux支持的拥塞控制算法:

# 查看支持的拥塞控制算法 sysctl net.ipv4.tcp_available_congestion_control # 输出示例: cubic reno hybla bbr # 查看当前使用的算法 sysctl net.ipv4.tcp_congestion_control

主要拥塞控制算法对比:

| 算法 | 适用场景 | 特点 |

|---|---|---|

| cubic | 通用,默认 | 稳定,适合大多数网络 |

| bbr | 高BDP、高带宽 | 谷歌开发,适合跨国专线 |

| hybla | 高延迟 | 专为卫星网络设计 |

| vegas | 低延迟 | 注重延迟控制 |

BBR算法配置:

# 启用BBR(需要内核5.15+) sysctl -w net.core.default_qdisc=fq sysctl -w net.ipv4.tcp_congestion_control=bbr # 验证BBR是否启用 sysctl net.ipv4.tcp_congestion_control # 应该输出: bbr sysctl net.core.default_qdisc # 应该输出: fq # BBR参数调优(可选) # bbr探测带宽 sysctl -w net.ipv4.tcp_bbr_bw_rtt_bit=15360 # 最小带宽(仅示例) # 持久化配置 cat >> /etc/sysctl.conf << 'EOF' net.core.default_qdisc=fq net.ipv4.tcp_congestion_control=bbr EOF

BBR vs CUBIC性能对比:

场景:1Gbps带宽,200ms RTT CUBIC算法: - 拥塞窗口增长较慢 - 达到满带宽需要较长时间 - 吞吐量 ≈ 600-800 Mbps BBR算法: - 不依赖丢包检测 - 更快速达到满带宽 - 吞吐量 ≈ 900-950 Mbps - 延迟更稳定

4. 高延迟环境优化

4.1 跨国专线优化

问题背景:

带宽:1Gbps

RTT:180-200ms

BDP:1Gbps × 200ms = 200Mb = 25MB

理论最大吞吐量:约1Gbps

优化前问题:

实际吞吐量:约100-200Mbps

带宽利用率:10-20%

文件传输速度:约12-25MB/s

优化方案:

# 跨国专线推荐配置 cat >> /etc/sysctl.conf << 'EOF' # 接收缓冲区(高延迟大带宽) net.ipv4.tcp_rmem=4096 262144 16777216 net.ipv4.tcp_wmem=4096 262144 16777216 # 缓冲区最大值 net.core.rmem_max=16777216 net.core.wmem_max=16777216 # TCP窗口缩放 net.ipv4.tcp_window_scaling=1 net.ipv4.tcp_timestamps=1 net.ipv4.tcp_sack=1 # BBR配置(如果内核支持) net.core.default_qdisc=fq net.ipv4.tcp_congestion_control=bbr # 网络队列优化 net.core.netdev_max_backlog=250000 net.core.somaxconn=65535 net.ipv4.tcp_max_syn_backlog=65535 # TCP时间参数优化 net.ipv4.tcp_slow_start_after_idle=0 net.ipv4.tcp_fin_timeout=15 net.ipv4.tcp_keepalive_time=60 EOF sysctl -p

验证优化效果:

#!/bin/bash

# 文件名:verify_international_link.sh

# 功能:验证跨国专线优化效果

SERVER_IP="对方服务器IP"

TEST_DURATION=30

echo"=========================================="

echo"跨国专线优化验证"

echo"=========================================="

# 1. 测试单连接吞吐量

echo""

echo"【1】单连接吞吐量测试"

echo"----------------------------------------"

echo"使用iperf3测试..."

iperf3 -c$SERVER_IP-t$TEST_DURATION-R | grep"receiver"

# 2. 测试多连接吞吐量

echo""

echo"【2】多连接吞吐量测试(10并发)"

echo"----------------------------------------"

iperf3 -c$SERVER_IP-t$TEST_DURATION-P 10 -R | grep"SUM"

# 3. 查看连接窗口

echo""

echo"【3】TCP连接状态"

echo"----------------------------------------"

ss -ti dst$SERVER_IP| head -5

# 4. 计算带宽利用率

echo""

echo"【4】带宽利用率计算"

echo"----------------------------------------"

# 假设理论带宽1Gbps

THEROY_BW=1000 # Mbps

ACTUAL_BW=$(iperf3 -c$SERVER_IP-t 10 -R 2>/dev/null | grep"receiver"| awk'{print $6}')

if[ -n"$ACTUAL_BW"];then

echo"理论带宽:${THEROY_BW}Mbps"

echo"实际带宽:$ACTUAL_BW"

# 提取数值计算

ACTUAL_NUM=$(echo$ACTUAL_BW| awk'{print $1}')

UTIL=$(echo"scale=2;$ACTUAL_NUM/$THEROY_BW* 100"| bc)

echo"带宽利用率:${UTIL}%"

fi

4.2 数据中心内部优化

问题背景:

带宽:10Gbps

RTT:0.5-1ms(内部网络)

BDP:10Gbps × 1ms = 10Mb = 1.25MB

延迟很低,但吞吐量要求很高

优化方案:

# 数据中心内部推荐配置(低延迟) cat >> /etc/sysctl.conf << 'EOF' # 低延迟配置 net.ipv4.tcp_rmem=4096 87380 6291456 net.ipv4.tcp_wmem=4096 65536 4194304 # 队列优化 net.core.netdev_max_backlog=100000 net.core.somaxconn=65535 net.ipv4.tcp_max_syn_backlog=65535 # 禁用slow start after idle(数据中心内常见) net.ipv4.tcp_slow_start_after_idle=0 # TCP连接复用 net.ipv4.tcp_tw_reuse=1 # 内核参数 net.ipv4.tcp_fin_timeout=15 # 中断合并优化 # 查看网卡驱动是否支持 adaptive-rx/tx ethtool -k eth0 | grep -E "adaptive|coalesce" EOF sysctl -p

网卡中断优化:

#!/bin/bash

# 文件名:nic_optimization.sh

# 功能:网卡中断和队列优化

NIC=${1:-eth0}

echo"=========================================="

echo"网卡优化 -$NIC"

echo"=========================================="

# 查看当前网卡队列数

echo""

echo"【1】当前网卡队列配置"

echo"----------------------------------------"

ethtool -l$NIC2>/dev/null ||echo"ethtool不支持此网卡"

# 查看队列深度

echo""

echo"【2】队列深度"

echo"----------------------------------------"

ethtool -g$NIC2>/dev/null ||echo"ethtool不支持此网卡"

# 查看中断聚合设置

echo""

echo"【3】中断聚合设置"

echo"----------------------------------------"

ethtool -c$NIC2>/dev/null ||echo"ethtool不支持此网卡"

# 优化中断聚合(低延迟场景)

echo""

echo"【4】优化中断聚合(低延迟配置)"

echo"----------------------------------------"

# 减小coalescing延迟,提高响应性

ethtool -C$NICrx-usecs 50 tx-usecs 50 2>/dev/null ||echo"设置失败"

# 查看CPU分布

echo""

echo"【5】IRQ亲和性"

echo"----------------------------------------"

cat /proc/interrupts | grep$NIC| head -10

4.3 移动网络优化

问题背景:

带宽:50-100Mbps

RTT:30-100ms(不稳定)

延迟抖动大

网络波动频繁

优化方案:

# 移动网络推荐配置 cat >> /etc/sysctl.conf << 'EOF' # 移动网络优化 net.ipv4.tcp_rmem=4096 131072 6291456 net.ipv4.tcp_wmem=4096 131072 4194304 # 启用TCP快速打开 net.ipv4.tcp_fastopen=3 # 保活优化 net.ipv4.tcp_keepalive_time=120 net.ipv4.tcp_keepalive_intvl=30 net.ipv4.tcp_keepalive_probes=3 # 拥塞控制选择vegas或bbr net.ipv4.tcp_congestion_control=cubic # 禁用窗口缩放(某些移动网络可能不支持) # net.ipv4.tcp_window_scaling=0 EOF sysctl -p

TCP快速打开(TFO)配置:

# 检查TFO支持

cat /proc/sys/net/ipv4/tcp_fastopen

# 启用TFO(客户端)

sysctl -w net.ipv4.tcp_fastopen=3

# 在Nginx中启用TFO

# nginx.conf

# server {

# listen 443 ssl fastopen=256;

# }

# 在应用程序中使用TFO

# 需要OS支持(Linux 3.7+)

5. 故障排查案例

5.1 案例一:跨国文件传输速度极慢

问题描述:

跨国服务器之间传输文件

带宽:1Gbps专线

文件大小:10GB

预期速度:约1GB/s(实际应该在800-900Mbps左右)

实际速度:只有50-80Mbps

传输时间:远超预期

排查过程:

#!/bin/bash # 文件名:case1_investigation.sh # 功能:案例一排查 echo"【案例一】跨国文件传输速度极慢排查" echo"==========================================" # 1. 基础延迟测试 echo"" echo"[1] 延迟测试" echo"----------------------------------------" ping -c 10 target-server | tail -2 # 2. 带宽测试 echo"" echo"[2] iperf3带宽测试" echo"----------------------------------------" iperf3 -c target-server -t 30 -P 1 -R 2>/dev/null | grep"receiver" # 3. TCP窗口检查 echo"" echo"[3] 当前TCP连接窗口" echo"----------------------------------------" ss -ti dst target-server | grep -E"rtt|bytes_acked"| head -5 # 4. 系统窗口配置 echo"" echo"[4] 系统TCP窗口配置" echo"----------------------------------------" sysctl net.ipv4.tcp_rmem sysctl net.ipv4.tcp_wmem # 5. 计算BDP echo"" echo"[5] BDP计算" echo"----------------------------------------" # 假设带宽1Gbps,RTT=180ms echo"带宽: 1000 Mbps" echo"RTT: 180 ms" echo"BDP = 1000 * 180 / 8 = 22500 KB = 约22 MB" echo"需要窗口大小 >= 22 MB 才能充分利用带宽" echo"" echo"当前系统默认窗口: 128 KB" echo"结论:窗口太小,无法达到理论带宽"

问题根因:

系统默认TCP窗口只有128KB

BDP需要22MB才能充分利用1Gbps带宽

实际带宽利用率只有约2%

解决方案:

# 应用优化配置 sysctl -w net.ipv4.tcp_rmem="4096 131072 25165824" sysctl -w net.ipv4.tcp_wmem="4096 131072 16777216" sysctl -w net.core.rmem_max=25165824 sysctl -w net.core.wmem_max=16777216 sysctl -w net.ipv4.tcp_window_scaling=1 # 或者使用BBR sysctl -w net.core.default_qdisc=fq sysctl -w net.ipv4.tcp_congestion_control=bbr

5.2 案例二:数据库查询延迟忽高忽低

问题描述:

应用服务器连接数据库服务器

网络延迟:1-5ms(正常)

但应用响应时间不稳定

有时1ms,有时20ms

导致应用超时

排查过程:

#!/bin/bash

# 文件名:case2_investigation.sh

# 功能:案例二排查

echo"【案例二】数据库查询延迟不稳定排查"

echo"=========================================="

# 1. 查看网络延迟分布

echo""

echo"[1] 延迟分布测试"

echo"----------------------------------------"

# 使用ping的大量样本来分析

ping -c 1000 target-db | awk -F'/''/^rtt/ {

print "avg="($5) " ms, min="($4) " ms, max="($6) " ms"

}'

# 2. TCP重传检查

echo""

echo"[2] TCP重传统计"

echo"----------------------------------------"

netstat -s | grep -i retransmit

# 3. 查看连接状态

echo""

echo"[3] TCP连接队列"

echo"----------------------------------------"

ss -s

# 4. MTU检查

echo""

echo"[4] MTU检查"

echo"----------------------------------------"

# 检查是否有PMTUD问题

ping -Mdo-s 1400 target-db -c 5

ping -Mdo-s 1500 target-db -c 5

# 5. Nagle算法检查

echo""

echo"[5] Nagle算法影响检查"

echo"----------------------------------------"

# 应用层是否禁用Nagle(小数据包频繁发送)

# 检查TCP_NODELAY设置

问题根因:

Nagle算法在小数据包场景下造成延迟

MTU不匹配导致分片

应用频繁发送小数据包

解决方案:

# 1. 应用层禁用Nagle算法 # Java: # socket.setTcpNoDelay(true); # Python: # sock.setsockopt(socket.IPPROTO_TCP, socket.TCP_NODELAY, 1) # 2. 检查MTU # 确保网络路径MTU一致 # 1500是标准以太网MTU # 3. 使用连接池 # 减少频繁建立连接的开销

5.3 案例三:多线程传输反而更慢

问题描述:

文件服务器之间传输数据

单线程速度:500Mbps

多线程(10个)速度:只有400Mbps

百思不得其解

排查过程:

#!/bin/bash # 文件名:case3_investigation.sh # 功能:案例三排查 echo"【案例三】多线程传输反而更慢排查" echo"==========================================" # 1. CPU使用率检查 echo"" echo"[1] CPU使用率" echo"----------------------------------------" top -bn1 | head -20 # 2. 中断分布 echo"" echo"[2] 网卡中断分布" echo"----------------------------------------" cat /proc/interrupts | grep eth0 | head -10 # 3. 网络软中断队列 echo"" echo"[3] 网络软中断状态" echo"----------------------------------------" cat /proc/softirqs | grep NET_TX # 4. 每线程带宽分析 echo"" echo"[4] 单线程vs多线程带宽对比" echo"----------------------------------------" echo"单线程:" iperf3 -c target -t 10 -P 1 -R 2>/dev/null | grep"receiver" echo"10线程:" iperf3 -c target -t 10 -P 10 -R 2>/dev/null | grep"SUM"

问题根因:

CPU成为瓶颈

网卡中断都落在单个CPU核心

多线程导致CPU上下文切换开销

解决方案:

# 1. 启用RSS(Receive Side Scaling) ethtool -L eth0 combined 4 # 使用4个队列 # 2. 设置IRQ亲和性 # 将不同队列的IRQ绑定到不同CPU核心 # 3. 启用RPS(Receive Packet Steering) echo"ff"> /sys/class/net/eth0/queues/rx-0/rps_cpus # 4. 使用高效的拥塞控制算法 sysctl -w net.ipv4.tcp_congestion_control=bbr

6. 监控与告警

6.1 TCP性能监控脚本

#!/bin/bash

# 文件名:tcp_performance_monitor.sh

# 功能:TCP性能监控

LOG_DIR="/var/log/tcp_monitor"

mkdir -p$LOG_DIR

echo"=========================================="

echo"TCP性能监控 -$(date '+%Y-%m-%d %H:%M:%S')"

echo"=========================================="

# 1. TCP连接统计

echo""

echo"【1】TCP连接统计"

echo"----------------------------------------"

ss -s | tee$LOG_DIR/ss_stats_$(date +%Y%m%d_%H%M).log

# 2. TCP错误统计

echo""

echo"【2】TCP错误统计"

echo"----------------------------------------"

netstat -s | grep -E"segments retransmitted|TCPLostRetransmit|fast retransmits|partial"| tee$LOG_DIR/tcp_errors_$(date +%Y%m%d_%H%M).log

# 3. 重传率

echo""

echo"【3】重传率分析"

echo"----------------------------------------"

netstat -s | awk'/segments received/ {rx=$1} /segments retransmitted/ {rtx=$1} END {printf "重传率: %.2f%%

", (rtx/rx)*100}'

# 4. 连接状态分布

echo""

echo"【4】连接状态分布"

echo"----------------------------------------"

ss -tan | awk'{print $1}'| sort | uniq -c | sort -rn

# 5. 高延迟连接

echo""

echo"【5】高延迟连接(>100ms)"

echo"----------------------------------------"

ss -ti state established | awk -F'Delay:''$2 ~ /[0-9]{3,}/ {print $0}'| head -10

# 6. 带宽利用率(如果安装了iperf3服务器)

echo""

echo"【6】当前带宽使用(需要iperf3服务器)"

echo"----------------------------------------"

# 这个需要根据实际情况

echo"iperf3 -c iperf-server -t 5 -R 2>/dev/null | grep receiver"

6.2 BDP问题告警

#!/bin/bash

# 文件名:bdp_alert.sh

# 功能:BDP相关问题告警

REDIS_HOST="localhost"# 如果用Redis做监控

ALERT_THRESHOLD_RTT=100 # RTT告警阈值ms

ALERT_THRESHOLD_BW_UTIL=50 # 带宽利用率告警阈值%

echo"=========================================="

echo"BDP问题告警检查 -$(date '+%Y-%m-%d %H:%M:%S')"

echo"=========================================="

# 检查高延迟

echo""

echo"【1】延迟检查"

echo"----------------------------------------"

PING_TARGETS=("8.8.8.8""目标服务器1""目标服务器2")

forTARGETin"${PING_TARGETS[@]}";do

AVG_RTT=$(ping -c 10$TARGET2>/dev/null | awk -F'/''{print $5}'| head -1)

if[ -n"$AVG_RTT"];then

echo"$TARGET:${AVG_RTT}ms"

IS_NUMERIC=$(echo"$AVG_RTT"| grep -E"^[0-9.]+$")

if[ -n"$IS_NUMERIC"] && [ $(echo"$AVG_RTT>$ALERT_THRESHOLD_RTT"| bc) -eq 1 ];then

echo" [告警] 延迟超过${ALERT_THRESHOLD_RTT}ms"

fi

fi

done

# 检查带宽利用率(如果有基准)

echo""

echo"【2】带宽利用率检查"

echo"----------------------------------------"

# 这里需要根据实际情况计算

# 假设通过iperf3测试获取带宽

echo"请使用iperf3进行实际带宽测试"

# 检查TCP窗口配置

echo""

echo"【3】TCP窗口配置检查"

echo"----------------------------------------"

WINDOW_MAX=$(sysctl -n net.core.rmem_max 2>/dev/null)

TCP_WMEM=$(sysctl -n net.ipv4.tcp_wmem 2>/dev/null)

echo"最大接收窗口:$(echo "scale=2; $WINDOW_MAX / 1024 / 1024" | bc)MB"

echo"发送窗口配置:$TCP_WMEM"

# 判断是否需要优化

# 如果WINDOW_MAX < 6MB,可能需要优化

if [ $WINDOW_MAX -lt 6291456 ]; then

echo " [建议] 接收窗口偏小,建议增大到6MB以上"

fi

7. 最佳实践总结

7.1 BDP计算公式速查

# 快速计算BDP和推荐窗口 # 公式: BDP_MB = 带宽_Mbps × RTT_ms / 8000 # 示例: # 带宽1Gbps=1000Mbps, RTT=200ms # BDP = 1000 × 200 / 8000 = 25 MB # 推荐窗口 = BDP × 1.5~2(留余量) # 推荐窗口 = 25 × 2 = 50 MB

7.2 配置推荐

高延迟大带宽(跨国、高带宽专线):

net.ipv4.tcp_rmem=4096 262144 16777216 net.ipv4.tcp_wmem=4096 262144 16777216 net.core.rmem_max=16777216 net.core.wmem_max=16777216 net.ipv4.tcp_window_scaling=1 net.ipv4.tcp_timestamps=1 net.ipv4.tcp_sack=1 net.core.default_qdisc=fq net.ipv4.tcp_congestion_control=bbr

低延迟数据中心:

net.ipv4.tcp_rmem=4096 87380 6291456 net.ipv4.tcp_wmem=4096 65536 4194304 net.core.netdev_max_backlog=100000 net.ipv4.tcp_slow_start_after_idle=0 net.ipv4.tcp_tw_reuse=1

移动网络:

net.ipv4.tcp_rmem=4096 131072 6291456 net.ipv4.tcp_wmem=4096 131072 4194304 net.ipv4.tcp_fastopen=3 net.ipv4.tcp_keepalive_time=120

7.3 问题诊断流程

TCP/BDP问题诊断流程:

┌─────────────────────────────────────────────────────┐

│ 1. 基础测量 │

│ - ping测量RTT │

│ - traceroute检查路由 │

│ - iperf3测量带宽 │

└─────────────────────┬───────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────┐

│ 2. 计算BDP │

│ - BDP = 带宽(Mbps) × RTT(ms) / 8 │

│ - 得到的单位是KB │

└─────────────────────┬───────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────┐

│ 3. 检查窗口配置 │

│ - sysctl net.ipv4.tcp_rmem │

│ - sysctl net.ipv4.tcp_wmem │

│ - ss -ti查看实际窗口 │

└─────────────────────┬───────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────┐

│ 4. 判断问题类型 │

│ - 窗口 < BDP:窗口不足导致带宽浪费 │

│ - 重传多:网络质量问题 │

│ - 延迟抖动:网络不稳定 │

└─────────────────────┬───────────────────────────────┘

│

▼

┌─────────────────────────────────────────────────────┐

│ 5. 实施优化 │

│ - 增大窗口配置 │

│ - 启用BBR │

│ - 优化拥塞控制算法 │

│ - 网络设备调优 │

└─────────────────────────────────────────────────────┘

7.4 常用命令速查

| 命令 | 用途 |

|---|---|

| ping -c 10 host | 测量RTT |

| traceroute host | 路由追踪 |

| iperf3 -c host -t 10 | 带宽测试 |

| ss -ti | 查看TCP连接详情 |

| sysctl net.ipv4.tcp_wmem | 查看发送窗口配置 |

| netstat -s | TCP统计信息 |

| ethtool -k eth0 | 网卡特性 |

| ethtool -G eth0 | 网卡队列 |

8. 总结

8.1 核心要点回顾

BDP概念:

BDP = 带宽 × RTT

代表网络上"飞行中"的数据量

窗口必须大于BDP才能充分利用带宽

常见误区:

以为带宽大就一定快,忽略了延迟影响

默认TCP窗口配置在高速网络下不足

忽视拥塞控制算法选择

优化方向:

增大TCP窗口配置

选择合适的拥塞控制算法(BBR)

应用层优化(NODELAY、缓冲区)

网络设备优化(网卡队列、中断)

8.2 性能目标参考

| 场景 | 带宽利用率目标 |

|---|---|

| 高延迟大带宽(跨国) | 70-90% |

| 低延迟数据中心 | 90-99% |

| 移动网络 | 50-80% |

8.3 进一步学习建议

推荐资源:

RFC 1323(TCP窗口缩放)

RFC 2581(TCP拥塞控制)

《TCP/IP详解 卷1:协议》

iperf3官方文档

实践建议:

在测试环境模拟不同延迟和带宽

建立网络性能基准测试

定期监控TCP重传率

关注内核更新,BBR持续改进

通过本文的学习,应该能够理解BDP的原理,识别生产环境中的BDP问题,并采取正确的优化措施。网络性能优化是一个系统工程,需要综合考虑带宽、延迟、窗口配置和应用程序等多个方面。

-

服务器

+关注

关注

14文章

10480浏览量

91940 -

TCP

+关注

关注

8文章

1441浏览量

83980 -

数据库

+关注

关注

7文章

4098浏览量

68757

原文标题:TCP/BDP问题:网络延迟的隐形杀手

文章出处:【微信号:magedu-Linux,微信公众号:马哥Linux运维】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

TCP协议如何优化

蓝光机 BDP-630/BDP-610/BDP-620/BDP-100/BD-160

TCP优化之TCP/IP网络流量加速

【转】电力电子电路故障诊断方法

如何优化LWIP TCP接收性能?

TD-HSUPA系统的TCP优化方法

基于WRED协议的TCP连接初始化的优化方法

TCP/IP协议典型的优化原则和方法

TCP/BDP问题的诊断方法和优化方案

TCP/BDP问题的诊断方法和优化方案

评论