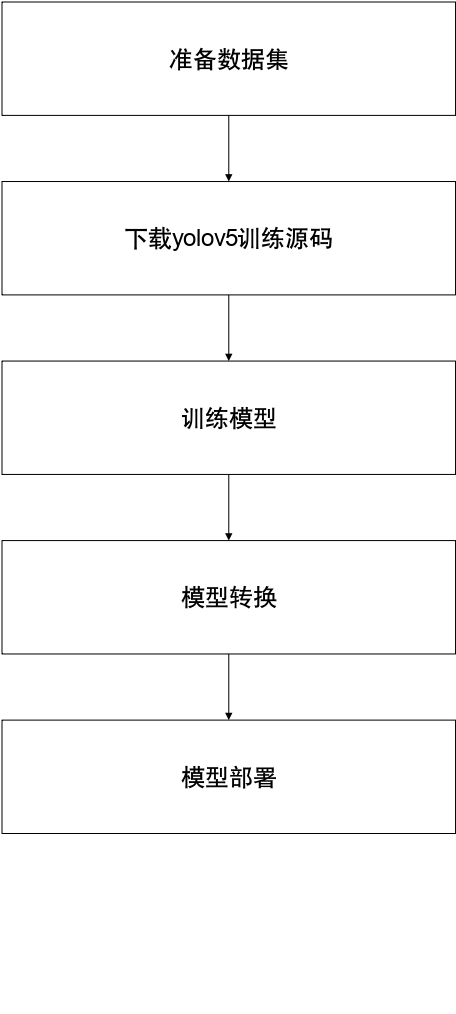

1. Yolov5简介

YOLOv5 模型是 Ultralytics 公司于 2020 年 6 月 9 日公开发布的。YOLOv5 模型是基于 YOLOv3 模型基础上改进而来的,有 YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x 四个模型。YOLOv5 相比YOLOv4 而言,在检测平均精度降低不多的基础上,具有均值权重文件更小,训练时间和推理速度更短的特点。YOLOv5 的网络结构分为输入端BackboneNeck、Head 四个部分。

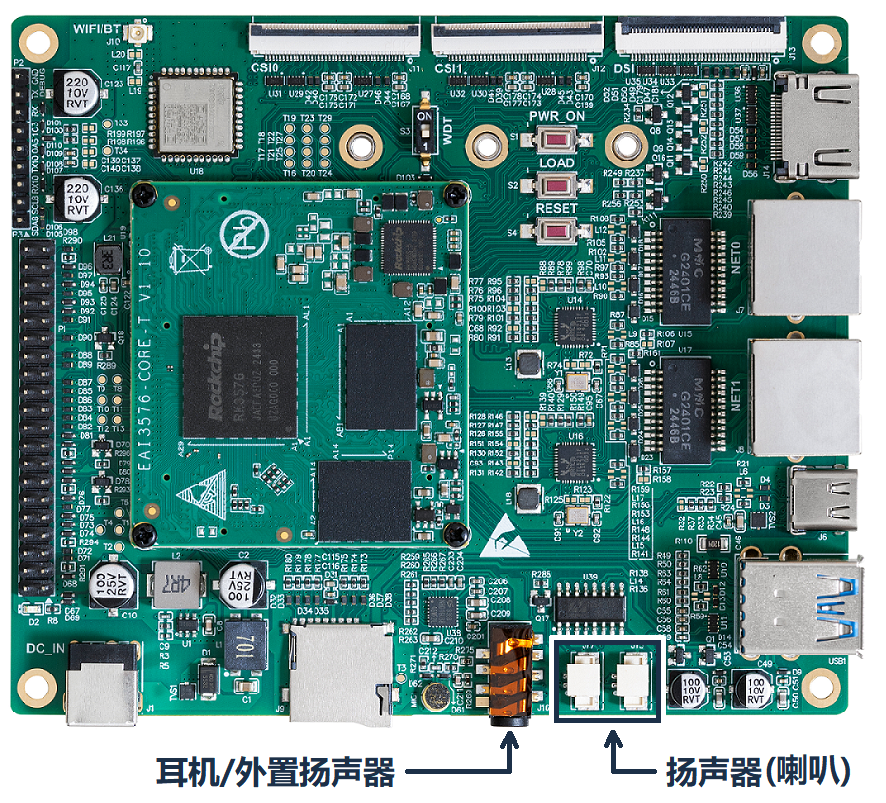

本教程针对目标检测算法yolov5的训练和部署到EASY-EAI-Orin-nano(RK3576)进行说明,而数据标注方法可以参考我们往期的文章。

2. 准备数据集

2.1 数据集下载

本教程以口罩检测为例,数据集的百度网盘下载链接为:

https://pan.baidu.com/s/17nJq2dQXxTHwc8eo8sNj5A?pwd=1234 提取码:1234

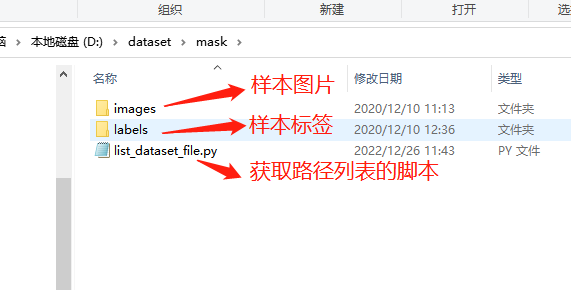

解压完成后得到以下三个文件:

2.2 生成路径列表

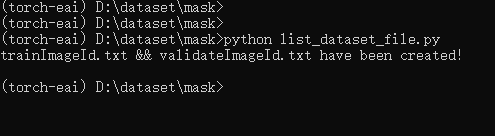

在数据集目录下执行脚本list_dataset_file.py:

python list_dataset_file.py

执行现象如下图所示:

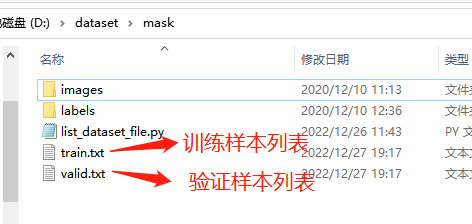

得到训练样本列表文件train.txt和验证样本列表文件valid.txt,如下图所示:

3. Yolov5目标检测算法训练

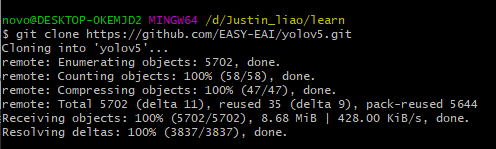

3.1 训练源码下载

通过git工具,在PC端克隆远程仓库(注:此处可能会因网络原因造成卡顿,请耐心等待):

git clone https://github.com/EASY-EAI/yolov5.git

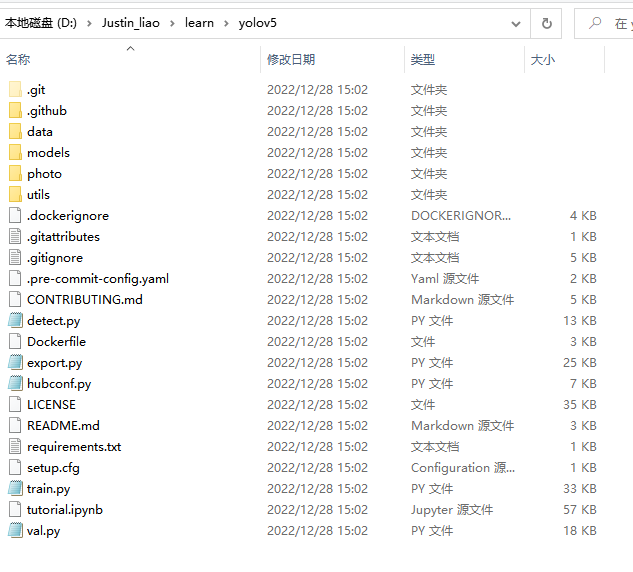

得到下图所示目录:

3.2 训练模型

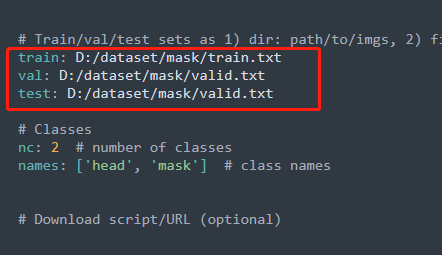

切换到yolov5的工作目录,接下来以训练一个口罩检测模型为例进行说明。需要修改data/mask.yaml里面的train.txt和valid.txt的路径。

执行下列脚本训练算法模型:

python train.py --data mask.yaml --cfg yolov5s.yaml --weights "" --batch-size 64

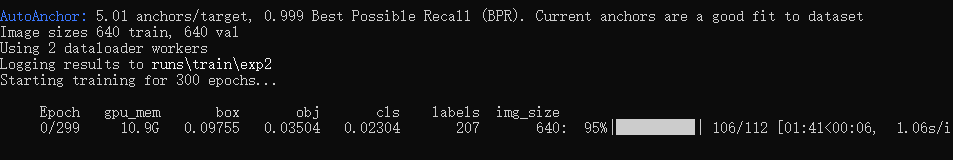

开始训练模型,如下图所示:

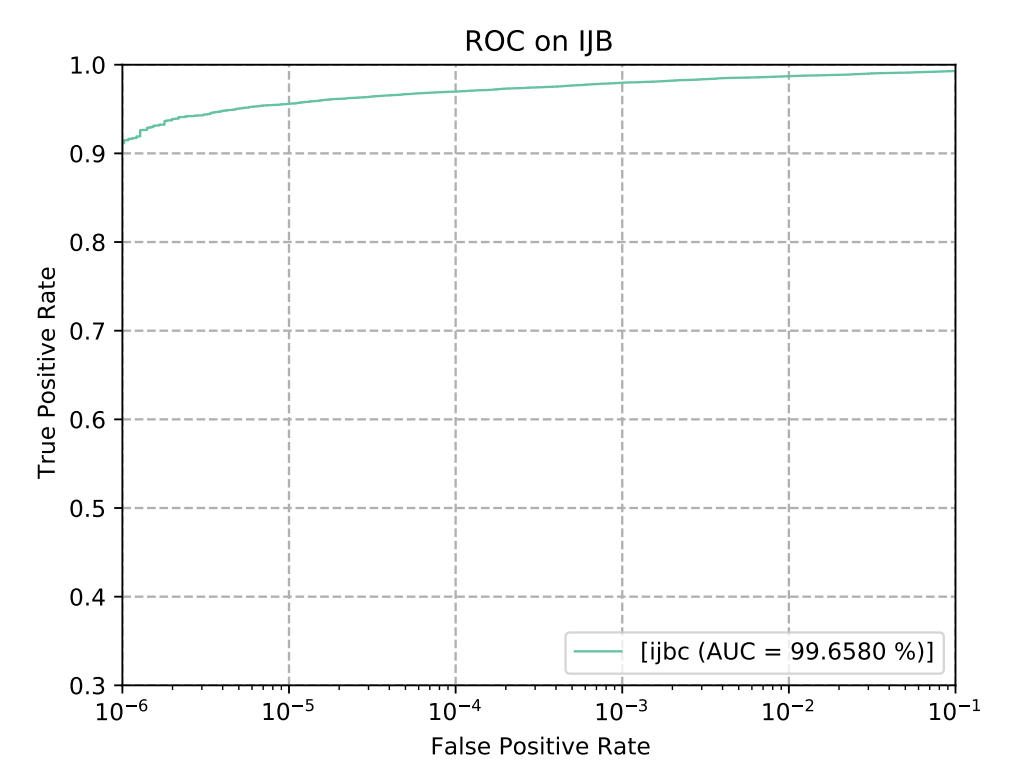

关于算法精度结果可以查看./runs/train/results.csv获得。

3.3 在PC端进行模型预测

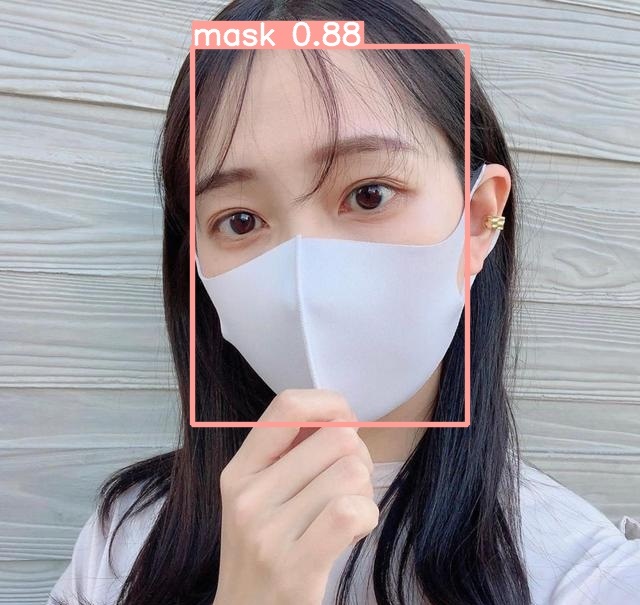

训练完毕后,在./runs/train/exp/weights/best.pt生成通过验证集测试的最好结果的模型。同时可以执行模型预测,初步评估模型的效果:

python detect.py --source data/images --weights ./runs/train/exp/weights/best.pt --conf 0.5

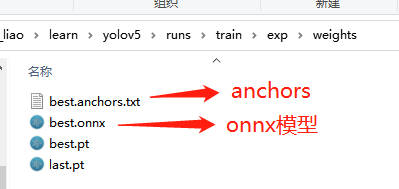

3.4 pt模型转换为onnx模型

算法部署到EASY-EAI-Nano需要转换为RKNN模型,而转换RKNN之前可以把模型先转换为ONNX模型,同时会生成best.anchors.txt:

python export.py --include onnx --rknpu RV1126 --weights ./runs/train/exp/weights/best.pt

生成如下图所示:

4. rknn-toolkit模型转换

4.1 rknn-toolkit模型转换环境搭建

onnx模型需要转换为rknn模型才能在EASY-EAI-Orin-nano运行,所以需要先搭建rknn-toolkit模型转换工具的环境。当然tensorflow、tensroflow lite、caffe、darknet等也是通过类似的方法进行模型转换,只是本教程onnx为例。

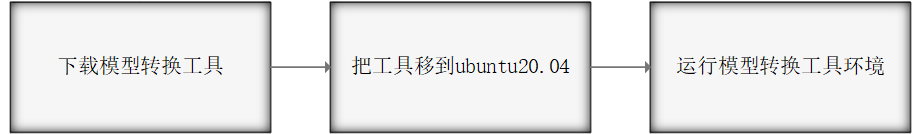

4.1.1 概述

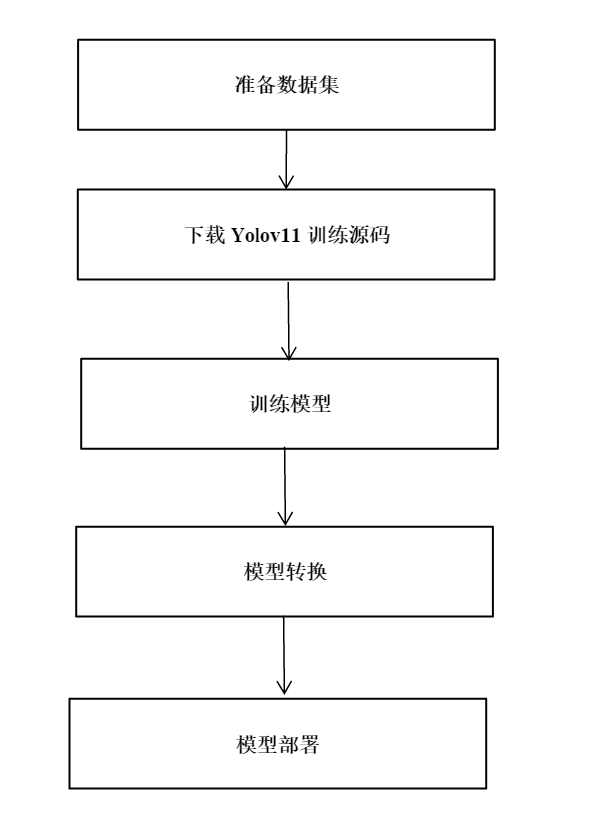

模型转换环境搭建流程如下所示:

4.1.2 下载模型转换工具

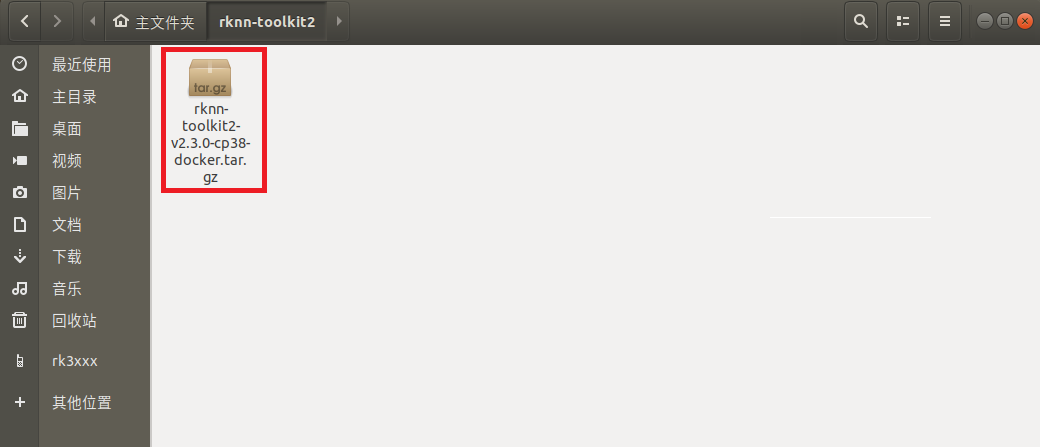

为了保证模型转换工具顺利运行,请下载网盘里“06.AI算法开发/01.rknn-toolkit2模型转换工具/rknn-toolkit2-v2.3.0/docker/rknn-toolkit2-v2.3.0-cp38-docker.tar.gz”。

网盘下载链接:https://pan.baidu.com/s/1J86chdq1klKFnpCO1RCcEA?pwd=1234提取码:1234

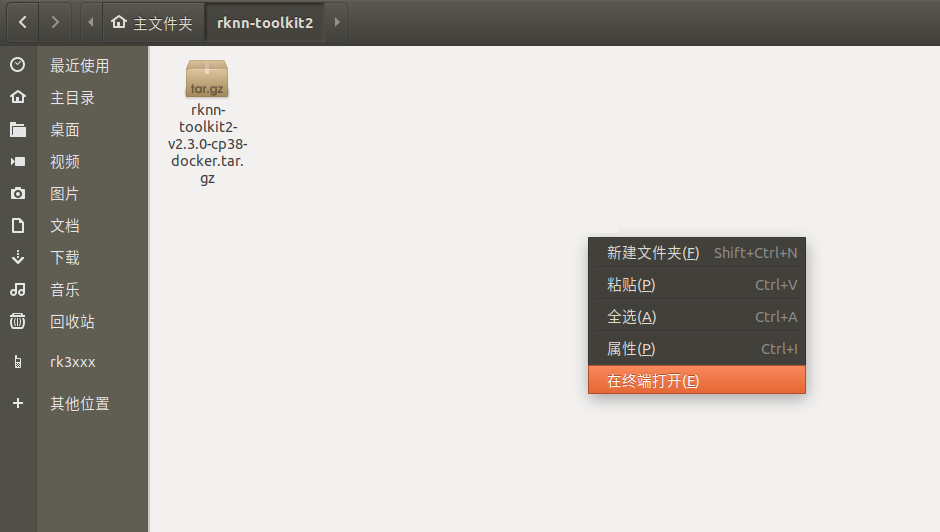

4.1.3 把工具移到ubuntu20.04

把下载完成的docker镜像移到我司的虚拟机ubuntu20.04的rknn-toolkit2目录,如下图所示:

4.1.4 运行模型转换工具环境

在该目录打开终端

执行以下指令加载模型转换工具docker镜像:

docker load --input rknn-toolkit2-v2.3.0-cp38-docker.tar.gz

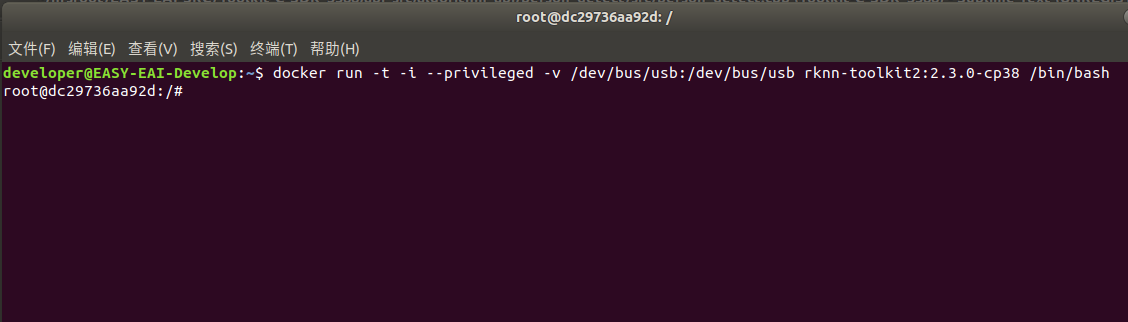

执行以下指令进入镜像bash环境:

docker run -t -i --privileged -v /dev/bus/usb:/dev/bus/usb rknn-toolkit2:2.3.0-cp38 /bin/bash

现象如下图所示:

输入“python”加载python相关库,尝试加载rknn库,如下图环境测试成功:

至此,模型转换工具环境搭建完成。

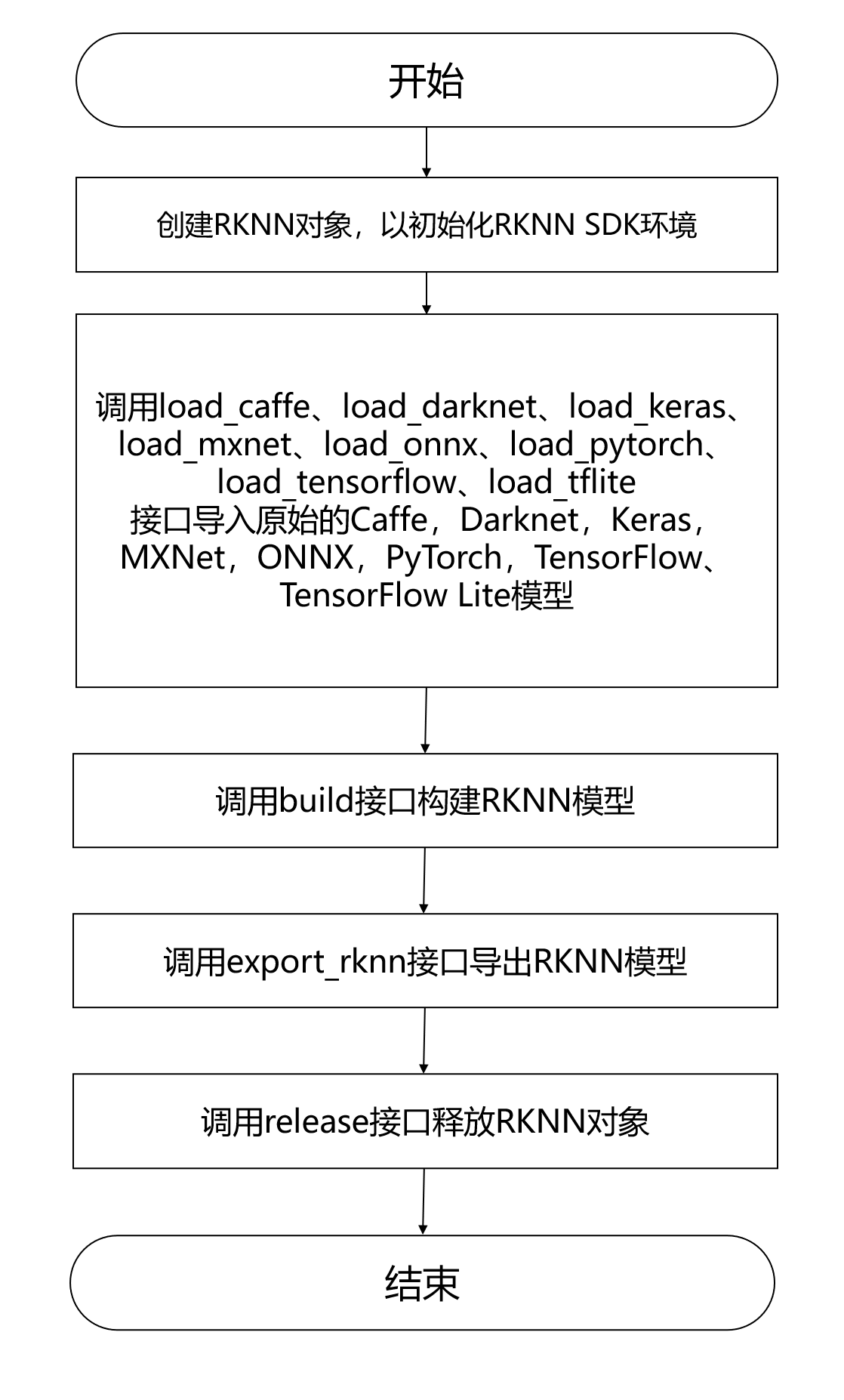

4.2 型转换为RKNN

EASY-EAI-Orin-nano支持.rknn后缀的模型的评估及运行,对于常见的tensorflow、tensroflow lite、caffe、darknet、onnx和Pytorch模型都可以通过我们提供的 toolkit 工具将其转换至 rknn 模型,而对于其他框架训练出来的模型,也可以先将其转至 onnx 模型再转换为 rknn 模型。 模型转换操作流程入下图所示:

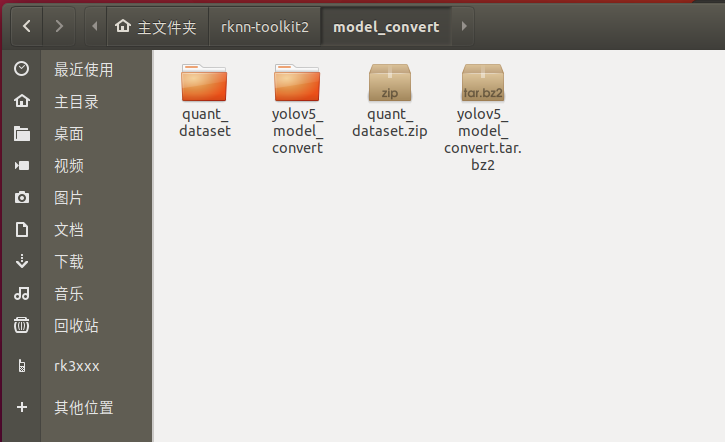

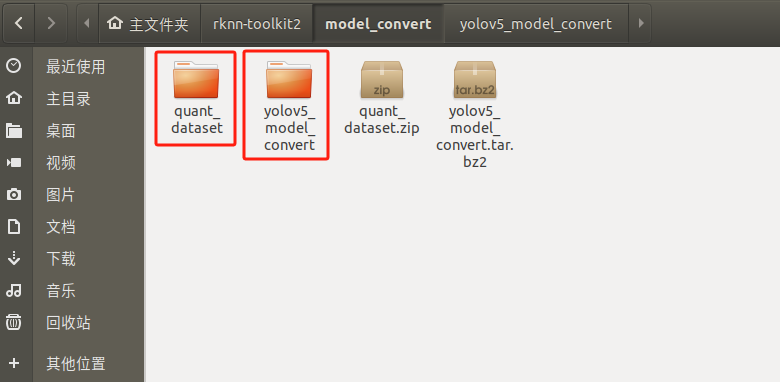

4.2.1 模型转换Demo下载

下载百度网盘链接:https://pan.baidu.com/s/1yWWn9JryiAOrSBNGWxuFMw?pwd=1234 提取码:1234。把 yolov5_model_convert.tar.bz2和quant_dataset.zip解压到虚拟机,如下图所示:

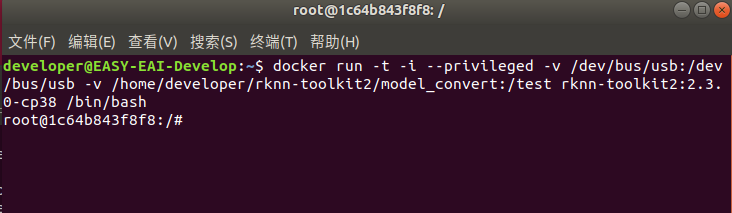

4.2.2 进入模型转换工具docker环境

执行以下指令把工作区域映射进docker镜像,其中/home/developer/rknn-toolkit2/model_convert为工作区域,/test为映射到docker镜像,/dev/bus/usb:/dev/bus/usb为映射usb到docker镜像:

docker run -t -i --privileged -v /dev/bus/usb:/dev/bus/usb -v /home/developer/rknn-toolkit2/model_convert:/test rknn-toolkit2:2.3.0-cp38 /bin/bash

执行成功如下图所示:

4.2.3 模型转换Demo目录结构介绍

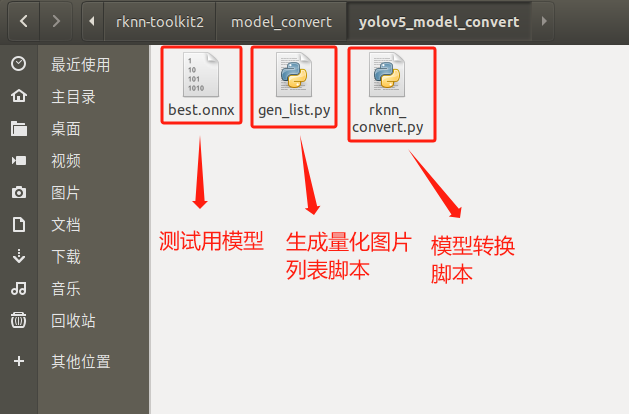

模型转换测试Demo由yolov5_model_convert和quant_dataset组成。yolov5_model_convert存放软件脚本,quant_dataset存放量化模型所需的数据。如下图所示:

yolov5_model_convert文件夹存放以下内容,如下图所示:

4.2.4 生成量化图片列表

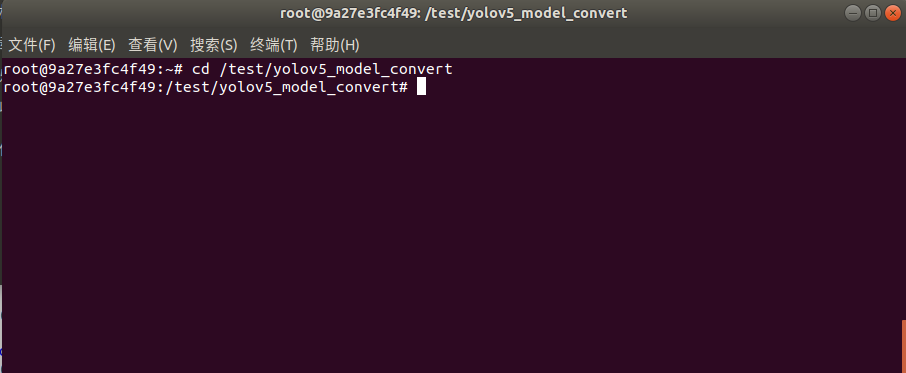

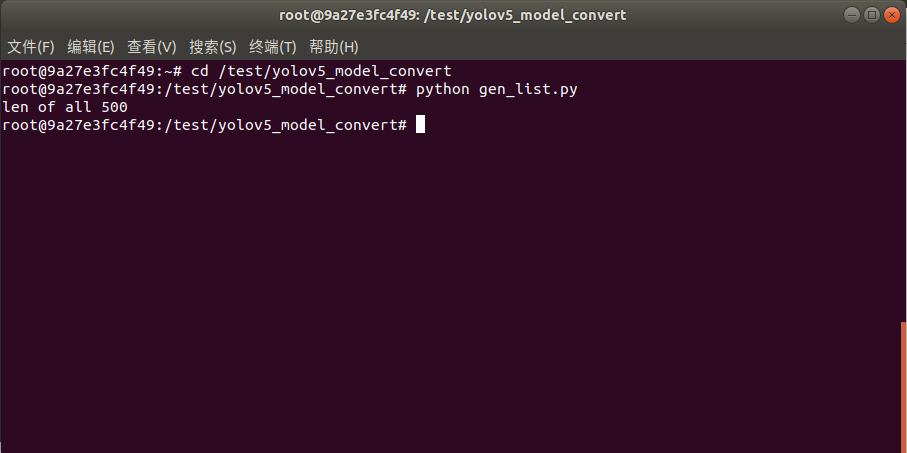

在docker环境切换到模型转换工作目录:

cd /test/yolov5_model_convert

如下图所示:

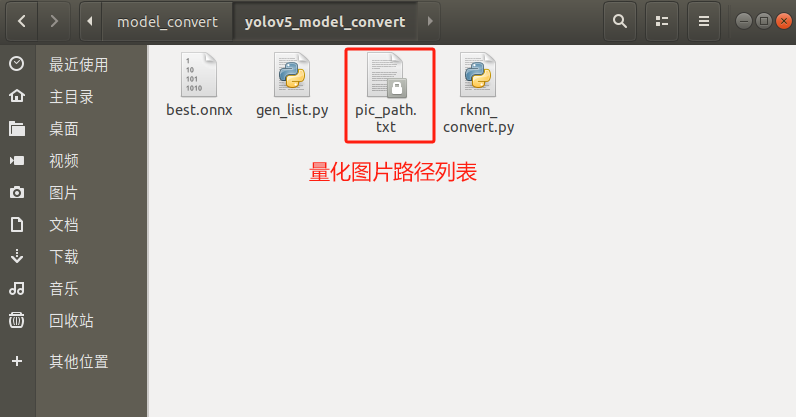

执行gen_list.py生成量化图片列表:

python gen_list.py

命令行现象如下图所示:

生成“量化图片列表”如下文件夹所示:

4.2.5 onnx模型转换为rknn模型

rknn_convert.py脚本默认进行int8量化操作,脚本代码清单如下所示:

import os import urllib import traceback import time import sys import numpy as np import cv2 from rknn.api import RKNN ONNX_MODEL = 'best.onnx' RKNN_MODEL = './bsd_person.rknn' DATASET = './pic_path.txt' QUANTIZE_ON = True if __name__ == '__main__': # Create RKNN object rknn = RKNN(verbose=True) if not os.path.exists(ONNX_MODEL): print('model not exist') exit(-1) # pre-process config print('--> Config model') rknn.config(reorder_channel='0 1 2', mean_values=[[0, 0, 0]], std_values=[[255, 255, 255]], optimization_level=3, target_platform = 'rv1126', output_optimize=1, quantize_input_node=QUANTIZE_ON) print('done') # Load ONNX model print('--> Loading model') ret = rknn.load_onnx(model=ONNX_MODEL) if ret != 0: print('Load yolov5 failed!') exit(ret) print('done') # Build model print('--> Building model') ret = rknn.build(pre_compile=True,do_quantization=QUANTIZE_ON, dataset=DATASET) if ret != 0: print('Build yolov5 failed!') exit(ret) print('done') # Export RKNN model print('--> Export RKNN model') ret = rknn.export_rknn(RKNN_MODEL) if ret != 0: print('Export yolov5rknn failed!') exit(ret) print('done')

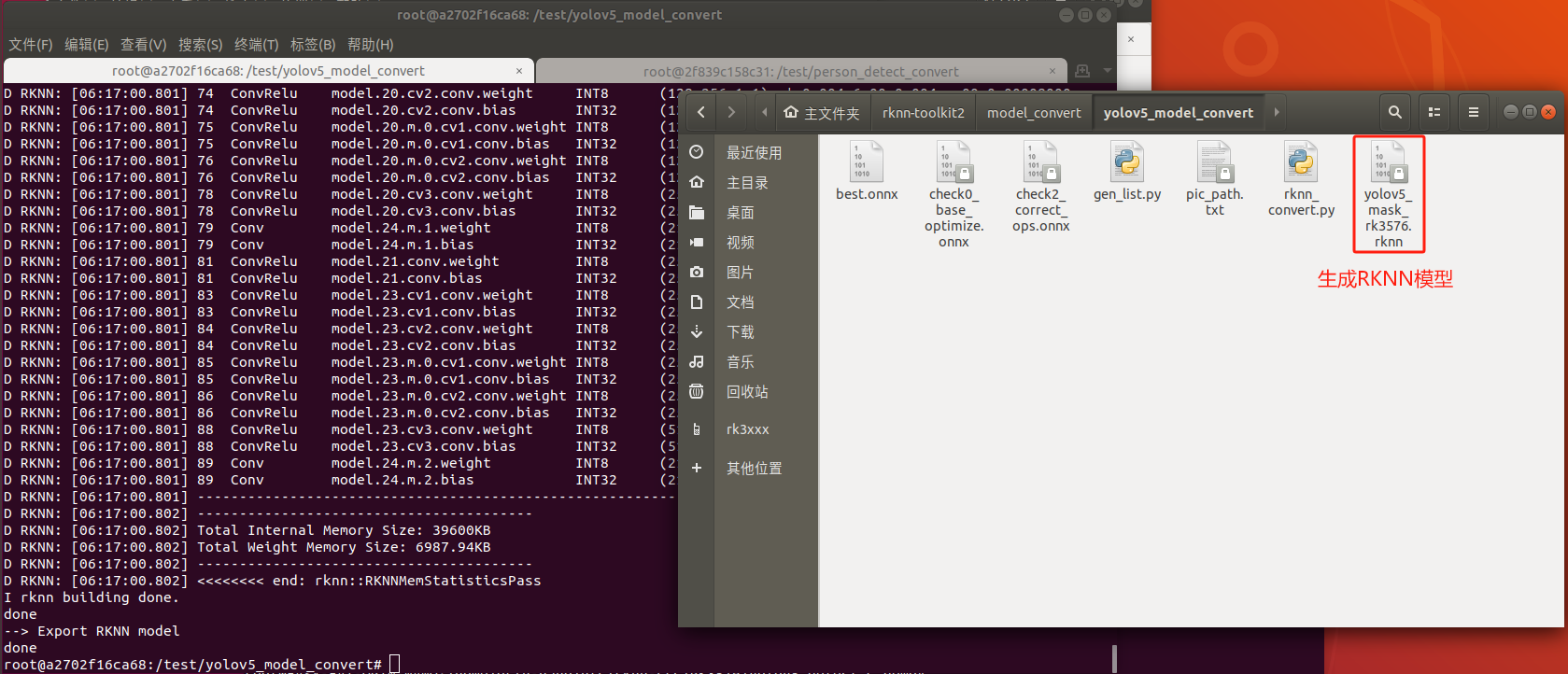

把onnx模型best.onnx放到yolov5_model_convert目录,并执行rknn_convert.py脚本进行模型转换:

python rknn_convert.py

生成模型如下图所示,此模型可以在rknn环境和EASY EAI Orin nano环境运行:

5. 模型部署示例

5.1 模型部署示例介绍

本小节展示yolov5模型的在EASY EAI Orin nano的部署过程,该模型仅经过简单训练供示例使用,不保证模型精度。

5.2 源码下载以及例程编译

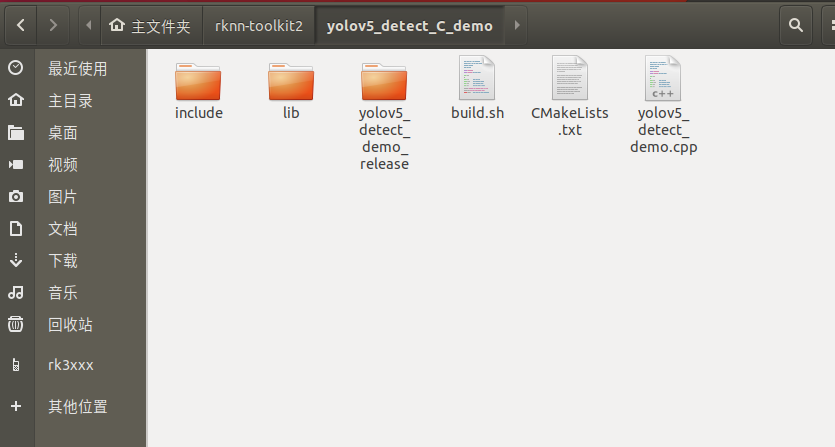

下载yolov5 C Demo示例文件。

百度网盘链接: (https://pan.baidu.com/s/1adoQOIsm1C5GIxeh0UnK5g?pwd=1234提取码:1234)。

下载程序包移至ubuntu环境后,执行以下指令解压:

tar -xvf yolov5_detect_C_demo.tar.bz2

下载解压后如下图所示:

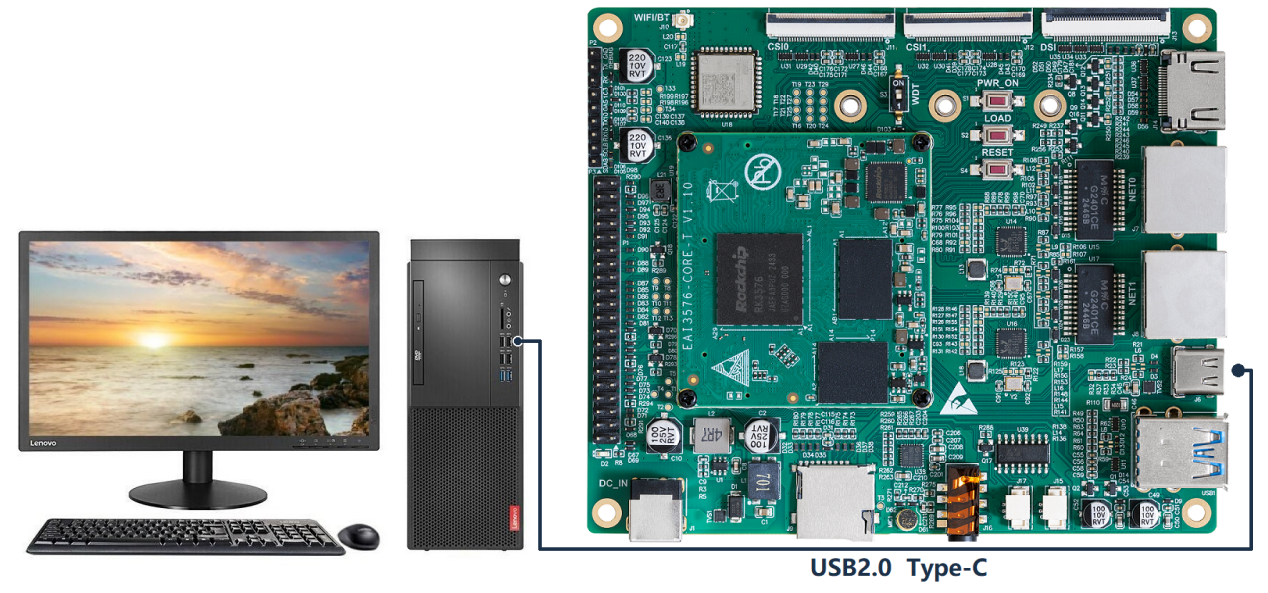

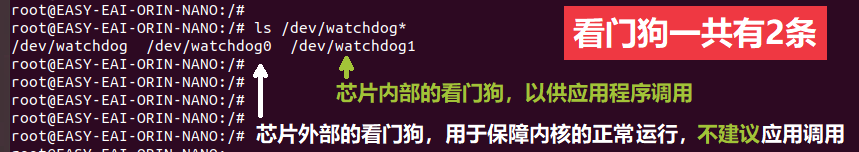

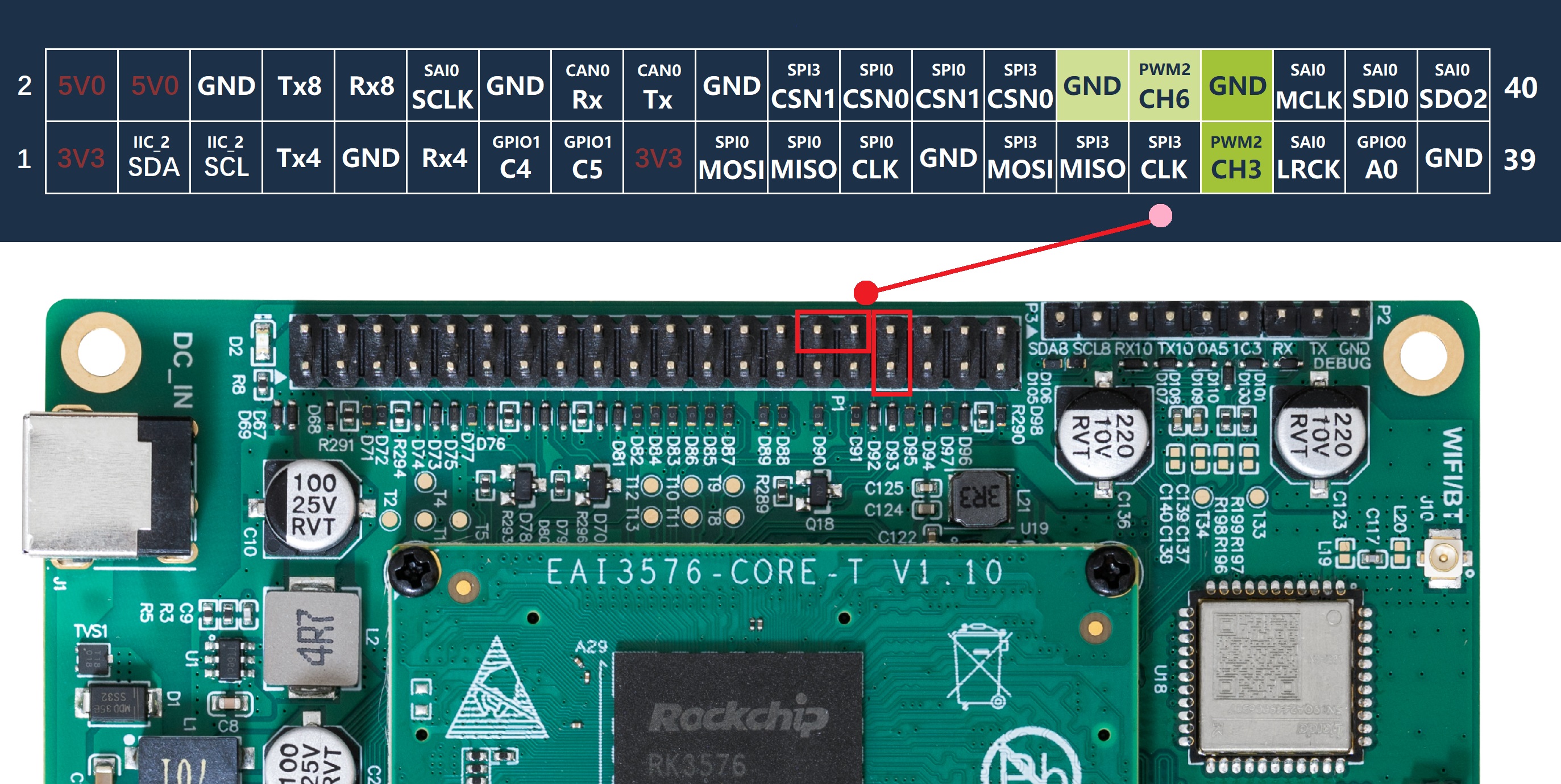

通过adb接口连接EASY-EAI-Orin-nano,,连接方式如下图所示:

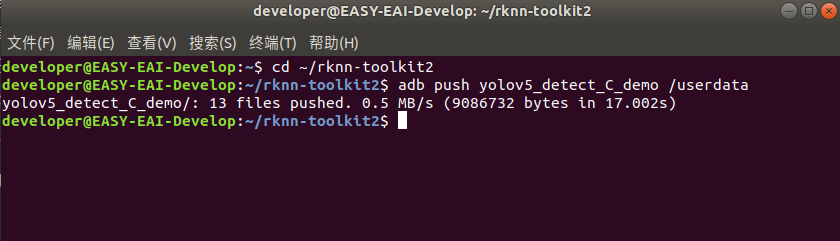

接下来需要通过adb把源码传输到板卡上,先切换目录然后执行以下指令:

cd ~/rknn-toolkit2 adb push yolov5_detect_C_demo /userdata

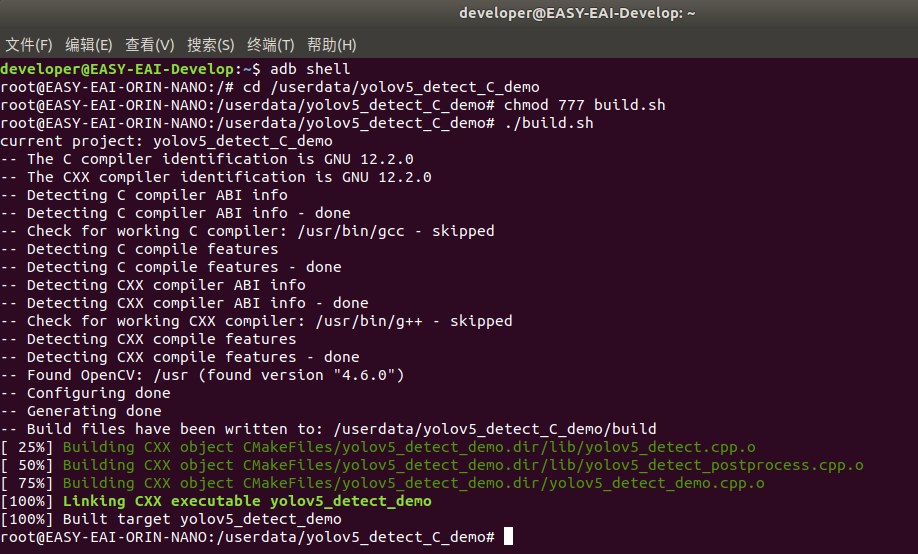

登录到板子切换到例程目录执行编译操作:

adb shell cd /userdata/yolov5_detect_C_demo chmod 777 build.sh ./build.sh

5.3 在开发板执行yolov5 目标检测算法

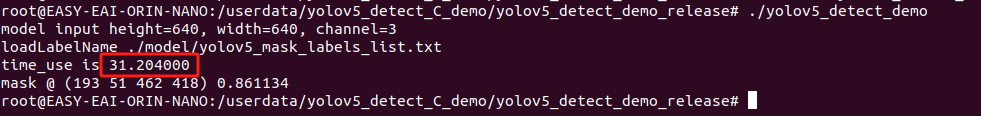

编译成功后切换到可执行程序目录,如下所示:

cd /userdata/yolov5_detect_C_demo/yolov5_detect_demo_release

运行例程命令如下所示:

chmod 777 yolov5_detect_demo ./yolov5_detect_demo

执行结果如下图所示,算法执行时间为31ms:

退出板卡环境,取回测试图片:

exit adb pull /userdata/yolov5_detect_C_demo/yolov5_detect_demo_release/result.jpg .

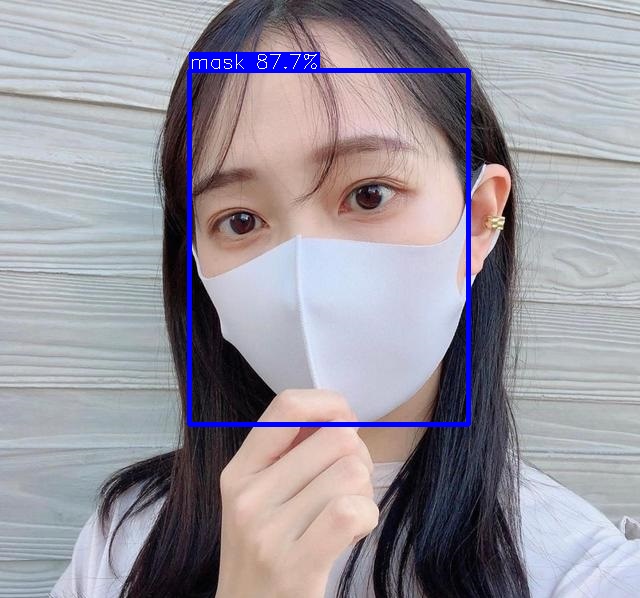

测试结果如下图所示:

至此,yolov5目标检测例程已成功在板卡运行。

6. 资料下载

| 资料名称 | 链接 |

| 训练代码github | https://github.com/EASY-EAI/yolov5 |

| 算法教程完整源码包 |

https://pan.baidu.com/s/1wlD6z7G9puELd0zgRC3BjA?pwd=1234 提取码:1234 |

审核编辑 黄宇

-

开发板

+关注

关注

26文章

6419浏览量

120825 -

rk3576

+关注

关注

1文章

297浏览量

1670

发布评论请先 登录

【米尔RK3576开发板评测】+项目名称YOLOV5目标检测

RK3576 yolov11-seg训练部署教程

基于RK3576开发板的MIPI-DSI使用

RK3576 Yolov11训练部署教程

基于瑞芯微RK3576的 yolov5训练部署教程

基于RK3576开发板的yolov5训练部署教程

基于RK3576开发板的yolov5训练部署教程

评论